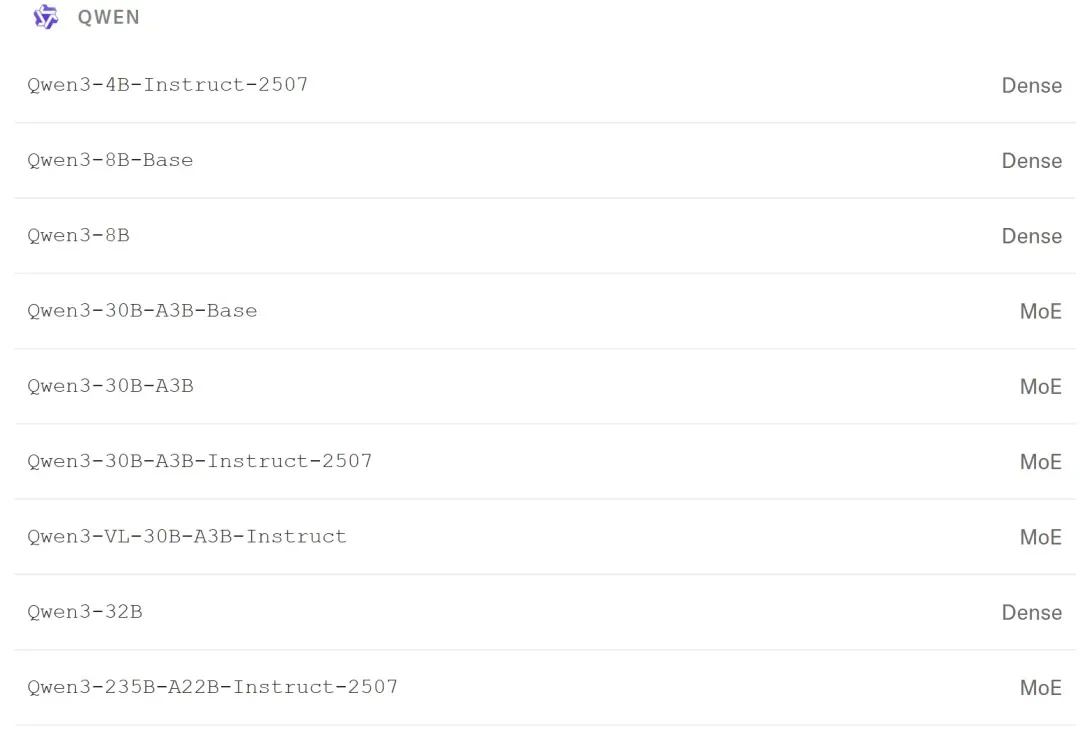

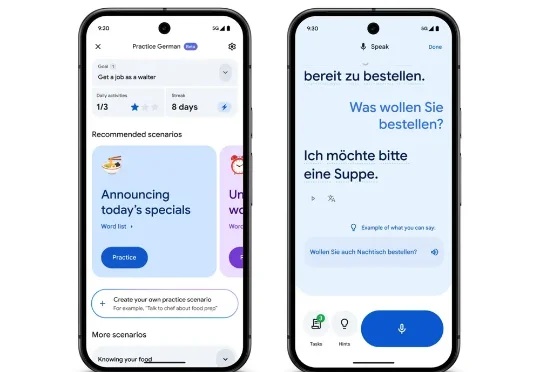

Thinking Machines首款产品重大更新:K2 Thinking、Qwen3-VL都可以微调了

Thinking Machines首款产品重大更新:K2 Thinking、Qwen3-VL都可以微调了当前,AI 领域的研究者与开发者在关注 OpenAI、Google 等领先机构最新进展的同时,也将目光投向了由前 OpenAI CTO Mira Murati 创办的 Thinking Machines Lab。

当前,AI 领域的研究者与开发者在关注 OpenAI、Google 等领先机构最新进展的同时,也将目光投向了由前 OpenAI CTO Mira Murati 创办的 Thinking Machines Lab。

「发现式智能」理念落地,天桥脑科学研究院尖峰智能实验室启航!当马斯克还在开颅切脑,国内这家世界最大私人脑科学研究机构开启「脑机共生」新时代。

关键在于,从加入那一刻起,你就能对公司产生影响。因此在团队中,你可能承担任何角色。资历长短不会决定你在层级中的位置。只要足够聪明、敏捷且充满热情,就能快速提升自我——这点确实很有帮助。

Google 周五宣布,正式向 Google 翻译引入其 Gemini 模型的各项能力。此次更新不仅带来了能够通过耳机进行的实时语音翻译 Beta 版体验,还大幅提升了文本翻译的语境理解能力,并扩展了应用内的语言学习工具。

大家还记得Mira Murati吗?那个曾经主导ChatGPT开发的“AI女王”,OpenAI的前CTO,2024年突然离职后,让整个科技圈炸锅!短短几个月,融资20亿美元,估值飙到120亿美元,现在更传出新一轮融资目标直冲500亿美元!这速度,这手笔,简直是AI界的“神话”!而最近的重磅炸弹来了:他们的首款产品Tinker正式全面开放!不再需要等待名单,人人可用!

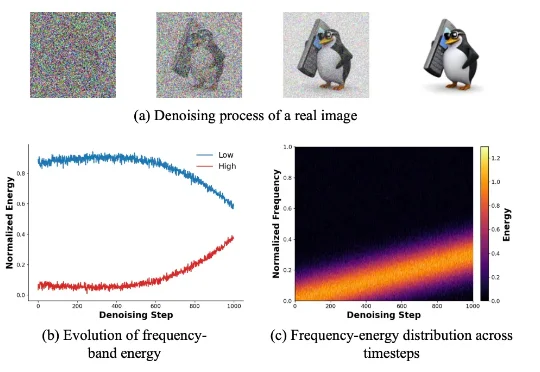

新加坡国立大学 LV Lab(颜水成团队) 联合电子科技大学、浙江大学等机构提出 FeRA (Frequency-Energy Constrained Routing) 框架:首次从频域能量的第一性原理出发,揭示了扩散去噪过程具有显著的「低频到高频」演变规律,并据此设计了动态路由机制。

这是 AI 带来的市场的充分性竞争。

最近刷到了 Macaron 发布的一条技术视频。

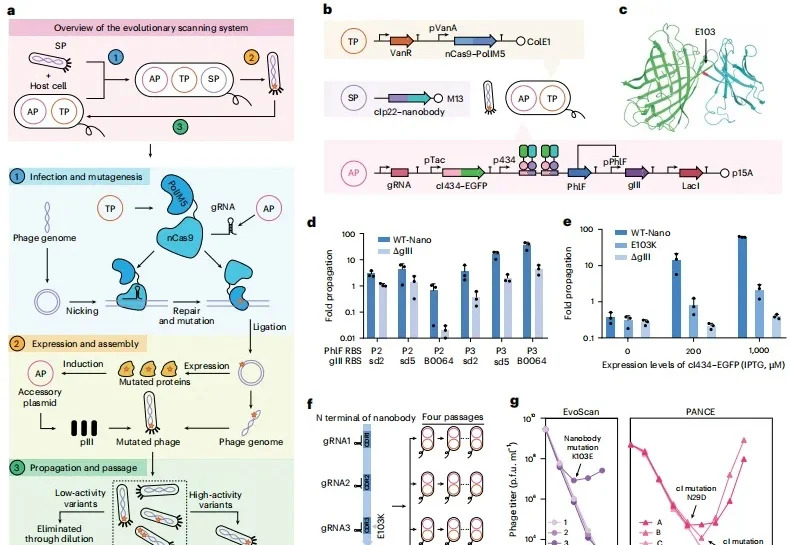

从去年到今年,清华大学教授张数一和团队连着两个冬天做出两个“AI+蛋白质”成果,它们分别是极速压缩与智能重建蛋白质序列空间的 EvoAI,以及能够 24 小时昼夜不停、全自动进化蛋白质的 iAutoEvoLab 工厂。相关论文分别发表于 Nature Methods 和 Nature Chemical Engineering。

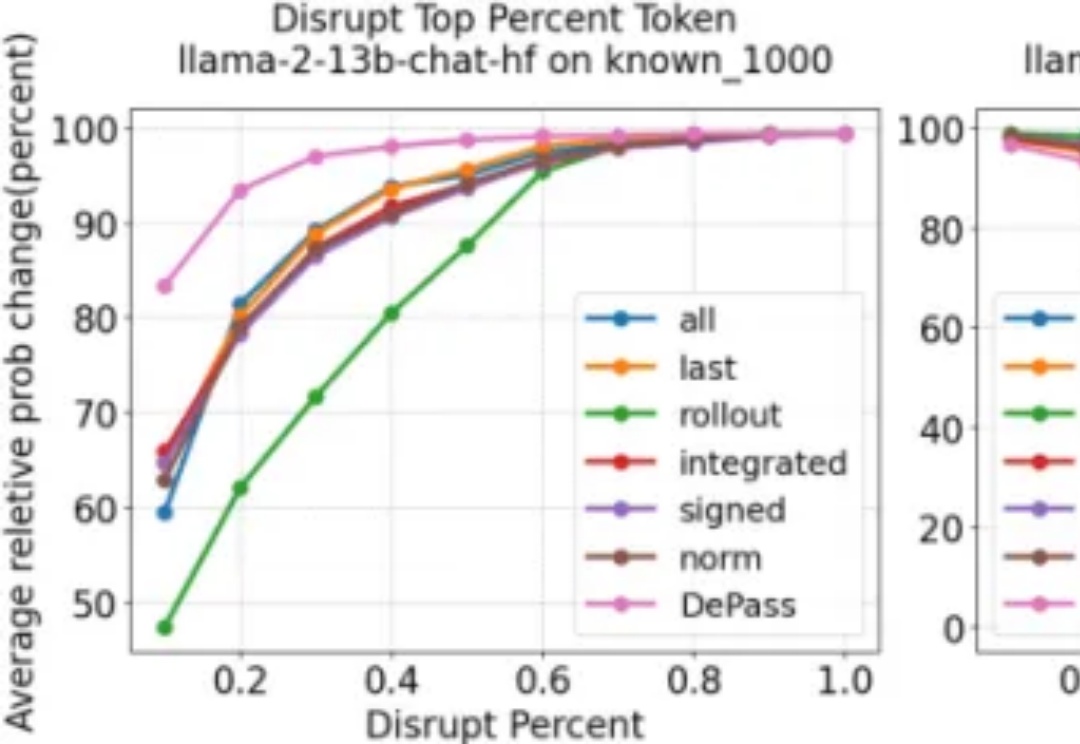

随着大型语言模型在各类任务中展现出卓越的生成与推理能力,如何将模型输出精确地追溯到其内部计算过程,已成为 AI 可解释性研究的重要方向。然而,现有方法往往计算代价高昂、难以揭示中间层的信息流动;同时,不同层面的归因(如 token、模型组件或表示子空间)通常依赖各自独立的特定方法,缺乏统一且高效的分析框架。