AI「看不懂」、「做不好」视频的问题,混元用「MTSS」解决了

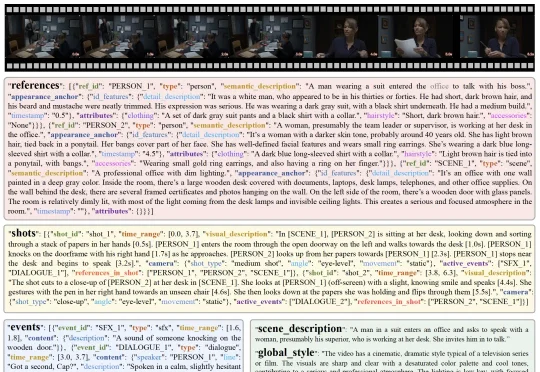

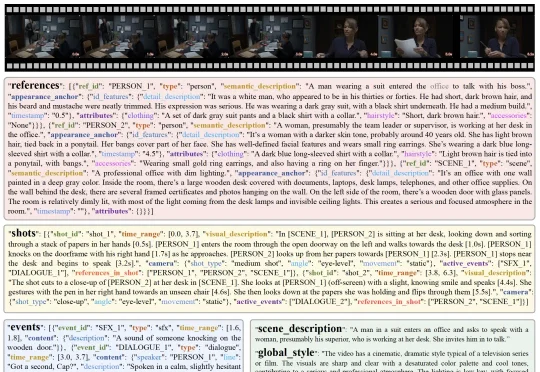

AI「看不懂」、「做不好」视频的问题,混元用「MTSS」解决了腾讯混元团队提出了 Multi-Stream Scene Script(MTSS),一种全新的视频描述范式 —— 将传统的 "一段话描述整个视频" 升级为 "多流结构化剧本",通过 Stream Factorization 和 Relational Grounding 两大核心原则,让视频描述既忠实又可扩展,在视频理解和生成任务中均取得显著提升。

腾讯混元团队提出了 Multi-Stream Scene Script(MTSS),一种全新的视频描述范式 —— 将传统的 "一段话描述整个视频" 升级为 "多流结构化剧本",通过 Stream Factorization 和 Relational Grounding 两大核心原则,让视频描述既忠实又可扩展,在视频理解和生成任务中均取得显著提升。

张佳圆带着他的新产品 Multica 一周斩获 GitHub 1.2w Star回来了。这一次,他想探索的是: 当 AI Agent 已经足够好,一个团队要怎么和多个 Agent 丝滑地协作?Multica 致敬的是 1964 年的操作系统 Multics——那个最终失败、但启发了 Unix 世界半个世纪的“多人、多任务”先驱。今天,它正在创造新的历史。

阶跃星辰今日发布新一代自动语音识别模型StepAudio 2.5 ASR。该模型面向语音转写与长音频处理场景,在架构上引入Multi-Token Prediction(多Token预测)以提升推理效率,并通过扩展上下文窗口强化长内容识别能力。

近日,上海人工智能实验室联合南京大学、香港中文大学及上海交通大学,将OpenClaw的成功应用于多模态生成领域。他们提出GEMS(Agent-Native Multimodal Generation with Memory and Skills),激发小模型潜力,甚至让6B小模型在部分任务超越了Nano Banana 2。

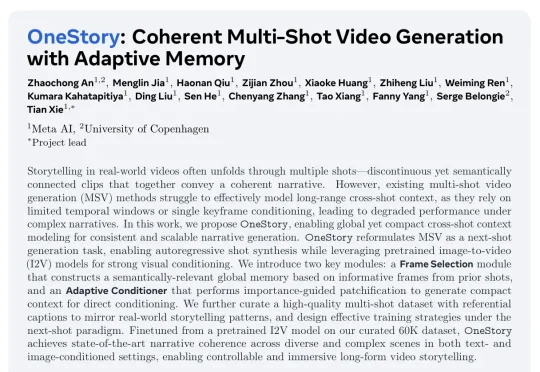

最近,来自Meta与University of Copenhagen的研究者提出了OneStory: Coherent Multi-Shot Video Generation with Adaptive Memory(收录于CVPR 2026)。这项工作聚焦于一个核心问题:如何在生成多镜头视频时,有效保留长程跨镜头上下文,从而实现更强的叙事一致性。

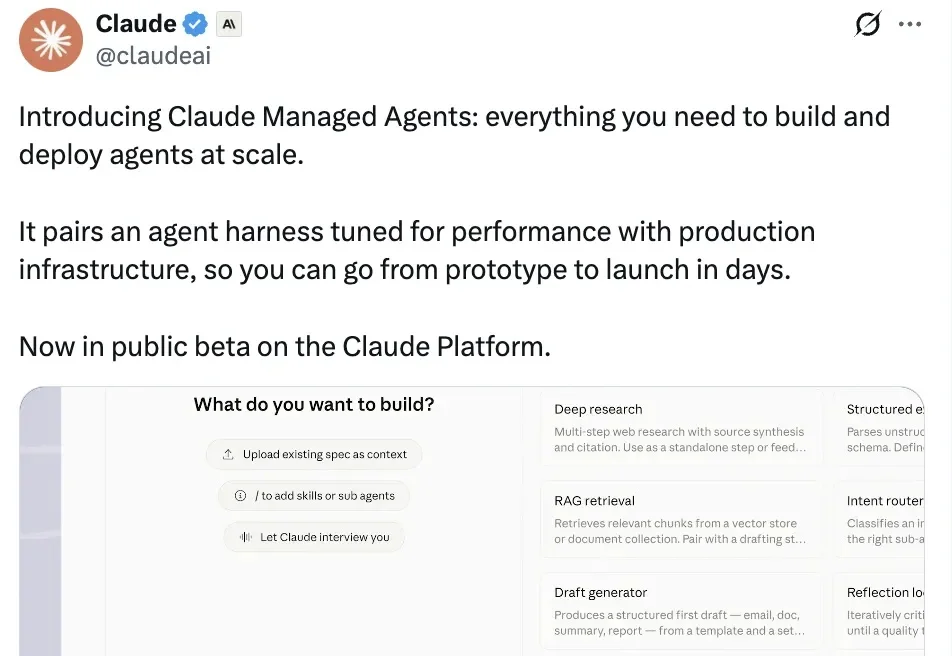

刚刚,Claude推出“企业版”服务,发布Claude Managed Agents,结果被开源项目“开团秒跟”!

在构建多Agent系统(Multi-Agent Systems)时,让几个Agent互相“对话”并不难,但要让它们在局部状态不一致的情况下,敲定一个全局唯一的决策,也就是达成“一致”(Agree)或“共识(Consensus)”,却是一个极具挑战的工程难题,您可能会问为什么,这有何难?

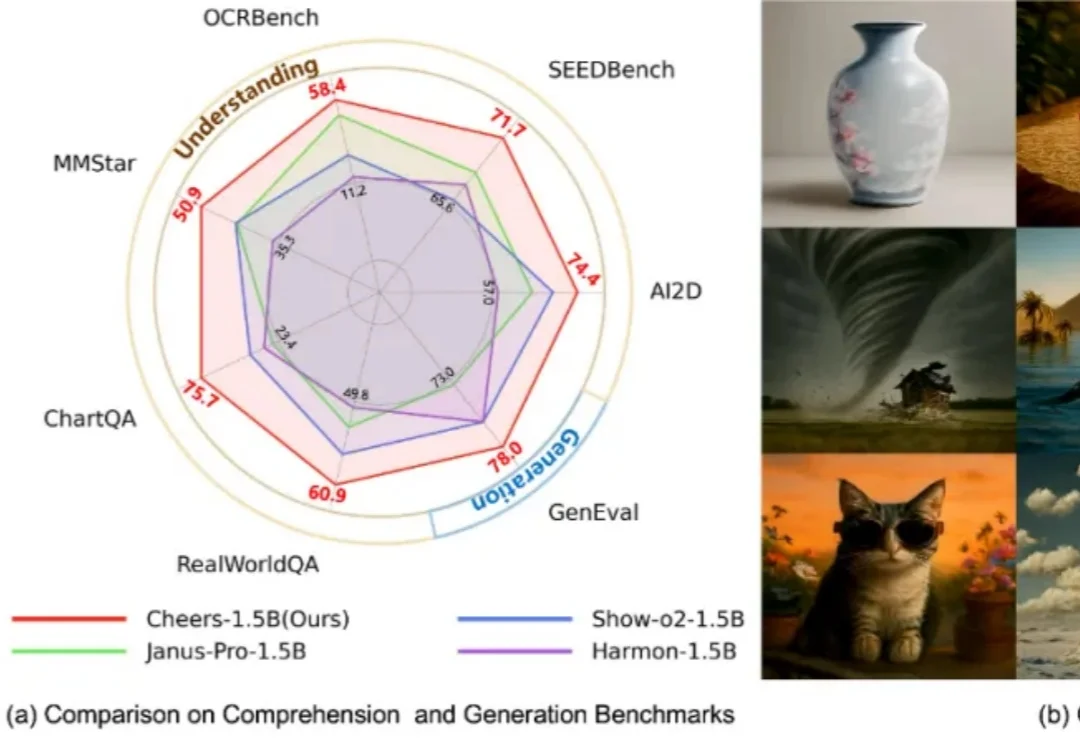

过去几年,多模态模型在理解任务上快速演进,图像问答、OCR、视觉推理、跨模态对话等能力不断提升;与此同时,图像生成模型也在视觉质量、指令遵循和细节表达上持续突破。下一步一个自然的问题是:能否用同一个模型,同时做好理解与生成?这正是统一多模态模型(Unified Multimodal Models, UMMs)正在回答的问题。

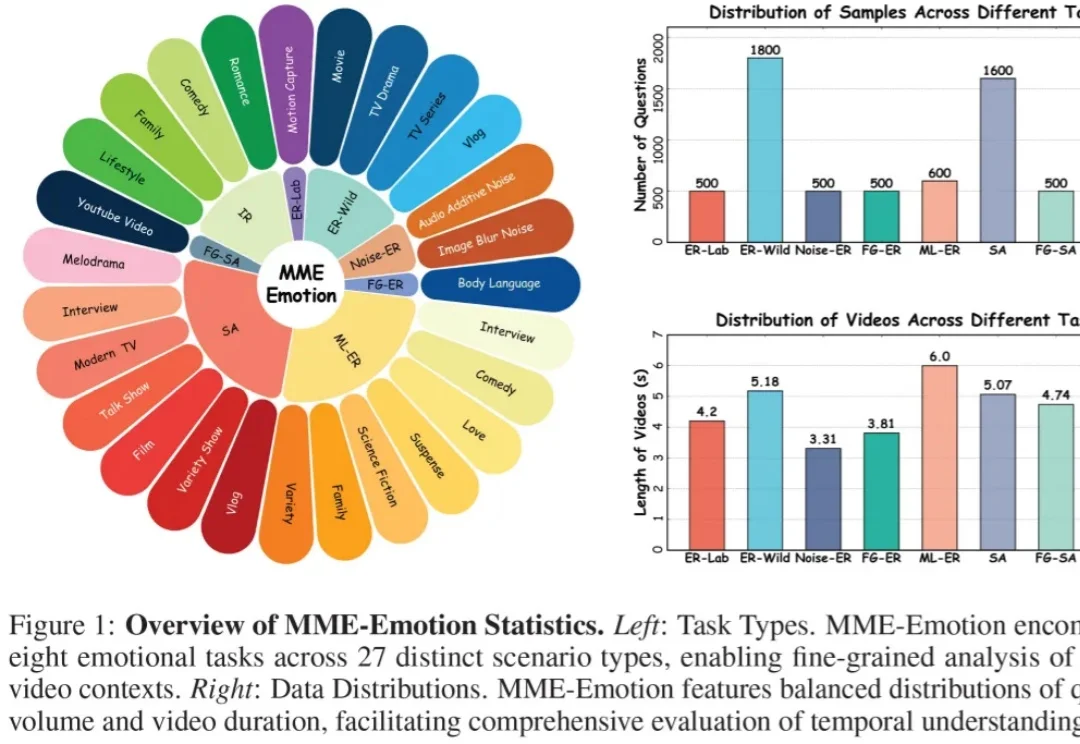

近年来,多模态大模型(Multimodal Large Language Models, MLLMs)正在迅速改变人工智能的能力边界。从图像理解到视频分析,从语音对话到复杂推理,大模型正在逐步具备类似人类的综合感知能力。但一个关键问题仍然没有得到充分回答:这些模型真的能够理解人类情绪吗?

大家好,我是袋鼠帝。 我最近做了一个挺有意思的实验。