用SFT打出RL的效果?微软联合提出高效后训练算法

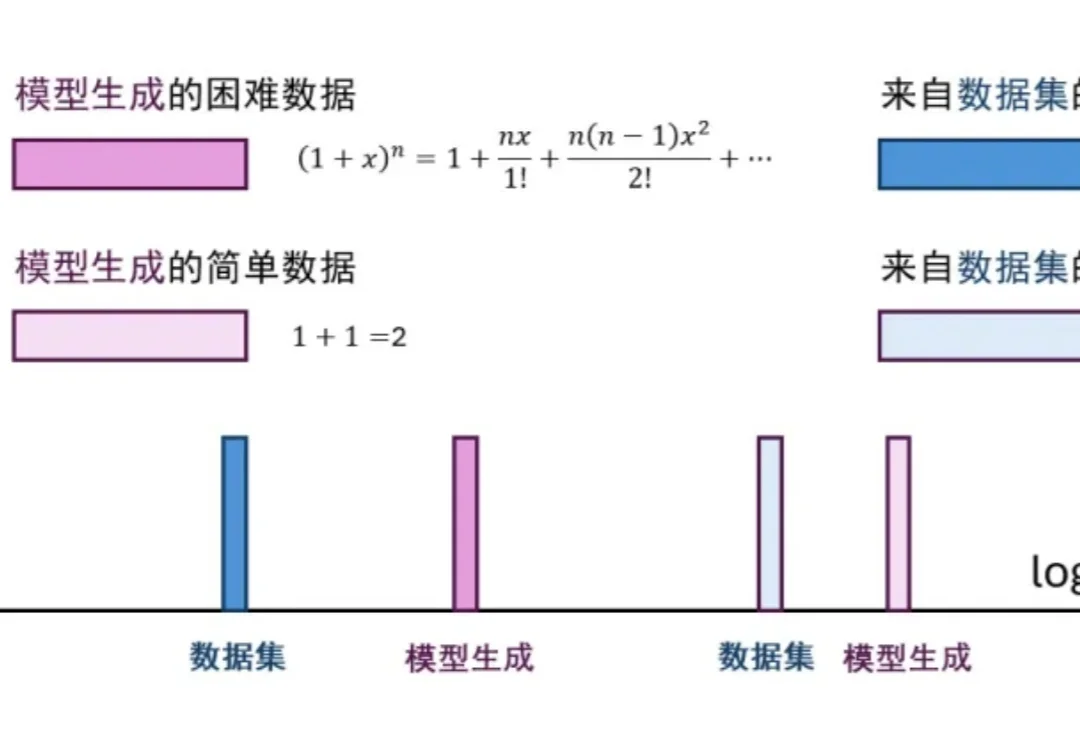

用SFT打出RL的效果?微软联合提出高效后训练算法在大模型后训练阶段,监督微调(SFT)和强化学习(RL)是两根不可或缺的支柱。SFT 利用高质量的离线(Off-policy)数据快速注入知识,但受限于静态数据分布,泛化能力往往容易触及天花板并带来灾难性遗忘;RL 则允许模型在探索中不断自我迭代,产生与当前策略同分布(On-policy)的数据,上限极高,但往往伴随着训练极度不稳定、计算资源消耗巨大的痛点。

来自主题: AI技术研报

5225 点击 2026-03-26 10:47