分享一个很实用的寓言故事prompt,5分钟帮你理解任何新概念。

分享一个很实用的寓言故事prompt,5分钟帮你理解任何新概念。故事是这样的。 这周我跟我们一个实习的小伙伴复盘内容,然后聊到了角度这块,我就跟他说了我们常用的选角度的方法论,提到了一个概念,叫陌生化。

搜索

搜索

故事是这样的。 这周我跟我们一个实习的小伙伴复盘内容,然后聊到了角度这块,我就跟他说了我们常用的选角度的方法论,提到了一个概念,叫陌生化。

如今想写出一篇结构严密、用词专业的文章已经不算难事,只需要敲几个 prompt 生成式 AI 就能瞬间给你一篇成千上万字的文章。布鲁金斯学会去年的一项调查显示,拥有学士学位的成年人中有 35% 的人在工作中使用 AI 来撰写或编辑文档。

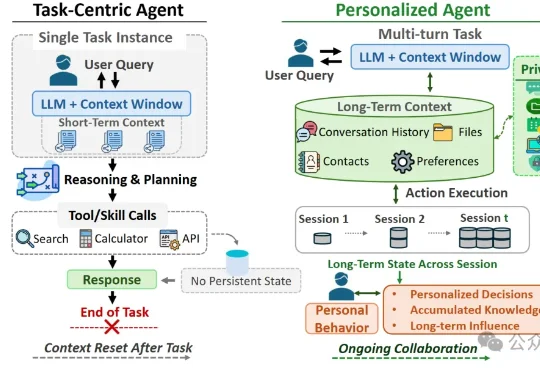

日常聊天可能在不经意间污染个性化Agent的长期记忆,使其在未来任务中偏离用户真实意图。研究人员通过ULSPB基准测试发现,即使无恶意提示,日常对话也可能改变Agent的安全边界。

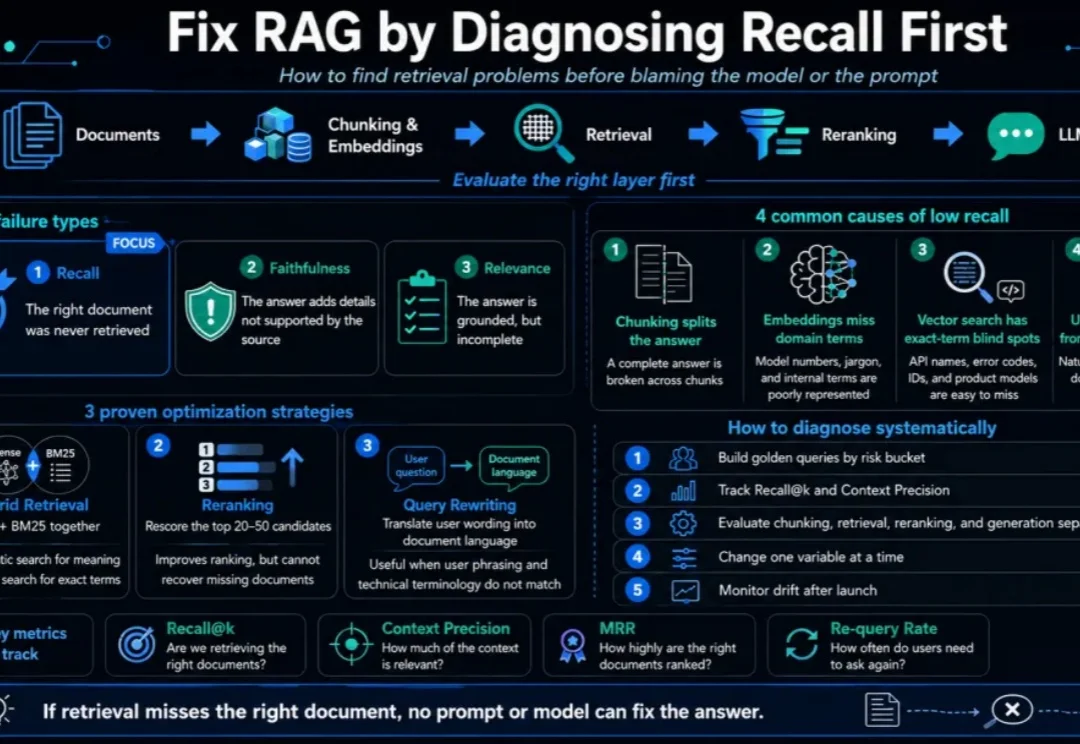

RAG 系统上线后答案出错,绝大多数团队的第一反应都是换更贵的模型、反复调试 prompt。

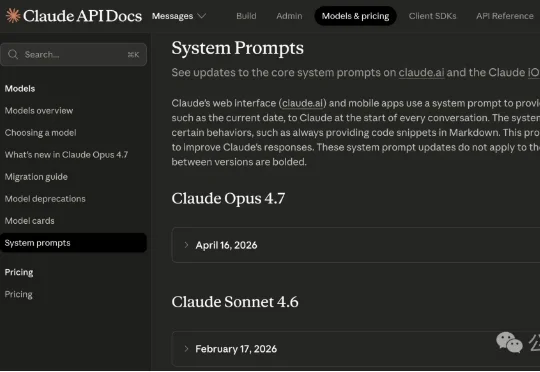

就在前两天,Anthropic祭出Claude 4.7的同时,照例公开了Claude 4.7的「驯化手册」,也就是那份系统提示词(system prompt)。Simon Willison在博客中对这份system prompt进行了逐行对比,哪里加了、哪里删了、哪里改了措辞,全部标了出来。

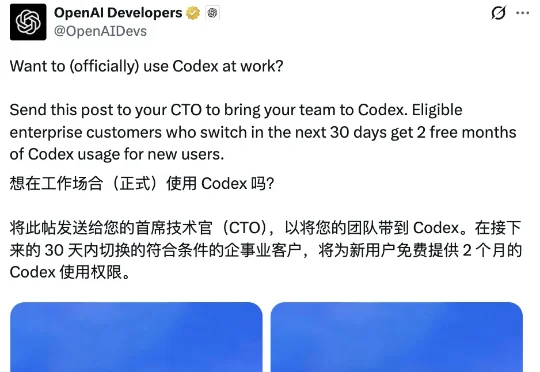

今天早上,OpenAI突然宣布一个促销政策:未来 30 天内,企业用户如果迁移到 Codex,2 个月免费 Codex 用量。同期,桌面端还内置了迁移工具,可以把 Claude Code 的 system prompts、custom skills、chat history、MCP server 配置一键搬过来。

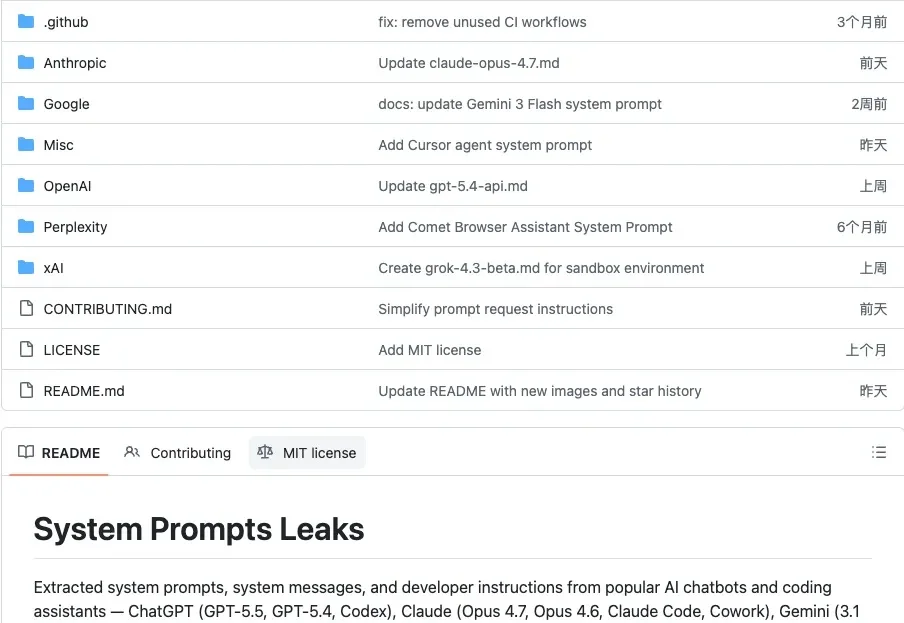

AI 的熟手玩家,都应该知道system prompt这个词:每一个你用过的 AI 助手,背后都有一份你看不见的文件,却对模型有着决定性的作用。

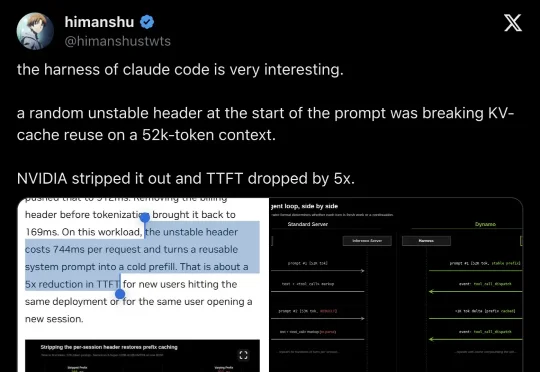

NVIDIA Dynamo 团队发现,Claude Code 向自定义端点发送请求时,prompt 最前面会带一行 session-specific billing header。这行 header 每个 session 都变,导致 52K token 的稳定前缀在 KV cache 中无法复用——TTFT 从 168ms 飙到 912ms。Dynamo 加了一个 `

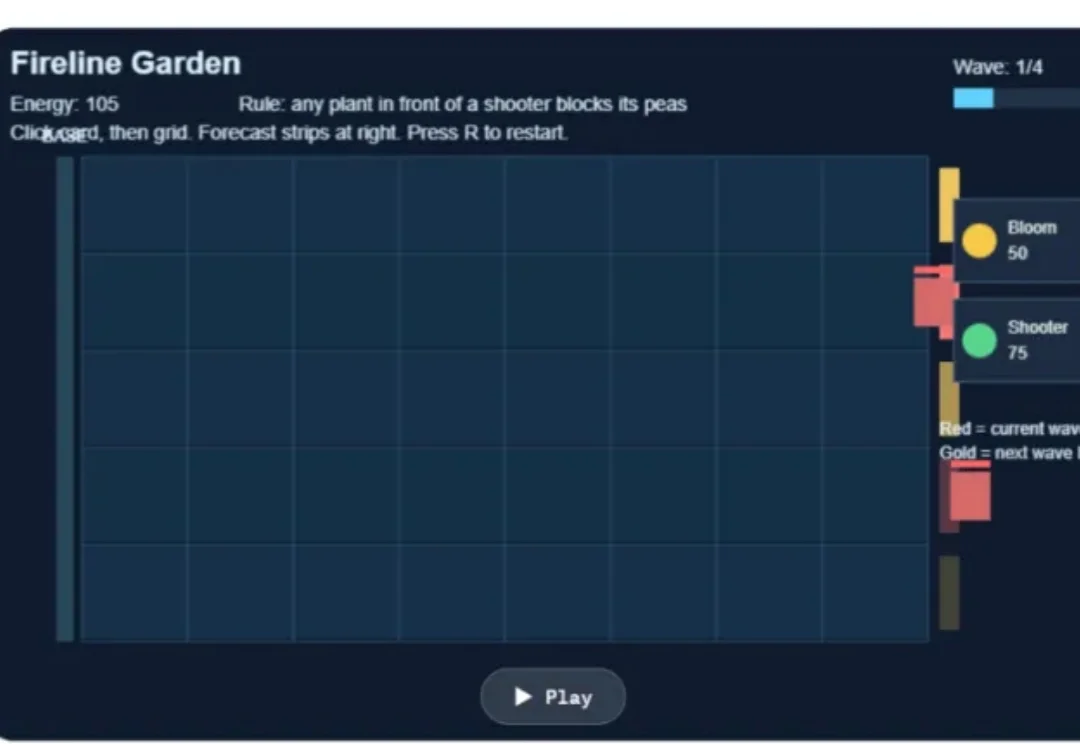

让大模型写一个小游戏,已经不新鲜了。它可以很快生成一个 Flappy Bird、一个塔防游戏、一个物理解谜页面,甚至还能补上按钮、分数和简单动画。但真正的问题是:这些游戏到底有没有新的玩法?它们是在创造,亦或只是把已有游戏换了一层皮?

用强化学习(RL)优化文生图模型的 prompt following 能力,是一条被广泛验证的路径 —— 让模型根据 prompt 用不同随机种子生成多张图片,通过 reward model 计算 reward,再利用相关 RL 算法优化模型。