哪里不会扫哪里!全球最强数学大模型发布人人可玩Demo,阿里多模态模型加持,中文适用

哪里不会扫哪里!全球最强数学大模型发布人人可玩Demo,阿里多模态模型加持,中文适用现在,最强数学大模型,人人都可上手玩了!

现在,最强数学大模型,人人都可上手玩了!

阿里云发布最强开源大模型Qwen2,干翻Llama 3,比闭源模型还强。

开源大模型全球格局,一夜再变。

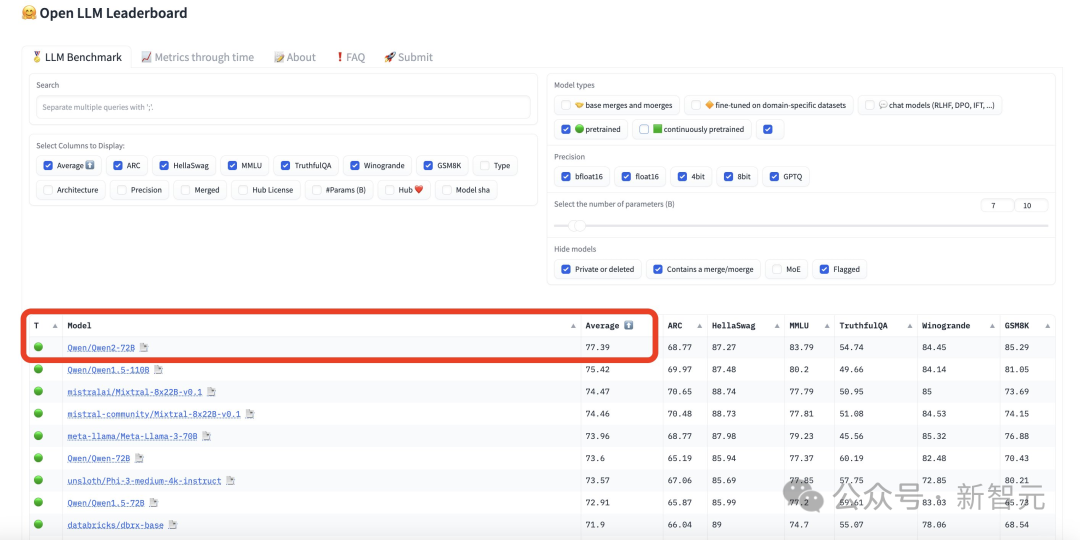

一夜之间,全球最强开源模型再次易主。万众瞩目的Qwen2-72B一出世,火速杀进开源LLM排行榜第一,美国最强开源模型Llama3-70B直接被碾压!全球开发者粉丝狂欢:果然没白等。

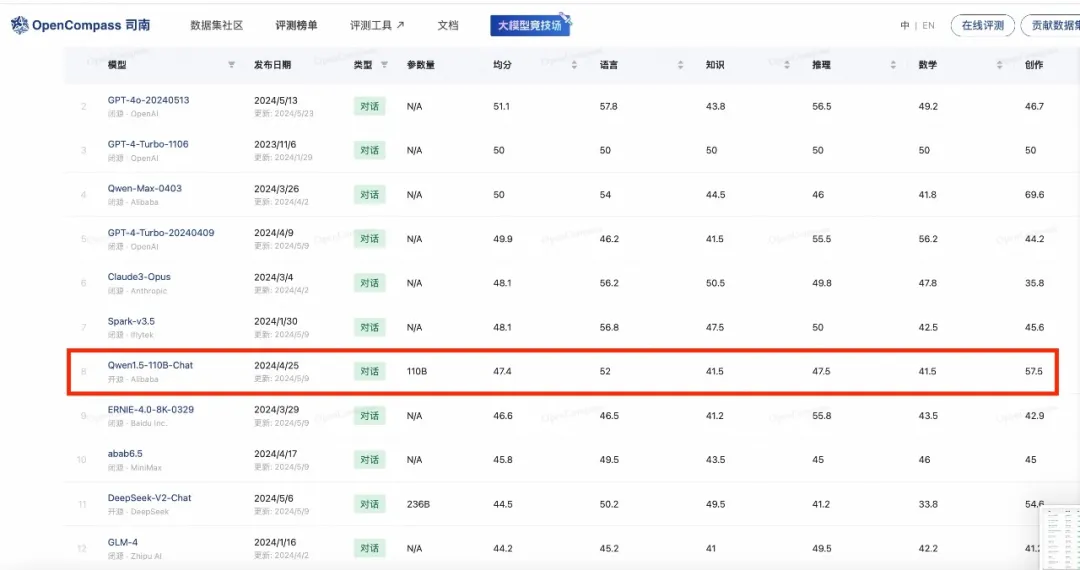

大模型领域,开源与闭源之争一直是技术和产业界关注的焦点。阿里云通义千问最新发布的Qwen2系列模型,为这场争论提供了最新的答案。

Qwen 系列会是众多大学实验室新的默认基础模型吗? 斯坦福团队套壳清华大模型的事件不断发酵后,中国模型在世界上开始得到了更多关注。不少人发现,原来中国已经有不少成熟的大模型正在赶超国外。

在上一篇文章「Unsloth微调Llama3-8B,提速44.35%,节省42.58%显存,最少仅需7.75GB显存」中,我们介绍了Unsloth,这是一个大模型训练加速和显存高效的训练框架,我们已将其整合到Firefly训练框架中,并且对Llama3-8B的训练进行了测试,Unsloth可大幅提升训练速度和减少显存占用。

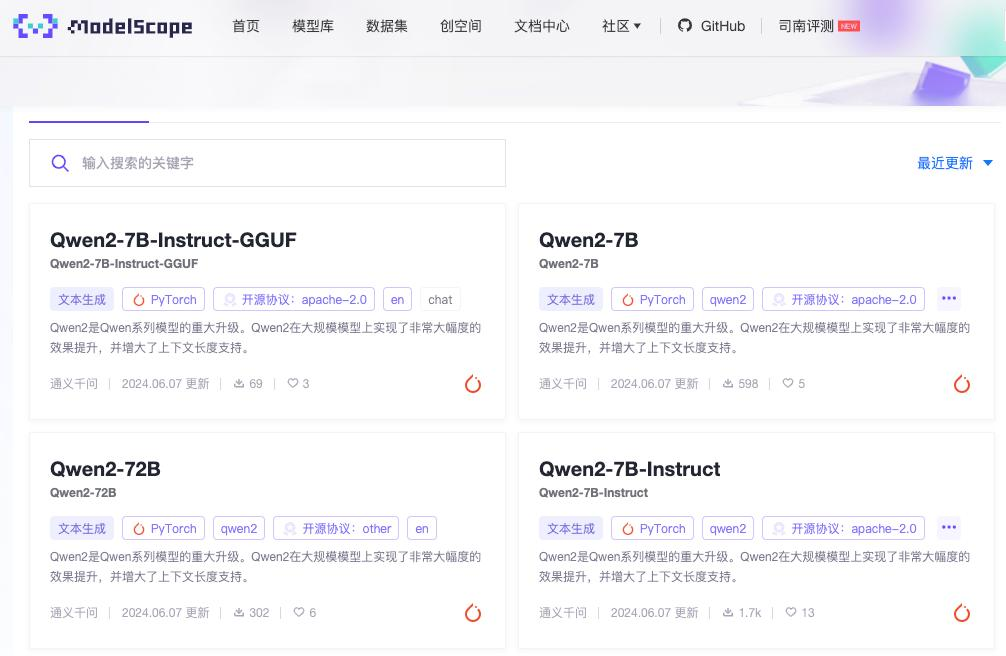

作为全球最顶级的机器学习工具库,Hugging Face上最近悄悄出现了一个新的transformers模型——Qwen2。没错,正是阿里通义千问Qwen模型的第二代。不过通义团队的算法同学在社交媒体上对此继续保持神秘。