TRAE SOLO 三端全量免费开放!移动端、Windows 桌面端已上线,支持语音讨论、飞书 CLI 接入及定时任务

TRAE SOLO 三端全量免费开放!移动端、Windows 桌面端已上线,支持语音讨论、飞书 CLI 接入及定时任务TRAE SOLO 移动端正式发布,桌面端、网页端同步全量,并上线 Windows 版本桌面端;中国版三端免费开放!

搜索

搜索

TRAE SOLO 移动端正式发布,桌面端、网页端同步全量,并上线 Windows 版本桌面端;中国版三端免费开放!

我在淘宝上花了28块钱,买了一个很奇葩的东西。

Voice Working来了!TRAE SOLO把「说话」变成主力干活方式,口语自动清洗、说错自动纠正、一句话调Skill切模式。动动嘴就能指挥你的电脑干活了!

不讲 Vibe Coding,而是 Vibe Working。

字节也开始做“OpenClaw”了,但它先把战场放在了工作台上。

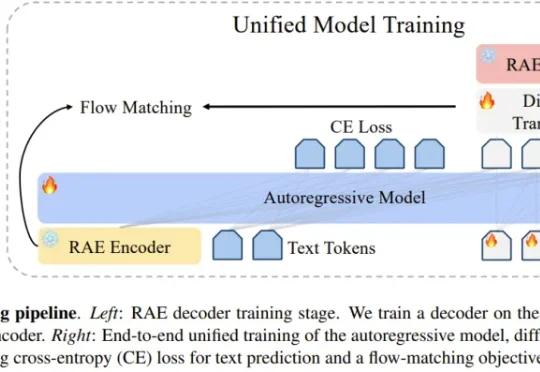

编辑|Panda 在文生图模型的技术版图中,VAE 几乎已经成为共识。从 Stable Diffusion 到 FLUX,再到一系列扩散 Transformer,主流路线高度一致:先用 VAE 压缩视

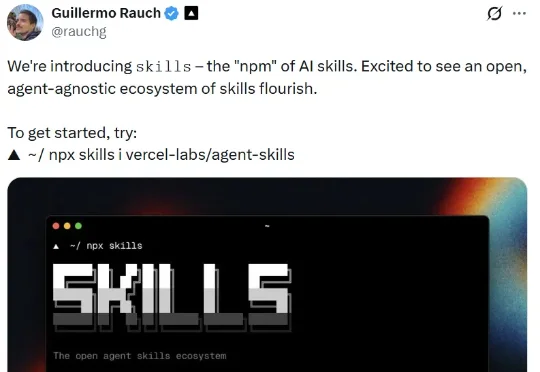

比如前些天,Vercel 创始人 Guillermo Rauch 推出了所谓的「AI skill 的 npm」,让用户仅需一个简单命令 npx skills add [package],就能为自己的 AI 智能体轻松注入专业能力。

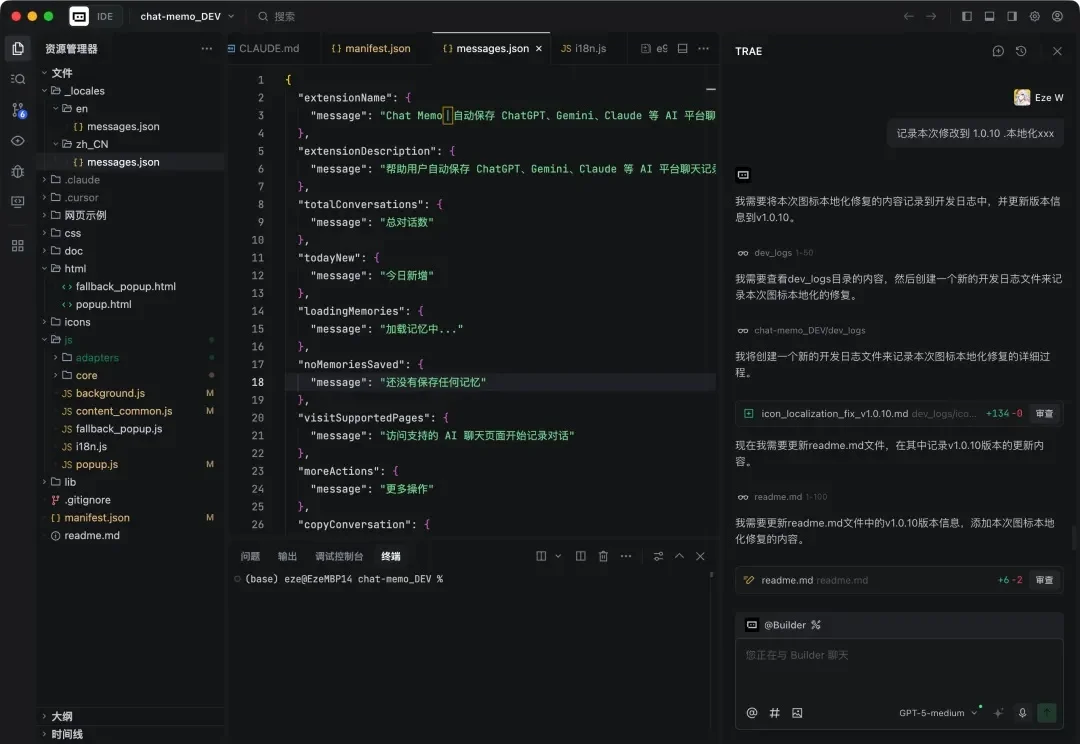

很多人可能不知道,我是 Trae 的老用户。

TRAE在一年里写了1000亿行代码!如果按照一个程序员每天写100行有效代码计算,这相当于300万个程序员不吃不喝、没日没夜干了一整年。而这也仅仅是《TRAE 2025年度产品报告》中的冰山一角,更多惊人的数据还包括:

TRAE国内版终于上线SOLO模式了,且全部功能完全免费!一口气带来了SOLO Coder、Plan模式、多任务并行等多个核心能力。