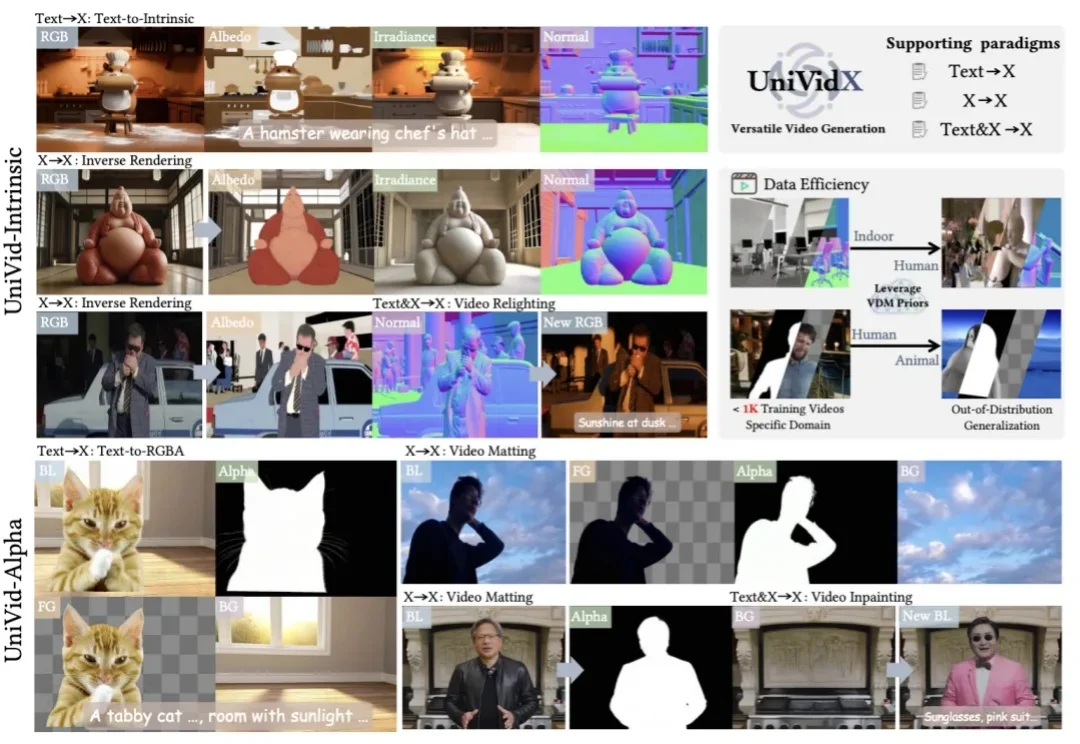

Siggraph 26 | 视频版Vision-Banana来了?大一统框架UniVidX刷新多项视频任务SOTA

Siggraph 26 | 视频版Vision-Banana来了?大一统框架UniVidX刷新多项视频任务SOTA近日,由香港科技大学 MMLab 及合作团队完成的研究工作「UniVidX: A Unified Multimodal Framework for Versatile Video Generation via Diffusion Priors」被计算机图形学顶级会议 SIGGRAPH 2026 正式接收。