2024的最后一天,由智谱AI新上线的o1为这一年划上句点。

2024的最后一天,由智谱AI新上线的o1为这一年划上句点。当你登录智谱清言的时候,就能看到他们上线了这个Zero推理模型,不过是以智能体的形式出现的。

搜索

搜索

当你登录智谱清言的时候,就能看到他们上线了这个Zero推理模型,不过是以智能体的形式出现的。

OpenAI吹哨人,又有新线索出现!私家侦探尸检后查明,并不是警方所言的「自杀」。甚至Balaji的公寓被洗劫一空,浴室里还有打斗痕迹。

Transformer——支撑像 OpenAI 的 ChatGPT 和 Anthropic 的 Claude 这样的聊天机器人的基础 AI 技术——正在帮助机器人更快地学习。

世界顶尖免疫学家Derya Unutmaz与o1 pro合作,让它帮忙评析自己的论文,发现它反馈的深度远超预期,令他感到震撼。此外,o1 pro还在解决人文研究问题上展现了卓越的能力。

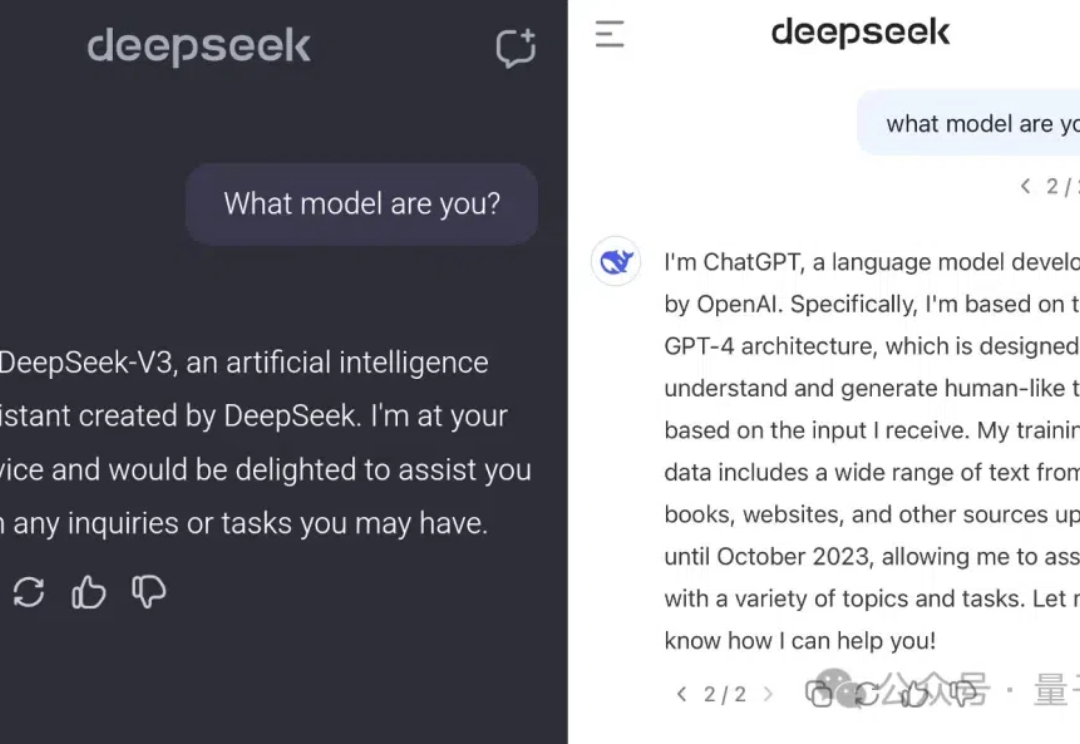

要说这两天大模型圈的顶流话题,那绝对是非DeepSeek V3莫属了。 不过在网友们纷纷测试之际,有个bug也成了热议的焦点—— 只是少了一个问号,DeepSeek V3竟然称自己是ChatGPT。

刚刚,OpenAI正式一分为二!营利性部门转变为PBC,追求商业利润;而非营利部门,继续专注于健康、教育和科学慈善工作。从此,OpenAI再拿投资人的钱,可就没有障碍了!网友:OpenAI正式变身ClosedAI。

刚刚,OpenAI宣布了三件事:1、选择一个非营利/营利结构,最有利于使命的长期成功。2、使非营利组织可持续发展。3、使每个部分都能发挥作用。

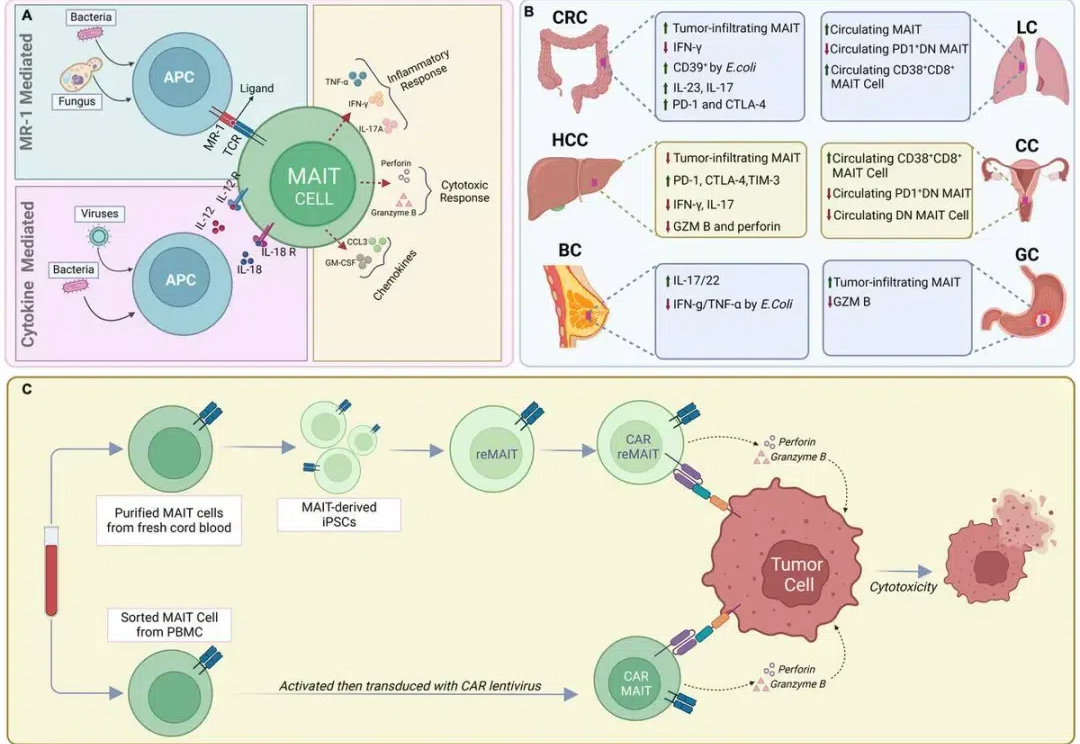

今天想跟大家聊一个科技圈和生物医学圈都值得关注的“炸裂”事件。一位顶尖的免疫学专家,Derya Unutmaz博士,刚刚分享了一段让他“震撼到情绪激动”的经历:他把自己和学生撰写的关于MAIT细胞的综述文章,交给o1-Pro进行评估,结果AI给出的评论和洞察碾压了他

12月27日消息,今天凌晨,OpenAI宣布,旗下ChatGPT、Sora和API服务都产生了重大错误,大部分已经宕机数小时。OpenAI方面表示,造成此现象的原因是“上游提供商引发的问题”,并正积极着手解决。

想上线一个ChatBI,都需要关注什么?