Kimi Work Beta 版邀你体验:你的工作,分我一半

Kimi Work Beta 版邀你体验:你的工作,分我一半今天,我们邀请你体验 Kimi Work Beta 版。

搜索

搜索

今天,我们邀请你体验 Kimi Work Beta 版。

最近人人都在聊 DeepSeek 的融资,这个等最终落定后我们再说。今天先说 Kimi 。

AI科技评论独家消息,前月之暗面后训练与强化学习负责人宋鸿涌(Flood Sung)已于 2025 年 12 月离职,创立机器人公司「北京十六号机器人科技有限公司」(XVI Robotics),公司业务方向聚焦通用人形机器人基座模型。

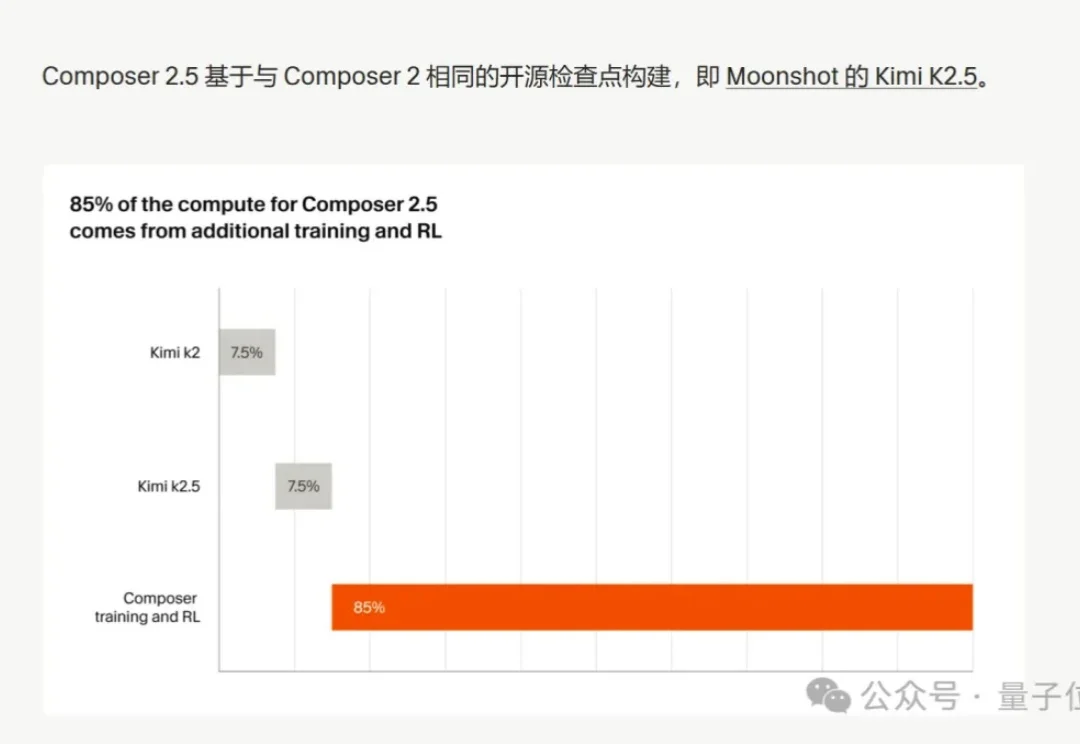

Cursor模型更新,最新版本已来到Composer 2.5。

今天,我们推出 Kimi WebBridge。 一个面向 Kimi Code、Claude Code、Cursor、Codex、Hermes Agent、OpenClaw 等本地 AI Agent 的浏览器插件,让 AI 真正像你一样操作浏览器。

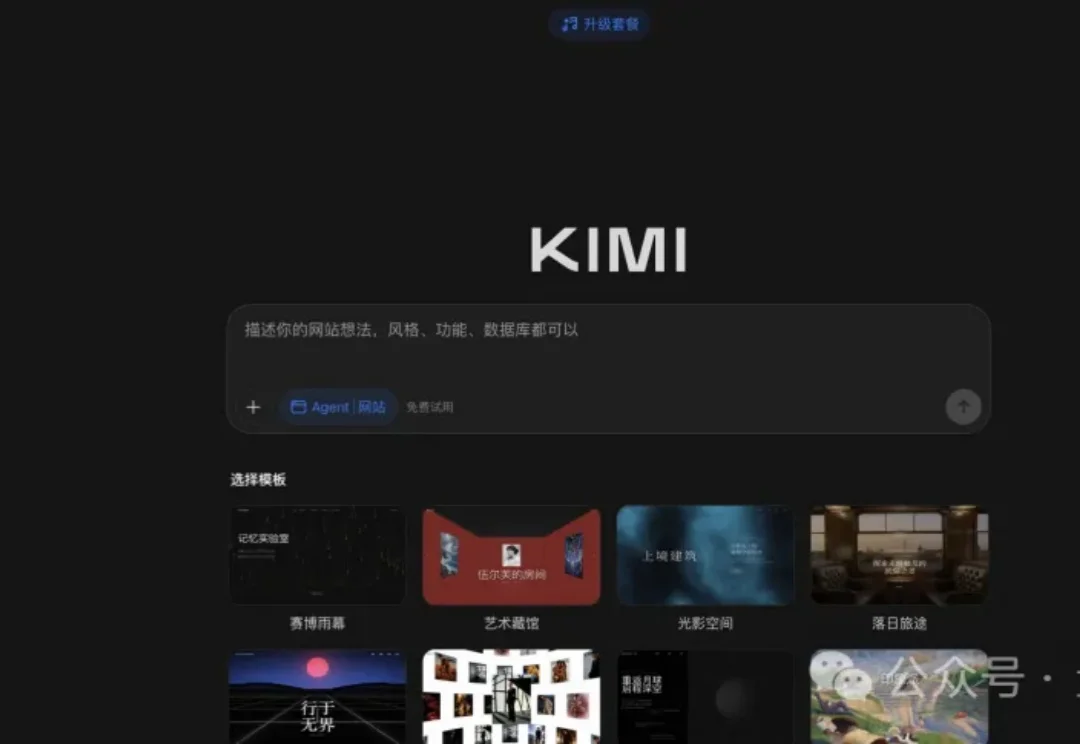

“帮我搭个读书笔记网站,带登录和搜索,能导出的那种。”

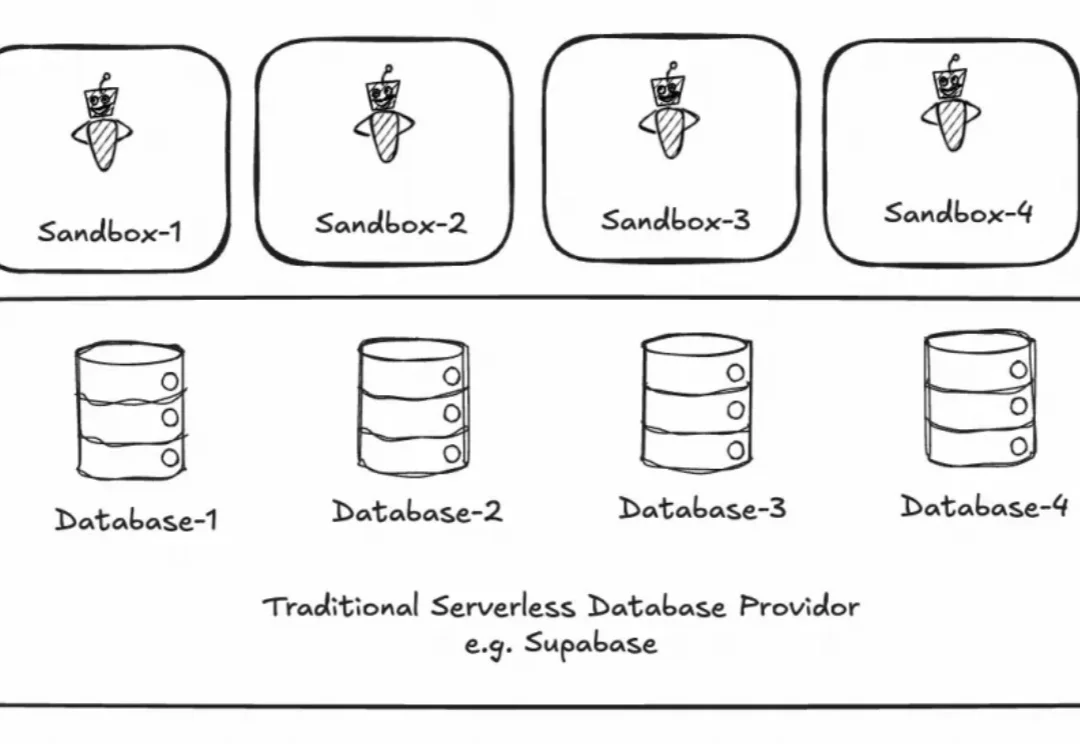

Agent 到底需要什么样的 infrastructure,今年业界一直有很多探讨,PingCAP 联合创始人黄东旭此前也发过多篇讨论文章,不过当时都是一些猜想。随着 agent 今年的爆发,大规模落地的案例出现了。

据华峰资本消息,近日,北京AI大模型独角兽月之暗面(Kimi)完成新一轮约20亿美元(约合人民币136.22亿元)融资,为中国大模型圈目前最大额融资,投后估值突破200亿美元(约合人民币1362.25亿元)。

独家获悉,Kimi (月之暗面)即将完成新一轮 20 亿美元融资,投后估值突破 200 亿美元。本轮融资由美团龙珠领投,中国移动、CPE(中信产业基金)等参投,其中仅龙珠就出手超 2 亿美元。

从去年开始做这个账号以来,我其实写过不少测模型的文章。我相信也有很多朋友是因为看了我测评的文章关注我的。但从过年之后,真的就很少写模型评测的文章了。主要是我写文章的速度甚至一度跟不上模型发布的速度了。