偶然刷到的一个逆天ElevenLabs开源平替!

偶然刷到的一个逆天ElevenLabs开源平替!订阅了 ElevenLabs 的小伙伴看过来,它的开源平替来了!Chatterbox 是全球首个支持强烈情绪控制的开源TTS 模型,更是号称开源 TTS 中的 SOTA ,由 Resemble AI 推出。

搜索

搜索

订阅了 ElevenLabs 的小伙伴看过来,它的开源平替来了!Chatterbox 是全球首个支持强烈情绪控制的开源TTS 模型,更是号称开源 TTS 中的 SOTA ,由 Resemble AI 推出。

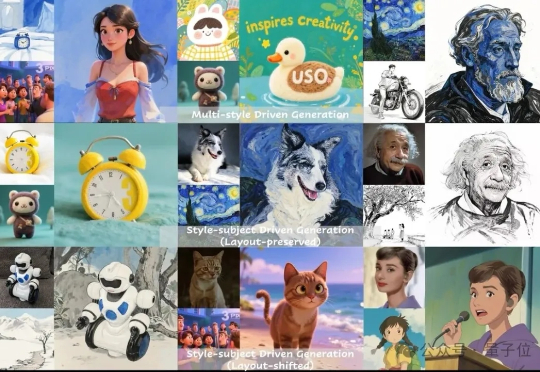

图像生成中的多指标一致性问题,被字节团队解决了! 字节UXO团队设计并开源了统一框架USO,让看上去不关联的任务相互促进,实现风格迁移和主体保持单任务和组合任务的SOTA。

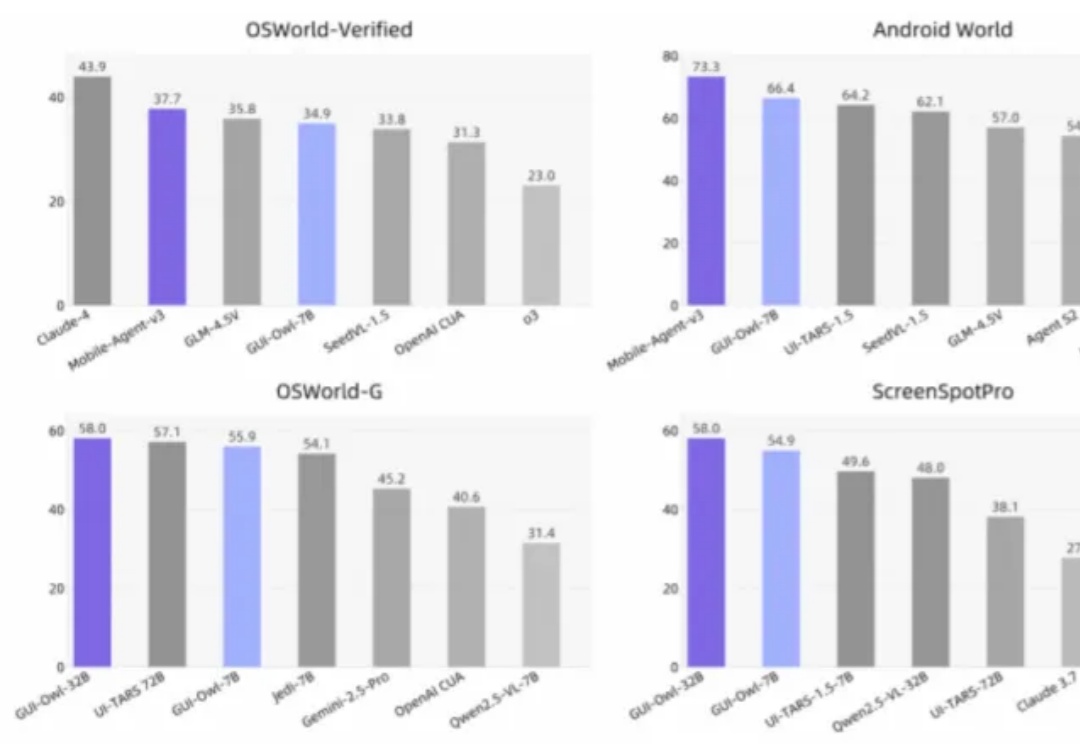

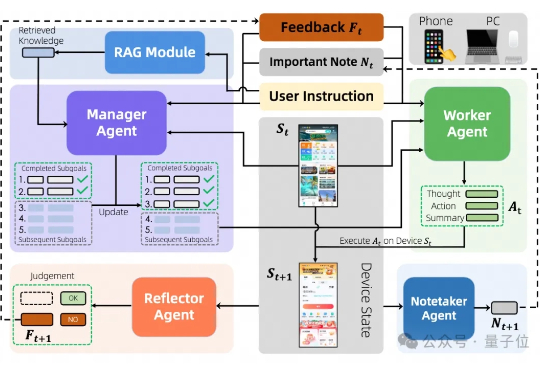

覆盖桌面、移动和 Web,7B 模型超越同类开源选手,32B 模型挑战 GPT-4o 与 Claude 3.7,通义实验室全新 Mobile-Agent-v3 现已开源。

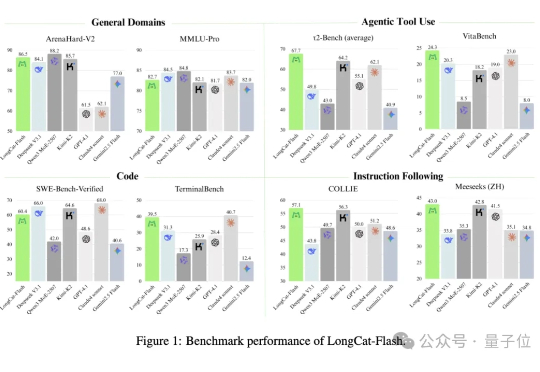

没想到啊,最新SOTA的开源大模型…… 来自一个送外卖(Waimai)的——有两个AI,确实不一样。 这个最新开源模型叫:Longcat-Flash-Chat,美团第一个开源大模型,发布即开源,已经在海内外的技术圈子里火爆热议了。

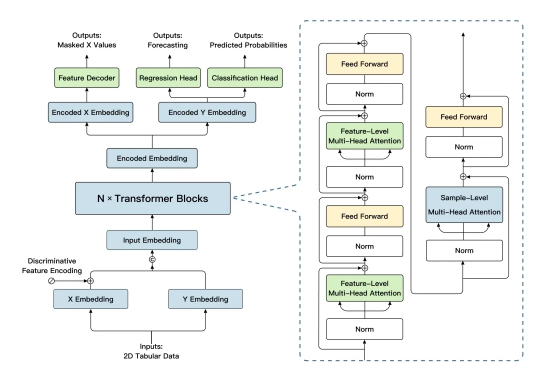

2025 年 8 月 29 日,由清华大学计算机系崔鹏教授团队联合稳准智能共同研发的结构化数据通用大模型「极数」(LimiX)正式宣布开源。

本月初,AI 圈翘首以盼的 GPT-5 终于问世,在数学、实际编程、多模态理解、推理等多个领域实现了新的 SOTA。今日,国产 AI 厂商元石科技重磅推出「All in One」旗舰模型 —— 问小白 5,成为其迄今为止最智能、最快捷、最实用的 AI 系统。尤其值得强调的是:问小白 5 的各项基准测试榜单成绩最接近 GPT-5,这使其成为当前国产大模型中最具代表性的对标者。

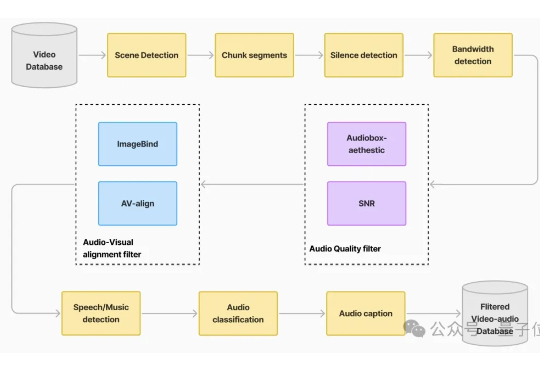

自带声音的视频生成模型,开源版开卷! 最新赶到的是腾讯混元:刚刚正式开源端到端的视频音效生成模型HunyuanVideo-Foley。

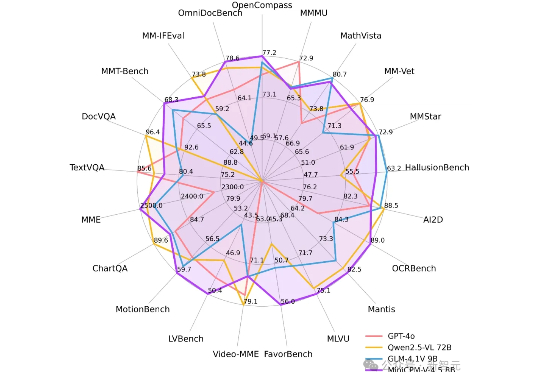

刚刚,面壁智能再放大招——MiniCPM-V 4.5多模态端侧模型横空出世:8B参数,越级反超72B巨无霸,图片、视频、OCR同级全线SOTA!不仅跑得快、看得清,还能真正落地到车机、机器人等。这一次,它不只是升级,而是刷新了端侧AI的高度。

今天,我们正式开源 8B 参数的面壁小钢炮 MiniCPM-V 4.5 多模态旗舰模型,成为行业首个具备“高刷”视频理解能力的多模态模型,看得准、看得快,看得长!高刷视频理解、长视频理解、OCR、文档解析能力同级 SOTA,且性能超过 Qwen2.5-VL 72B,堪称最强端侧多模态模型。

能自动操作手机、电脑的智能体新SOTA来了。 通义实验室推出Mobile-Agent-v3智能体框架,在手机端和电脑端的多个核心榜单上均取得开源最佳。