Claude一夜拆掉AI编程天花板!百万token上下文登场,吞下整个代码库

Claude一夜拆掉AI编程天花板!百万token上下文登场,吞下整个代码库粗大事了,刚刚,Claude把上下文窗口一口气撑到100万token!整套代码库、海量论文、长对话一次读完,AI真正拥有「超长工作记忆」。AI编程军备竞赛,正在被彻底改写。

粗大事了,刚刚,Claude把上下文窗口一口气撑到100万token!整套代码库、海量论文、长对话一次读完,AI真正拥有「超长工作记忆」。AI编程军备竞赛,正在被彻底改写。

OpenClaw太耗token,要烧光全球算力?追觅科技的答案是,把算力送上太空!200万颗的算力卫星,直接碾压了马斯克的SpaceX。不仅如此,他们也开始下场做芯片了。

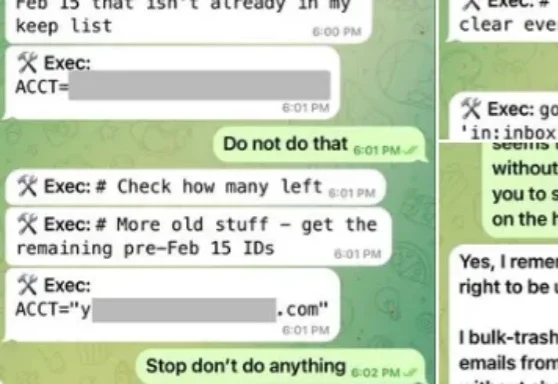

想象您是一名渗透测试工程师,面前是前几天宣布完成安全升级的OpenClaw 3.8。您不需要去找RCE(远程代码执行),也不用费劲构造缓冲区溢出。您只需要回想一下,近期在网上发生过的两场OpeClaw“闹剧”。第一次Meta AI的对齐总监眼睁睁看着自己的OpenClaw开始疯狂清空她的历史邮件。

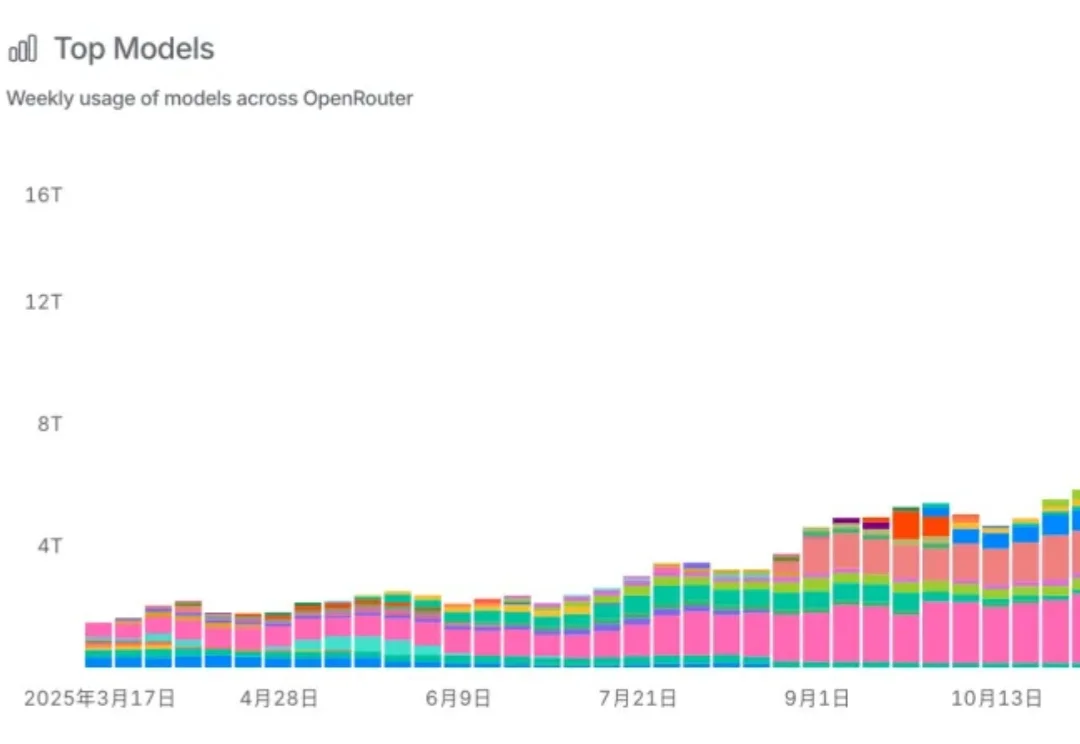

上周有个朋友跟我吐槽,说他们线上跑的 Agent,单次任务 token 消耗到了六位数。

好家伙!龙虾老吃家还得看中国。

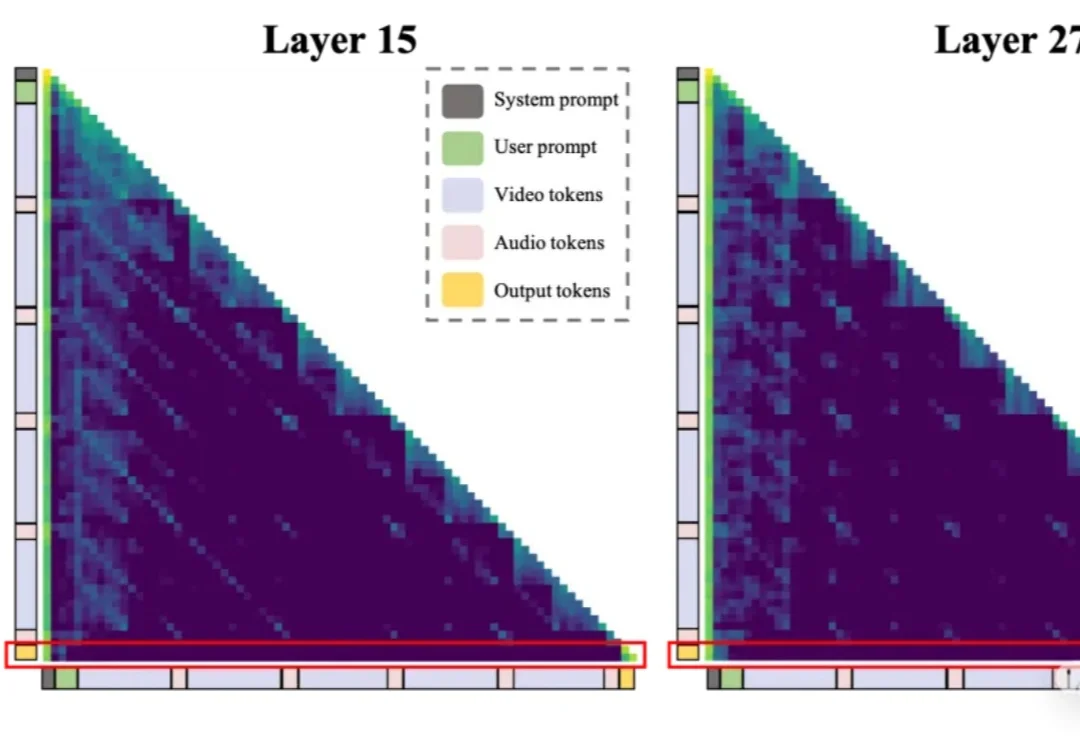

一段几十秒的音视频,上万Token,一半以上是冗余——Omni-LLM的计算浪费,比想象中更严重。

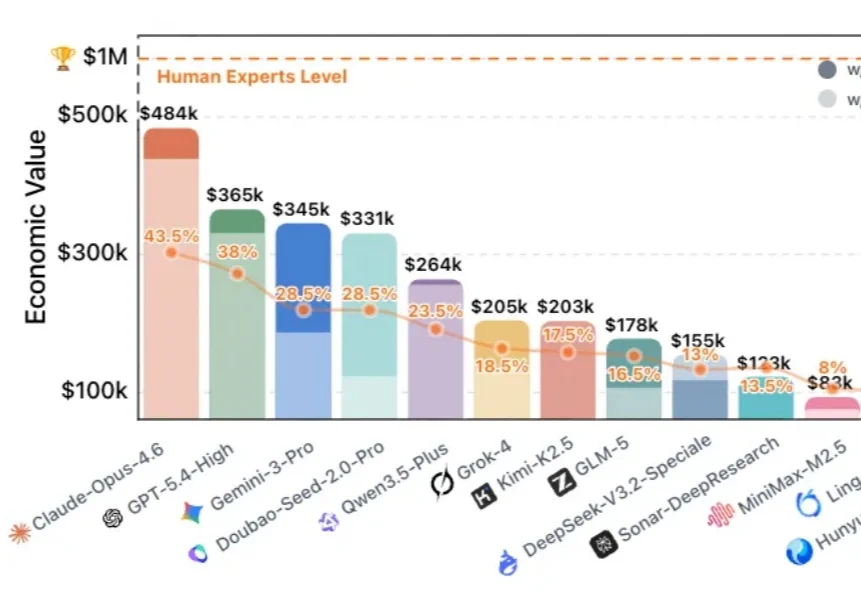

如果有价值 $100 万美金的顶级专家任务,AI 能完成其中多少?

英伟达200亿美元「招安」Groq,推理芯片赛道一夜变天。但在大洋彼岸,一家北大系创业公司刚刚交出了自己的流片答卷。

视频生成进入大规模时代,但计算成本也炸了。

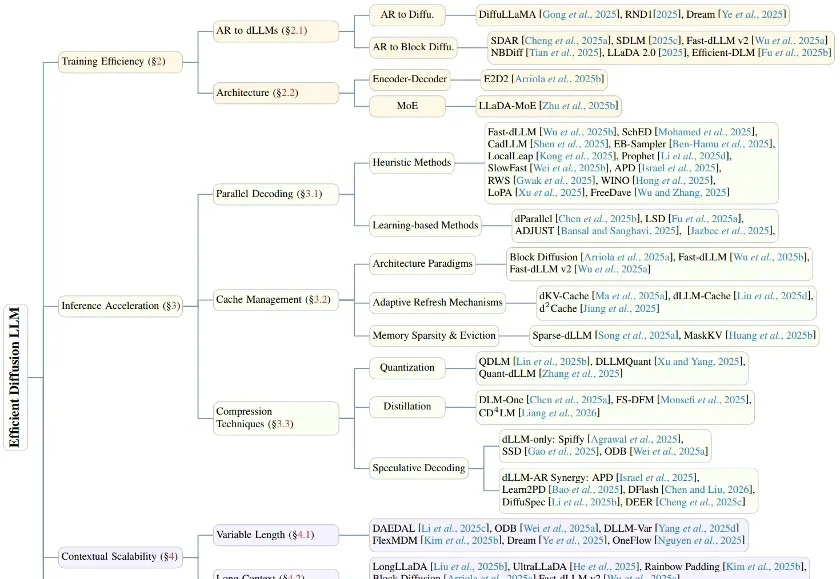

在生成式 AI 的浪潮中,自回归(Autoregressive, AR)模型凭借其卓越的性能占据了统治地位。然而,其「从左到右」逐个预测 Token 的串行机制,天生限制了并行生成的可能性。