8B模型奥数成绩比肩GPT-4!上海AI Lab出品

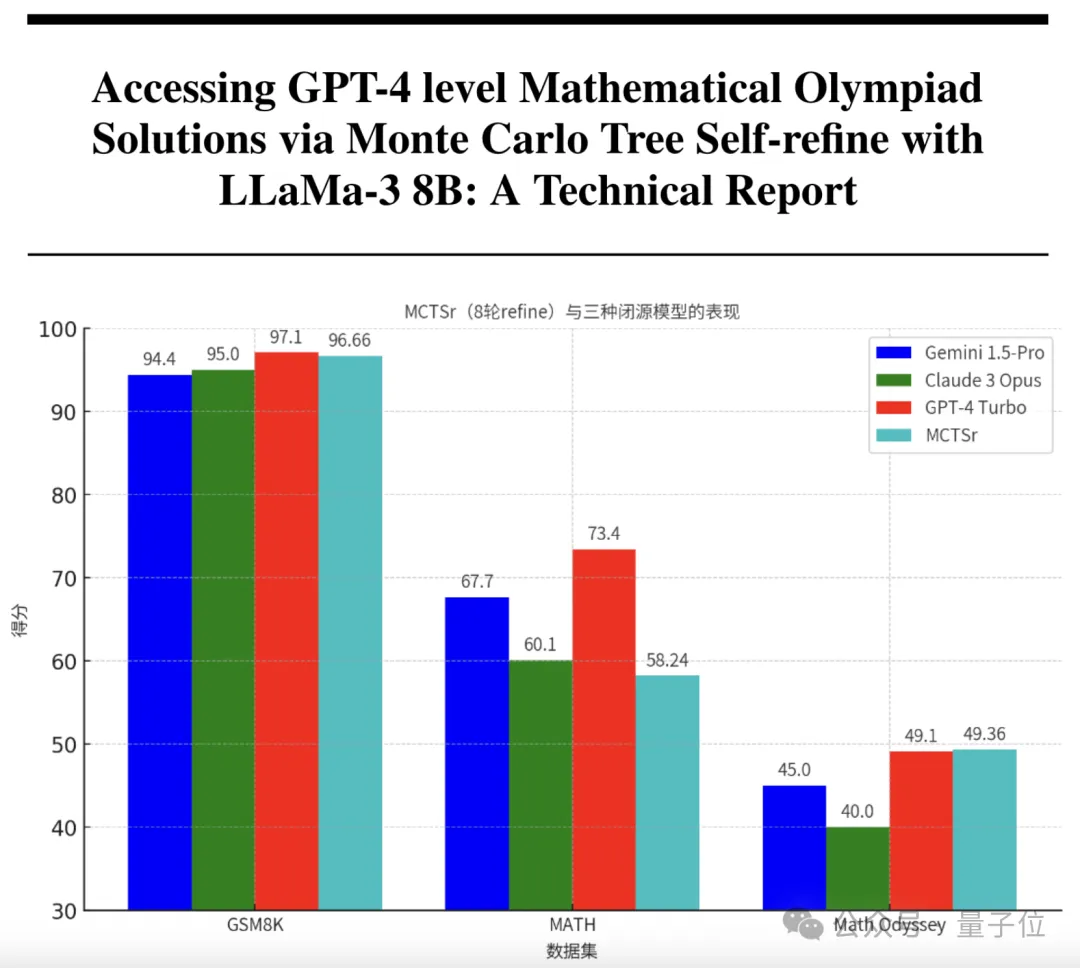

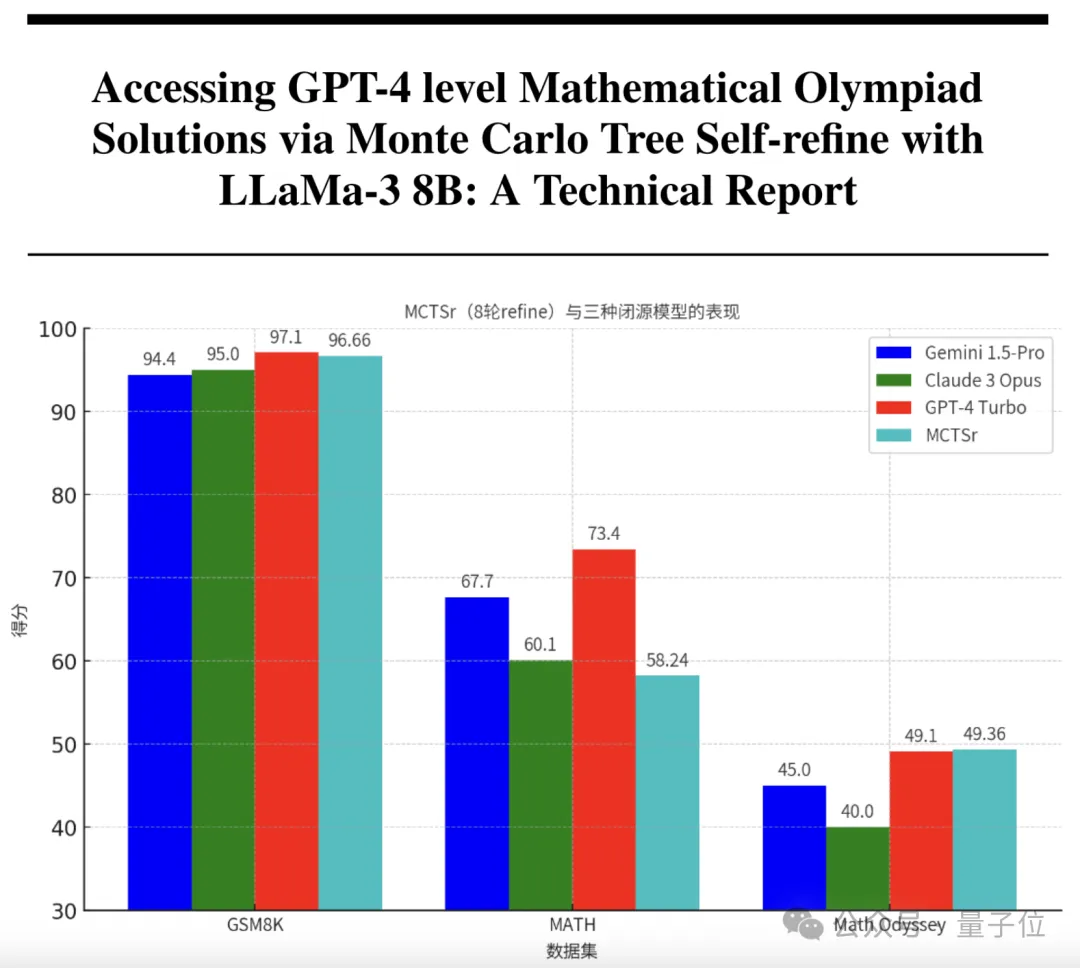

8B模型奥数成绩比肩GPT-4!上海AI Lab出品只要1/200的参数,就能让大模型拥有和GPT-4一样的数学能力? 来自复旦和上海AI实验室的研究团队,刚刚研发出了具有超强数学能力的模型。 它以Llama 3为基础,参数量只有8B,却在奥赛级别的题目上取得了比肩GPT-4的准确率。

搜索

搜索

只要1/200的参数,就能让大模型拥有和GPT-4一样的数学能力? 来自复旦和上海AI实验室的研究团队,刚刚研发出了具有超强数学能力的模型。 它以Llama 3为基础,参数量只有8B,却在奥赛级别的题目上取得了比肩GPT-4的准确率。

3D生成也有自个儿的人工评测竞技场了~ 来自复旦大学和上海AI lab的研究人员搞了个3DGen-Arena,和大语言模型的Chatbot-Arena、GenAI-Arena等一脉相承,要让大伙儿对3D生成模型来一场公开、匿名的评测

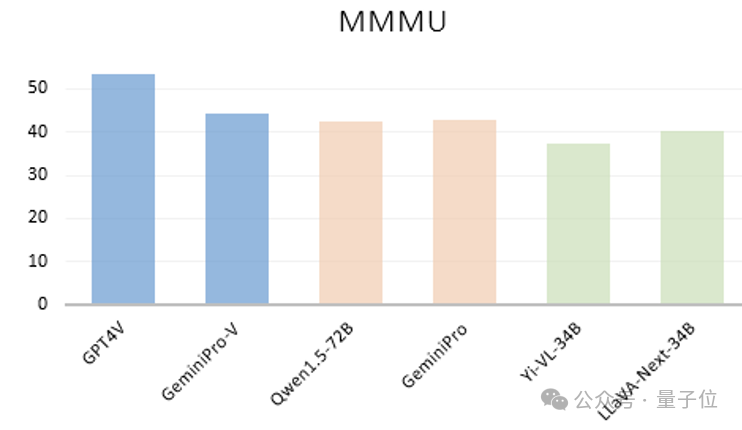

大模型不看图,竟也能正确回答视觉问题?!中科大、香港中文大学、上海AI Lab的研究团队团队意外发现了这一离奇现象。他们首先看到像GPT-4V、GeminiPro、Qwen1.5-72B、Yi-VL-34B以及LLaVA-Next-34B等大模型,不管是闭源还是开源,语言模型还是多模态,竟然只根据在多模态基准MMMU测试中的问题和选项文本,就能获得不错的成绩。

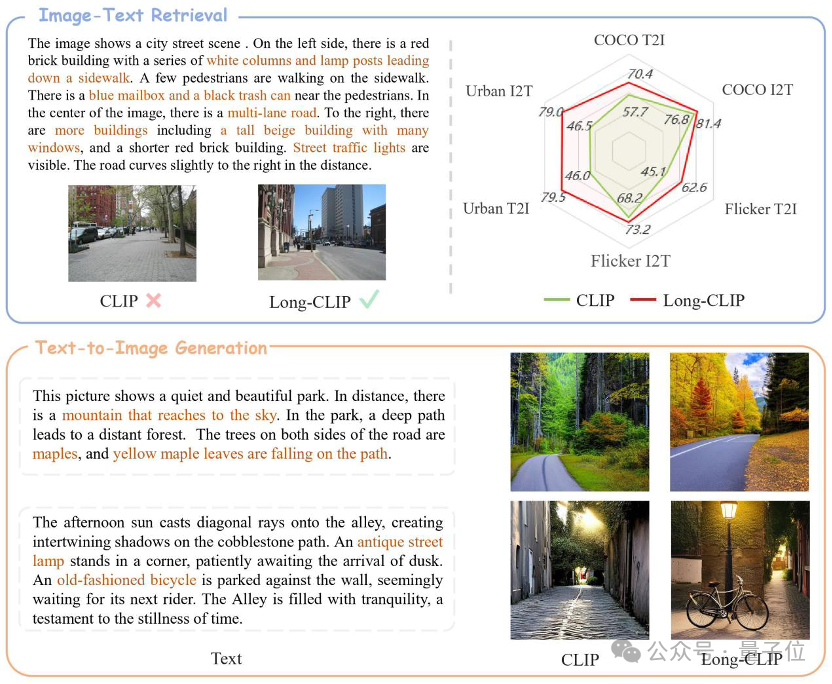

CLIP长文本能力被解锁,图像检索任务表现显著提升!一些关键细节也能被捕捉到。上海交大联合上海AI实验室提出新框架Long-CLIP。

“据我了解,国内多个一线大模型机构,都已经突破了兆级的长文本能力。”以上,是“2024全球开发者先锋大会”大模型前沿论坛会间隙,上海人工智能实验室领军科学家林达华与量子位的交谈剪影。

最新科学大模型浦科化学(ChemLLM),发布即开源!

来自南洋理工大学、上海AI实验室等机构的研究人员,共同推出了新款文生3D基础模型3DTopia。只需要一组文本,它就可以在5分钟内生成出多样化、高精度的3D模型。

Nature今年的统计显示,有78%的科学家还没有将ChatGPT等AI工具纳入日常研究中来。

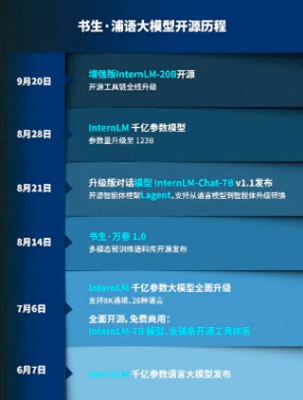

上海AI实验室与商汤科技联合香港中文大学和复旦大学正式推出书生·浦语大模型(InternLM)200亿参数版本InternLM-20B,并在阿里云魔搭社区(ModelScope)开源首发。