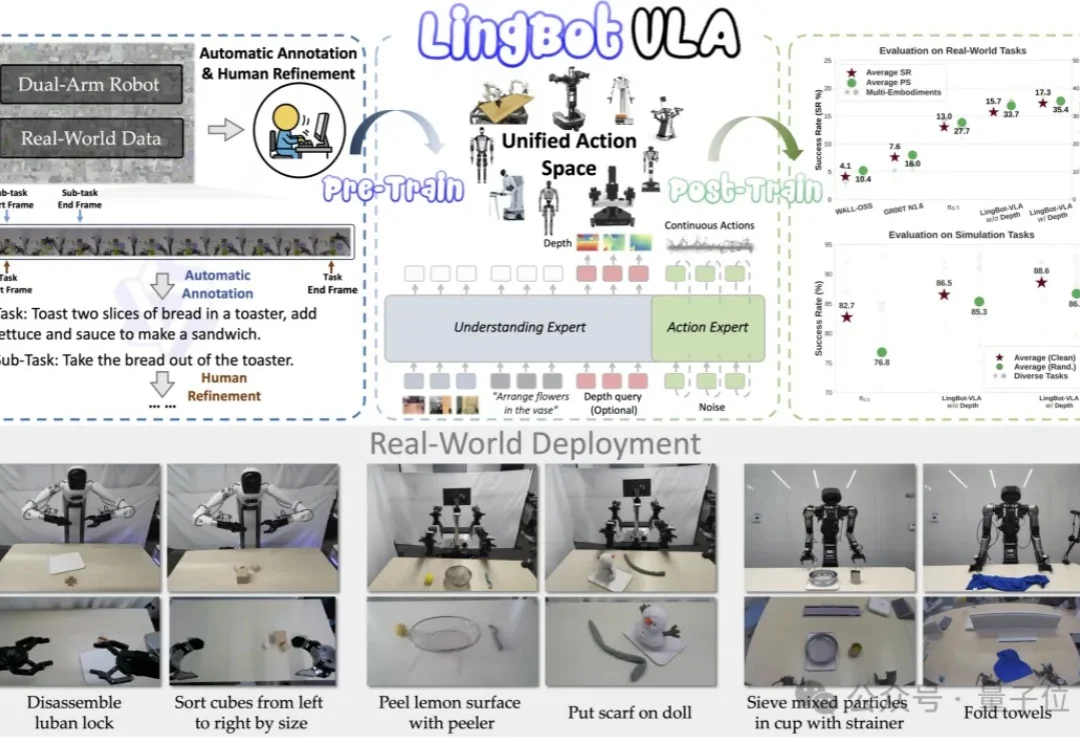

蚂蚁灵波开源LingBot-VLA后训练代码!150条示教数据即可适配新机器人

蚂蚁灵波开源LingBot-VLA后训练代码!150条示教数据即可适配新机器人就在刚刚,蚂蚁集团旗下具身智能公司灵波科技传出新动作—— 全面开源其具身基座模型LingBot-VLA的真机后训练工具链。

搜索

搜索

就在刚刚,蚂蚁集团旗下具身智能公司灵波科技传出新动作—— 全面开源其具身基座模型LingBot-VLA的真机后训练工具链。

如果要让机器人更有价值,“大脑”层面的突破是关键。

家庭具身智能企业「欧拉万象(Ola Dimensions)」近日已完成数亿元人民币融资,由招商局创投领投,赛富投资、九合创投、拙朴投资、BV百度风投、聚合投资等知名机构联合投资。

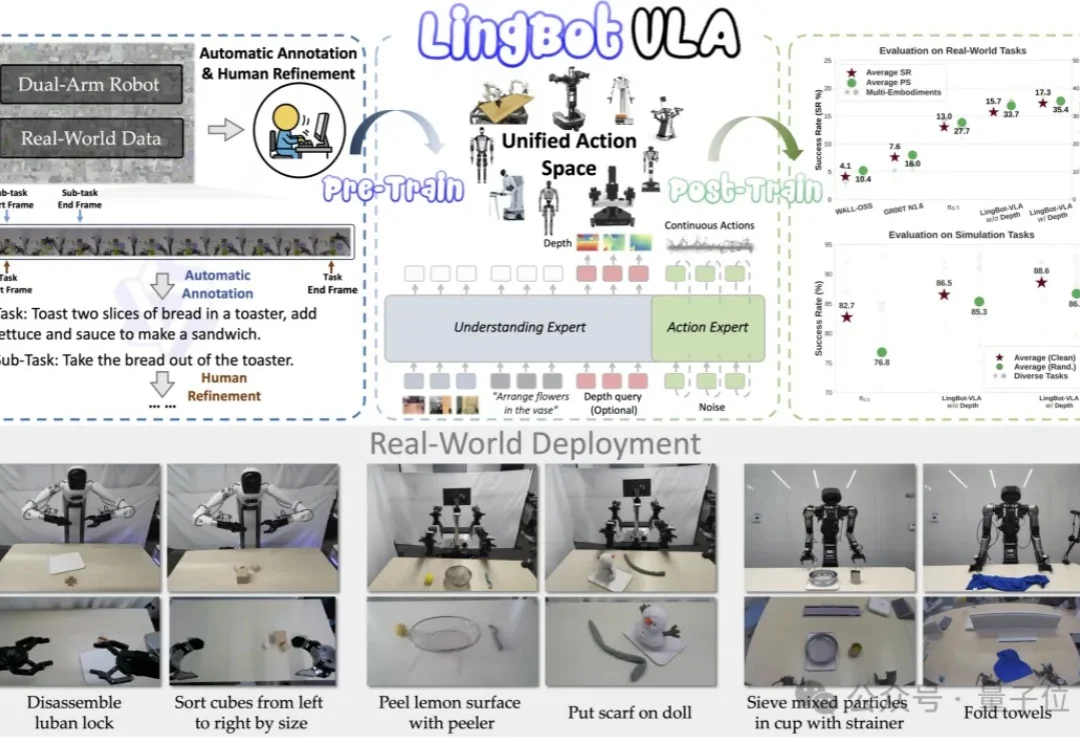

刚刚,宇树发布其首款载人变形机甲GD01。据称这是全球首款量产版载人机甲,可以变形,能作民用交通工具,载人后体重约500kg,售价390万元起。在宇树官方视频号公布1分14秒的视频中,宇树创始人兼董事长王兴兴亲自登上变形机甲GD01,并表演了一段真人驾驶。

重构仿真数据的生产方式。

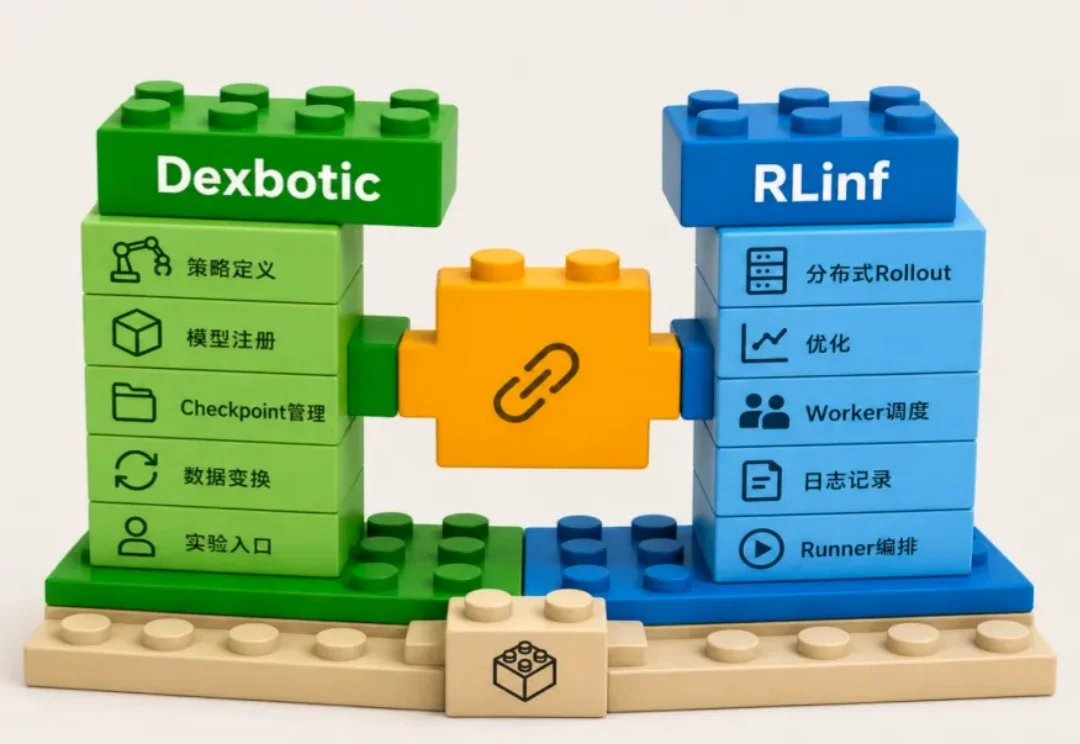

近日,原力灵机开源的具身智能原生框架 Dexbotic 宣布正式支持以 RLinf 作为其分布式强化学习后端。对具身智能开发者而言,这不仅是一次普通的工程适配,更意味着 VLA 模型研发中长期存在的「SFT 与 RL 割裂」问题,正在被真正打通。

2026 年,机器人正在准备走进家庭,和人类同处一个屋檐下。

机器人拉个拉链,到底需不需要“脑子”?

你可能觉得今年人形机器人的 demo 已经看麻了。但 Ted Xiao 说,哪怕是最粗糙的那一条,放在两年前都能让全场研究者惊掉下巴,因为那时候没人相信这事真能成。

GENE-26.5 值得看的,是它背后的「具身智能版 Harness + 模型」。