进我的收藏夹吃灰吧:大模型加速超全指南来了

进我的收藏夹吃灰吧:大模型加速超全指南来了2023 年,大型语言模型(LLM)以其强大的生成、理解、推理等能力而持续受到高度关注。然而,训练和部署 LLM 非常昂贵,需要大量的计算资源和内存,因此研究人员开发了许多用于加速 LLM 预训练、微调和推理的方法。

来自主题: AI技术研报

4652 点击 2024-02-09 14:05

2023 年,大型语言模型(LLM)以其强大的生成、理解、推理等能力而持续受到高度关注。然而,训练和部署 LLM 非常昂贵,需要大量的计算资源和内存,因此研究人员开发了许多用于加速 LLM 预训练、微调和推理的方法。

近年来,随着Transformer模型的大规模发展和应用,模型大小每两年平均增长240倍,GPT-3等大模型的参数增长已经超过了GPU内存的增长。在大算力激增的需求下,越来越多行业人士认识到,新的计算架构或许才是算力破局的关键。

近日,苹果连发两篇论文,不仅能一键生成逼真的3D化身,而且还要把大模型装进你的iPhone

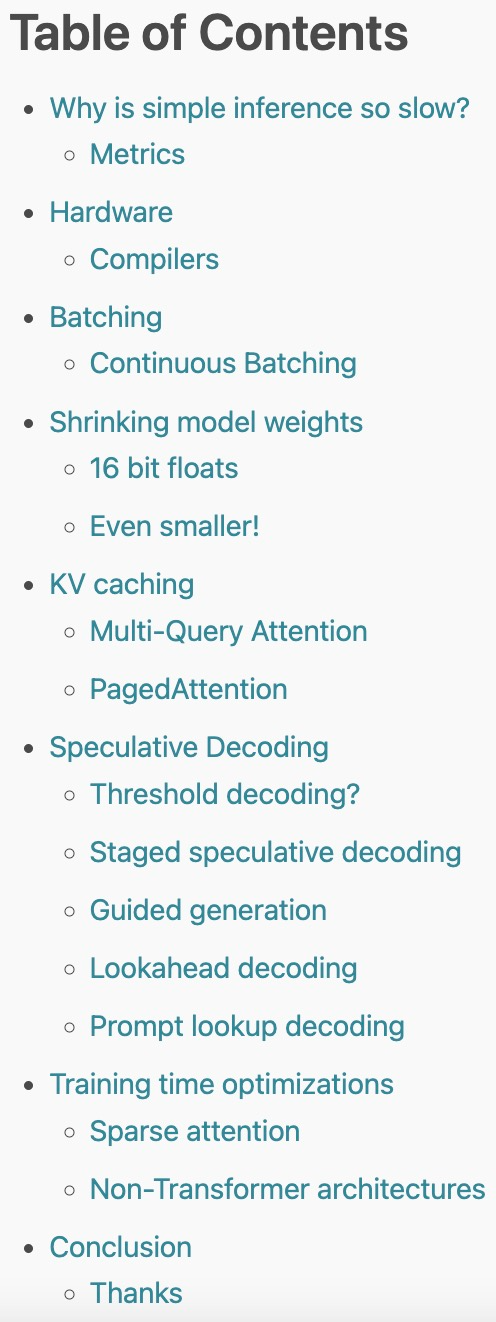

大语言模型需要消耗巨量的GPU内存。有可能一个单卡GPU跑推理吗?可以的话,最低多少显存?70B大语言模型仅参数量就有130GB,仅仅把模型加载到GPU显卡里边就需要2台顶配100GB内存的A100。

端侧大模型以及AI Core的出现,势必将带来安卓机新一轮的内存容量升级。

英伟达老黄,带着新一代GPU芯片H200再次炸场。官网毫不客气就直说了,“世界最强GPU,专为AI和超算打造”。