国产Nano Banana开源!用华为AI芯片训练,1张图只要1毛钱

国产Nano Banana开源!用华为AI芯片训练,1张图只要1毛钱今天,首个在国产芯片上完成全程训练的SOTA(最佳水平)多模态模型开源。这是智谱联合华为开源的图像生成模型GLM-Image。从数据到训练的全流程,该模型完全基于昇腾Atlas 800T A2设备和昇思MindSpore AI框架完成构建。

今天,首个在国产芯片上完成全程训练的SOTA(最佳水平)多模态模型开源。这是智谱联合华为开源的图像生成模型GLM-Image。从数据到训练的全流程,该模型完全基于昇腾Atlas 800T A2设备和昇思MindSpore AI框架完成构建。

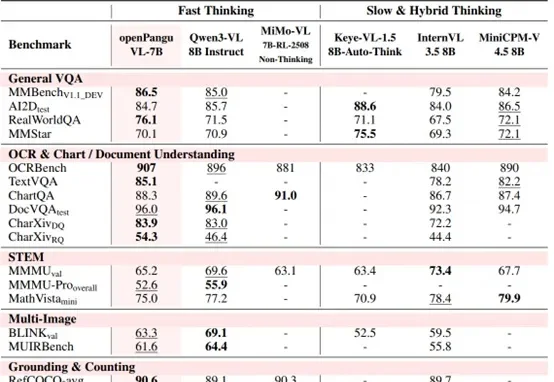

7B量级模型,向来是端侧部署与个人开发者的心头好。

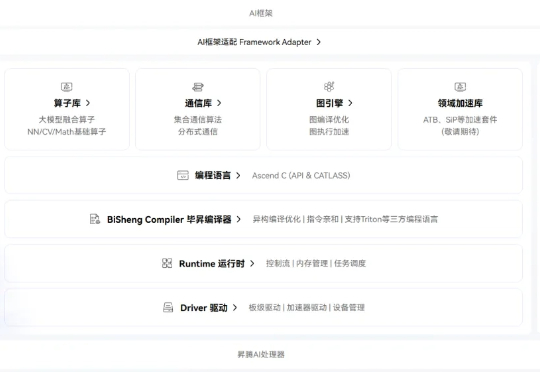

最近,在 AI 基础算力上重磅频出的华为,又亮出了一张王牌:昇腾的底层基础软件,CANN 全面开源开放。昇腾宣布将通过一系列新举措,持续支持开发者在 AI 模型、算子、内核、底层资源等多个层级进行自主优化与自定义开发。通过开放共建,一个新兴的 AI 算力生态正在快速崛起,改变计算架构领域本已固化的格局。

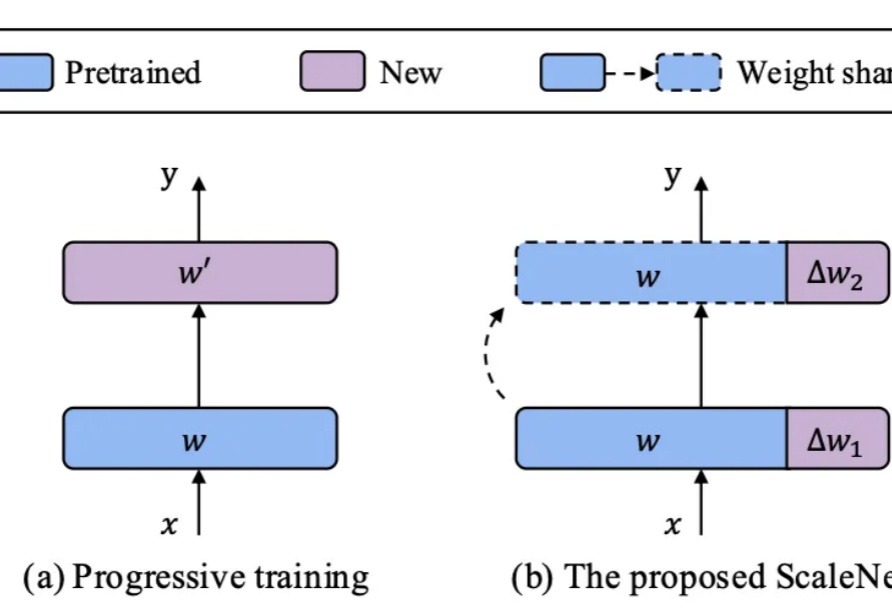

在基础模型领域,模型规模与性能之间的缩放定律(Scaling Law)已被广泛验证,但模型增大也伴随着训练成本、存储需求和能耗的急剧上升。如何在控制参数量的前提下高效扩展模型,成为当前研究的关键挑战。

今年是 AI 大模型的落地关键年。大模型技术在快速进步,但行业落地仍面临三大痛点:开发门槛高、场景碎片化、端侧能力有限。结合 AI 能力与云计算,在 CGC2025 大会上,华为云提出的 Versatile 智能体平台与 CloudDevice 云终端协同,正致力于破解这些难题。

AI 行业很多人相信,我们正在或已经进入所谓的「AI 下半场」。在这一轮 AI 的浪潮中,硬件的竞争早已不再是单纯的算力比拼,而是一场围绕软件、开发者与生态的「护城河」之战。当国产 AI 生态的转型成为科技领域的时代呼声,华为昇腾及其异构计算架构 CANN 正站在了这场变革的聚光灯下。

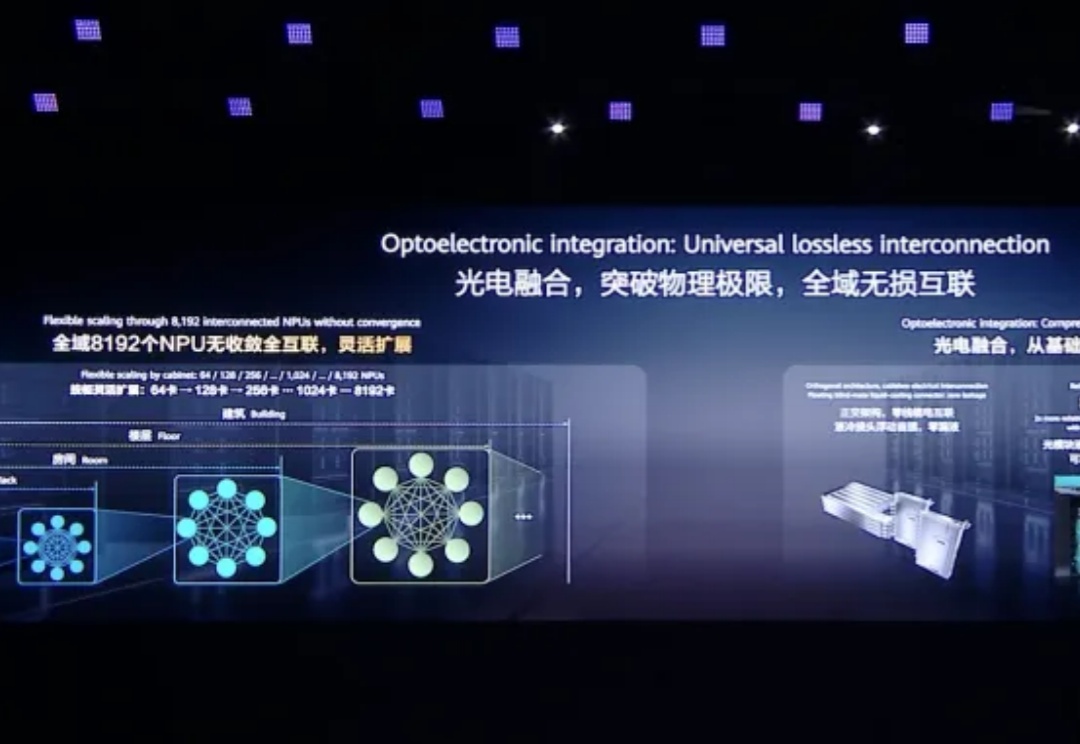

上周,华为全联接大会集中展示了华为最新最强的一系列创新。

在运营端,技术融合破解管理痛点:深圳明源云与华为共建 “业务-数据-AI” 三层平台,支撑建设、招商、运营、资管等四大AI场景落地,助力推动不动产投建营业务AI时代的变革。

作为华为服务金融客户的窗口,华为数字金融军团不仅在全联接大会上回顾了过往案例,更重点推出了应对 AI 落地挑战的 FAB(FinAgent Booster)金融智能体加速器。帮助客户快速建立自己的 Agent 能力,缩短开发周期,让 AI 加速融入业务流程。

在华为全联接大会2025上,鸿蒙操作系统5展示了其更强大的AI全场景能力,包括“小艺任务空间”“情绪感知”以及“小艺大脑”等一系列更高阶的AI全场景体验。无论是出差订票、日程安排,还是多设备联动播放音乐,AI助手小艺都能听得懂、做得到。