大模型推理成本降10倍、速度快20倍,AI Infra公司「趋境科技」在推理端开创模型落地新路径

大模型推理成本降10倍、速度快20倍,AI Infra公司「趋境科技」在推理端开创模型落地新路径2024年,落地,无疑是大模型最重要的主题。

2024年,落地,无疑是大模型最重要的主题。

千亿参数规模的大模型推理,服务器仅用4颗CPU就能实现!

最近,新加坡国立大学联合南洋理工大学和哈工深的研究人员共同提出了一个全新的视频推理框架,这也是首次大模型推理社区提出的面向视频的思维链框架(Video-of-Thought, VoT)。视频思维链VoT让视频多模态大语言模型在复杂视频的理解和推理性能上大幅提升。该工作已被ICML 2024录用为Oral paper。

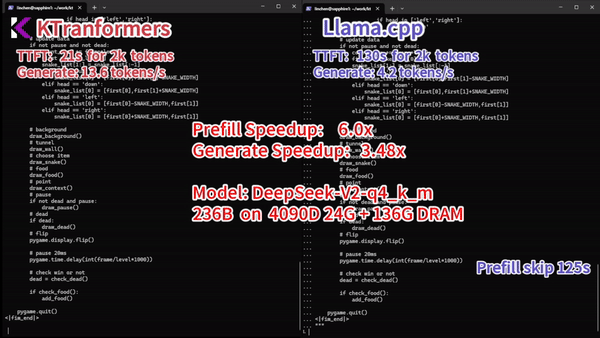

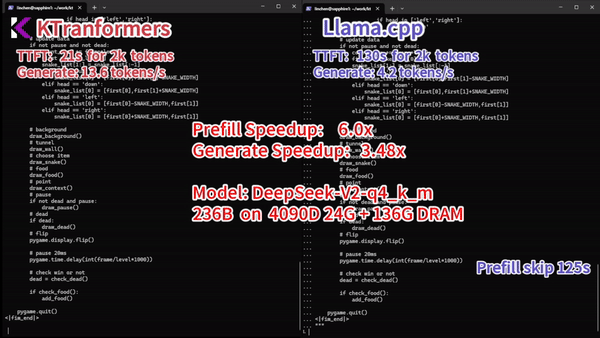

微软的这项研究让开发者可以在单卡机器上以 10 倍的速度处理超过 1M 的输入文本。

如何在有限的内存下实现高效的大模型推理,是端侧AI发展的重要任务。

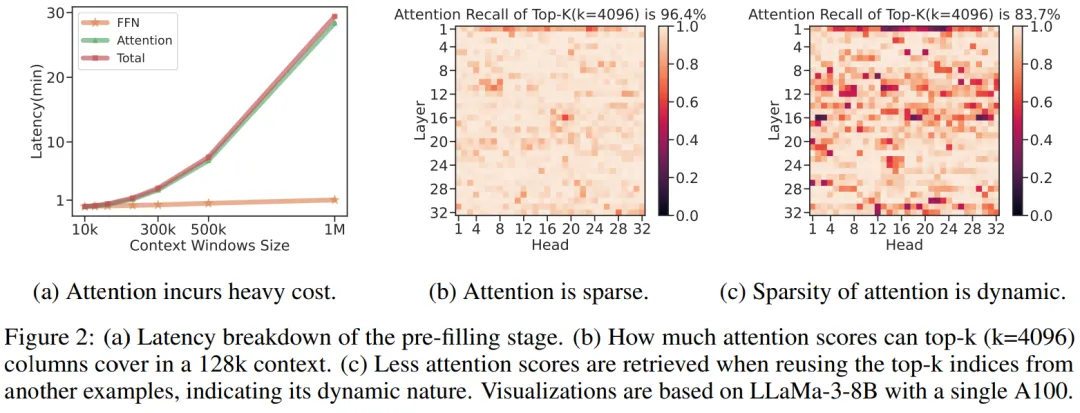

大模型推理速度提升50%以上,还能保证少样本学习性能!

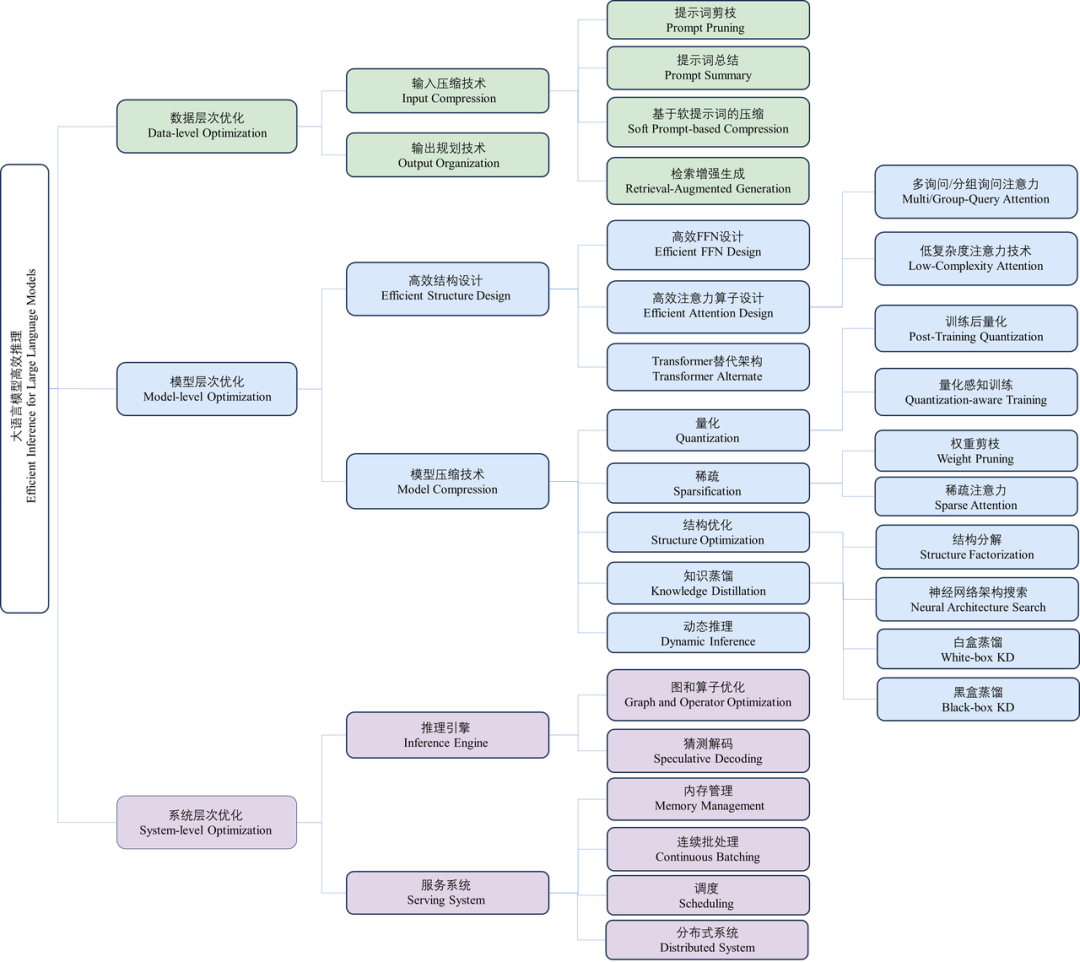

近年来,大语言模型(Large Language Models, LLMs)受到学术界和工业界的广泛关注,得益于其在各种语言生成任务上的出色表现,大语言模型推动了各种人工智能应用(例如ChatGPT、Copilot等)的发展。然而,大语言模型的落地应用受到其较大的推理开销的限制,对部署资源、用户体验、经济成本都带来了巨大挑战。

两周前,OpenBMB开源社区联合面壁智能发布领先的开源大模型「Eurux-8x22B 」。相比口碑之作 Llama3-70B,Eurux-8x22B 发布时间更早,综合性能相当,尤其是拥有更强的推理性能——刷新开源大模型推理性能 SOTA,堪称开源大模型中「理科状元」。

【新智元导读】从今天起,千元级就能解锁专属大模型了!这款搭载首颗纯国产14nm Chiplet大模型推理芯片的「深目」AI模盒,可以轻松实现百亿级参数多模态大模型的推理+微调。各种碎片化长尾算法,直接秒级生成!

推测解码(Speculative Decoding)是谷歌等机构在 2022 年发现的大模型推理加速方法。它可以在不损失生成效果前提下,获得 3 倍以上的加速比。GPT-4 泄密报告也提到 OpenAI 线上模型推理使用了它。