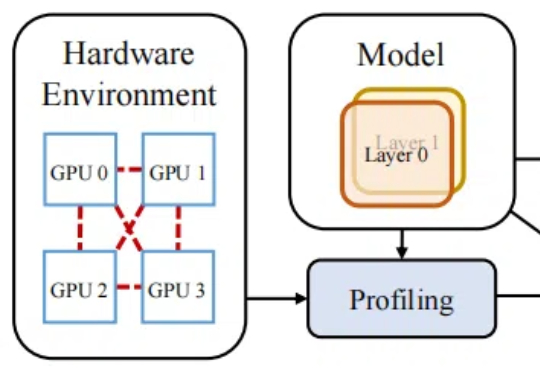

CVPR Oral | 南京大学李武军教授课题组推出分布式训练算法UniAP,大模型训练最高加速3.8倍

CVPR Oral | 南京大学李武军教授课题组推出分布式训练算法UniAP,大模型训练最高加速3.8倍训练成本高昂已经成为大模型和人工智能可持续发展的主要障碍之一。

搜索

搜索

训练成本高昂已经成为大模型和人工智能可持续发展的主要障碍之一。

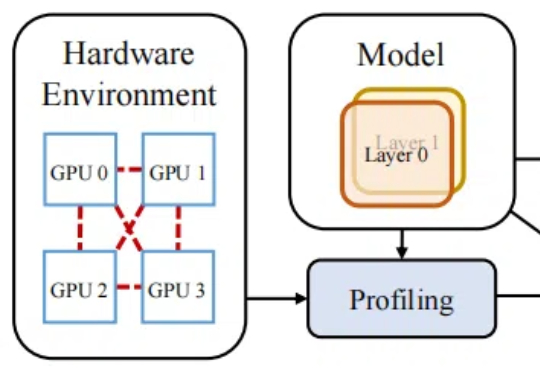

「工欲善其事,必先利其器。」 如今,人工智能正以前所未有的速度革新人类认知的边界,而工具的高效应用已成为衡量人工智能真正智慧的关键标准。

大模型训练几乎消耗尽所有IT数据之后,挖掘OT数据正成为AI落地的重要方向。

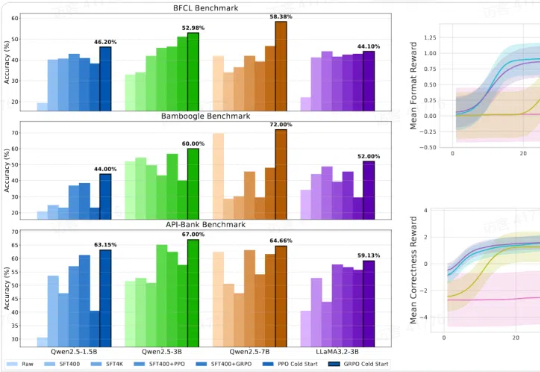

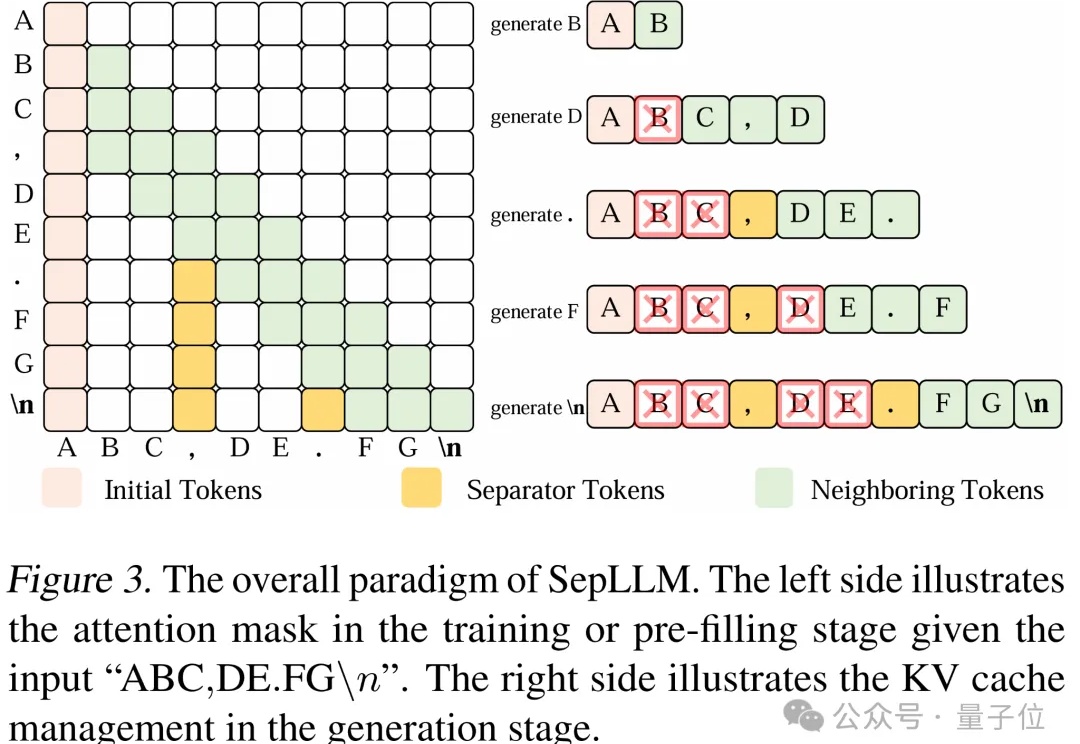

文字中貌似不起眼的标点符号,竟然可以显著加速大模型的训练和推理过程?

卷赢大模型训练成本之后,DeepSeek正在重塑全球AI竞争格局。

36氪获悉,具身智能创业公司“自变量机器人(X Square Robot)”完成数亿元Pre-A++轮融资。本轮融资由光速光合与君联资本领投、北京机器人产业基金、神骐资本跟投。融资将用于下一代统一具身智能通用大模型的训练与场景落地。

首个FP4精度的大模型训练框架来了,来自微软研究院!

12月31日,上海高级别自动驾驶引领区数据采集车发车仪式在上海浦东举行,30辆全新的智己L6数据采集车盛装列队并集中发车。上海正谋划打造人工智能“模塑申城”,建设高级别自动驾驶引领区,按照“单车智能为基础,车路云协同为关键支撑”技术路线,持续推动上海智能网联汽车产业生态培育。

DeepSeek新版模型正式发布,技术大佬们都转疯了! 延续便宜大碗特点的基础之上,DeepSeek V3发布即完全开源,直接用了53页论文把训练细节和盘托出的那种。

枢途科技(深圳)有限公司(以下简称「枢途科技」)近日完成数百万元天使轮融资,本轮由奇绩创坛投资,主要用于多模态大模型训练迭代、通用复合机器人结构升级等技术与产品的研发和交付。