深挖RLHF潜力,复旦语言和视觉团队创新奖励模型优化,让大模型更对齐

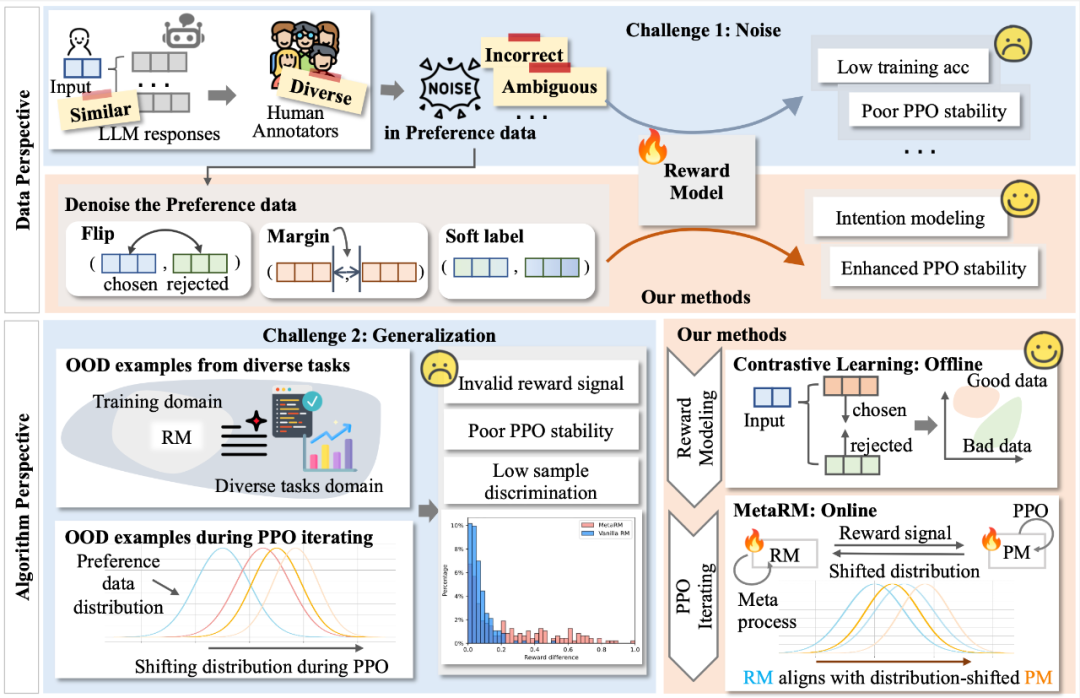

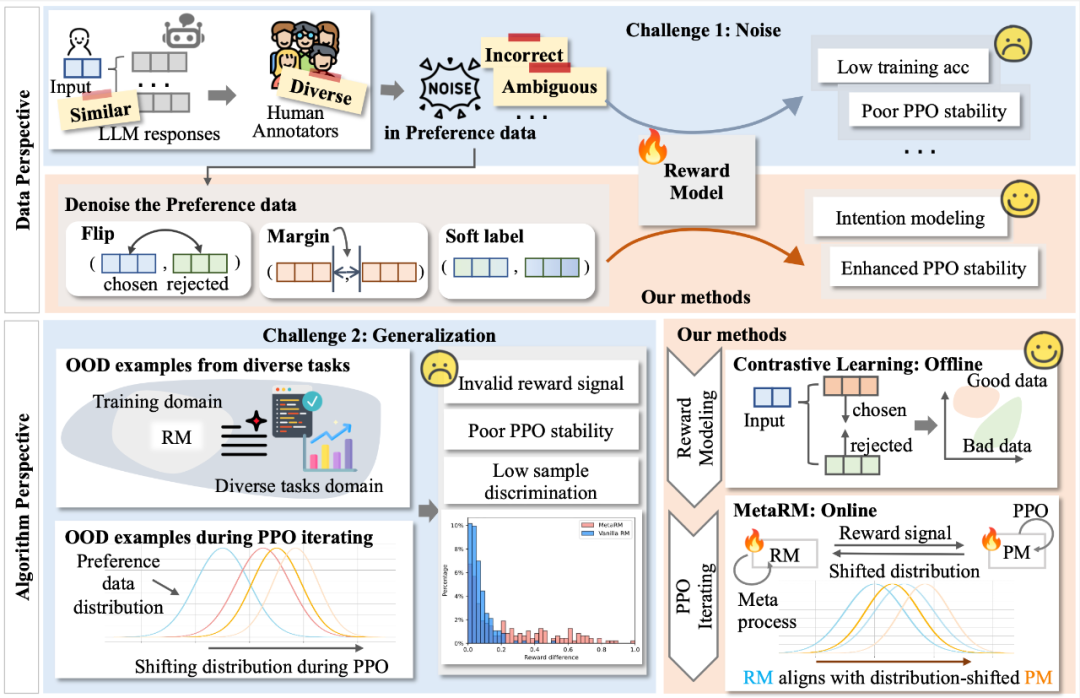

深挖RLHF潜力,复旦语言和视觉团队创新奖励模型优化,让大模型更对齐复旦团队进一步挖掘 RLHF 的潜力,重点关注奖励模型(Reward Model)在面对实际应用挑战时的表现和优化途径。

来自主题: AI技术研报

4238 点击 2024-01-16 10:16

复旦团队进一步挖掘 RLHF 的潜力,重点关注奖励模型(Reward Model)在面对实际应用挑战时的表现和优化途径。

传闻中OpenAI的Q*,已经引得AI大佬轮番下场。AI2研究科学家Nathan Lambert和英伟达高级科学家Jim Fan都激动的写下长文,猜测Q*和思维树、过程奖励模型、AlphaGo有关。人类离AGI,已是临门一脚了?