WAIC科学前沿会议大佬演讲干货!周伯文:大模型也有幻觉,全球AI创新指数公布

WAIC科学前沿会议大佬演讲干货!周伯文:大模型也有幻觉,全球AI创新指数公布随着AGI这一生产力背后的生产力的进一步发展进化,我们也期待通过不断的努力和探索,推动AGI的技术突破和价值实现,为人类社会创造更多的福祉。

随着AGI这一生产力背后的生产力的进一步发展进化,我们也期待通过不断的努力和探索,推动AGI的技术突破和价值实现,为人类社会创造更多的福祉。

本文介绍了一篇语言模型对齐研究的论文,由瑞士、英国、和法国的三所大学的博士生和 Google DeepMind 以及 Google Research 的研究人员合作完成。

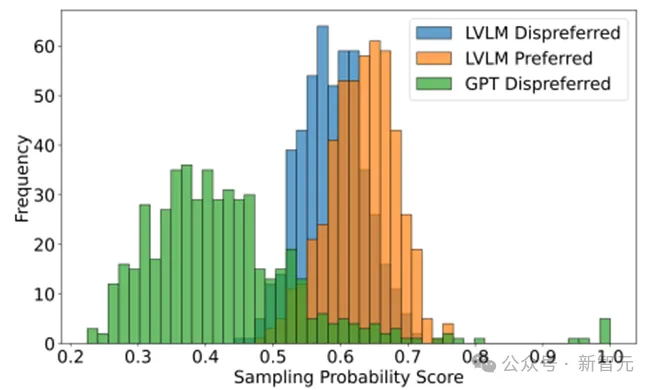

现有多模态大模型在对齐不同模态时面临幻觉和细粒度感知不足等问题,传统偏好学习方法依赖可能不适配的外源数据,存在成本和质量问题。Calibrated Self-Rewarding(CSR)框架通过自我增强学习,利用模型自身输出构造更可靠的偏好数据,结合视觉约束提高学习效率和准确性。

Alembic首次推出用于企业数据分析和决策支持的无「幻觉」人工智能。

DeepMind发表了一篇名为「To Believe or Not to Believe Your LLM」的新论文,探讨了LLM的不确定性量化问题,通过「迭代提示」成功将LLM的认知不确定性和偶然不确定性解耦。研究还将新推导出的幻觉检测算法应用于Gemini,结果表明,与基线方法相比,该方法能有效检测幻觉。

两个星期前,Google 在今年的 I/O 大会中高调介绍了自家的 AI 搜索功能 AI Overview,并在当周宣布对美国用户开放。我们尚且没能等来预热了好久的 ChatGPT Search,全球市占率超过 9 成的搜索引擎巨头 Google 却无预警地在美国开放了 AI 搜索,一副“为了提升用户体验舍我其谁”的架势。

谷歌AI又闯大祸!

虽然大型语言模型(LLM)在各种常见的自然语言处理任务中展现出了优异的性能,但随之而来的幻觉,也揭示了模型在真实性和透明度上仍然存在问题。

如今,大型语言模型(LLM)已经成为了我们生活中的好帮手

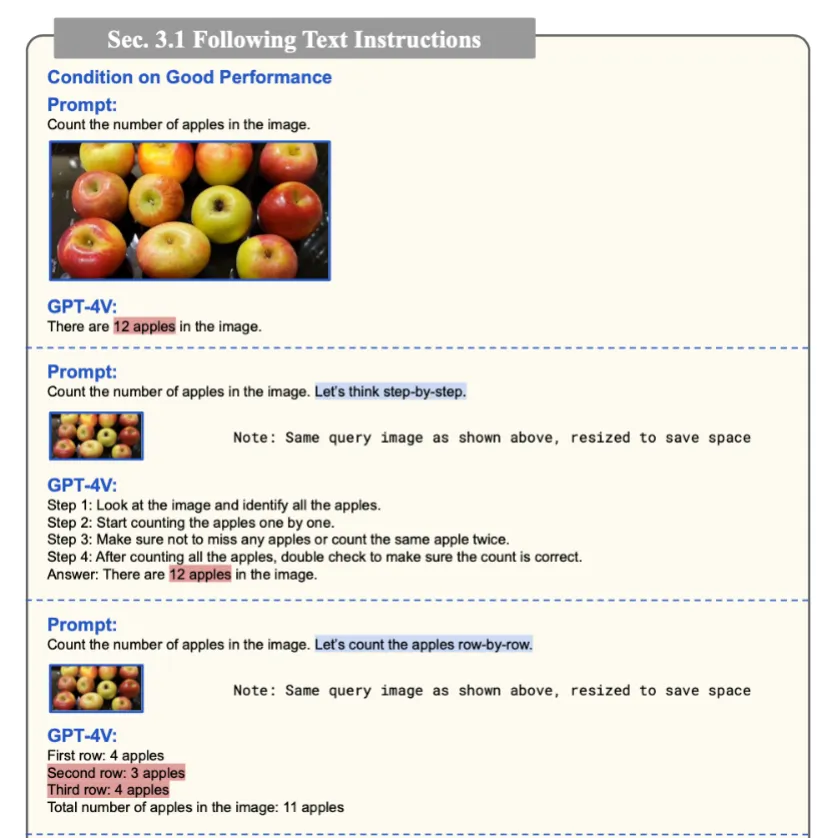

GPT-4V 的推出引爆了多模态大模型的研究。GPT-4V 在包括多模态问答、推理、交互在内的多个领域都展现了出色的能力,成为如今最领先的多模态大模型。