4GB 显存单卡居然能跑 70B 大模型了!

4GB 显存单卡居然能跑 70B 大模型了!大语言模型需要消耗巨量的GPU内存。有可能一个单卡GPU跑推理吗?可以的话,最低多少显存?70B大语言模型仅参数量就有130GB,仅仅把模型加载到GPU显卡里边就需要2台顶配100GB内存的A100。

来自主题: AI资讯

9272 点击 2023-12-07 11:00

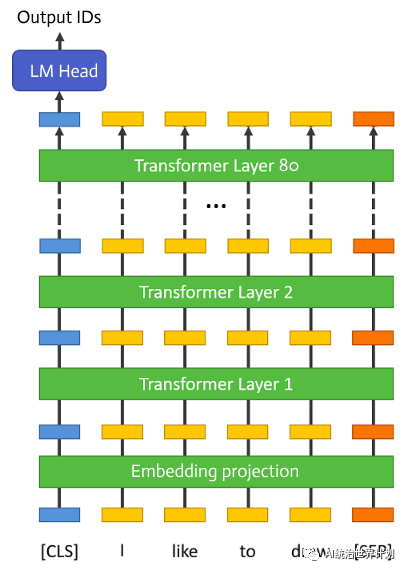

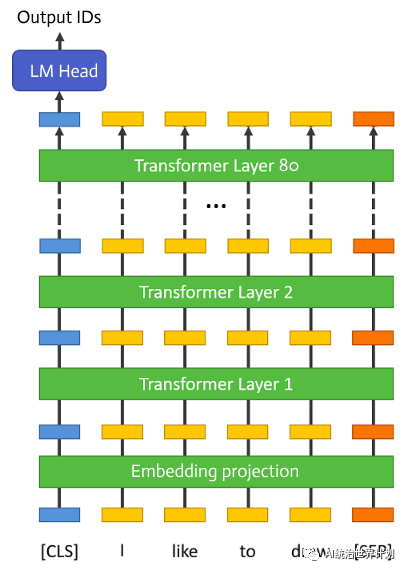

大语言模型需要消耗巨量的GPU内存。有可能一个单卡GPU跑推理吗?可以的话,最低多少显存?70B大语言模型仅参数量就有130GB,仅仅把模型加载到GPU显卡里边就需要2台顶配100GB内存的A100。

不知道大伙们还记得,那名用 50 张 1080 TI 显卡对抗癌症的“ 业余 ”程序员不。他曾自掏腰包训练了个 AI ,还整了个免费的网站,让人工智帮你“ 看片子 ”,能快速诊断出乳腺癌。

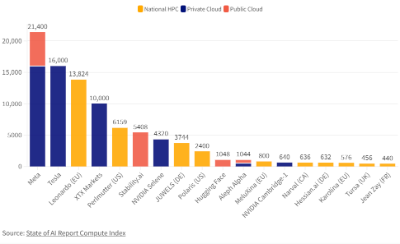

在高性能计算(HPC)、人工智能(AI)、和数据分析等领域,图形处理器(GPUs)正在发挥越来越重要的作用。其中,NVIDIA的 A100尤为引人注目。这是英伟达最强大的显卡处理器,也是当前使用最广泛大模型训练用的显卡。

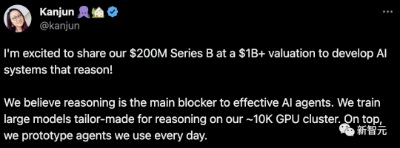

一家华人女科学家的创业公司晋升为独角兽,英伟达等机构投资超2亿美元。该公司手握1万块H100显卡!