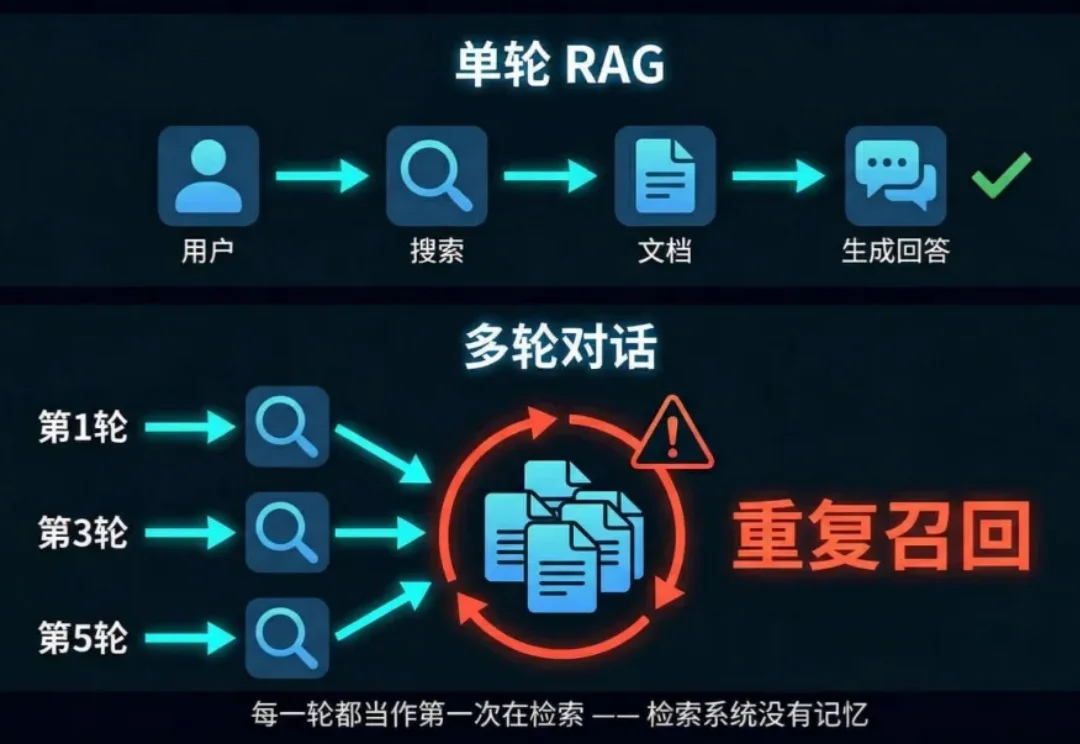

多轮对话时,RAG反复做重复召回,模型层与Milvus层分别如何解决?

多轮对话时,RAG反复做重复召回,模型层与Milvus层分别如何解决?做 RAG 的团队,基本都会在多轮对话上吃过亏。

做 RAG 的团队,基本都会在多轮对话上吃过亏。

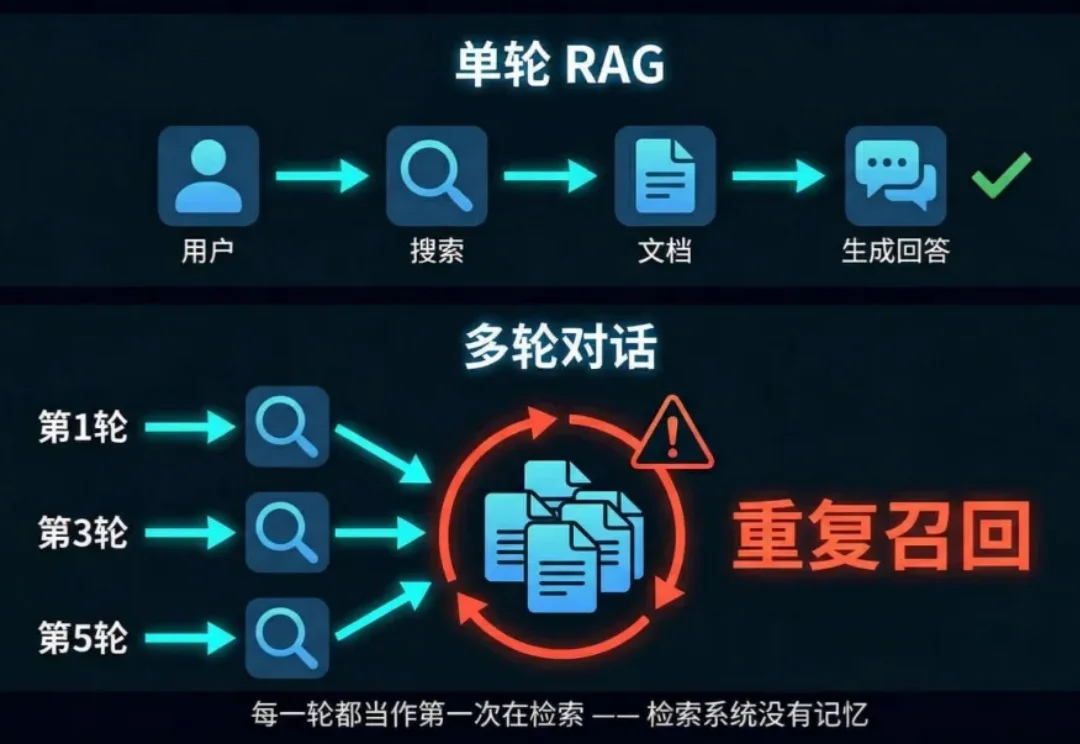

大多数世界模型工作默认:只要学到一个好的 latent dynamics,问题就解决了。 但这个假设本身是可疑的——什么样的信息,才足以支撑一个可预测、可传播的动力学? 本文从信息论出发,重新审视这一前提。

今天,多位开发者在DeepSeek官方交流群和社交媒体上反馈,DeepSeek官方API所调用的模型能力出现了变化,已拥有一百万的上下文窗口,而不是此前的128k,知识截止日期更新为2025年5月,而不是此前的2024年。

就在刚刚,自变量机器人发布了全球首个世界统一模型架构的具身智能基础模型:WALL-B。基于世界统一模型,WALL-B解决了传统VLA架构在模块间数据搬运上的bug点——

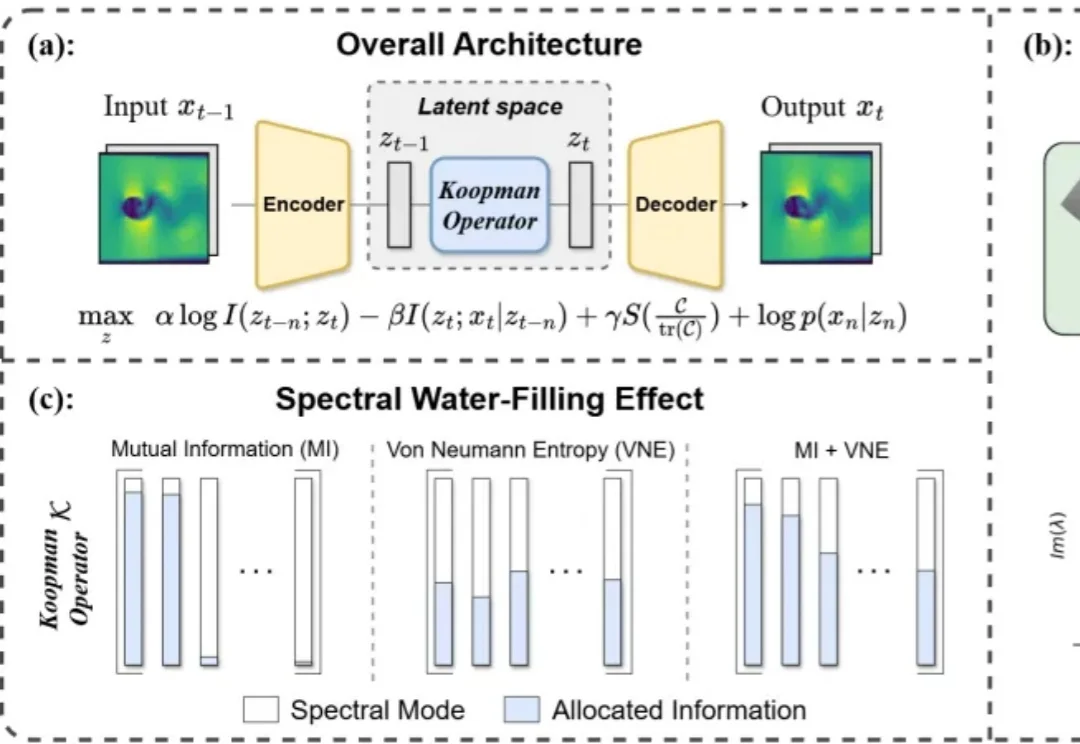

一个3B激活参数的端侧模型,在全球Agent权威评测中,以94%任务完成率,超越了Claude、GPT-5.4、Gemini等国际主流云侧和端侧大模型。商汤绝影Sage来了,它不是「更聪明的语音助手「,而是第一个真正能在车里「办成复杂事「的智能体基座。

手握最强大的模型Mythos,Anthropic却把它锁了起来。

大模型人才涌入,帮助智驾厂商突破原有技术框架上限。

用AI跑批量任务的人,手里基本都有一个干活的模型,不是最聪明,但要快、要便宜,稳定不出岔子。

神秘模型Elephant的面纱,终于被揭开了。

2026年3月26日,科创板公布了《宇树科技招股说明书》(申报稿)。拟发行不低于4044.6万股,募集资金约42亿(20亿用于模型研发、11亿用于本体研发4.4亿用于产品开发、6.2亿用于基建)。