多模态不是拼模块,千问新模型证明了最关键的一件事

多模态不是拼模块,千问新模型证明了最关键的一件事林俊旸离职了,但 Qwen 不能停。最近 Qwen3.5-Omni 发布,一个原生全模态大模型,文本、图片、音频、视频的理解与生成,集于一身。 这不是第一个试图「什么都做」的模型。过去两年,多模态是所

林俊旸离职了,但 Qwen 不能停。最近 Qwen3.5-Omni 发布,一个原生全模态大模型,文本、图片、音频、视频的理解与生成,集于一身。 这不是第一个试图「什么都做」的模型。过去两年,多模态是所

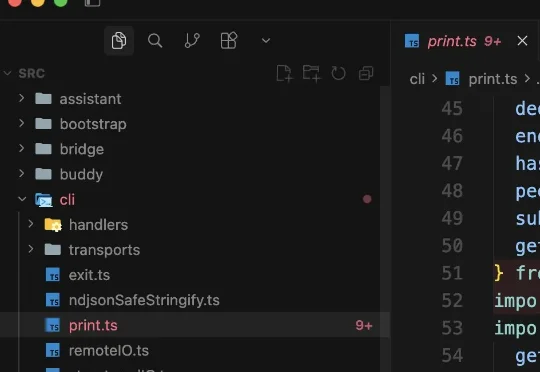

我自己用 Coding Plan 也有一段时间了,最开始只是为了省点 API 钱,后来各家陆续推出固定月费套餐,我发现选起来比想象中复杂。Codex、Claude Code、Cline、OpenClaw 这些工具让开发者越来越习惯用自然语言驱动代码生成和任务执行,但高频调用带来的 API 成本也成了一笔固定开销。

全世界都在等ASI降临,OpenAI却在年初悄悄上线广告位。9亿用户撑不起数百亿美元的算力账单,智力正在贬值,神仙也得下凡赚钱!

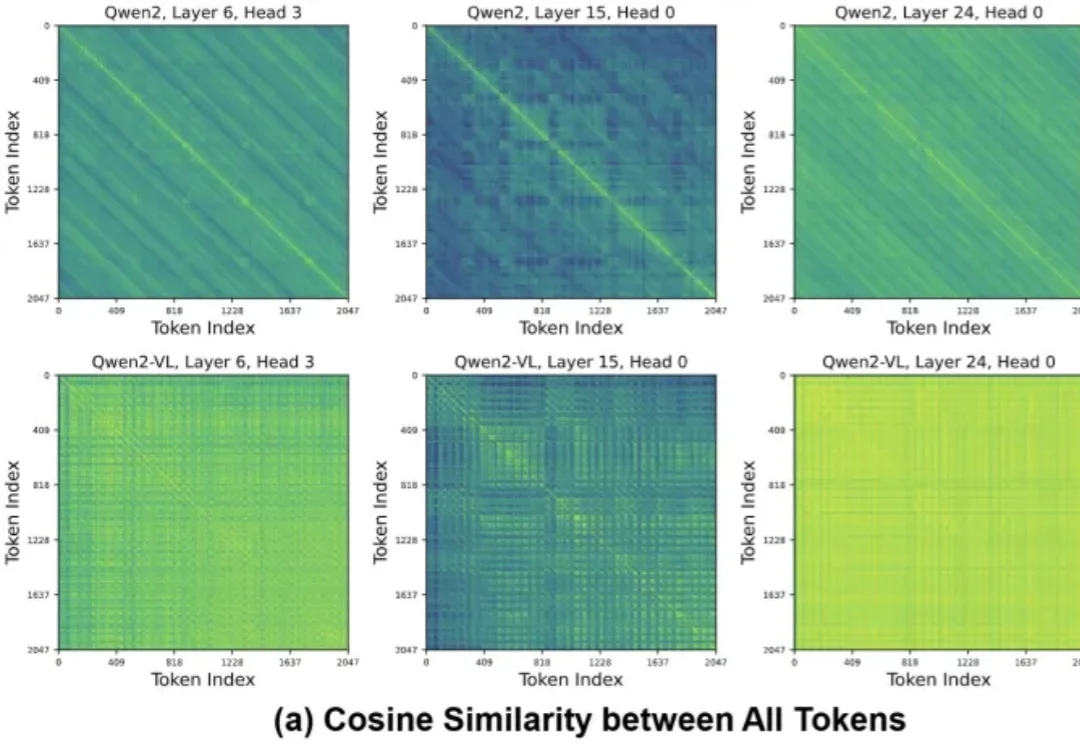

长上下文推理已经成了VLM/LLM的默认形态。

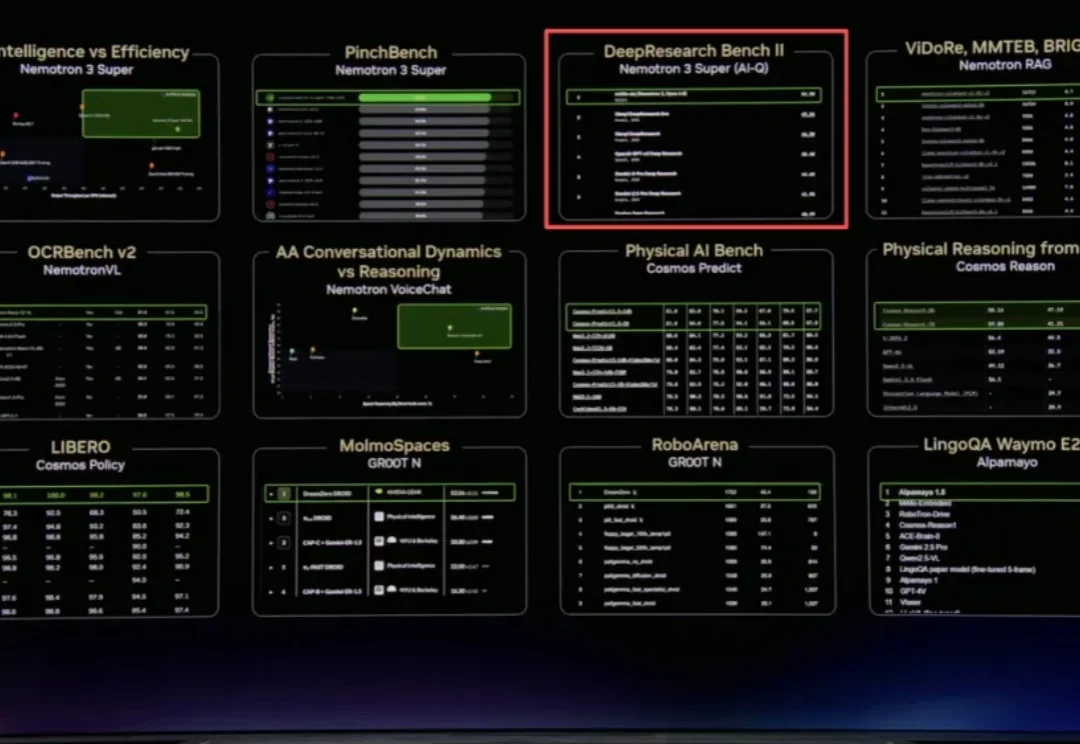

3 月 16 日,在刚刚结束的 NVIDIA GTC 2026 大会上,黄仁勋在长达三小时的 Keynote 演讲中发布了 NVIDIA Agent Toolkit 和 AI-Q 开放智能体蓝图,将 AI Agent 定位为下一个重大前沿。

3 月 31 日,智谱(02513.HK)发布上市后首份年度业绩。2025 年全年收入 7.24 亿人民币,同比增长 132%,是国内收入规模最大的大模型公司。同时,MaaS API 平台 ARR 约 17 亿人民币(约 2.5 亿美金),过去 12 个月增长 60 倍

对于 Anthropic 而言,这是继前几天 Mythos 模型文档外泄后的又一次严重 OpSec事故。但对于整个大模型应用层的开发者和行业研究者来说,这份源码却是一份毫无保留的、价值极高的前沿 AI Agent 工程架构白皮书。

具身数据层的全球竞赛正在迅速升温。NVIDIA Research在2026年发布EgoScale数据与训练框架,在Ego-centric人类操作视频上训练VLA模型,用 20,854小时带动作标注的第一人称人类视频,观察到数据规模和验证损失之间接近对数线性的scaling law。1X收集人类第一视角及家庭行为数据,通过 Sunday项目采集百万小时级家庭场景视频。

过去数月,AI 领域很难绕开一个名字 ——OpenClaw。这个项目在极短时间内获得了爆发式关注:数十万星标、惊人的 Token 消耗,以及几乎所有大厂的快速跟进。从表面上看,它像是又一个现象级 AI 产品;但如果进一步审视,一个更值得思考的问题随之浮现 ——OpenClaw 的出现,究竟意味着什么?它真的是一次技术突破,还是某种更深层变化的信号?

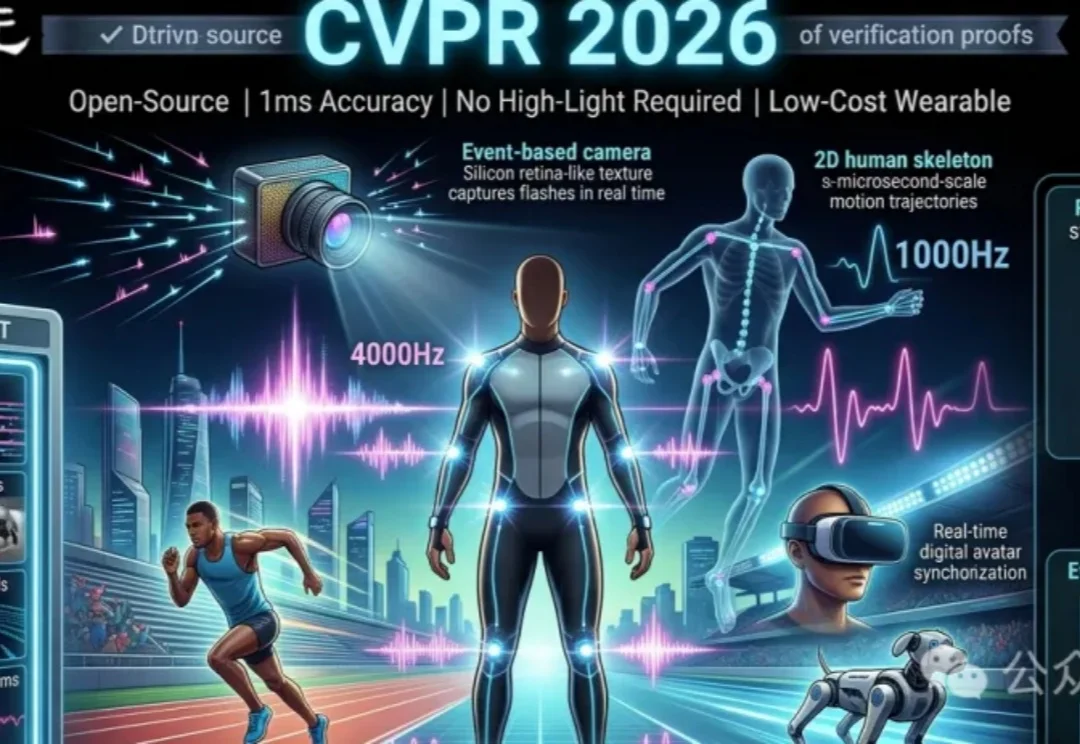

全球首个1毫秒级人体动作捕捉系统FlashCap,通过闪烁LED与事件相机结合,实现1000Hz超高帧率捕捉。无需昂贵设备或强光环境,低成本穿戴服即可精准捕捉极速动作。团队同步开源715万帧的FlashMotion数据集与多模态模型ResPose,显著提升运动分析精度,推动体育、VR与机器人领域迈向高动态智能新阶段。