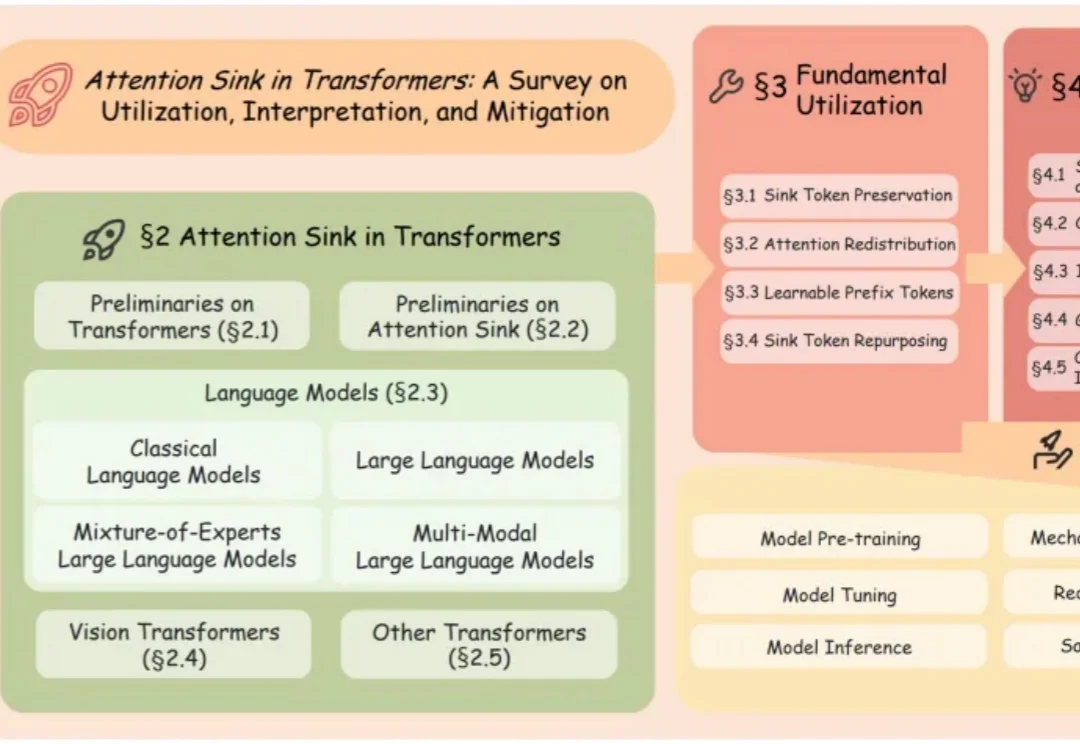

首篇「Attention Sink」综述:从利用、理解到消除,Transformer中的注意力「汇聚」全景解析

首篇「Attention Sink」综述:从利用、理解到消除,Transformer中的注意力「汇聚」全景解析几乎所有 Transformer 都在做一件反常的事:把大量注意力集中到少数几个特定 Token 上。这不是 bug,而是 Transformer 固有的「注意力汇聚」(Attention Sink)。首篇系统性综述,带你从利用、理解到消除,全面掌握这一核心现象。

来自主题: AI技术研报

8759 点击 2026-04-24 09:14