独家丨清华大学丁宁成立通用物理智能公司「自然意志」,估值40亿

独家丨清华大学丁宁成立通用物理智能公司「自然意志」,估值40亿AI科技评论独家获悉,清华大学助理教授、博士生导师丁宁成立公司「自然意志」,聚焦具身大脑方向,已获得IDG资本、峰瑞资本、真格基金等机构天使轮投资,估值高达40亿人民币。

AI科技评论独家获悉,清华大学助理教授、博士生导师丁宁成立公司「自然意志」,聚焦具身大脑方向,已获得IDG资本、峰瑞资本、真格基金等机构天使轮投资,估值高达40亿人民币。

近日,AI创业公司Naive.ai的融资消息引发广泛关注。据多家媒体报道,这家由清华大学电子工程系副教授代季峰创立的新公司,已完成约3亿美元融资,估值约8亿美元。投资方包括一线基金和科技巨头,具体机构暂未披露。公司专注于开源模型的后训练和AI Agent方向,核心团队包括前MiroMind成员及联合创始人朱锡洲。

当文字、图像、视频已经先后被生成式 AI 重写,3D 很可能就是下一站。

太疯狂了!Meta和METR刚测出的AI进化数据,与中国团队两年前提出的「密度定律」完美重合。硅谷猛然回头,发现中国研究者在这条路上已领先两年!

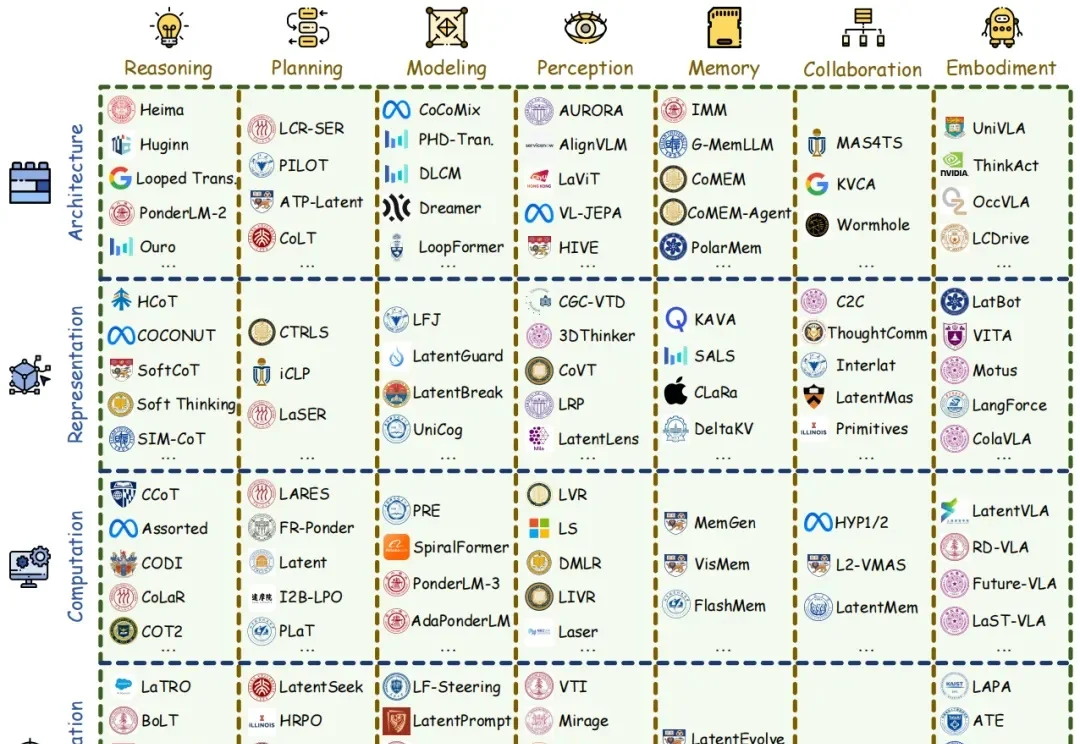

从 2024 年底的关于潜在空间的早期探索,再到 2025 年底和 2026 年初的相关研究爆发,潜空间范式正在彻底重塑大模型 (LLMs, VLMs, VLAs 等延伸模型) 的底层设计逻辑。

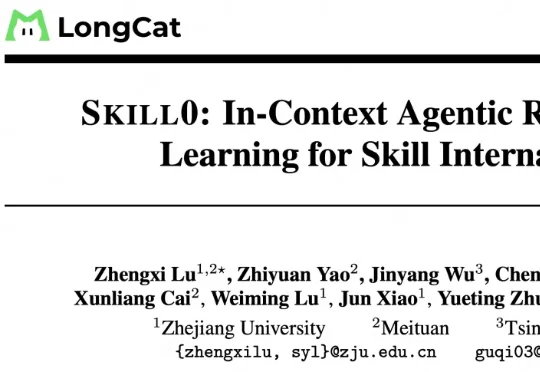

浙江大学联合美团龙猫团队、清华大学推出全新研究成果——SKILL0,并提出技能内化(Skill Internalization)——小模型真正需要的,或许不是推理时的“外挂技能”,而是将技能内化为本能。

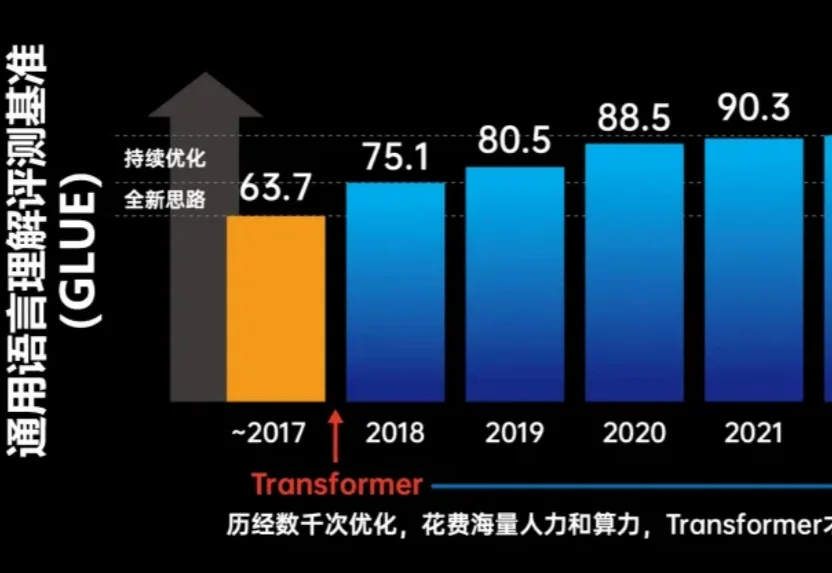

在人工智能研究中,许多研究者将大量时间投入到为那 1% 的性能提升反复调参与实验迭代之中。

从高价值商业场景切入,打造“真通用”的具身智能。

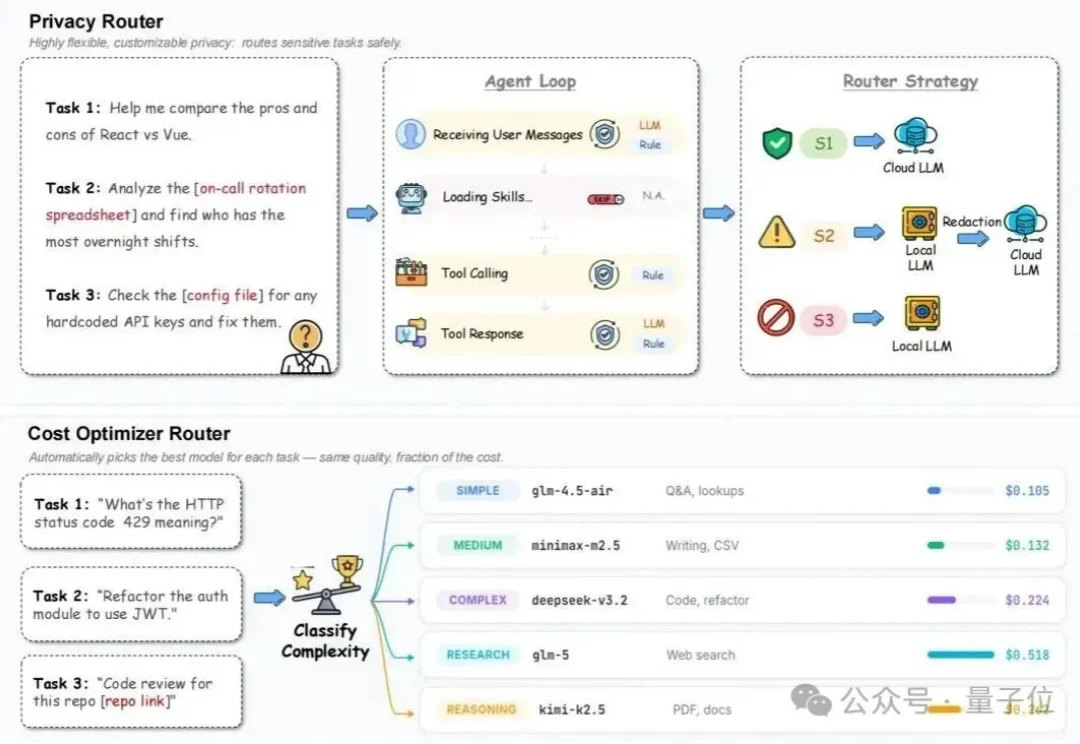

把Agent接入工作流,本该是件提效的乐事。

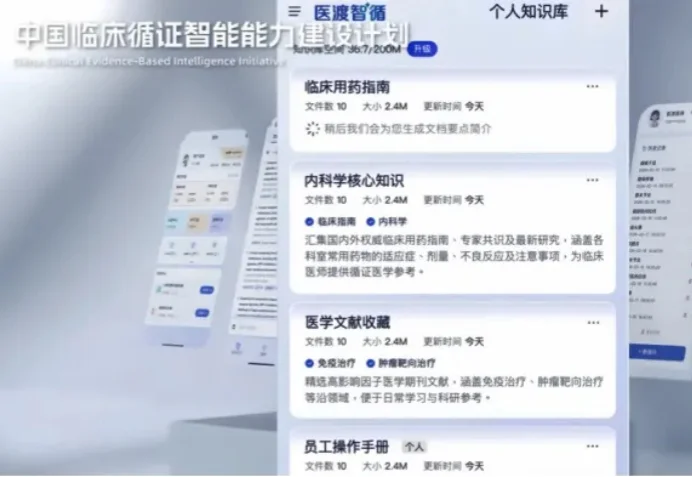

2026中关村论坛上,清华大学附属北京清华长庚医院等多家顶级医疗机构,联合发起国内首个聚焦循证医学与AI深度融合的行业级举措——“中国临床循证智能能力建设计划”。