突破万次连续编辑极限!中科院提出首个理论保稳的知识保留方法

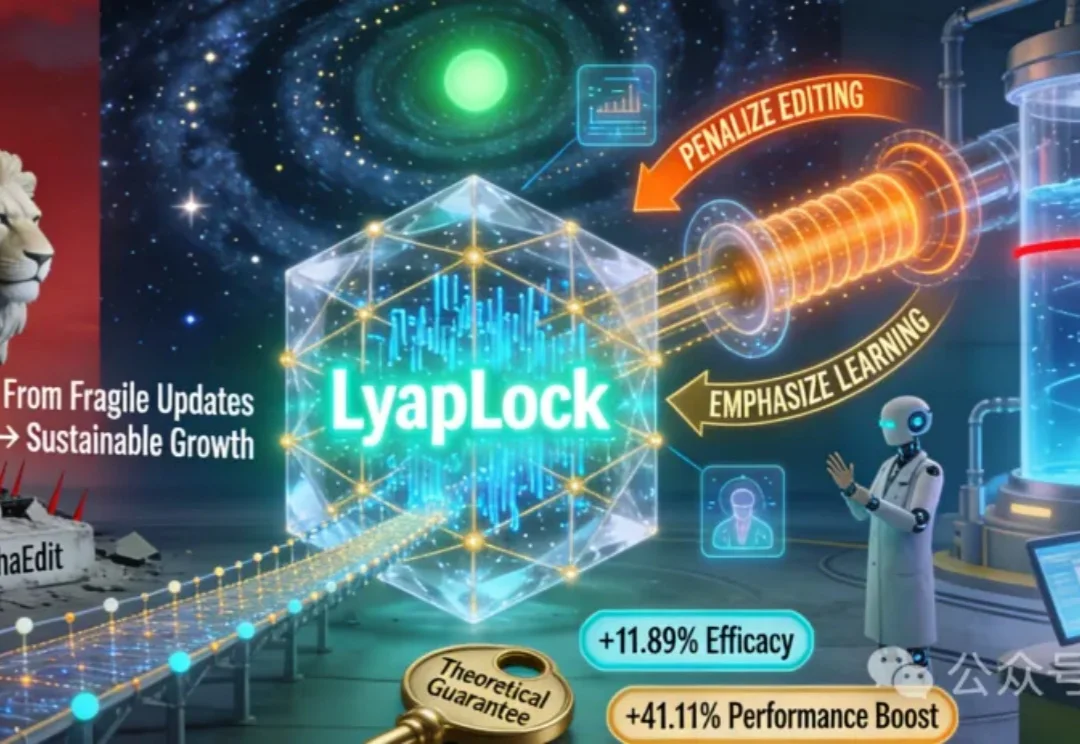

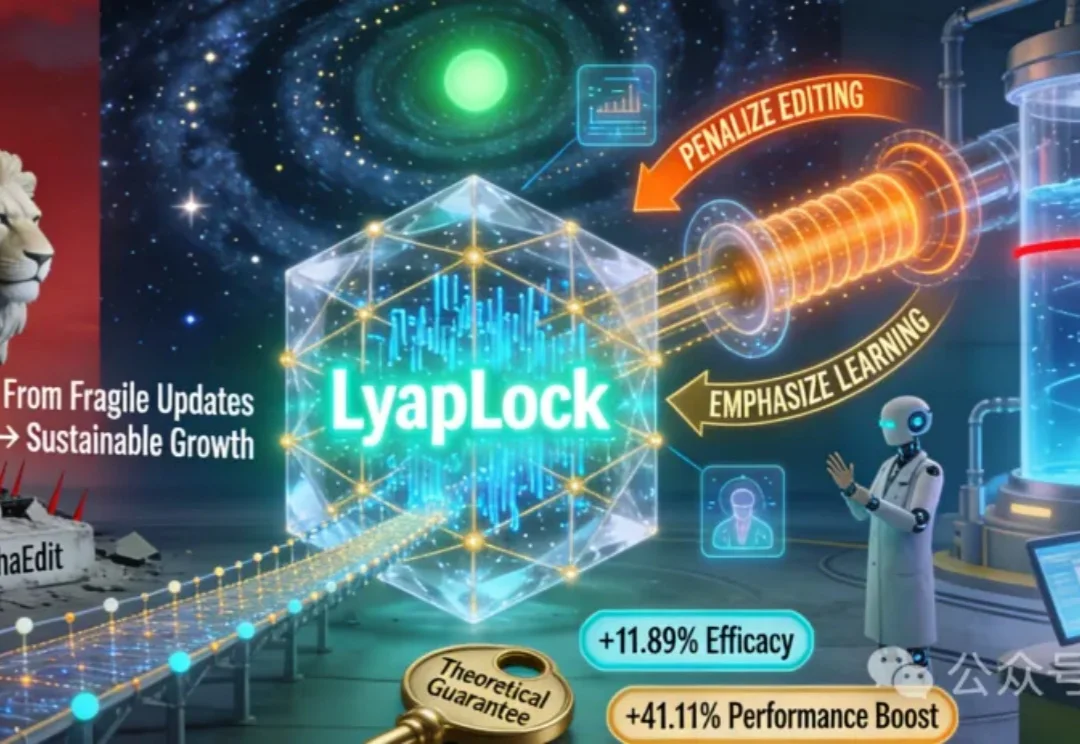

突破万次连续编辑极限!中科院提出首个理论保稳的知识保留方法LyapLock首次让大模型在上万次知识更新中稳住旧记忆、精准学新知。它用「虚拟队列」实时监控遗忘风险,动态平衡新旧知识,理论保证长期不崩盘,编辑效果比主流方法提升11.89%,还能赋能现有模型,让AI真正学会「持续成长」。

来自主题: AI技术研报

10162 点击 2026-03-12 10:16

LyapLock首次让大模型在上万次知识更新中稳住旧记忆、精准学新知。它用「虚拟队列」实时监控遗忘风险,动态平衡新旧知识,理论保证长期不崩盘,编辑效果比主流方法提升11.89%,还能赋能现有模型,让AI真正学会「持续成长」。

精准学获阿里2亿融资,推AI一对一教育产品。

从教育版“高德地图”,到真正的“AI老师”