浙大李玺团队:指代表达理解新方法,ScanFormer粗到细迭代消除视觉冗余

浙大李玺团队:指代表达理解新方法,ScanFormer粗到细迭代消除视觉冗余作为基础的视觉语言任务,指代表达理解(referring expression comprehension, REC)根据自然语言描述来定位图中被指代的目标。REC 模型通常由三部分组成:视觉编码器、文本编码器和跨模态交互,分别用于提取视觉特征、文本特征和跨模态特征特征交互与增强。

作为基础的视觉语言任务,指代表达理解(referring expression comprehension, REC)根据自然语言描述来定位图中被指代的目标。REC 模型通常由三部分组成:视觉编码器、文本编码器和跨模态交互,分别用于提取视觉特征、文本特征和跨模态特征特征交互与增强。

在过去的几年中,大型语言模型(Large Language Models, LLMs)在自然语言处理(NLP)领域取得了突破性的进展。这些模型不仅能够理解复杂的语境,还能够生成连贯且逻辑严谨的文本。

没有算法没有实验,从2610篇收录论文中脱颖而出,成为唯一一篇纯理论入选2024 ICML Spotlight的论文。

寻隐(英文名 Queryable)是一款 iOS 上的 AI 照片搜索软件,支持用户使用自然语言搜索本地照片。软件诞生的契机是 OpenAI 发布的 CLIP 模型。

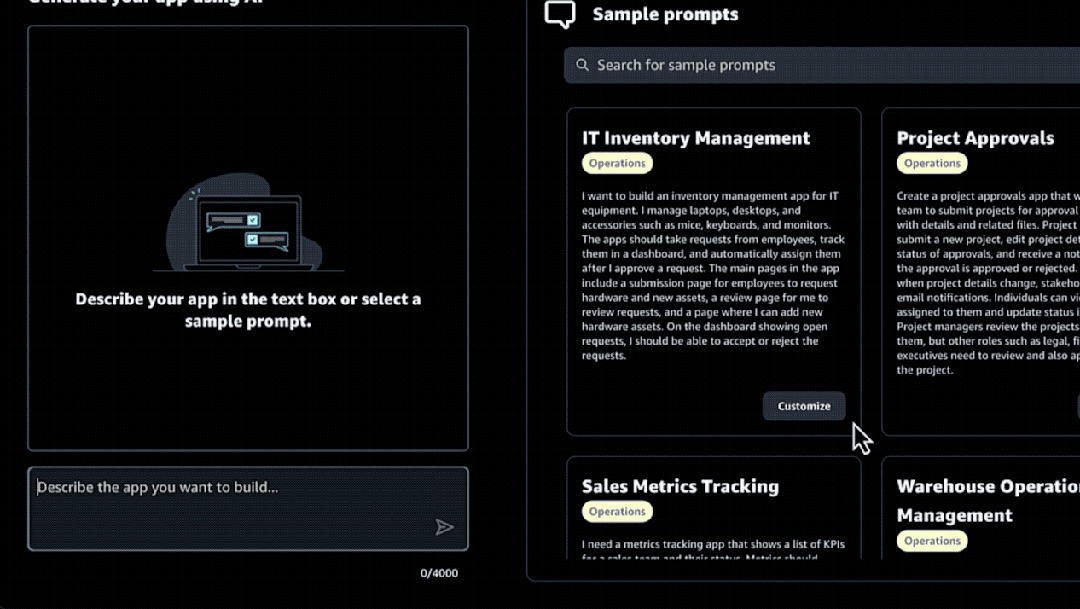

现在开发一个APP需要多久? “云计算一哥”亚马逊云科技,深夜给出了一个新标准—— 只需三步,几分钟,纯靠自然语言和鼠标“点点点”即可。

人工智能(AI)在过去十年里取得了长足进步,特别是在自然语言处理和计算机视觉领域。然而,如何提升 AI 的认知能力和推理能力,仍然是一个巨大的挑战。

本文作者肖镇中是德国马克思普朗克-智能系统研究所和图宾根大学的博士生

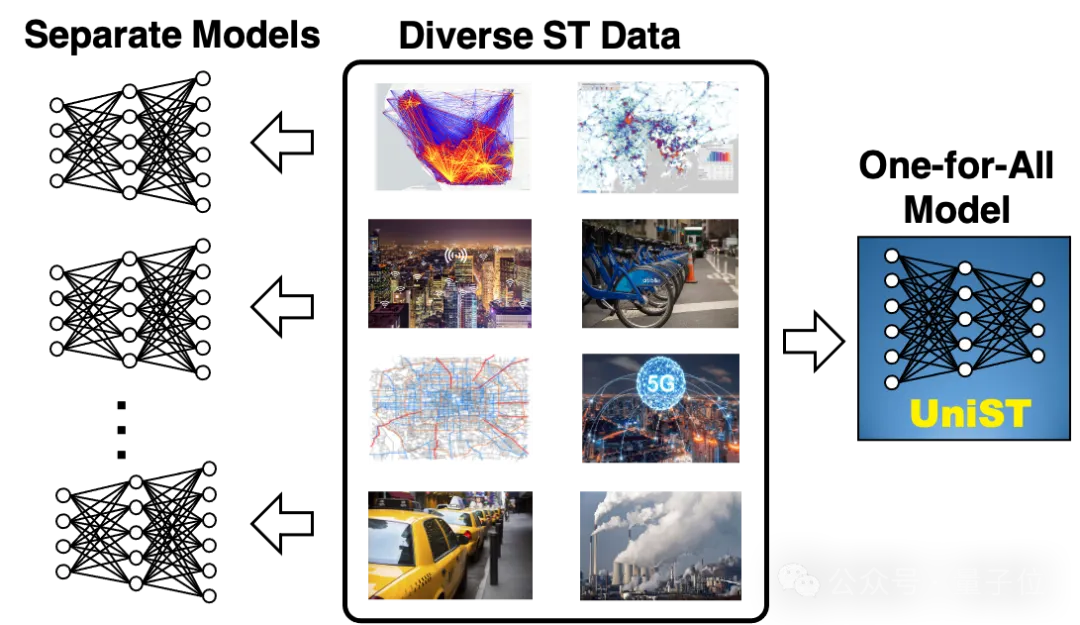

城市时空的预测,迎来GPT时刻。 清华大学电子系城市科学与计算研究中心推出了第一个无需自然语言的纯时空通用模型——UniST,首次展示了纯时空模型本身的通用性和可扩展性,研究成果已被KDD2024接收。

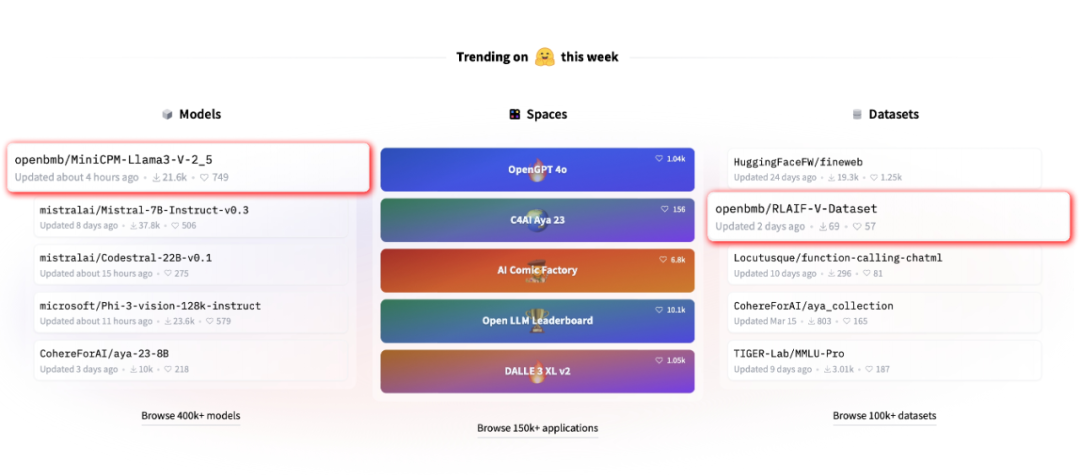

近期,由清华大学自然语言处理实验室联合面壁智能推出的全新开源多模态大模型 MiniCPM-Llama3-V 2.5 引起了广泛关注

研究人员提出了一种新的大型语言模型训练方法,通过一次性预测多个未来tokens来提高样本效率和模型性能,在代码和自然语言生成任务上均表现出显著优势,且不会增加训练时间,推理速度还能提升至三倍。