首个Qwen3.6开源模型来了!编程视觉双提升,还兼容OpenClaw

首个Qwen3.6开源模型来了!编程视觉双提升,还兼容OpenClaw3B激活参数,视觉能力直逼Claude Sonnet 4.5。

搜索

搜索

3B激活参数,视觉能力直逼Claude Sonnet 4.5。

伴随多模态大模型的发展,GUI Agent正成为人机交互的新范式。

me stepping down. bye my beloved qwen.(我将卸任。再见了,我深爱的 qwen。) 3 月 4 日凌晨,阿里通义千问(Qwen)技术负责人林俊旸在 X 突然发文,向自己一手带大的开源模型项目告别。

昨天深夜,阿里通义千问团队在 X 平台正式发布了 Qwen3.5 小模型系列,覆盖 0.8B、2B、4B 和 9B 四个参数规格。甫一发布,便在海外科技圈引发强烈反响。马斯克也在该推文下评论称:「Impressive intelligence density」(令人印象深刻的智能密度)。这股热度的背后,APPSO 也好奇,为什么这几款小模型能够激起如此大的波澜?

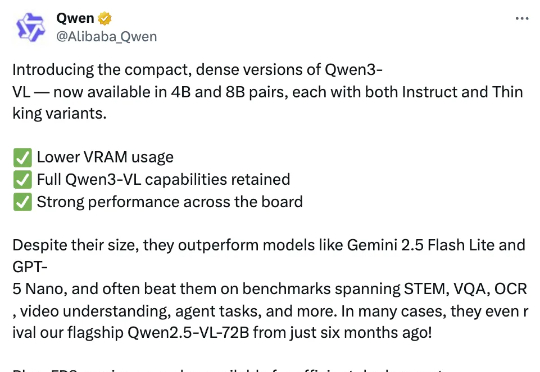

智东西10月15日报道,今日,阿里通义千问团队推出其最强视觉语言模型系列Qwen3-VL的4B与8B版本,两个尺寸均提供Instruct与Thinking版本,在几十项权威基准测评中超越Gemini 2.5 Flash Lite、GPT-5 Nano等同级别顶尖模型。

昨天,阿里通义千问大语言模型负责人林俊旸在社交媒体上官宣,他们在 Qwen 内部组建了一个小型机器人、具身智能团队,同时表示「多模态基础模型正转变为基础智能体,这些智能体可以利用工具和记忆通过强化学习进行长程推理,它们绝对应该从虚拟世界走向物理世界」。

据“互联网八卦小喇叭”等媒体爆料,全球顶尖AI科学家、IEEE Fellow许主洪(Steven Hoi)已加盟阿里通义,转向通义大模型的相关研发工作。许主洪拥有超20年AI产业和学术经验,是新加坡管理大学终身教授、曾任新加坡南洋理工大学终身副教授,在AI领域发表了300多篇顶级学术论文,

深夜,阿里通义大模型团队连放三个大招:开源原生全模态大模型Qwen3-Omni、语音生成模型Qwen3-TTS、图像编辑模型Qwen-Image-Edit-2509更新。Qwen3-Omni能无缝处理文本、图像、音频和视频等多种输入形式,并通过实时流式响应同时生成文本与自然语音输出。

通义DeepResearch团队 投稿 量子位 | 公众号 QbitAI 阿里开源旗下首个深度研究Agent模型通义DeepResearch! 相比于基于基础模型的ReAct Agent和闭源Deep

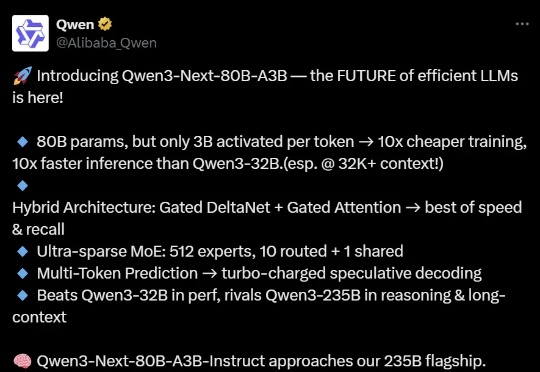

训练、推理性价比创新高。 大语言模型(LLM),正在进入 Next Level。 周五凌晨,阿里通义团队正式发布、开源了下一代基础模型架构 Qwen3-Next。总参数 80B 的模型仅激活 3B ,性能就可媲美千问 3 旗舰版 235B 模型,也超越了 Gemini-2.5-Flash-Thinking,实现了模型计算效率的重大突破。