UltraRAG 3.0 发布:拒绝“盲盒”开发,让每一行推理逻辑都清晰可见

UltraRAG 3.0 发布:拒绝“盲盒”开发,让每一行推理逻辑都清晰可见今天,清华大学 THUNLP 实验室、东北大学 NEUIR 实验室、OpenBMB 、面壁智能与 AI9Stars 联合发布 UltraRAG 3.0 ,针对上述痛点,为科研工作者与开发者打造更懂开发者的技术框架,具备 3 大核心优势:

搜索

搜索

今天,清华大学 THUNLP 实验室、东北大学 NEUIR 实验室、OpenBMB 、面壁智能与 AI9Stars 联合发布 UltraRAG 3.0 ,针对上述痛点,为科研工作者与开发者打造更懂开发者的技术框架,具备 3 大核心优势:

近日,liko.ai 宣布完成首轮融资,由商汤国香资本、东方富海、讯飞创投、洪泰基金、正轩投资、面壁智能等多家产业及财务投资机构联合投资,光源资本担任孵化方及独家财务顾问。本轮融资将用于端侧视觉语言模型、AI 原生硬件以及家庭多模态通用终端研发。

面壁智能近期已完成新一轮融资。本轮融资由北京市属国有投资平台“京国瑞”(北京京国瑞股权投资基金管理有限公司)及市场化创投基金“米聚和基”等共同参与,数亿元资金将主要用于加大端侧大模型研发力度及推动商业化进程。

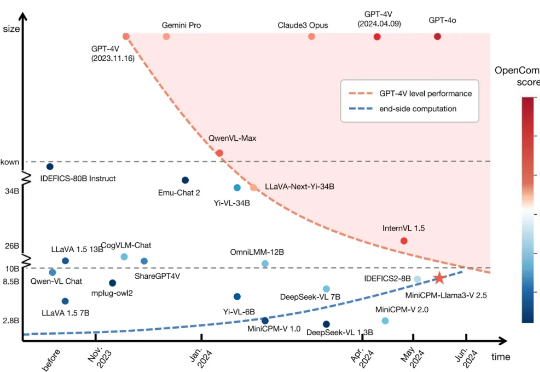

当科技巨头们终于调转庞大的船头,驶向这片“新大陆”时,他们发现,早已有人在这里深耕。面壁智能(ModelBest)就是其中最坚定的先行者之一。早在“端侧AI”成为巨头们发布会上的热词之前,这支团队就已笃定云端API路线的局限,并确立了以提升“知识密度”为核心,在端侧“以小博大”的独特技术路径。

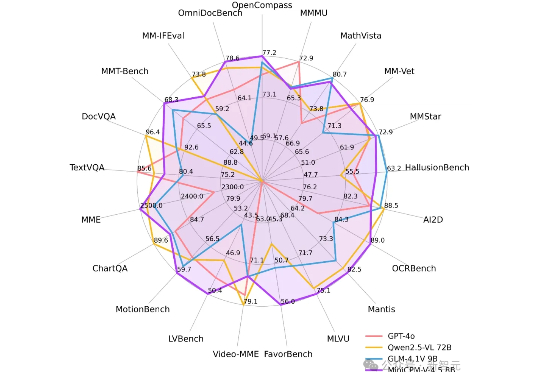

刚刚,面壁智能再放大招——MiniCPM-V 4.5多模态端侧模型横空出世:8B参数,越级反超72B巨无霸,图片、视频、OCR同级全线SOTA!不仅跑得快、看得清,还能真正落地到车机、机器人等。这一次,它不只是升级,而是刷新了端侧AI的高度。

今天,我们正式开源 8B 参数的面壁小钢炮 MiniCPM-V 4.5 多模态旗舰模型,成为行业首个具备“高刷”视频理解能力的多模态模型,看得准、看得快,看得长!高刷视频理解、长视频理解、OCR、文档解析能力同级 SOTA,且性能超过 Qwen2.5-VL 72B,堪称最强端侧多模态模型。

7 月 1 日,国际顶级学术期刊《Nature》旗下子刊《Nature Communications》正式刊登了来自清华、面壁等研究团队联合研发的高效端侧多模态大模型MiniCPM-V 核心研究成果。

有史以来最具想象力的小钢炮系列,MiniCPM 4.0 来了!

专注于端侧大模型研发的中国AI初创企业面壁智能完成新一轮数亿元融资,本轮融资由洪泰基金、国中资本、清控金信和茅台基金联合投资。本轮融资的完成,将进一步为面壁智能构筑高效大模型技术、产品壁垒、加速行业赋能与生态拓展奠定坚实基础,协同产业上下游推动「端侧大脑」在千行百业规模化应用。

未来物理世界要实现AGI,一定是通过端侧智能。