近年来,视觉-语言-动作模型(Vision-Language-Action, VLA)在诸多机器人任务上取得了显著的进展,但它们仍面临一些关键问题,例如由于仅依赖从成功的执行轨迹中进行行为克隆,导致对新任务的泛化能力较差。

此外,这些模型通常通过微调来复制在不同环境下由专家收集的演示数据,这导致了分布偏差,并限制了它们对多样化操作目标(如效率、安全性和任务完成)的适应能力。

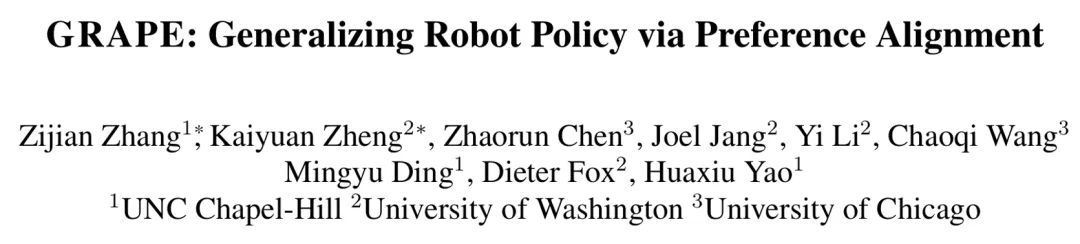

为了解决这一问题,我们提出了 GRAPE,一种即插即用的算法,通过偏好对齐提升机器人策略的泛化能力,并支持将 VLA 模型对齐到任意设定的目标。GRAPE 的框架如下图所示:

图 1:GRAPE 的框架

GRAPE 带来了以下三大优势,显著增强了 VLA 模型的泛化性:

具体而言,GRAPE 的框架可以被拆成三个部分:Trajectory-wise Preference Optimization、Customized Preference Synthesis 和 Iterative Online Alignment。以下是这三个部分的详细介绍:

Trajectory-wise Preference Optimization(轨迹级偏好优化):

GRAPE 将逐步训练的 VLA 模型扩展到轨迹级别,并通过强化学习(RL)目标进行训练,确保对齐后的策略能够优先选择被接受的轨迹,而非被拒绝的轨迹。

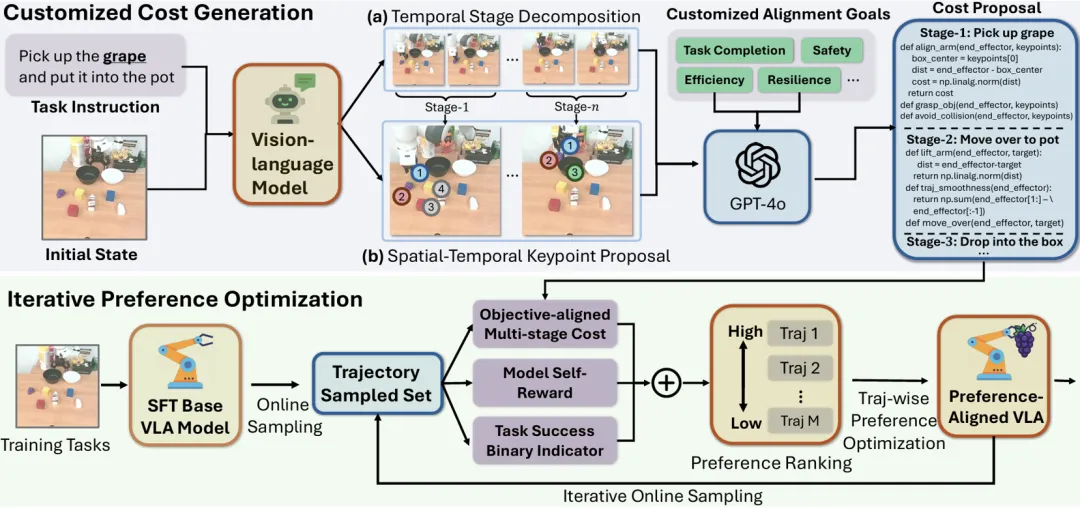

具体而言,我们基于 DPO 的 Loss 函数进行了改进,引入了一种全新的 TPO_Loss,使得模型能够学习轨迹级别的偏好。我们利用模型在任务中采集的较优与较劣的尝试(分别计为 ζ_w,ζ_l),建立了 TPO 偏好数据集,最终使得模型在 TPO 训练后在全局层面获得了对齐,并增强了其鲁棒性。

图 2 TPO-Loss 公式

Customized Preference Synthesis(定制化偏好合成):

基于 TPO-Loss 的设计,我们需要对于轨迹的优劣进行建模,从而构建对应的偏好数据集。然而,对于一些复杂的机器人任务,并没有能够用于轨迹排序的奖励模型。

针对这个问题,GRAPE 引入了一种可扩展算法,将复杂操作任务分解为独立阶段,并通过一个大型视觉-语言模型提出的关键点,自动引导偏好建模过程中的时空约束。这些约束具有灵活性,可根据需求进行定制,使模型与不同目标(如安全性、效率或任务完成)保持一致。

Iterative Online Alignment(迭代式在线对齐):

GRAPE 通过以下迭代循环不断优化对齐过程:1)在线样本采集,2)合成偏好排序,3)轨迹级偏好优化。这种方法逐步提升了 VLA 策略的泛化能力,并使其与任意目标更好地对齐。

真机泛化实验

我们在域内任务以及五种分布外泛化(OOD)任务上评估了 GRAPE 的性能,这些 OOD 任务包括:视觉(新的视觉环境)、主体(未见过的物体)、动作(未见过的操作)、语义(未见过的提示)和语言落地泛化(物体处于未见过的空间位置)。

结果显示,GRAPE 在这些 OOD 任务上的表现分别比最先进的 OpenVLA-SFT 模型提升了 20.7%、27.5%、10.0%、5.0% 和 26.7%。这充分体现了通过偏好对齐过程所实现的卓越泛化能力。

仿真泛化实验

我们进一步在 Simpler-Env 和 LIBERO 环境中评估了 GRAPE 的性能,重点考察三种 OOD 任务的泛化能力:主体(未见过的物体)、物理属性(未见过的物体尺寸 / 形状)和语义(未见过的提示)。

结果显示,GRAPE 在这些 OOD 任务上相较 OpenVLA-SFT 模型分别提升了 8.0%、12.3% 和 19.0% 的表现。

图 3:真机与仿真实验统计结果

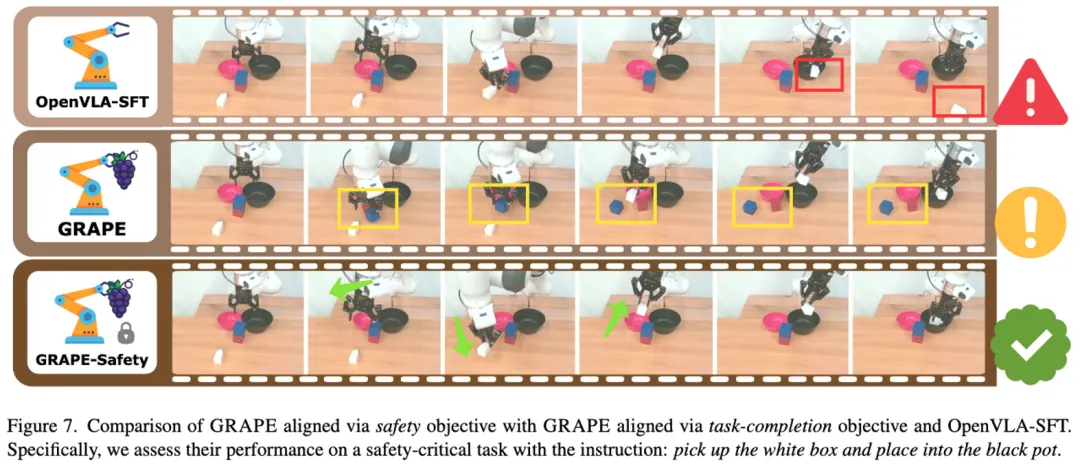

特定对齐目标分析

GRAPE 能够高效地将机器人策略与通过自然语言指定的多种目标对齐,例如任务完成、安全性和效率。这些目标被融入多阶段的成本函数中,进而影响采样轨迹的排序。

实验表明,当对齐目标为更安全或更高效的操作策略时,GRAPE 可将碰撞率降低 44.31%,或将执行轨迹的长度缩短 11.15%。

图4:指定的对齐目标(安全),训练后的模型学会了安全地执行操作

本文提出了 GRAPE,一种即插即用的 VLA 模型对齐框架,在多种机器人任务场景下均能使用,能够基于轨迹偏好提升机器人策略的泛化能力,并支持将模型对齐到指定目标。

文章来自于“机器之心”,作者“张子健、Mingyu Ding、 Joel Jang、Yi Li 、Dieter Fox、Zhaorun Chen、Chaoqi Wang”。

【免费】cursor-auto-free是一个能够让你无限免费使用cursor的项目。该项目通过cloudflare进行托管实现,请参考教程进行配置。

视频教程:https://www.bilibili.com/video/BV1WTKge6E7u/

项目地址:https://github.com/chengazhen/cursor-auto-free?tab=readme-ov-file

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner