大型语言模型(LLM)本身很强大,但知识是静态的,有时会“胡说八道”。为了解决这个问题,我们可以让它去外部知识库(比如维基百科、搜索引擎)里“检索”信息,这就是所谓的“检索增强生成”(RAG)。但这还不够,更高级的方法是让 LLM 变成一个能自主决策的“智能体”(Agent),它能自己决定“何时搜、搜什么、怎么搜、如何利用搜索结果”,这个过程就叫做“智能体搜索”(Agentic Search)。而要让这个智能体变得更聪明、更自适应,最好的方法之一就是用“强化学习”(RL)来训练它。

强化学习(RL)正好提供了“和环境交互—拿反馈—改策略”的自适应机制,于是本文写成首篇专门聚焦“基于RL的代理式搜索”的系统综述,来自宾夕法尼亚州立大学的研究者们用三条主轴组织全篇:What RL is for(RL在干什么)、How RL is used(RL怎么用)、Where RL is applied(RL用在何处),再配套评测与应用、开放挑战与展望。带您一文读懂RL如何赋能智能体搜索,从基础原理到评测与应用的全景脉络。

信息检索技术的发展其实是一条不断提升“智能化”水平的道路,理解这条路能帮我们看清当前的位置。最早的传统信息检索(IR),比如经典的BM25算法,就像一个图书馆的“图书目录”,您输入关键词,它给您返回一堆可能相关的书,但具体哪本、哪一页有用,得您自己判断。后来,检索增强生成(RAG)出现了,它更像一位“图书管理员”,您提出问题,它不仅帮您找到相关的书,还会翻到具体的某一页,把内容直接递给您,这大大提升了答案的准确性,但它的工作方式依旧是被动的。

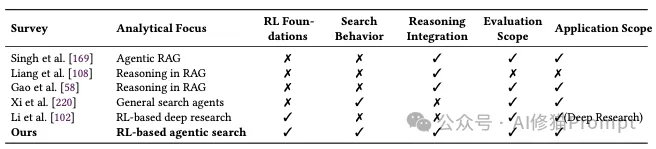

代表性综述与这篇工作的比较。✓表示该主题是主要关注点;✗表示有限或未涵盖

当面对一个真正复杂的问题时,比如“分析一下最近AI芯片市场的竞争格局和未来趋势”,一次搜索是远远不够的。这时候就需要“智能体搜索”登场了,它扮演的是一个“智能研究员”的角色。它会先思考,把大问题拆解成“目前主流的AI芯片有哪些?”、“英伟达、AMD、谷歌的最新产品是什么?”、“市场份额和财报数据如何?”等一系列子问题,然后主动去搜索、阅读、整合信息,甚至在发现信息冲突或不足时,会主动调整搜索策略,再进行新一轮的探索,直到形成一份全面、可靠的报告。这篇论文告诉我们,强化学习正是训练出这种高级“研究员”的关键技术。

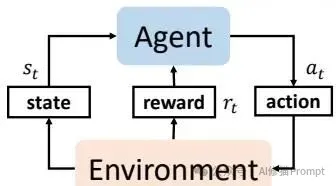

那么,强化学习(RL)究竟是如何训练智能体的呢?您可以把它想象成一个“教练与运动员”的模型。LLM智能体是“运动员”,搜索引擎、数据库等外部工具是它训练的“场地”(环境),智能体的每一个搜索或推理行为都是一个“动作”。当智能体完成一次任务后,“教练”(奖励函数)会根据最终答案的质量(比如准确率、事实一致性)和过程的效率(比如搜索次数、API调用成本)给出一个“分数”(奖励或惩罚)。

强化学习的核心组件。智能体(Agent)在特定状态(State)下执行一个动作(Action),环境(Environment)会反馈一个奖励(Reward)并进入下一个状态,智能体根据这个循环来学习最优策略。

这个“分数”就是驱动智能体学习的核心信号。通过最大化累积奖励,智能体能逐渐学会,哪些动作序列能带来高分,哪些是无效的“瞎忙活”。研究者们在这篇论文中总结了当前最主流的几种训练算法,比如PPO(近端策略优化)、GRPO(组相对策略优化)和DPO(直接偏好优化),它们各有侧重:PPO像一位经验丰富的老教练,稳定但需要额外的“陪练”(价值网络);GRPO则更轻量,通过让一组“克隆运动员”内部比较来学习,节省了资源;而DPO则另辟蹊径,直接学习“好动作”与“坏动作”之间的偏好差异,过程更简单直接。

您可能会问,RL具体能优化智能体搜索的哪些环节?研究者们将其归纳为五大核心角色,这远比简单地“触发一次搜索”要丰富得多,它贯穿了从理解问题到最终回答的全过程。

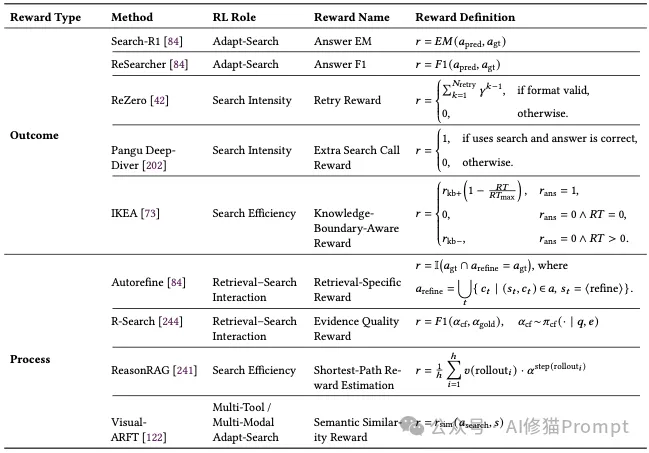

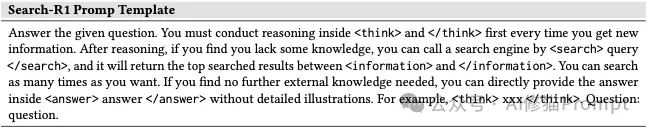

了解了RL能做什么之后,接下来的问题就是具体该怎么操作,这直接关系到您如何将这些理念落地到产品开发中。研究者们从训练范式和奖励设计两个方面给出了清晰的路线图,这对于您在实际开发中非常有指导意义。

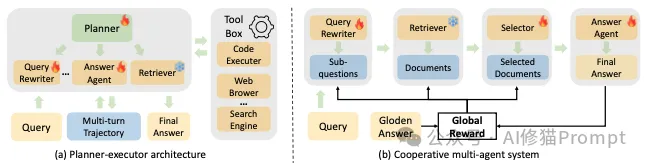

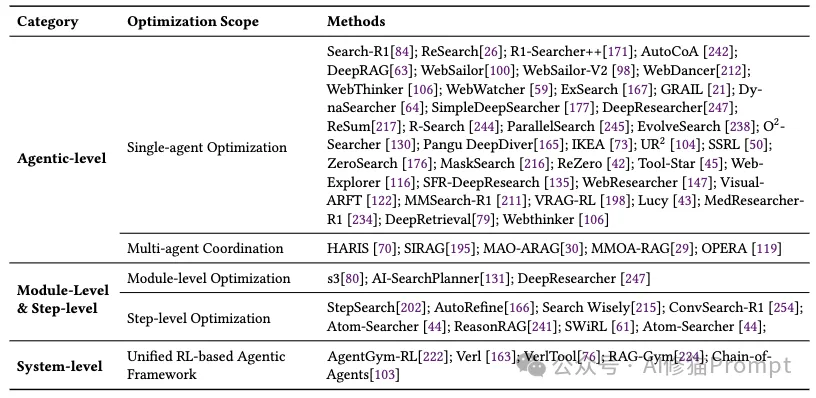

在系统架构中,RL的应用范围也相当灵活,您可以根据产品的复杂度和优化目标,选择在不同层次上应用RL。研究者们将其划分为三个层次,从宏观到微观,层层递进。

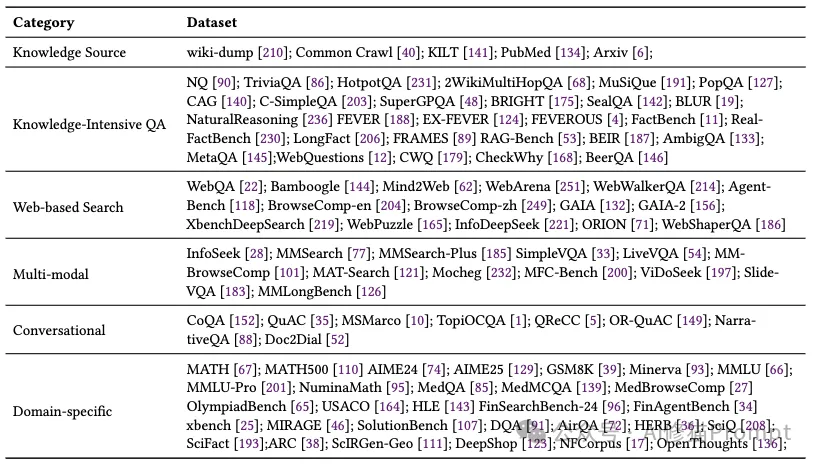

当然,一个技术好不好,最终要看它的实际效果和应用前景。研究者们在论文中系统地梳理了用于评估智能体搜索的“考场”(数据集)和“评分标准”(评估指标),以及它已经大放异彩的“应用领域”,这能帮助您更全面地衡量和定位自己的产品。

NQ、HotpotQA),模拟真实网页环境的搜索任务(如WebQA、GAIA),需要结合图文信息的“多模态搜索”,模拟用户连续提问的“对话式搜索”,以及面向数学、医疗、科学等特定领域的专业基准。这些多样化的“考场”确保了智能体不仅要会“开卷考试”,还要能应对各种复杂、动态的真实场景。EM、F1分数、ROUGE),新的评估体系更关注过程。例如,“搜索效果”指标(如精确率、召回率)衡量找到的信息是否相关;“搜索效率”指标(如查询次数、API成本)评估智能体是否“经济实惠”;而“过程质量”指标(如每一步搜索带来的“信息增益”、对证据的“利用率”)则深入考察其思考过程的合理性。不过,挑战依然存在。如何让智能体在处理文本、图像、音频等多种信息的“多模态搜索”中保持逻辑一致?如何为需要跨越数天甚至数周的“长时程研究任务”设计有效的记忆机制?以及,如何确保智能体在开放网络环境中不被恶意信息误导,保证其行为的“可信赖性”?这些都是亟待今后去探索和解决的课题。

您可能会特别好奇,在这么多挑战中,研究者们是否强调了某一个特定的方向?答案是肯定的,而且非常明确。在这篇论文的未来挑战部分,研究者们将“多模态智能体搜索”(Multi-modal Agentic Search)放在了首要位置,认为这是该领域走向成熟、解决真实世界问题的关键瓶颈。于这方向近期的热点,您可以看下DeepSeek最新开源的DeepSeek-OCR:

《AI的光学时刻来了,DeepSeek-OCR运行3B参数,仅6.2G,完美!》

论文专门开辟了一个小节来介绍多模态搜索的应用。其中提到了像 VRAG-RL(用于理解富含视觉信息的文档)、Visual-ARFT 和 WebWatcher(结合网页搜索和视觉分析)等前沿工作。这说明多模态搜索已经不是一个纯理论概念,而是有了切实的落地应用和研究方向。

这篇综述论文为我们描绘了一幅清晰的蓝图:通过强化学习,我们可以将LLM从一个被动的知识检索工具,转变为一个能够主动规划、探索和学习的智能体。它不再是简单地执行“检索-生成”的线性流程,而是在一个动态的决策循环中,不断优化自己的信息获取与问题解决能力。研究者在最后的小结中特别强调:真正可用的系统离不开“面向场景的适配、多模态能力、资源效率管理”。

文章来自于微信公众号“AI修猫Prompt”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】FASTGPT是基于LLM的知识库开源项目,提供开箱即用的数据处理、模型调用等能力。整体功能和“Dify”“RAGFlow”项目类似。很多接入微信,飞书的AI项目都基于该项目二次开发。

项目地址:https://github.com/labring/FastGPT

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】MindSearch是一个模仿人类思考方式的AI搜索引擎框架,其性能可与 Perplexity和ChatGPT-Web相媲美。

项目地址:https://github.com/InternLM/MindSearch

在线使用:https://mindsearch.openxlab.org.cn/

【开源免费】Morphic是一个由AI驱动的搜索引擎。该项目开源免费,搜索结果包含文本,图片,视频等各种AI搜索所需要的必备功能。相对于其他开源AI搜索项目,测试搜索结果最好。

项目地址:https://github.com/miurla/morphic/tree/main

在线使用:https://www.morphic.sh/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0