能无限进步的「超级智能体」来了!

最近,Meta研究团队的一篇题为HYPERAGENTS(超级智能体)的论文迅速刷屏。

这篇论文将LSTM之父Jürgen Schmidhuber二十年前提出的哥德尔机(Gödel Machine)思想,与达尔文开放算法相结合,提出了能持续自我迭代的达尔文哥德尔机。

基于此这一思想,Agent不仅能更好地完成具体任务、持续提高自身表现。

更关键的是,它可以不断优化“改进自身”的底层逻辑,实现“元学习(Meta-learning)”

这,便是论文定义的新一代超级智能体——Hyperagents。

论文更进一步提出:未来AI有望通过持续自我迭代,最终突破人类预设的初始算法边界,也正因如此,AI安全必须被摆在核心位置。

不少网友也感慨道:

元学习真正让人既害怕又兴奋的,是元层面的改进能够跨领域迁移。这不是在某一件事上变得更厉害,而是学会了在一切事情上变得更厉害。

目前,这篇论文已被ICLR 2026接收。

要理解超级智能体Hyperagents,必须先了解它的基石——

哥德尔机(Gödel Machine)。

哥德尔机是一种假设性的自我完善型AI。它在数学上寻求证明:

如果存在某种更好的策略,它会通过递归重写自身代码来解决问题。

而这一假设,最早由尤尔根·施密德胡伯(Jürgen Schmidhuber)在二十多年前提出。

在传统机器学习中,AI的“学习方法”是人类预设的硬编码,它只能通过调整内部参数来逼近目标;

而哥德尔机则打破了这一限制,它能够将算法框架本身视为可编辑的代码,通过自主重写程序来实现学习能力的自我演进。

但问题也随之而来:哥德尔机往往要求AI在自我演进之前,证明该改动具备净收益。

也就是说,改代码花掉的算力成本,未来能不能通过更强的性能赚回来?

不幸的是,这种计算在现实中的复杂任务中几乎是无法实现的。

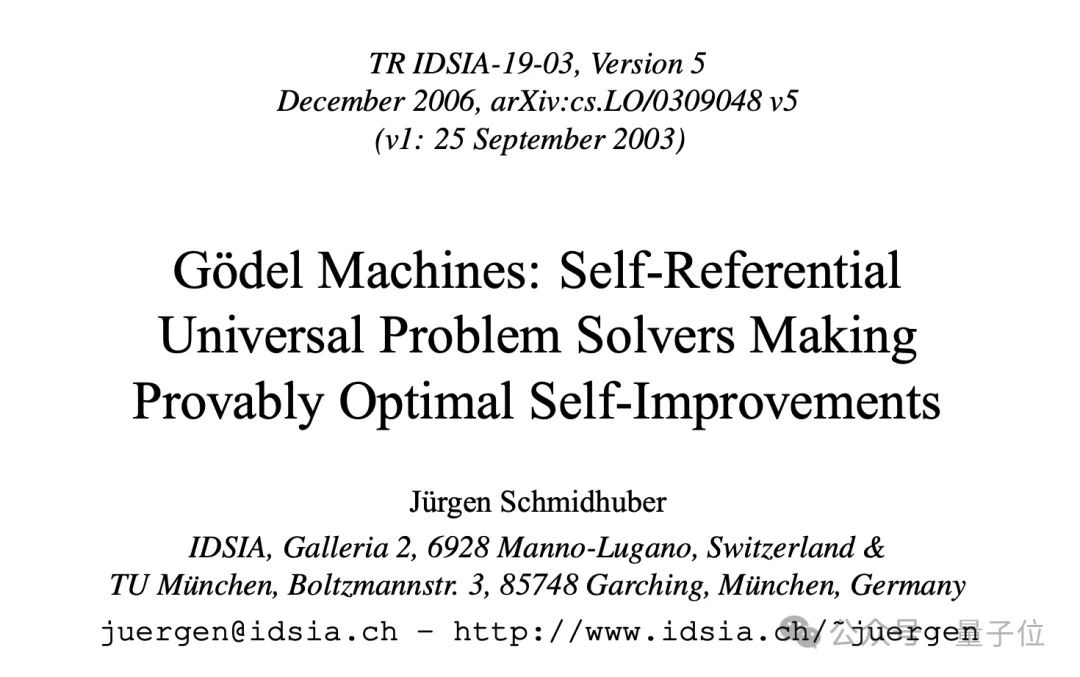

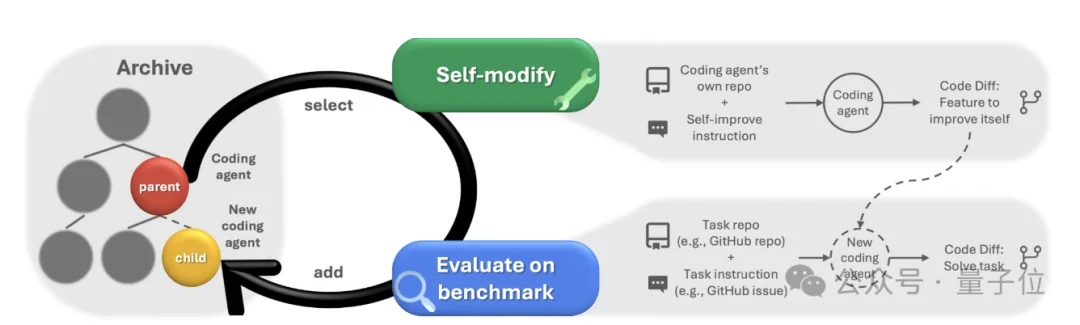

针对这一问题,Meta团队提出达尔文哥德尔机(DGM),它利用开放式算法(Open-ended algorithms),通过在大模型提议的代码改进方案中进行搜索,获取能从经验上提升性能的方案。

换句话说,DGM利用基础模型来提议代码改进方案,并利用开放式算法的最新创新成果,来搜索并构建一个不断增长的、多样化且高质量的AI智能体库。

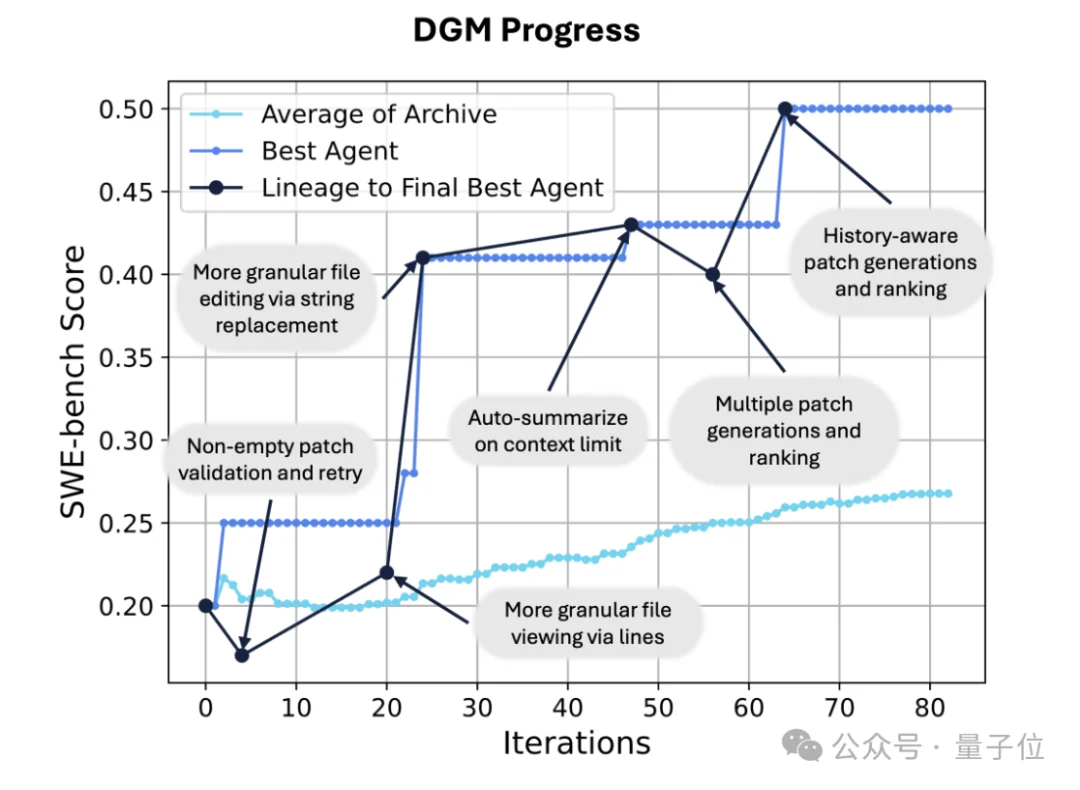

基于此,DGM能创造出各种自我改进方案,例如:增加补丁验证(Patch Validation)步骤、优化文件查看功能、增强编辑工具、生成并筛选多个解决方案以选出最优解,以及在进行新更改时,会自动添加历史尝试记录(并分析失败原因)以供参考。

论文的实验还表明,DGM获得的算力越多,自我提升效果越好。

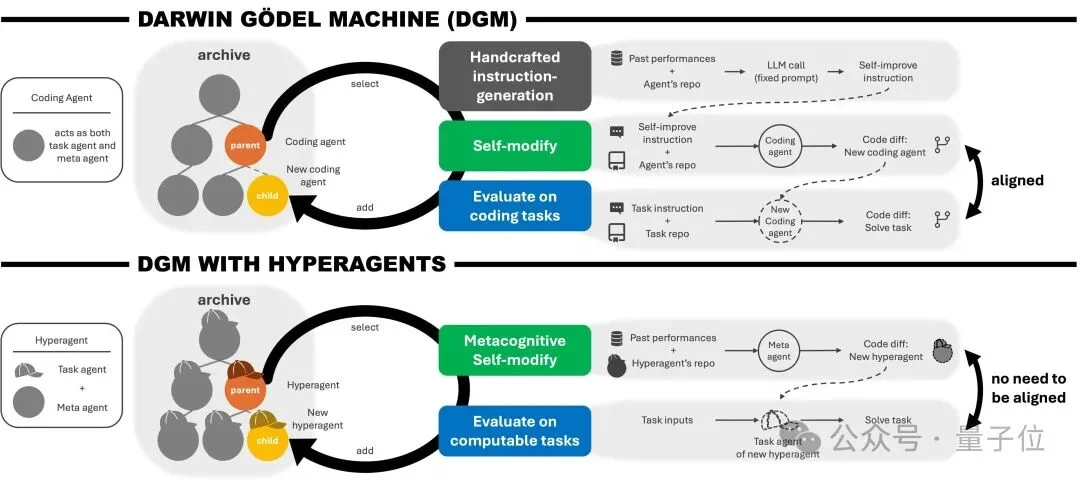

虽然DGM很强,但它存在一个致命限制:它主要在编程任务中有效。

这是因为DGM依赖一个关键假设——评估任务与自我修改任务必须“对齐”。

在编程领域,这种对齐是天然的:提升了编程能力,自然也就提升了修改自身代码的能力。

也就是说,解决外部编程问题的逻辑工具,可以直接转化为修改其自身底层代码的能力。

相反,如果是在非编程领域(如写诗),即便提升了写诗能力,也无法直接转化为修改代码的逻辑水平。

在这种缺乏“自指性(Self-referentiality)”的任务中,DGM的递归进化链条就会断裂,陷入停滞。

基于此,文章提出超级智能体——

它们既能修改自己的任务执行行为,也能修改生成未来改进建议的过程。

这实现了所谓的元认知自我修改(metacognitive self-modification):不仅学习如何做得更好,还学习如何更有效地进行改进。

进一步,论文将超级智能体实例化为DGM-Hyperagents (DGM-H)。

DGM-H是对DGM的扩展,其中任务解决行为和自我改进程序都是可编辑且可进化的,其框架如下:

打个比方,在Hyperagents中,运动员不仅在训练,教练也在学习如何更好地执教。由此,运动员的表现和教练的执教水平不断螺旋上升。

此外,DGM-H还改进了生成新智能体的过程(例如引入持久化记忆、性能追踪等),且这些元级改进具有跨领域迁移和跨运行累积的特性。

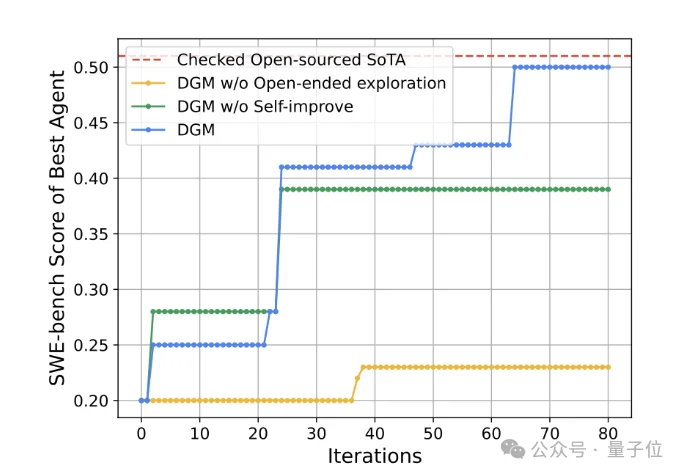

实验证明,达尔文哥德尔机(Darwin Gödel Machine)能够通过修改自身代码库实现持续的自我提升。

在SWE-bench上,DGM自动将其性能从20.0%提升至50.0%。

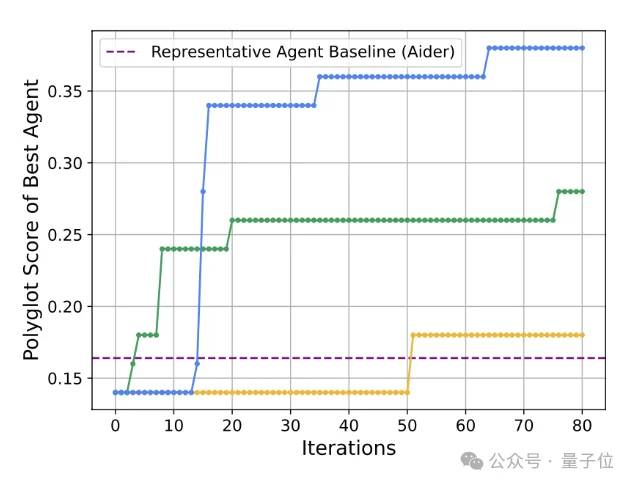

在Polyglot上,DGM的性能从初始的14.2%跃升至30.7%,远超由Aider开发的具有代表性的人工设计智能体。

这些结果证明了DGM能发现并实施有效的自我改进。

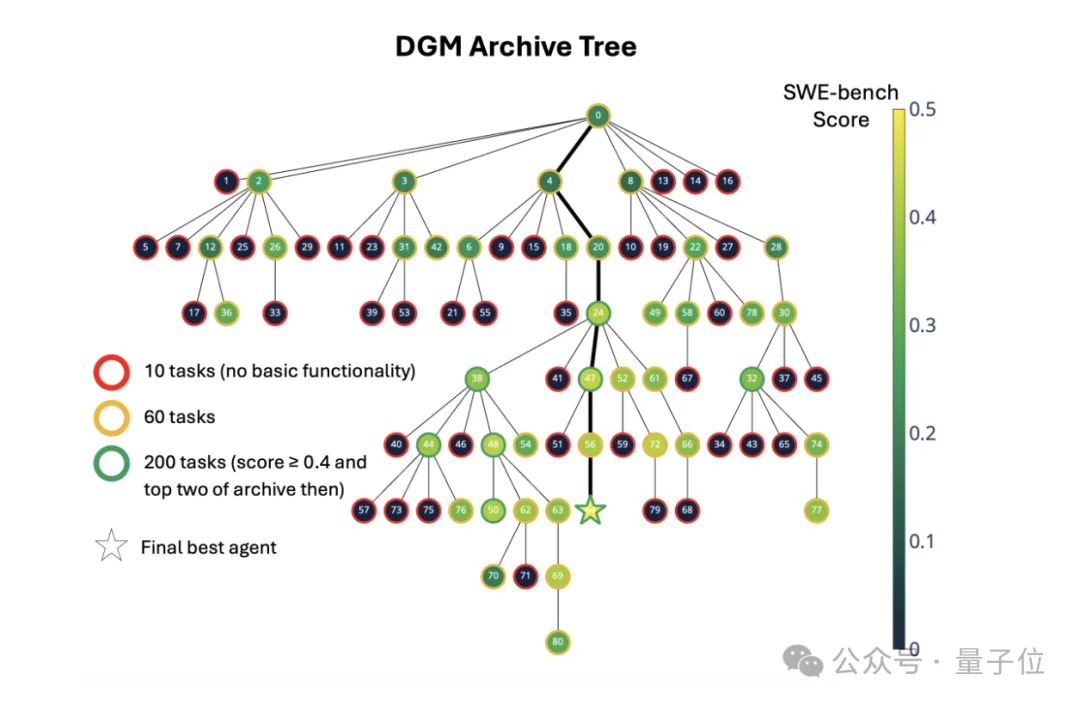

而实现这一点的关键在于其开放式进化搜索策略:

通过从现有智能体库中采样生成新智能体,DGM能够并行探索多条进化路径。

性能稍逊的“祖先”智能体在发现新方法和功能方面起关键作用,避免了早熟收敛。

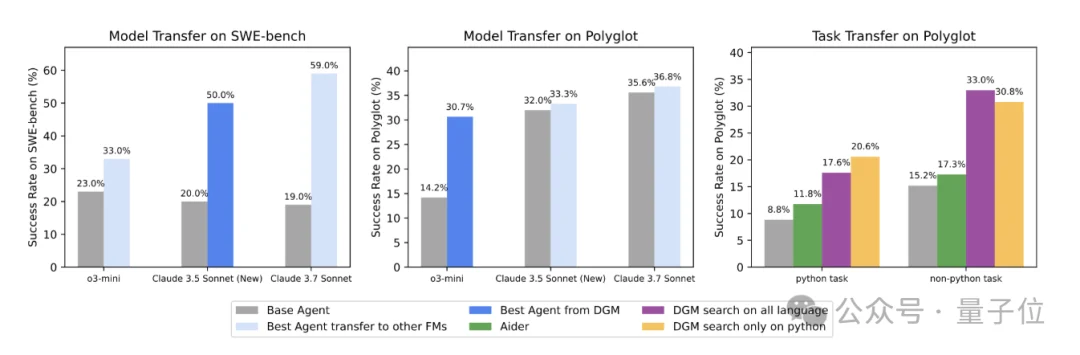

此外,DGM的改进具有广泛的迁移性:

最后,让我们来介绍一下这篇论文的作者们。

这篇论文的第一作者是来自UBC的Jenny Zhang,她师从Jeff Clune教授。

△ 图源:Jenny Zhang推特主页

她本科就读于帝国理工,这篇论文是她在Meta实习期间完成的。她的研究方向专注于强化学习、自改进AI与Open-Ended AI。

Bingchen Zhao是来自爱丁堡大学的博士生,,师从Oisin Mac Aodha教授

他本科毕业于同济大学,他此前在Meta FAIR团队,致力于构建自我改进的AI系统。

△ 图源:Bingchen Zhao谷歌学术主页

Wannan Yang在纽约大学攻读博士,目前在Meta超级智能实验室实习,她本科毕业于爱丁堡大学。

△ 图源:Wannan Yang个人主页

论文的其他作者还包括Jeff Clune、以及来自Meta的研究员Minqi Jiang(已离职)、Sam Devlin和Tatiana Shavrina。

参考链接

[1]https://arxiv.org/pdf/2603.19461

[2]https://sakana.ai/dgm/

[3]https://x.com/jennyzhangzt

文章来自于“量子位”,作者 “henry”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】DeepBI是一款AI原生的数据分析平台。DeepBI充分利用大语言模型的能力来探索、查询、可视化和共享来自任何数据源的数据。用户可以使用DeepBI洞察数据并做出数据驱动的决策。

项目地址:https://github.com/DeepInsight-AI/DeepBI?tab=readme-ov-file

本地安装:https://www.deepbi.com/

【开源免费】airda(Air Data Agent)是面向数据分析的AI智能体,能够理解数据开发和数据分析需求、根据用户需要让数据可视化。

项目地址:https://github.com/hitsz-ids/airda

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI