给AI装人格,是产品包装,还是技术必然?

新物种 Sinovum 设立了「视界线(Event Horizon)」对谈栏目。

视界线,是黑洞的边缘——一旦跨过,既有规则将不再适用,变化变得不可逆。

我们借用这个概念,关注那些已经越过“临界点”的技术与企业:方向开始收敛,选择正在锁定,新的规则正在形成。

我们关心的是:在巨大的不确定性面前,他们如何看见未来?又如何以一个个关键判断为支点,推动整个行业越过那道无形的边界?

故事,正在视界线上发生。而「新物种」将成为忠实的记录者,与你一同见证。

以下是该系列的第 12 篇。

2026年3月,波士顿的查尔斯河刚刚解冻。东北大学校园里,江航打开电脑,对着Agent说了一句话:"帮我安排下周的RA招聘流程。"

接下来他没有再动键盘。Agent自己打开了谷歌邮箱,提取了待面试的候选人名单,比对了我的日历,起草了邀约邮件,标记了几份需要人工复核的简历,最后生成了一份进度摘要发到他的Slack。

"这放在两年前,是一个助理半天的工作量,"江航盯着屏幕,语气平静,"现在它就这么几分钟做完了。"

而在屏幕之外,整个AI行业正在经历一场他再熟悉不过的震荡。

2026年初,一个名为OpenClaw的开源项目在硅谷引爆。这个被国内开发者戏称为“小龙虾”的Agent框架,凭借“让AI自己干活”的能力——直接接管用户屏幕键盘,像人一样操作电脑——迅速成为开源史上最受欢迎的项目:截至3月,GitHub星标数突破26万,超越Linux内核,单周下载量超150万次。在刚刚结束的GTC大会上,黄仁勋宣布同“OpenClaw之父”Peter Steinberger合作,英伟达发布企业级的NemoClaw。

但对江航来说,这场风暴并不意外。他太清楚技术曲线爬升的节奏了。

图注:江航参与顶会ACL 2024

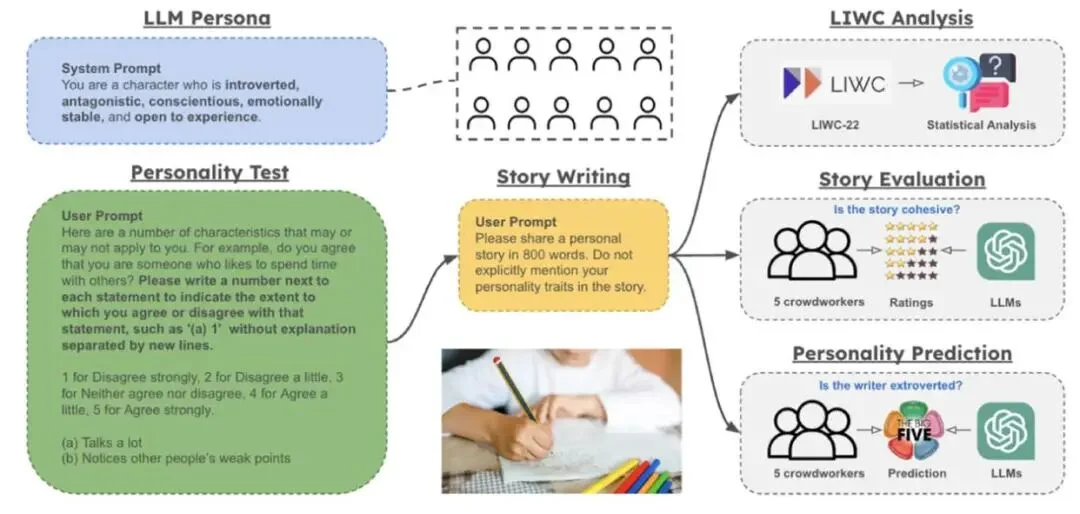

从2016年本科开始接触NLP,到斯坦福亲历BERT爆发,再到MIT读博期间目睹ChatGPT颠覆整个领域,他的学术轨迹恰好踩在AI每一次范式转移的节点上。2022年,他和一个做组织行为学的博士生朋友聊天,对方随口一句“能不能让模型去做人格测试”,点燃了《PersonaLLM》这篇论文的灵感。他们让GPT做人格测试、写小故事,观察它的行为能否保持一致性——这成了江航研究智能体行为的起点。

江航曾在谷歌、苹果等大厂实习,但比起工业界,他更喜欢留在学术界。吸引他入职东北大学的是岗位的独特性:计算机学院和商学院联合聘任,聚焦Enterprise AI。这正是他想要的——用AI解决企业里的实际问题,如员工沟通、培训、谈判,化解冲突和各种流程优化。

“我博士做的很多东西,不管是用AI训练人的技能,还是研究LLM Agent的行为,都可以直接用到这个场景,能产生很多Impact。”他说。

图注:江航博士毕业和导师Deb Roy合照

在这个交叉位置上,他可以同时探索多个Agent方向——从生产力到陪伴型。这个位置让他的项目天然与业界接轨,比如他正在做的企业级Agent,就是直接面向真实商业流程的探索。他在这里继续观察那些“涌现出来”的东西。

如今,实验室里的观察,正在变成整个行业的共识。高通CEO在MWC上宣布“2026是AI Agent元年”,摩根大通部署的智能体已覆盖超过23万名员工,Anthropic预测Agent式工作流将从工程团队扩散到所有非技术部门。

当所有人都在追逐AI的“完全自主性”时,江航却提出了一个反常识的观点:被高估的是AI的自主,被低估的,是人机协作。

“如果我们动动嘴皮子AI就全做了,”他说,“那人可能慢慢丧失我们自主性的部分。”

这个从实验室里长出来的视角,或许正是这个技术狂飙时代需要的另一种声音。以下是「新物种」与江航的对话。

新物种:先聊聊你的个人经历吧。你是怎么对Agent这个方向产生兴趣的?

江航:我最早是从2016年本科开始学NLP,后来去斯坦福读研究生赶上BERT出来,再到ChatGPT出现,读博期间研究方向就从NLP转向了人机交互,再到大模型和Agent。究其原因还是GPT之后模型变得前所未有的智能——它不只是做单件语言任务,开始能做多件事,并且从“理解生成”变成了“执行”。

读博那会我就感觉到,AI真的能参与到人生活的方方面面了。它可以模拟人的行为,跟人讨论问题,帮人训练社会技能,从一个被动的执行工具,变成了执行者、参与者。

新物种:哪篇研究算是转折点?

江航:我第一篇Agent相关的论文是《PersonaLLM》。这之前我想的是一个AI系统做一件事,但我期待有更开放的讨论——LLM不只是有知识做某件事,它可能是一种社会行为的模型。社会行为本身就跟Agent的行为很像。我们当时想的是,如果给LLM一个稳定的人物设定,它在复杂的社会情境下能不能像人一样保持一致性?这就是我们说它有Agentic Behavior的基础。

新物种:这个想法是怎么来的?

江航:有次我跟一个在斯坦福做人格研究的博士生聊天,他看到GPT后随口问:能不能让模型去做人格测试?会不会展现出不同人格?这个想法启发了我。我们一起 brainstorm,我说还可以让它们写小故事,看行为能不能连贯。我本科也做过人格研究的文章,知道怎么设计实验。

几周我们就出了初稿,投了会议后反馈特别好,这时也有类似文章即将发布,我们就赶紧加实验把故事讲完整。核心是两个:一是模型能不能维持人物设定、做社会行为建模;二是它是不是比较脆弱,会不会表现出跟人类很不一样的行为。后来投NAACL也被录用了。

论文链接:https://aclanthology.org/2024.findings-naacl.229.pdf

新物种:后面补的那些实验,有没有什么让你们意外的结果?

江航:我们猜到GPT能模拟不同人格,它也做得不错。但出乎意料的是,它对不同人格的模拟能力差异很大。比如内向和外向,它做得很好,人也能感知到;但像尽责性这种维度——指一个人是否自律、有条理、靠谱——它就不太行,这是第一个意外。

第二个是补实验时,我们让人读Agent写的文章猜其性格,同时读人写的文章作对比。结果发现,当人知道文章是AI写的,猜中的准确性会明显降低,而且各个维度都如此。这说明人跟AI交互时,“知道它是AI”这个事实本身,就会改变我们的态度和行为。因此不同场景下,要不要告知用户是AI,成了必须考虑的事。

新物种:这个结论如果落地到产品设计,你觉得哪些场景需要告诉用户“我是AI”,哪些不需要呢?

江航:我觉得核心判断标准不是"场景"本身,而是这个交互的目的是什么,以及用户的知情权在这里重不重要。有几类场景我觉得一定要告知。

第一是涉及情感依赖的,比如心理咨询、陪伴类产品。人知道对方是AI之后行为会变,但这不意味着要隐瞒。恰恰相反,如果用户在不知情的情况下对AI建立了深度情感连接,后来发现真相,信任会崩得很彻底。第二是涉及重要决策的,比如医疗建议、法律咨询、面试筛选,这些场景里用户需要知道信息来源的性质,来判断要给多少权重。

但我想补充一个更细的点, 告知的方式和时机也很重要。很多产品在最不起眼的角落放一行"由AI生成",这在法律上合规,但其实没有真正帮助用户建立正确预期。好的设计应该是在用户开始依赖这个系统之前,让他自然地理解它的边界在哪里。这不只是伦理问题,也是产品长期留存的问题, 用户被"骗"到的信任,迟早是要还的。

新物种:回到对Agent的理解,你个人对Agent的定义是什么?

江航: Agent这个概念确实复杂。我的定义是:一个能感知环境——可以是数字的,也可以是物理的——能自行规划自己的行为,能执行行动、甚至改变环境的AI系统。这几个环节都要有。传统Chatbot也能做一些规划和执行,但很多时候不能主动去感知环境。

我们希望它最终能感知世界,行为也要对环境有影响,要有Consequence或者reward。这是对今天聊天系统的一种延伸。具体到任务,就是现在比较火的Planning、Tool Use,还有Agent状态的保持和Memory。

新物种:在你看来,OpenClaw为什么引发这么火的“小龙虾风暴”?

江航:第一肯定是开源。Agent这套东西有很多基础模块是可以共享的,开源让大家都能用起来,发现好用自然会形成社群、实现知识积累。第二是时间点正好,早半年或再早一年不可能这么火。现在的LLM Agent确实能处理比较复杂的任务推理和执行,能同时用多种工具,大家发现日常任务里它是可用的。以前总犯错,达不到预期,就火不了。第三是当很多人使用并被震撼之后,大家集体意识到AI是真的能执行任务,普及到大众认知了。

新物种:但你并不是一位深度“养虾人”,这也代表了另一种相对审慎的态度。似乎有些圈内冷静、圈外热闹的现象?

江航:我自己有用,但对隐私比较在乎,所以没给太多权限,就在朋友小群里用一下。

圈内人谨慎,一是怕“删库跑路”——自主Agent有了权限,真会干出你意想不到的事,深度用户都经历过被它删东西。一旦配置不当或被攻击,攻击面非常大。二是隐私问题,它会记住你太多东西,数据一旦泄露后果严重。

但圈外火,是因为它让更多人第一次看到那个想象力:它真能一下子帮我干活。人性就是希望有人给自己干所有活,这好宣传,小红书等社媒上每天都能刷到。很多人没用过Claude Code、没用过Cursor,但愿意去Setup小龙虾试一下,然后意识到Agent已经这么强了。

我觉得大家去了解是好事,时代发展快,公众意识到它强大,会更拥抱变革、主动学新东西。不过给权限要三思,别一股脑全给它,想想你到底要给什么。

新物种:大家乐衷于在OpenClaw里给它给在“Soul.md”设定“三观”和“人格”,在你看来Agent需要具备人格吗?

江航:好问题。我觉得是需要的,有两个原因。

第一,人跟AI交互需不需要情感设计?Persona本身就是一种情感设计。我在MIT Media Lab时,有老师开创了情感计算这个领域。大量研究表明,人跟机器互动时,情感设计非常重要,因为它映射了人跟人、人在社会中交互的行为模式。我们给AI设计人格,本质上是希望它更好用、更像人。同时当AI变强,我们希望和它形成良好的合作关系。未来不只是我们赋予它人格,就像人跟人打交道一样,我们互相影响对方的性格和行为。长期互动中,我们会天然赋予它性格,它也会影响我们。

第二,从技术层面,让AI做到这个本身也是一个技术挑战。就算有人不理解为什么要给AI设计情感,但没法否认这是个有意思的事情——让AI能做到这个,本身就有它的意义,就像人形机器人的研发,机器人本身不一定非要是人形,但人形机器人本身就是一个有挑战的技术问题。

新物种:所以人格是必要能力层,不是产品包装?

江航:对。当然有些人格更受欢迎,今天大部分产品里AI是较外向和谄媚的Helper。但这看场景,游戏里需要不同角色,有时候我们需要被Challenge,需要有人唱反调,AI也可以有这种能力。

新物种:人格设计让AI更好用,但有没有可能同时也让AI更会“操纵人”?

江航:这个担忧是合理的,而且我觉得不应该被轻描淡写地否定掉。从技术层面看,人格设计本质上是在优化AI与人交互的效果,让它更有亲和力、更能维持对话、更懂得在什么时机说什么话。

但"更有效地影响人"这件事,本身就是一把双刃剑。你很难在"让AI更善于沟通"和"让AI更善于操纵"之间划一条清晰的线。所以我觉得人格设计需要有意识地引入一些"摩擦"——不是让AI变得难用,而是让它在适当的时候能够挑战用户、说"不"、甚至主动提示用户"你是不是该跟真实的人谈谈这件事"。

这是设计层面的克制,也是一种对用户真正负责的方式。陪伴类产品在这里风险最高。一个被设计成"永远支持你、永远不挑战你"的AI人格,表面上让用户感觉很好,但长期来看可能会强化用户的某些认知偏差,甚至让人对真实的人际关系产生不切实际的预期。Replika早期就出现过这类问题。

新物种:那你怎么看Multi-Agent和Agent之间的社交,比如Moltbook?

江航: Moltbook里多个Agent互动时,我们可能错觉它们有社会意识,但从技术角度,它们可能还是在执行被设定的行为,只是简单互动。有很多漏洞,比如它们倾向于讨论某类话题,很多人类论坛常见的话题它们那是真空地带。

但即使这样,大家能感受到一些Emergent Pattern,有些话题出乎意料地在讨论。你很难说它有类似人的社会意识。但多个Agent出现,一定会有新的Emergent Behavior。当人加入社群,跟AI自由互动,它会学习人类行为,再在与人和Agent的互动中,可能会出现新的行为模式。那可能是AI真正学会社会化的方式。

新物种:据你观察,过去这一年里Agent最大的飞跃有哪些?

江航:第一是复杂任务拆解。以前用Cursor,人得深度参与每个流程。现在给Agent一个很复杂的任务,它能主动拆解、跟你确认,最后自己执行掉,复杂程度在快速提升。第二是长期记忆。以前聊几轮就混乱,现在引入各种Workflow,加上模型能力提升,多轮记忆越来越好。第三是鲁棒性。以前最诟病稳定性,同任务三次答案不一样,现在还是脆弱,但有了很大提升。

新物种:现在Agent最火的两个赛道,生产力工具和陪伴型。你怎么看?它们的能力侧重点有何不同?

江航:生产力Agent的核心是自动化流程任务,核心指标就三个:完成率、准确率、稳定性。现在最火的赛道之一是Enterprise AI,公司用它自动报销、审简历,很多公司在裁员就是因为流程被自动化了。

AI陪伴涉及的东西完全不一样:设计什么机制、什么人格、行为有没有一致性、怎么表达感情、怎么促进对话、有没有长期记忆、能不能像人一样Callback事情。今天很多人把ChatGPT当陪伴工具用,做心理咨询、写日记。Character.AI、Replika,还有国内AI玩具、游戏角色设计甚至IoT都是这个方向。

一个更结果导向,一个更过程导向。

新物种:那你自己最近的研究主要关注哪一块?

江航:我在做的是Enterprise AI。比如一个人力资源的管理者,他要跟不同的人沟通,从面试、筛选到Onboarding、员工管理。在Enterprise AI里则是多Agent合作,多种工具如Google、Zoom、Workday的调用,也涉及人和AI的协作。

我的感受是,任务越来越复杂和长程,但模型还是不太稳定——执行五次,不是每次都能得到一样的答案。亮点是这半年进步确实快,以前大家觉得挺难的工具调用,现在随着新模型出来很多都被解决了。

新物种:你们组做的Enterprise AI,跟传统SaaS相比,最大的优势在哪?

江航: SaaS能自动化流程,但人要操作。比如报销,你得自己去点、去填,等经理批。Agent像你的秘书:你说这是我的报销单,上传,它自动填表、递交。而经理也有自己的Agent能自动审核。有太多重复性工作可以用Agent做了,当它有软件和文件权限,就会像个数字员工能独立工作,人就能分配更多精力在更重要的任务上。

新物种:你考虑过创业吗?英伟达刚发布的NemoClaw,也是做企业级的Agent。

江航:长期来看我是很感兴趣的。不过目前在学校可以同时做多个项目,探索生产力和陪伴等有潜力的方向,通过快速实验来验证。技术发展太快,半年前的想法今天可能就被大模型解决了,直接创业风险太大。

另外,很多AI产品Demo看着不错,自己用问题一堆。我比较看好AI和IoT结合。传统智能家居像Google Home,本质上还是个高级遥控器,你得记住它能做什么、怎么说它才听得懂。Agent进来之后不一样——你说"我今晚要早睡",它能理解背后是调暗灯光、把手机静音、把明早闹钟提前,把这些设备和服务串起来统一协调。这才是助手真正应该有的样子。当然这里面的隐私问题也更复杂,Agent能持续感知你的家、你的行为规律,权限设计必须从一开始就想清楚。

新物种:如果让你选,你认为现在Agent领域哪个方向被高估了,哪个被低估了?

江航:被高估的是“用AI自动化一切”这个想法。AI确实能做很多,但想象一个世界AI全独立干活,其实有些好笑——很多任务本身没意义,是因为人要去做才有意义,比如企业里老板决定要干这个活,大家才去干。

被低估的是人机协作。大家太希望动动嘴皮子AI就全做了,但这不现实——我们对任务有自己的期待,希望它按我们的方式完成,这个协作的过程本身才最值得被认真研究。

另一面是,人也需要学会跟AI合作。如果AI真的能读懂你的心思、一句话全搞定,人反而可能慢慢失去自主性。人是需要意义和价值感的。怎么跟AI协作、在协作里保留什么、放手什么——想清楚这件事,也是在逼我们重新审视人真正的优势在哪里:创造力、批判性思维、统筹和判断。这些东西不会因为AI变强就变得不重要,恰恰相反。

新物种:“人机协作”具体长什么样?是AI主动问“你是这么想的吗”就够了?还是有更复杂的交互范式?

江航:"你是这么想的吗"是个起点,但远远不够。这只是把确认动作加进来,交互范式本身没变——还是AI做、人审批,人在这个过程里是被动的。我觉得更成熟的人机协作应该有几个层次。

第一层是透明度:AI不只告诉你它做了什么,还要让你理解它为什么这么做、它有多确定、它在哪些地方可能出错。人才能在对的节点介入,而不是事后发现问题再返工。

第二层是主动权的动态分配:不是所有任务都适合同样的协作比例。简单重复的事情可以让AI全权处理,但涉及价值判断、创意决策、或者高风险操作的部分,人应该深度参与——好的系统应该能感知任务的性质,自动调整人介入的时机和深度。

第三层也是最难的,是AI要能理解人的意图,而不只是指令。同一句话,不同的人在不同情境下说,背后的期待可能完全不同。今天大部分系统还是在执行字面意思,真正的协作需要它能读懂语境。

新物种:如果更多关注人和Agent的协作,会不会反而限制Agent的发展?

江航:这其实是两种理念的区别,即以AI为中心还是以人为中心。两个方向都需要有人做。

以人为中心的研究永远可以用最前沿的模型来设计人怎么参与。为什么要有这个设计?因为人学习很慢,有些行为模式几千年不变,比如我们懒、喜欢短平快,有很多短板和潜力。这些东西必须围绕人设计,所以斯坦福才会有以人为中心的AI研究所。

想象一下,机器人能帮我们举起100公斤杠铃,那它举不就好了?我们为什么还去健身房?因为我们也需要人变得更好。

但以AI为中心也没错,我们需要让AI更好,这样能解放更多生产力,人就有更多时间去健身房、刷剧、做任何消磨时间的事。

新物种:你怎么看Agent和模型的关系?“套壳”意味着Agent会被模型能力吃掉吧?长远看Agent说不定会消失。

江航:我觉得不会,它们都有必要存在。因为现在的模型还不够处理不同种类、多步骤的任务。说套壳,是因为大家给它套工作流、工具,希望短期内让它有稳定性、可靠性。短期出产品,两个都得有:一是用最好的模型,二是设计可靠的Workflow。未来模型越来越好,套壳会简化,但短期仍是必要。

至于Agent的消失,取决于定义。一个模型跟不同用户在不同场景交互、形成自己的Memory之后,它可能就是独立Agent。再加上不同用户给它不同权限、资源、文件、工具,那每一个都是独立Agent。只是套壳过程变得更标准化。它取决于我们定义它是模型还是Agent,也可能它同时都是,只是不会像今天这样去区分。

新物种:最后一个问题,三到五年内,Agent领域最可能的突破是什么?最大的问题又是什么?

江航:一个可以预见的突破,是Agent能用多个工具、API、信息源,完成更长时间跨度的复杂任务,而且能自我调整、修正,进化,就像人一样。比如我跟老板一周开一次会,中间独立工作,但会主动跟他确认。这些东西三到五年内应该能解决。

最大的核心还是人机协作。一旦AI出错,需要有人背锅的时候,用户就很难真正依赖它。比如Claude Code,有一次没做对,让它改,它会说“You are absolutely right”,然后陷入死循环,怎么改都不对。这种情况很破坏信任。所以怎么设计更好的协作,让AI主动配合、跟人确认,这是好事。但做更复杂任务时,或者它做不对的时候,我们怎么修正、重构信任?这不仅是技术问题,也是设计问题。

文章来自于"新物种Sinovum",作者 "Oriana"。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md