近日,医学信息出版巨头Wolters Kluwer Health委托进行的一项调研显示,美国医生对于在医疗实践中应用生成式AI的态度正在发生积极的转变,越来越多的临床医生对生成式AI寄予厚望。

其中,68%的美国医生在过去一年内改变了对生成式AI的观点,现在认为AI对医疗行业更有益。

随着大型语言人工智能模型(Large Language Models,LLM)的突破性进展,以ChatGPT为代表的生成式AI(Generative AI, GenAI)迅速成为各行各业关注的焦点。

在医疗保健领域,生成式AI同样蕴含巨大潜力,有望成为帮助医生优化临床决策、提升诊疗效率的得力助手。

这项于2024年2月开展的调研访问了100位在大型医院/医疗系统工作、日常使用临床决策支持工具的美国医生,68%的受访者表示,相比一年前,他们现在更倾向于认为生成式AI在医疗领域大有可为。

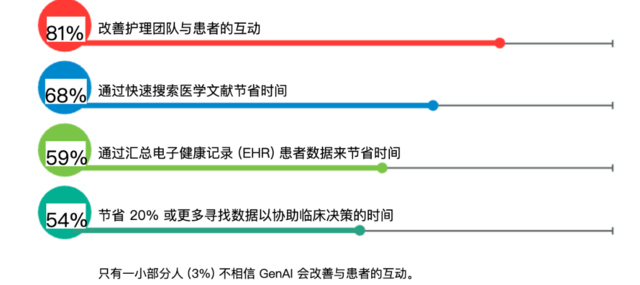

其中,40%的医生计划在今年年底前,就开始在面对面诊疗中使用生成式AI技术。医生们对生成式AI如此乐观,究其原因,主要基于以下几点考量:

1. 生成式AI有望帮助医生节省大量检索文献、总结病历的时间

总体而言,超过半数(54%)医生估计,在生成式AI的加持下,他们为辅助临床决策而查找数据的时间能节省20%以上。如果这一憧憬成真,医生将能投入更多时间在病人身上,用“聆听”和“共情”搭建起更温暖的医患关系。

2. 生成式AI技术的另一大亮点,在于其协调整个医疗团队、优化诊疗流程的能力

医学的精细化发展使得医疗服务日益专业化、碎片化,如何打通“信息孤岛”,让各科室、各岗位紧密配合,及时响应患者需求,是现代医院管理的一大挑战。

由此可见,医生已不再把生成式AI视为简单的信息整理工具,而是寄希望其在更高层面重塑医疗流程,激发团队协作的活力。

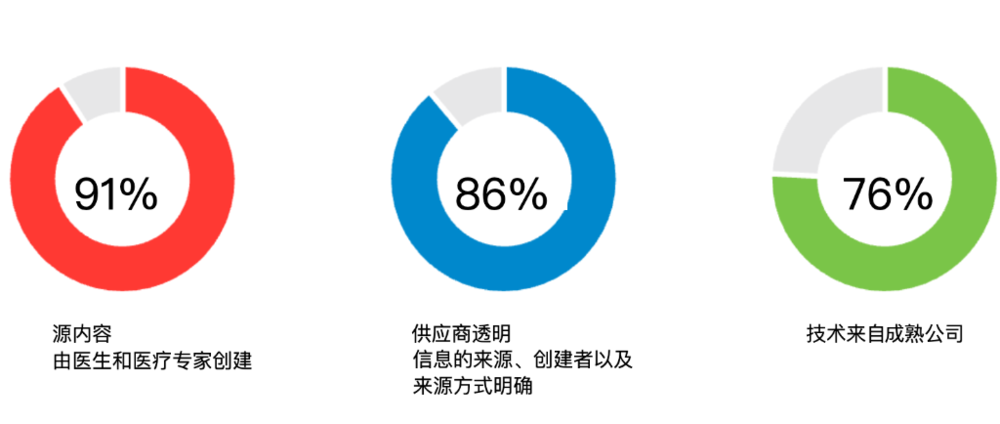

3. 医生更关注数据来源可靠性

然而,在对生成式AI的憧憬之余,医生们也明确表示,只有足够安全可靠、源自权威的生成式AI工具,才能赢得他们的信任和青睐。

高达58%的医生表示,选择生成式AI工具时最看重的是内容源的透明度,必须明确其使用的数据和知识是由医学专业人士创建。

针对具体应用场景,

显然,医生对医疗生成式AI的要求很高,这对相关企业是一个提示:唯有以循证医学为指导,以临床需求为依归,以伦理为底线,才能研发出经得起考验、服务于患者的生成式AI产品。

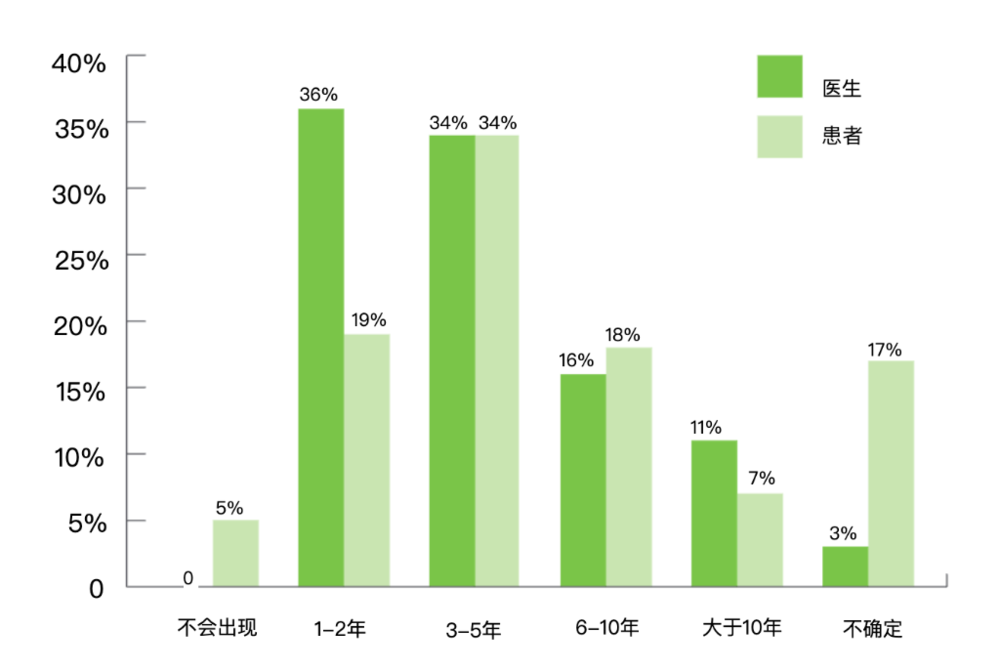

4. 患者对生成式AI的观念与医生有差异

医生对生成式AI的认知正在加速成熟,与患者的观念也存在一定差异。

另一项于2023年开展的美国公众调研发现,近半数(48%)受访者表示,即便明确告知医生在使用生成式AI辅助诊断,他们对诊断结果的信心也不会提升。

而在医生这边,66%的受访者认为,只要向患者说明用了生成式AI,患者就会对诊断更有信心。

同样,有80%的公众担心生成式AI被用于诊断决策,但只有20%的医生意识到这一顾虑。

此外,医患双方在生成式AI落地时间表上的预期也有分歧:

总的来说,医生对生成式AI的接受度要高于患者,双方在对生成式AI能力、落地时间的判断上也存在一定差异。

综上所述,美国医生对生成式AI在医疗保健领域的应用前景持乐观态度,并对其在节省时间、优化流程、辅助决策等方面的潜力充满期待。但他们也明确表示,对医疗生成式AI工具有着极高的要求,呼吁供应商以循证和伦理为指导、以透明和专业赢得信任。

文章来自 “华尔街日报 ”