国内的AI厂商活得不大好……

大家好,我是很帅的狐狸

昨天我跑去一家AI厂商找朋友聊天

听他们吐槽了现在的行业现状

今儿跟你们分享一些有意思的信息

本文会回答——

昨天听到的抱怨,主要还是「价格战」。

豆包、Kimi、智谱清言、星火,包括最近上架APP的腾讯元宝,都免费了。

而百度的文心一言4.0居然还要收费,我交了一个月就不打算继续续费了……

另一方面,各家大模型的API也在打价格战。

稍微解释下API——简单说就是程序员们可以通过调用厂商提供的API,让自己的程序也有对应大模型的能力。

第一个下场搅浑水的是幻方量化的DeepSeek。

中文能力不输GPT-4,价格却只有它的1%(百万tokens输入1元,token即AI可以处理的最小单位)。

接着是字节旗下的豆包。

百万tokens输入降到了8毛(Pro 32k),Pro 128k版也只要5块。

接着其他大厂也跟上了——

通义千问对标GPT-4的Qwen-Long百万token输入降到了5毛;百度文心一言直接把ENIRESpeed、ENIRELite这两个相对较水的模型给免费了;讯飞接着把星火Lite永久免费开放,顶配的Spark3.5 Max也降到了21元/百万tokens。

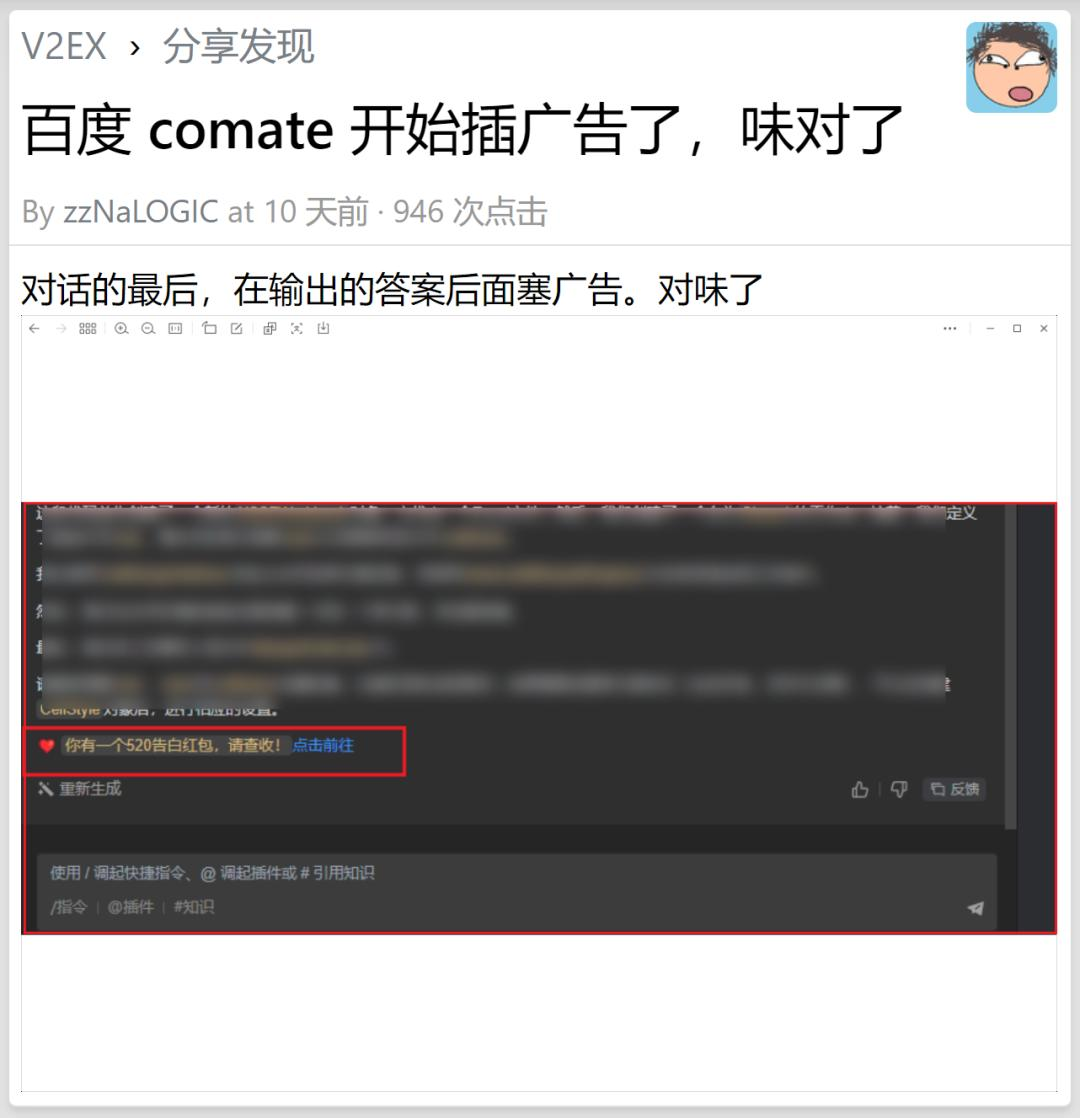

可能也是因为这样,百度也不得不在想着其他变现手段……

Anyway,虽然国内模型便宜不少,不过我认识的不少不差钱的工程师们,在生产环境还是偏好最贵(但效果最好)的GPT-4…

另一方面,to-B的定制项目也在卷——

AI厂商的朋友告诉我,除了大厂,创业公司们也打价格战打得火热。

听到了个有意思的案例是——

某银行招标一个场景大模型,腾X开价1,170万,通XXX开价790万,最后智XXX开价120万,成单了。

作为创业公司,这也不算不能理解的选择——

做to-B市场,万事开头难,需要有标杆案例,所以就算是亏钱也愿意接单。

另一方面,不少创业公司还不知道to-B的难做——毕竟手上刚融了一大堆钱,打标时没啥心理负担,中一个亏一个。

这轮「AI+」的逻辑跟9年前提出的「互联网+」其实很类似——大家都是拿着锤子找钉子,或者说,是拿着技术找场景。

不过跟「互联网+」超级无敌不一样的一点是——此时此刻并没有类似智能手机这样的新终端。

换句话说,不像当年,坑位很多——市场供不应求,用户们都在找新应用。

现在用户的手机装满应用,该占的坑都被占了。

用户要换APP,迁移成本会很高——

比如要搬数据,比如要学新应用怎么用(prompt并不是每个人都很擅长)。

当你的「AI+」场景带来的价值增量,并没有高于迁移成本时,用户宁愿坐等现有APP厂商,看看过几个月它们能不能迭代出AI能力。

另一方面,基于大模型带来的价值增量,相对还是比较有限。

毕竟,就现有的大模型技术,就算用上了RAG、外接了搜索引擎,还是不可避免会有AI幻觉的出现——

你也不希望让AI帮你点份外卖,结果它搞错了地址或数量。

当然,电商场景大多还只是小钱,如果还想用它来做医疗或投资决策,要克服的心理障碍就更大了…

Anyway,从结果来看,新App并没有撬动平台企业们对流量的垄断——毕竟并没有多出新的坑位来。

所以对于找场景的创业公司来说,对比9年前的「互联网+」时代,机会还是少了挺多的。

昨天跟AI厂商里的朋友也聊到了这点——

我们认识就是在15年「双创」的时候。

那时候创业的,除了叫得上号的一些大牛,还有很多不怕虎的小牛犊(包括当年的我们)。

而现在的AI创业公司,大多都是AI 1.0时代的老人,或是学术背景较强的专业人士。

所以看清这点的人,都没有急着做to-C应用,甚至连某些大厂(比如腾讯)也是先深耕B端场景。

更多的聪明人在to-B市场疯狂内卷,加上有数据和算力优势的大厂躬身入场,价格战自然是避免不了的。

那……对于创业公司来说,机会在哪呢?

逻辑推导来看的话……

第一个机会,是迁移成本低的工具。

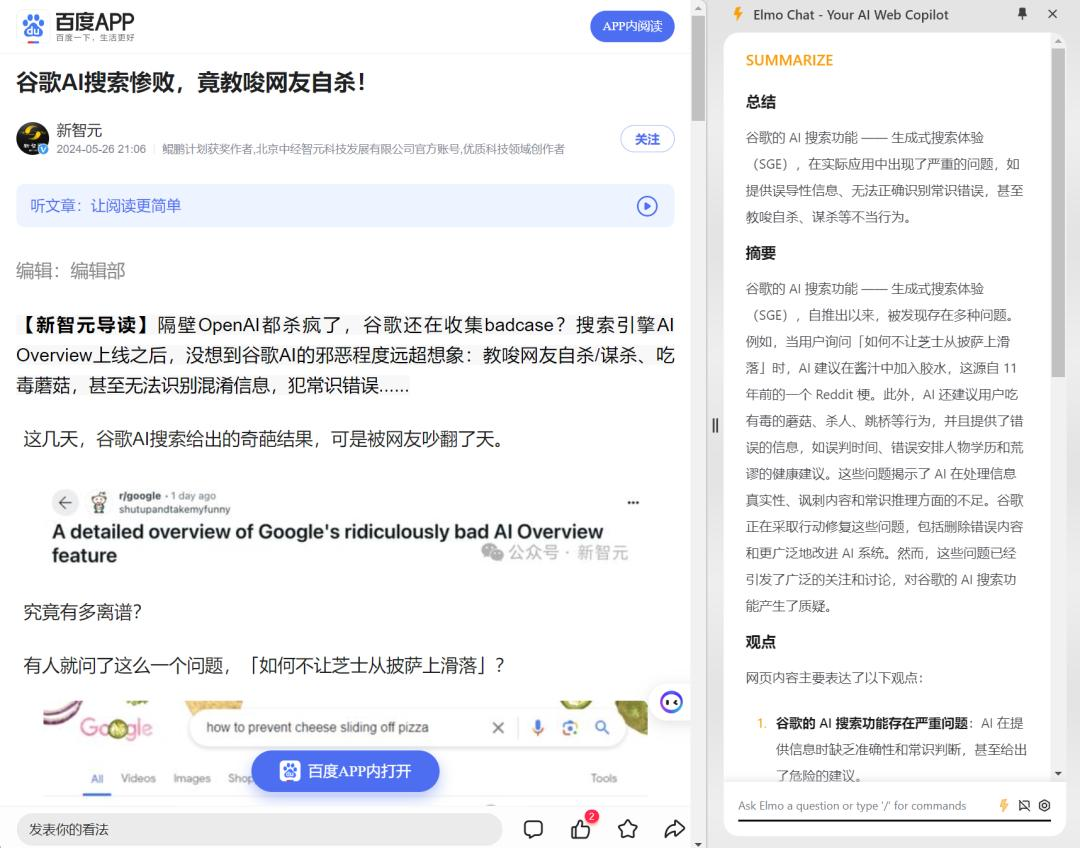

举个例子,比如文章总结类的AI工具。

这类工具每次使用都是独立的,也不依赖我以前的历史使用数据。

所以我现在已经完全离不开Elmo Chat这款Chrome插件了(贾扬清的产品)。

它的总结效果比Kimi Copilot之类的好,而且还免注册免登录。

当然,对于这类工具也有它的弱点——

一是没啥变现机会。

只能等到竞品都死光了,可以开始插广告;或是推新功能,让自己变成全家桶。

比如类似功能的Monica,基本上什么场景都覆盖了,所以有一部分重度用户会很快把免费次数给用完。

截图/

二是迁移成本低。

用户一旦发现有更好用的工具或是平替,马上就卸载了。

假设现在Elmo Chat强制要我付费的话,我肯定马上改用其他家的产品。

第二个机会,是「只有我做得到」的场景。

比如Kimi一开始选的「长文本处理」的场景,营销上也主打这点。

不过Kimi在3月份开始卷到了200万字上下文后,文心一言、360智脑、通义千问也都开始卷长文本了(通义千问更是直接卷到了1000万字)。

而在4月份,Google提出了Infini-Transformer架构,可以让LLM处理无限长的上下文;差不多同一时间,Meta(脸书母公司)也提出了一种无限长文本技术。

换句话说,之后长文本处理变成了大模型标配,Kimi原有的优势忽然就没有了。

因此呢,创业公司跟大厂斗「只有我做得到」,确实不是那么容易的事情…

哦你可能发现了,上面这两点简单说就是「人无我有,人有我优」……

但在AI时代吧,要做到这两点,始终要靠别人没有的数据基础才行,所以难度真不是一丁点…

这可能也是为什么尽管很烧钱,大家还是在打价格战的底层原因——靠价格优势争取来更多的用户使用数据,之后才能让自己一直保持数据优势。

文章来源于“狐狸君”,作者“很帅的狐狸”

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】MindSearch是一个模仿人类思考方式的AI搜索引擎框架,其性能可与 Perplexity和ChatGPT-Web相媲美。

项目地址:https://github.com/InternLM/MindSearch

在线使用:https://mindsearch.openxlab.org.cn/

【开源免费】Morphic是一个由AI驱动的搜索引擎。该项目开源免费,搜索结果包含文本,图片,视频等各种AI搜索所需要的必备功能。相对于其他开源AI搜索项目,测试搜索结果最好。

项目地址:https://github.com/miurla/morphic/tree/main

在线使用:https://www.morphic.sh/

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0