3D场景理解让人形机器人「看得见」周身场景,使汽车自动驾驶功能能够实时感知行驶过程中可能出现的情形,从而做出更加智能化的行为和反应。而这一切需要大量3D场景的详细标注,从而急剧提升时间成本和资源投入。

最近,ETH Zurich等团队提出了一种Few-shot学习方法,大大改善了这一局限性,并重新审视了目前的FS-PCS任务,在3D场景感知领域引入全新的benchmark,为未来的模型设计与开发开创了新局面。

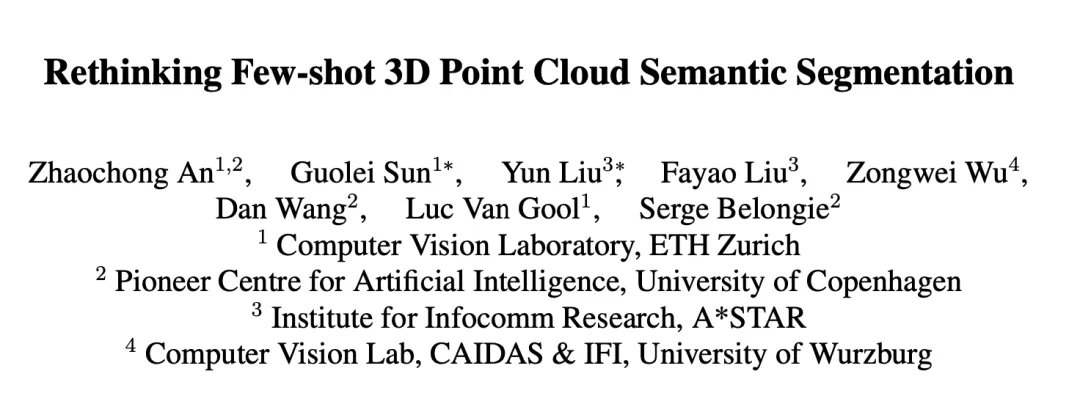

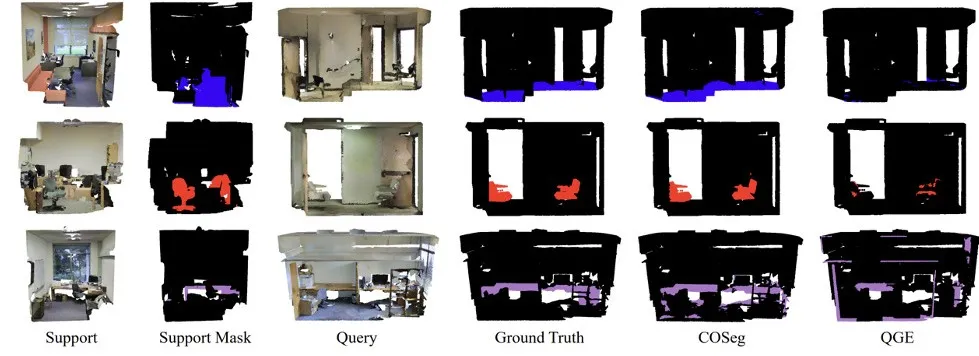

3D Few-shot分割结果示例

3D场景理解在自动驾驶、智能机器人等领域扮演着至关重要的角色,它使设备能够感知并理解周围的三维世界。尽管传统的全监督学习模型在特定类别的识别上表现出色,但这些模型通常只限于识别这些预定义的类别。这就意味着,每当需要识别新的对象类别时,就必须收集大量的3D场景数据并进行详细标注,这一过程不仅耗时耗力,还极大限制了全监督模型在真实世界中的应用广度和灵活性。

然而,借助Few-shot学习方法,这一局面得到了显著改善。Few-shot学习是一种需要极少标注样本就能迅速适应新类别的技术。这意味着模型可以通过少量的示例迅速学习和适应新的环境,大大降低了数据收集和处理的成本。这种快速、灵活的学习方式,使得3D场景理解技术更加适应快速变化的现实世界,为各种应用场景如自动驾驶和高级机器人系统打开了新的可能性。因此,研究Few-shot 3D模型能有效推动很多重要任务在更广阔世界的实际应用。

特别的,对于Few-shot 3D point cloud semantic segmentation(FS-PCS)任务,模型的输入包括support point cloud以及关于新类别的标注(support mask)和query point cloud。模型需要通过利用support point cloud和support mask获得关于新类别的知识并应用于分割query point cloud,预测出这些新类别的标签。在模型训练和测试时使用的目标类别无重合,以保证测试时使用的类均为新类,未被模型在训练时见过。

任务的重新审视与改正

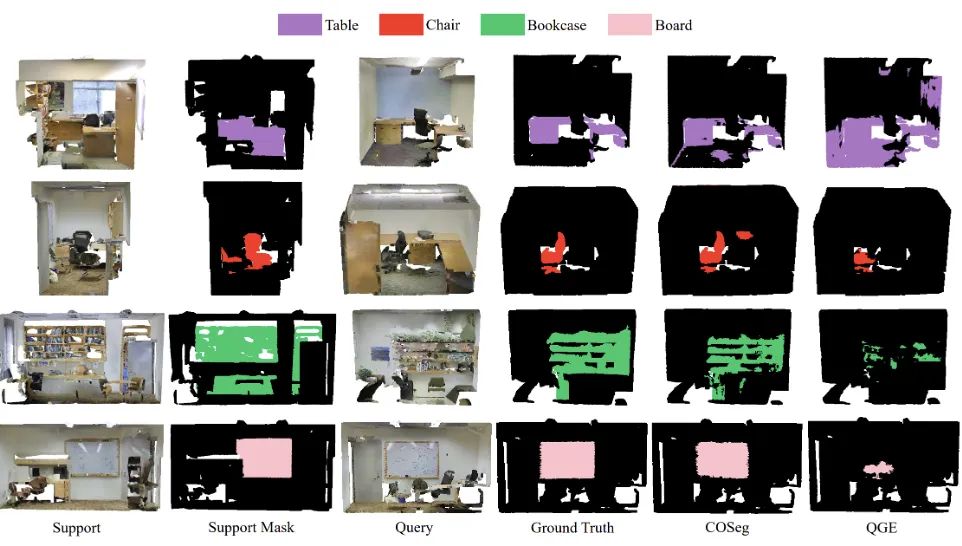

图1. 两个场景的可视化(前景类分别为door和board)

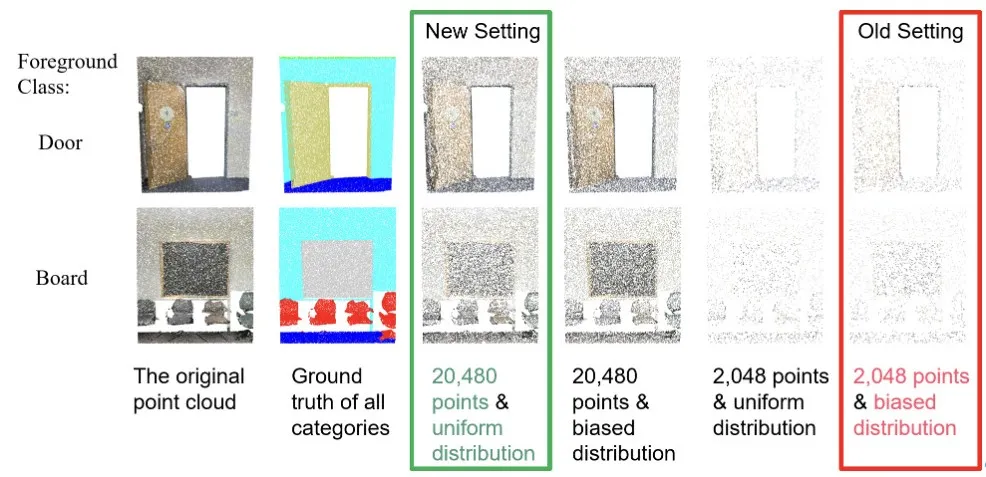

表1. 存在(w/FG)和不存在前景泄露(w/o FG)时过往模型的性能比较

该文章重新审视了当前FS-PCS任务。发现当前的任务setting具有两个显著的问题:

因此,为了改正这些问题,作者提出了一个新的setting来标准化FS-PCS任务,采用均匀采样并增加采样点数10倍到20480点。如图1中第三列所示,新setting下的输入有一致性的点的分布和更清晰的语义信息,使得该任务更加贴近于真实的应用场景。

在新改正的setting下,作者引入了一个新的模型叫做Correlation Optimization Segmentation(COSeg)。过往的方法都基于特征优化范式,侧重于优化support或者query的特征,并将改进后的特征输入到无参的预测模块获得预测结果,可看作隐式的建模support和query间的correlations。相反,没有注重于优化特征,文中提出了correlation优化范式,直接将support和query间的correlations输入到有参的模块中,显式的优化correlations,允许模型直接塑造query和support间的关系,增强了模型的泛化能力。

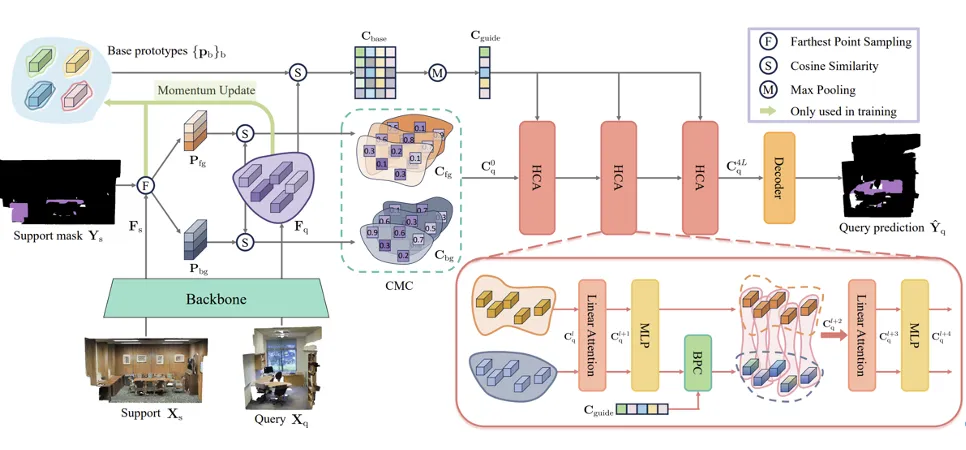

图2. COSeg架构

在COSeg中,首先对每个query点计算与support prototypes间的Class-specific Multi-prototypical Correlation简称为CMC,表示每个点和所有类别prototypes之间的关系。随后将CMC输入到后续的Hyper Correlation Augmentation(HCA)模块。

HCA模块利用两个潜在的关系来优化correlations。第一,query点都是互相关联的,因此他们对于类别prototypes间的correlations也是互相关联的,由此可得到点和点间的关系,相对应于HCA的前半部分对correlations在点维度做attention。第二,将一个query点分为前景或者背景类依赖于该点对于前景和背景prototypes之间的相对correlations,由此可得到前景和背景间的关系,相对应于HCA的后半部分对correlations在类别维度做attention。

此外,由于few-shot模型在base类别上做训练,在novel类别上做测试。这些模型会容易被测试场景中存在的熟悉的base类别干扰,影响对于novel类别的分割。为了解决该问题,文中提出对于base类别学习无参的prototypes(称为base prototypes)。当分割新类时,属于base类的query点应该被预测为背景。因此,利用base prototypes,作者在HCA层内部引入Base Prototypes Calibration(BPC)模块来调整点和背景类别间的correlations,从而缓解base类带来的干扰。

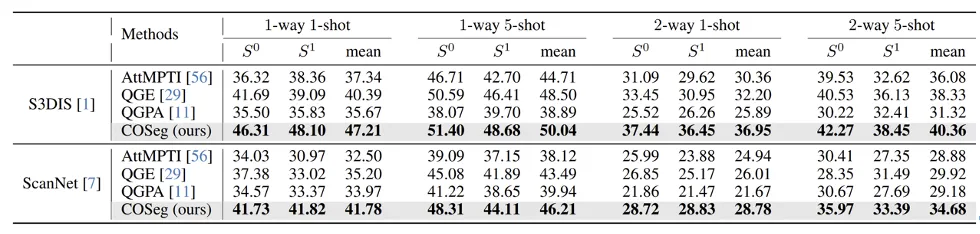

表2. 新的FS-PCS benchmark

图3. COSeg和过往最佳方法的可视化比较

文中的实验首先在改正后的标准setting下评测了之前的方法,创立了标准的benchmark,并且证明了COSeg方法的优越性能,在各个few-shot任务中都实现了最佳的结果。可视化也清楚表明了COSeg实现了更好分割结果。此外,在文中作者也提供了广泛的消融实验证明了设计的有效性和correlation优化范式的优越性。

该文章的研究在FS-PCS领域的贡献如下。

首先,作者确定了当前FS-PCS setting中的两个关键问题(前景泄露和稀疏点分布),这两个问题降低了对过往方法的评价基准的准确性。为了解决过往setting中的问题,文中引入了一个全新的标准化的setting以及评价benchmark。

此外,在标准化FS-PCS setting下,作者提出一个新的correlation优化范式,显著提高了模型在few-shot任务上的泛化性能。文中的模型COSeg融合了HCA来挖掘有效的点云关联信息和BPC来进行背景预测的调整,在所有few-shot任务上实现了最佳的性能。

文中改正的标准化setting开放了更多在Few-shot 3D分割任务上提升的可能性,同时提出的新correlation优化范式也为未来的模型设计与开发提供了新的方向。这项工作作为FS-PCS领域的一个新基准,有望激励更多研究者探索和拓展小样本3D场景理解的边界。

作为参考,以下几点可以作为潜在的研究方向,以进一步推动该领域的发展:

总结来说,这一领域的前景十分广阔,而且目前尚处于新兴起步阶段,对于广大的研究者而言,无疑是一个充满希望和机遇的研究领域。

参考链接:

[1] Lang, Chunbo, et al. "Progressive parsing and commonality distillation for few-shot remote sensing segmentation." IEEE Transactions on Geoscience and Remote Sensing (2023).

[2] Liu, Yuanwei, et al. "Intermediate prototype mining transformer for few-shot semantic segmentation." Advances in Neural Information Processing Systems 35 (2022): 38020-38031.

[3] Zhang, Canyu, et al. "Few-shot 3d point cloud semantic segmentation via stratified class-specific attention based transformer network." Proceedings of the AAAI Conference on Artificial Intelligence. Vol. 37. No. 3. 2023.

[4] Boudiaf, Malik, et al. "Few-shot segmentation without meta-learning: A good transductive inference is all you need?." Proceedings of the IEEE/CVF conference on computer vision and pattern recognition. 2021.

[5] Wang, Jiahui, et al. "Few-shot point cloud semantic segmentation via contrastive self-supervision and multi-resolution attention." 2023 IEEE International Conference on Robotics and Automation (ICRA). IEEE, 2023.

[6] Lang, Chunbo, et al. "Learning what not to segment: A new perspective on few-shot segmentation." Proceedings of the IEEE/CVF conference on computer vision and pattern recognition. 2022.

[7] Sun, Yanpeng, et al. "Singular value fine-tuning: Few-shot segmentation requires few-parameters fine-tuning." Advances in Neural Information Processing Systems 35 (2022): 37484-37496.

文章来自于微信公众号“机器之心”,作者 “机器之心”