Llama一举成为世界开源的领头羊。

截至目前,Llama模型在开源平台HuggingFace下载量近3.5亿。

Groq的创始人表示,这也太疯狂了,想想Linux花了多长时间才达到这个数字?

官博介绍,这一数字,是去年同期的10倍。而且,仅在上个月,模型的下载量超2000万次。

2023年2月,Llama 1首次亮相,经过多次迭代,到现在已经过去了整整18个月。

而在这仅有的一年半里,Llama已经从一个最先进的单体基础模型,发展成为,一个面向开发者的强大生态系统。

LeCun还不忘给自家模型宣传一波,越来越多的大公司、小公司、初创公司、政府和非营利组织,正基于此开发新的产品和服务。

还有高校机构、研究人员和工程师每天都在改进Llama,并提出新的用例。

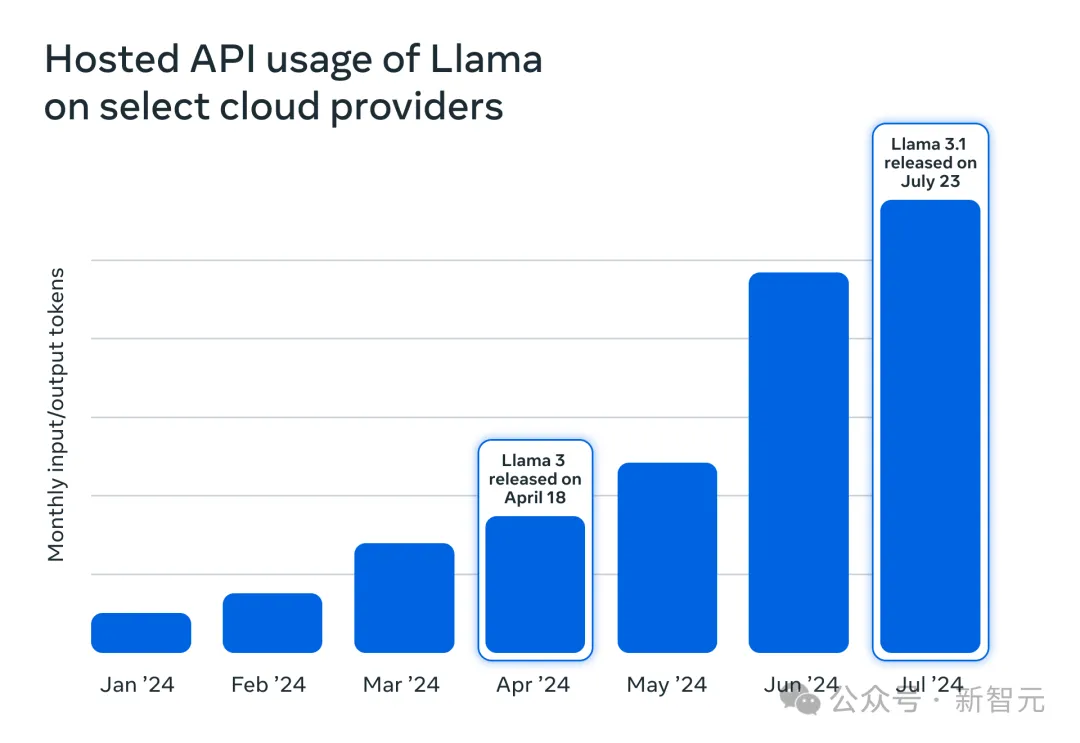

另外,值得关注的一点是,自今年5月Llama 3.1发布之后,云服务商对模型API token调用需求,翻了一番还要多。

一些Meta最大的云服务提供商,从2024年1月到7月,Llama的每月token量增长了10倍。

从微软云、英伟达、谷歌云等科技巨头,到Groq、Databricks等初创公司,全都支持Llama模型的使用。

老黄称,「Llama深深地影响着最先进AI的进步」。

可见,Llama正引领着开源之光。

Llama开源,拉低token价格战

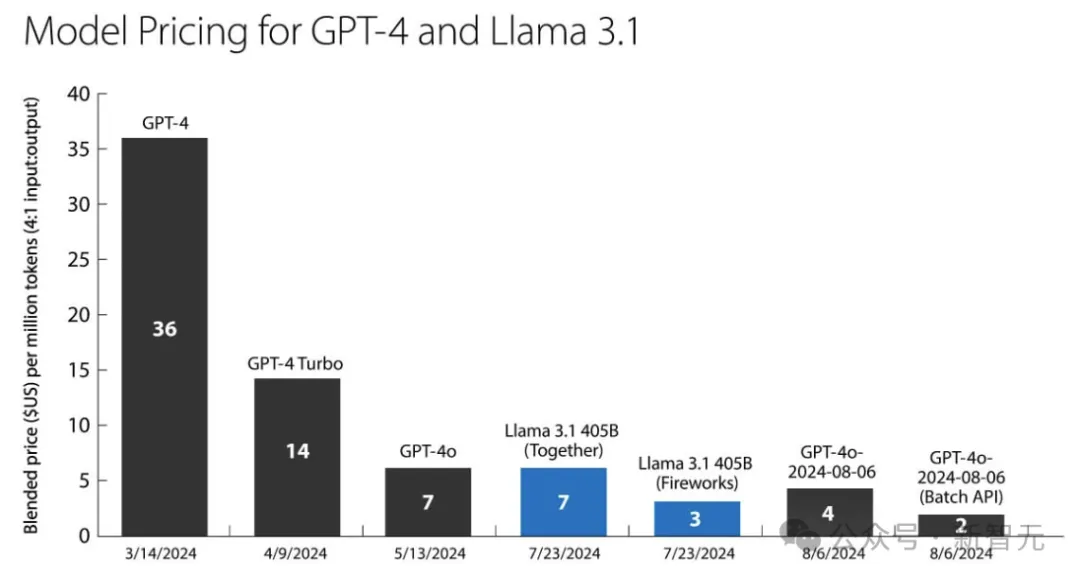

GPT-4级别模型开源,最先带来的好处是,token的价格不断下降。

AI大牛吴恩达在DeepLearning的博客中,算了一笔账:

近期,OpenAI官宣降价后,GPT-4o的token成本,现在是每百万token4美元。(假设是80%输入和20%输入token混合率)

还记得,2023年3月首发GPT-4时,每百万token的成本是36美元。

博客地址:https://www.deeplearning.ai/the-batch/issue-264/

17个月的时间,价格相当于每年下降了79%(4/36 = (1 - p)^{17/12})。

如你所见,token价格正迅速下降!

而推动token价格不断下降的一个因素,便是开源模型(如Llama 3.1)的发布。

这是因为,API提供商(如Anyscale、Fireworks、Together AI初创公司,以及一些大型云服务商)并不需要担心赚回开发模型所需的成本,因此他们可以直接在价格、速度等其他因素上,开启竞争。

此外,一些芯片公司Groq(快速生成token领先者)、Samba Nova(能以114 token/s速度运行Llama 3.1 405B)、Cerebras(以1800 token/s速率运行Llama 3.1 8B),以及英伟达、AMD、英特尔、高通等半导体巨头,在硬件上的创新,近一步拉低了模型价格。

Groq发文介绍了,如今支持Llama模型的生态。

「到目前为止,Groq已经使用Llama模型套件和自家LPU Inference,每天向40多万开发人员提供50亿个免费token」。

在构建用程序时,吴恩达发现,根据未来技术发展方向,进行设计是非常有用的,而非局限于当前水平。

基于多家软硬件公司的技术路线(改进半导体、更小的模型、推理架构中的算法创新),可以预见的是,token价格还将持续下降。

这意味着,即便你构建的智能体工作流看起来成本太高,而随着token价格不断下降,或许在某个时间,这套方案在未来也变得经济可行。

假设你创建了一个APP帮助人类,可每秒连续输出100个token。那如果百万token 4美元,每小时只花费1.44美元。

这远远低于美国,以及许多其他国家最低工资标准。

Meta挑战ChatGPT赢得数百万用户

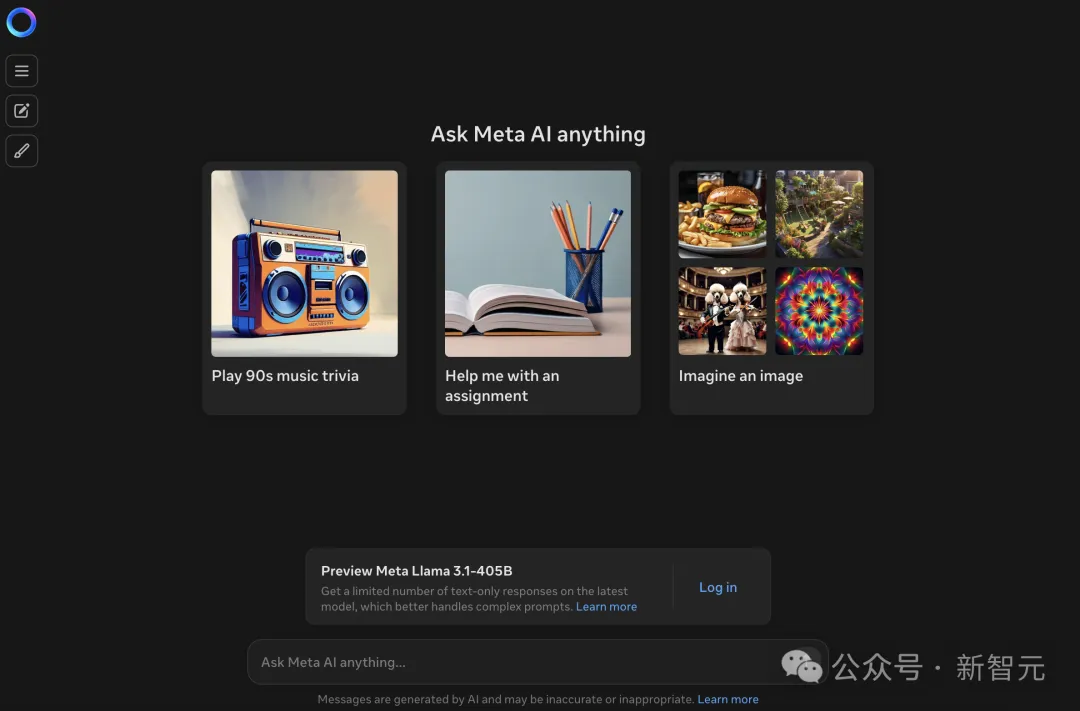

小扎希望,到今年年底,让Meta AI成为全球使用量最多的AI助手,超越OpenAI的ChatGPT。

目前,这一切正朝着他的目标,取得了进展。

据内部2位员工透露,8月初,Meta AI(2023年9月发布)在发布不到一年时间里,收揽了至少4亿月活跃用户和4000万日活跃用户。

这些数字从侧面反映了,超30亿用户的Meta,每天至少使用Meta旗下的一款应用中的AI助手。

此外还包括,通过Meta AI专属网站,以及Ray-Ban智能眼镜,也收获了不少用户。

庞大的用户群,成为大型科技公司优势,希望从ChatGPT中夺取一部分市场份额和关注度。

其实,谷歌也向数十亿用户推广了对话式AI——Gemini,但力度却不如Meta。

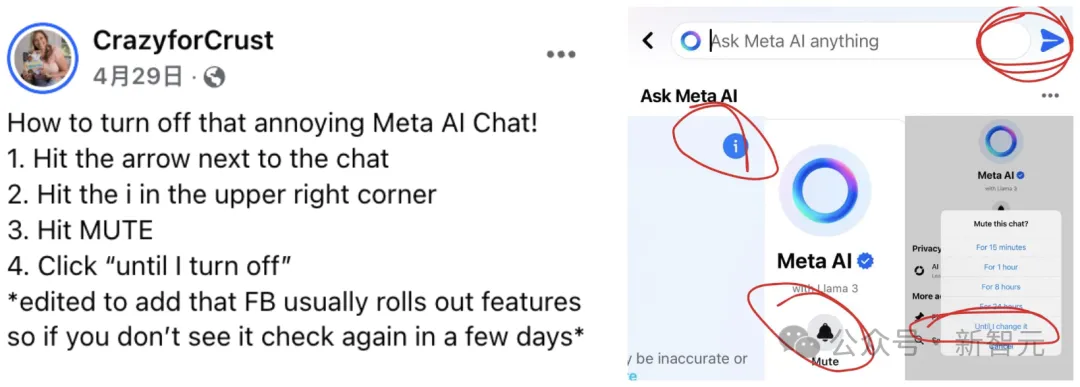

但一些使用Meta应用程序的人,在Facebook、Reddit、X上,抱怨Meta过于激进地推广AI助手,比如在其APP的键盘上添加搜索按钮。

有的人还出了一个关闭Meta AI对话的教程。

出于对用户参与度的担忧,Meta员工可能会不定期讨论的一个问题是,是否有些用户无意间使用了Meta AI。

8月初使用数据显示,大约10%的月活跃用户,每天使用助手来回答问题、生成图像和执行其他任务。

而这一比例远低于Meta的其他应用程序。

Meta此前2月报告称,80%的月活跃用户每天至少使用一款自家的应用。

这些数字表明,Meta AI已经是ChatGPT强有力的竞争者之一。

2022年11月,ChatGPT首次推出。截至目前,每周有超2亿人使用。鉴于最近的使用数据,Meta AI可能相距不远。

与Meta AI不同,ChatGPT也是一项盈利的业务模型。

数百万用户每月需要支付20美元,成为ChatGPT Plus用户,才能用上最先进模型撰写、编程、答问的能力。

数据显示,ChatGPT订阅收入,每年大约高达20亿美元。

Meta已在今年投入高达400亿美金数据中心和其他基础设施。

而Meta AI被视为,未来公司获得这些巨额投资回报的关键部分,主要用于开发这一产品的背后大模型Llama。

虽有报道曝出,Meta正推出一个付费版的高级人工智能助手。

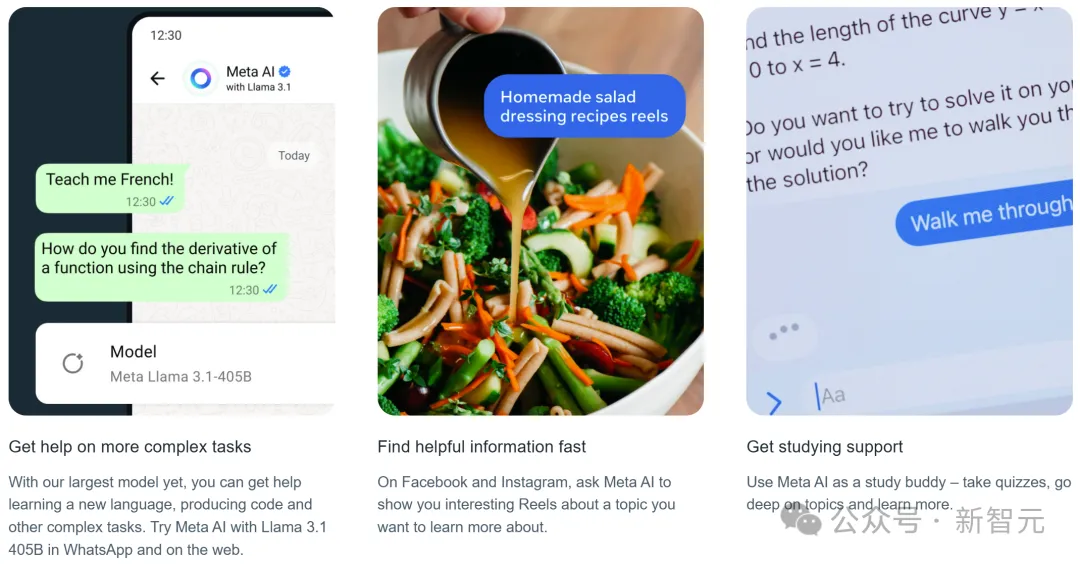

去年9月,Meta刚刚推出AI助手时,人们最初只能通过Instagram、WhatsApp或Messenger上的直接消息与Meta AI聊天。

今年,Meta开始在各种应用中, 让其变得更加显眼、容易访问。

4月,他们将Meta AI添加到其应用程序的搜索栏和信息流中,并为其推出了独立网站meta.ai。

同月,Meta还推出了一个新版本的AI助手,该版本能够识别和解析图像,并在其Ray-Ban智能眼镜中广泛应用。

目前,该助手在Meta的应用程序中可用的语言有8种,并在22个国家提供,同时在美国和加拿大的智能眼镜中提供英语版本。

开源AI如火如荼

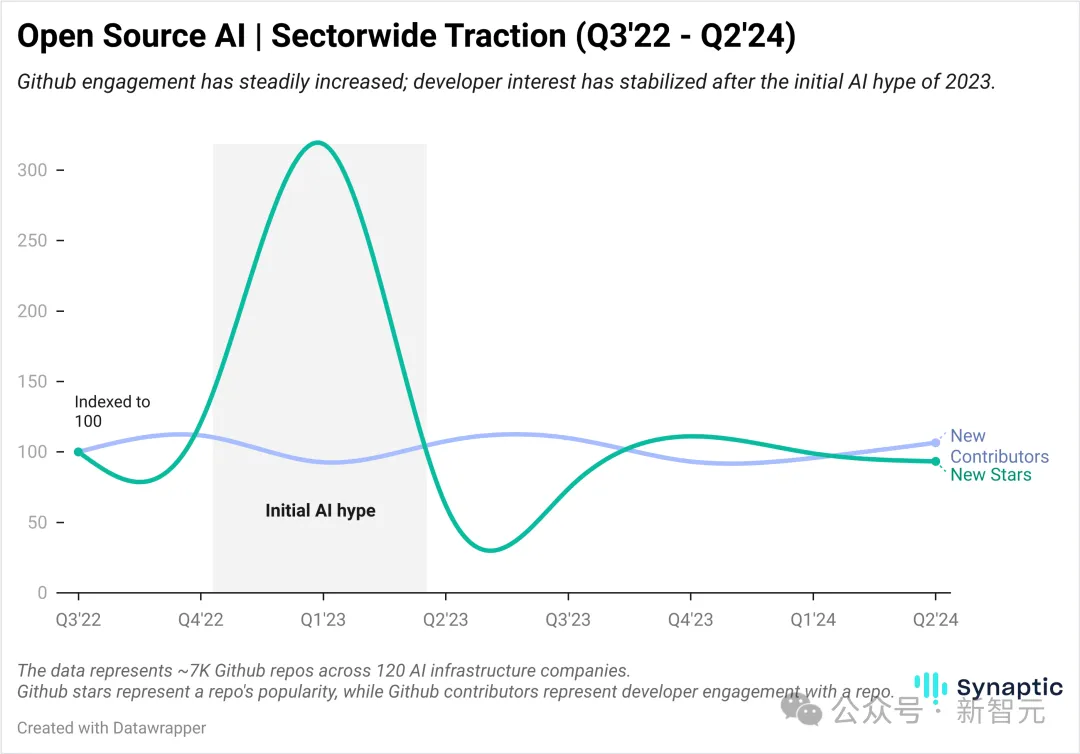

开源AI技术正在迅速发展,推动着生成式AI的重大创新。通过GitHub和Hugging Face等可访问的研究和平台,社区已经启动了取得突破性成果的项目。

自2023年第一季度的温和增长以来,开发者的兴趣已经增长并稳定下来,进入了「稳步爬升的光明期」(Slope of Enlightenment)——价值驱动的创新在此增长。

2024年,开源AI中严肃的开发者参与(即GitHub贡献者)仍在继续增加。

- 开源AI产品初创企业数量显著增加

2024年,参与开源AI的参与者数量激增,新的参与者如Neum AI和Patronus AI进入了这一领域,而像Vian AI这样的老牌参与者也为其用户提供了开源工具包。

- 开发工具仍然热门;培训和监控工具竞争加剧

大多数初创企业仍专注于生成式AI的开发工具,这对于构建、部署和管理应用程序至关重要。

然而,围绕模型训练和监督用例的初创企业活动有所增加,这表明可能会向在小众数据上微调模型和增强AI治理的方向转变。

在开源模型领域,领先者开始显现,开发的新模型较少,更多的重点放在来自Mistral和Meta等公司的改进和更高效的版本上。

- 开源开发正在缩小与闭源解决方案的差距

开源使得研究更具成本效益和可访问性,促进了来自多元创作者的创新,并且法律限制较少。据统计,有41%的企业用户倾向于选择开源来满足生成式AI的需求。

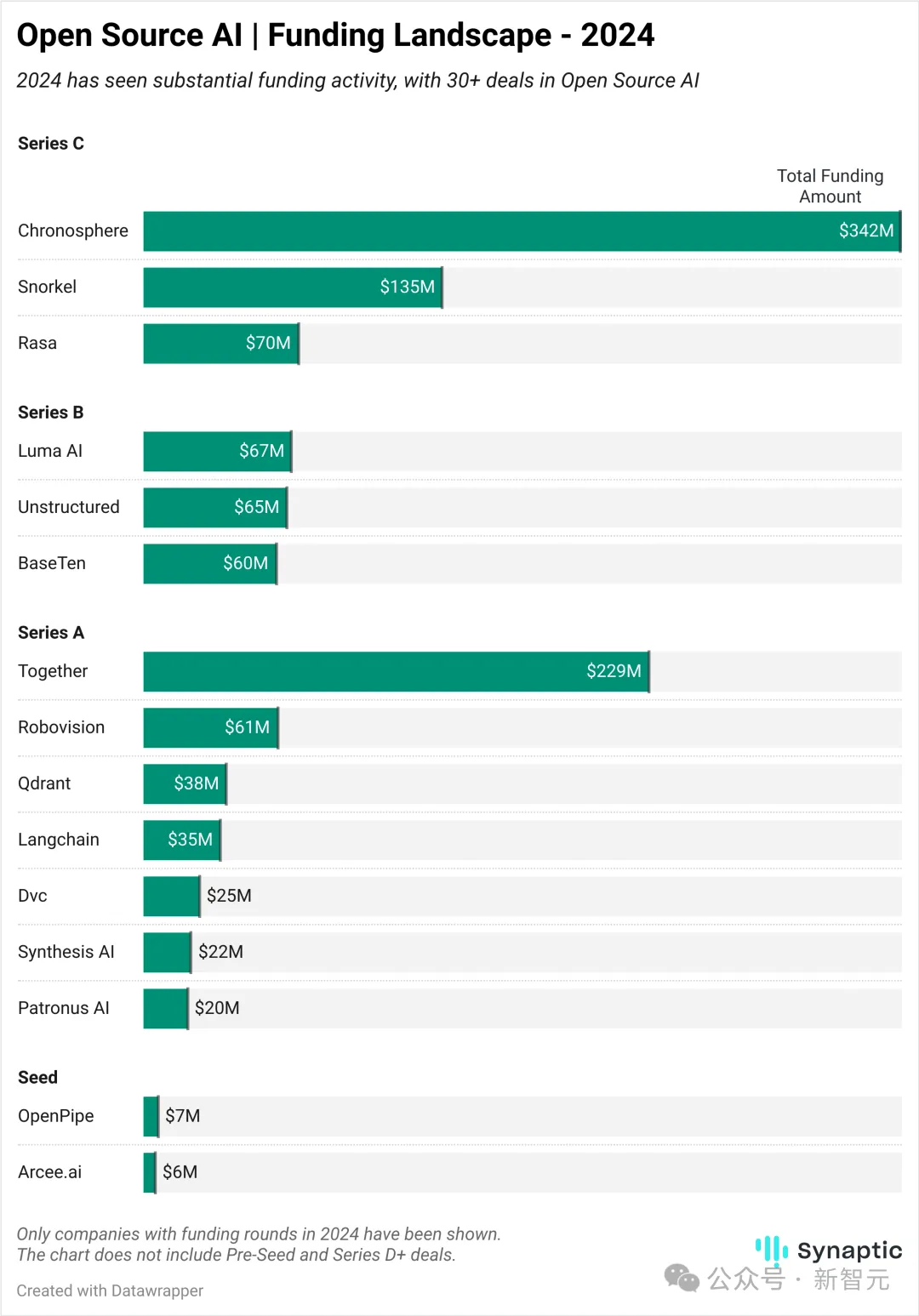

过去两年,开源AI领域已完成60多笔交易,总融资额超过130亿美元。这些交易中有超过45%属于A轮及以上的融资,表明对增长阶段投资的强烈关注。

- Deci AI被英伟达以3亿美元收购

- Scale AI完成了10亿美元的F轮融资

- Mistral AI完成了6.4亿美元的B轮融资

- Together AI完成了1.06亿美元的A轮融资

在开源AI领域中,模型训练和开发工具是获得资金最多的细分领域(不包括Mistral和Databricks),占总融资的60%。

其中,英伟达参与了8笔交易(包括Scale AI、Mistral AI、Together AI)。

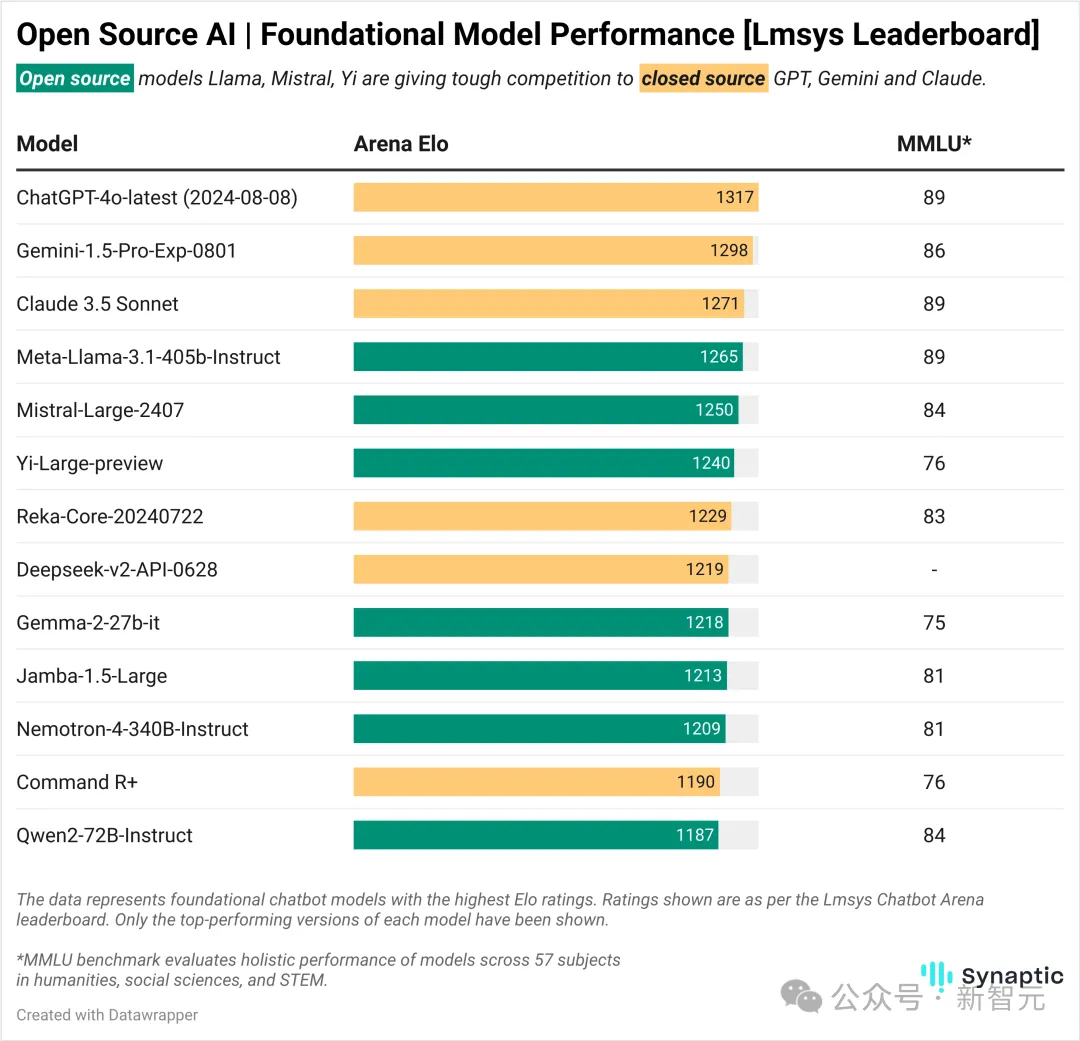

如今,开源和闭源模型之间的基准差距现在比以往任何时候都要小——Meta Llama和Mistral在MMLU上的表现几乎与GPT-4o相同。

其他开源模型,如Qwen和Yi,也在性能上快速赶上。

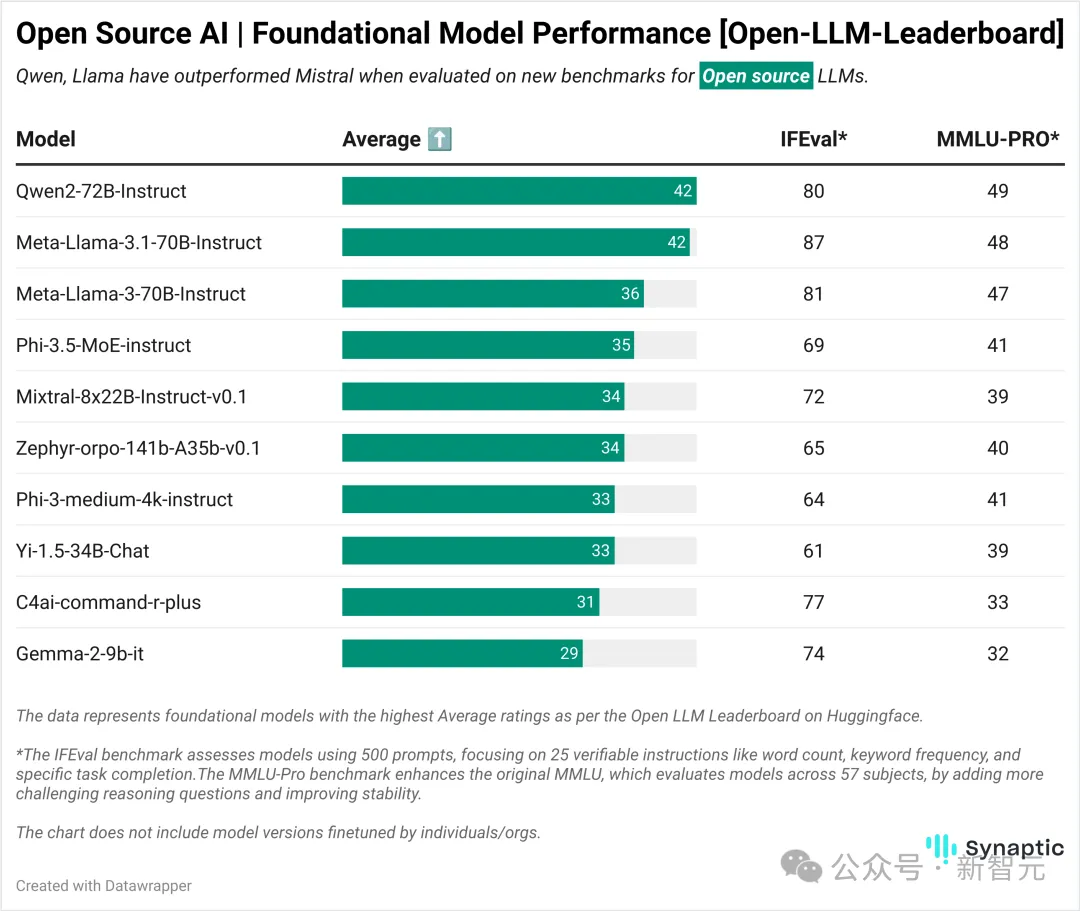

为了解决现有评估(如Elo和MMLU)的局限性,Hugging Face于2024年6月正式推出了专注于复杂任务的开源LLM排行榜——Open-LLM-Leaderboard。

在过去的6个月中,随着新竞争者的出现,开源AI的格局发生了显著变化。

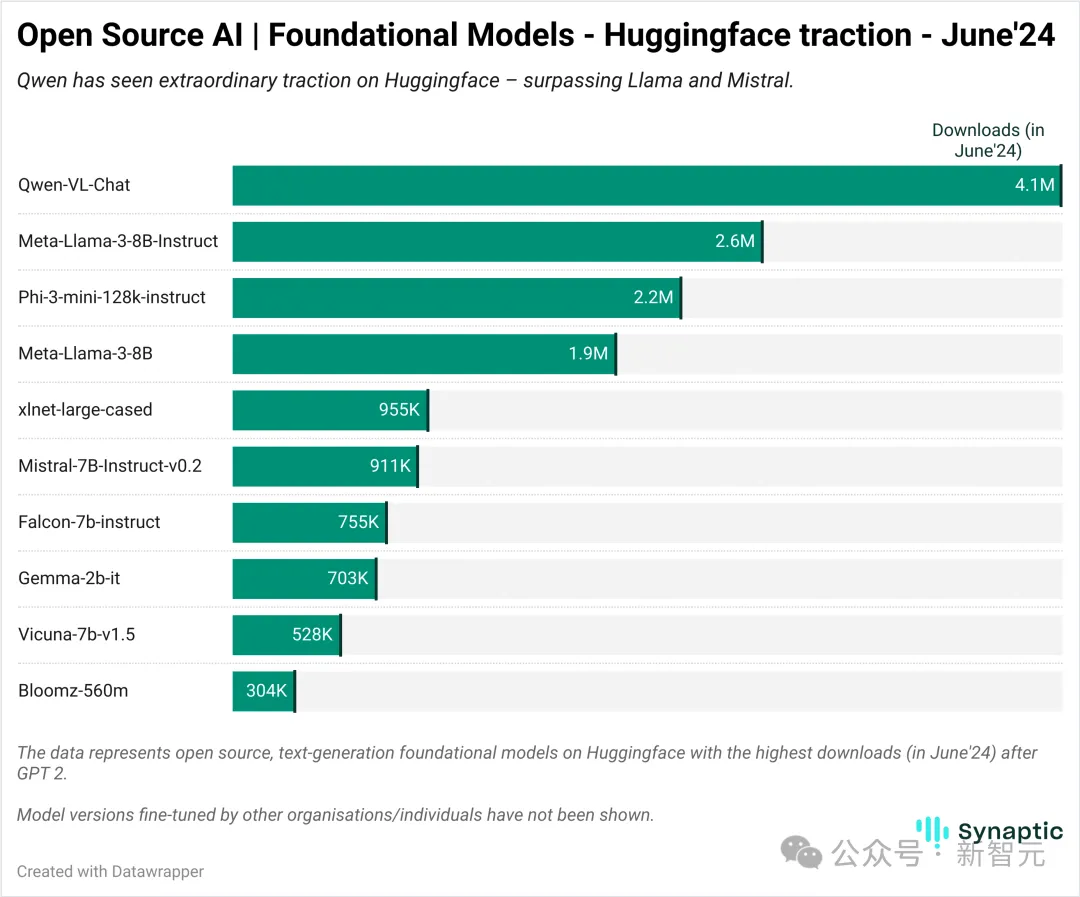

经过大量数据预训练的Qwen,于2024年6月在Huggingface Traction上获得了最高的下载量。

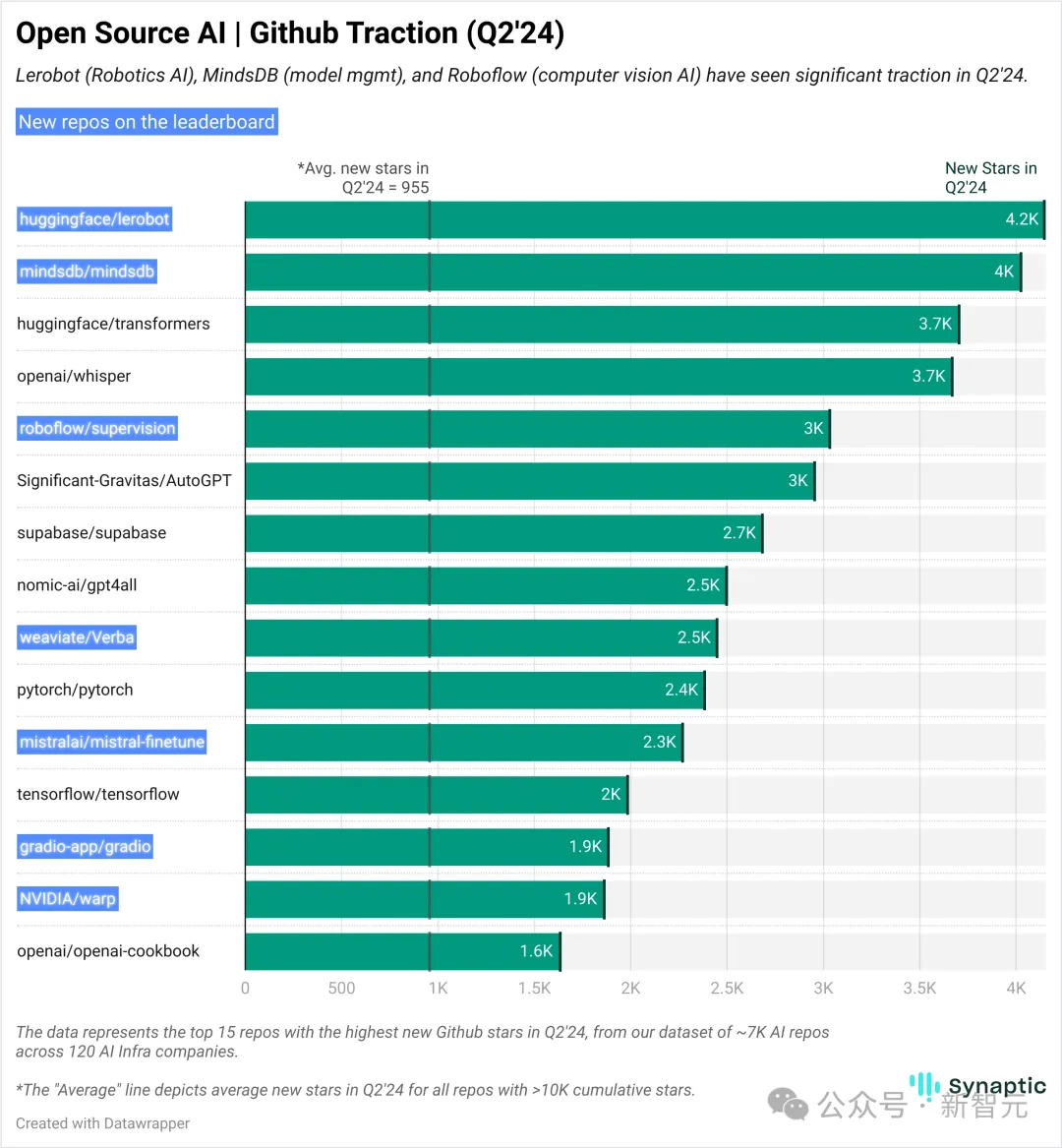

GitHub的stars是项目在GitHub上受欢迎程度的直接指标。

AutoGPT和ModularML的Mojo在2023年引领了GitHub热度——自那时以来,多个仓库已经获得了显著的进展。

LeRobot提供基于PyTorch的真实世界机器人模型、数据集和工具,旨在使机器人技术更易于访问。它具有最先进的模仿学习和强化学习方法,提供预训练模型、人类收集的数据集和模拟环境。

由英伟达支持的MindsDB是一个使用企业数据构建AI模型的平台。MindsDB简化了数据源和AI/ML工具之间的连接,自动化工作流程以创建定制的AI系统。

文章来源于“新智元”,作者“新智元”

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner