研究者警告:强化学习暗藏「策略悬崖」危机,AI对齐的根本性挑战浮现

研究者警告:强化学习暗藏「策略悬崖」危机,AI对齐的根本性挑战浮现强化学习(RL)是锻造当今顶尖大模型(如 OpenAI o 系列、DeepSeek-R1、Gemini 2.5、Grok 4、GPT-5)推理能力与对齐的核心 “武器”,但它也像一把双刃剑,常常导致模型行为脆弱、风格突变,甚至出现 “欺骗性对齐”、“失控” 等危险倾向。

强化学习(RL)是锻造当今顶尖大模型(如 OpenAI o 系列、DeepSeek-R1、Gemini 2.5、Grok 4、GPT-5)推理能力与对齐的核心 “武器”,但它也像一把双刃剑,常常导致模型行为脆弱、风格突变,甚至出现 “欺骗性对齐”、“失控” 等危险倾向。

在大模型逐步接近AGI之时,"AI对齐"一直被视为守护人类的最后一道防线。

让 AI 与人类价值观对齐一直都是 AI 领域的一大重要且热门的研究课题,甚至很可能是 OpenAI 高层分裂的一大重要原因 ——CEO 萨姆・奥特曼似乎更倾向于更快实现 AI 商业化,而以伊尔亚・苏茨克维(Ilya Sutskever)为代表的一些研究者则更倾向于先保证 AI 安全。

Ilya领衔的OpenAI对齐团队,刚刚发表了首篇论文——用类似GPT-2监督GPT-4的方法,或可帮人类搞定自己更聪明的超级AI!

本文探讨了AI对齐在OpenAI公司中被忽视的一部分,以及AI对齐在大模型训练中的重要性和影响。文章揭示了OpenAI内部因AI对齐而产生的分歧,并阐述了AI对齐在保证AI按照人类意图和价值观运作方面的作用。同时,文章指出AI对齐在大模型训练中存在的性能阉割和对齐税等问题,以及AI对齐在大模型发展中的隐藏模型和重要性。

OpenAI的董事会发生了“政变”,导致CEO奥特曼被罢免。董事会没有公布具体原因,引发了公司内部和投资者的不满和困惑。

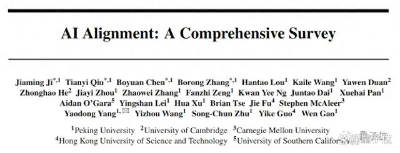

通用模型时代下,当今和未来的前沿AI系统如何与人类意图对齐?通往AGI的道路上,AI Alignment(AI对齐)是安全打开 “潘多拉魔盒” 的黄金密钥。