芯片设计效率提升2.5倍,中科大华为诺亚联合,用GNN+蒙特卡洛树搜索优化电路设计 | ICLR2025

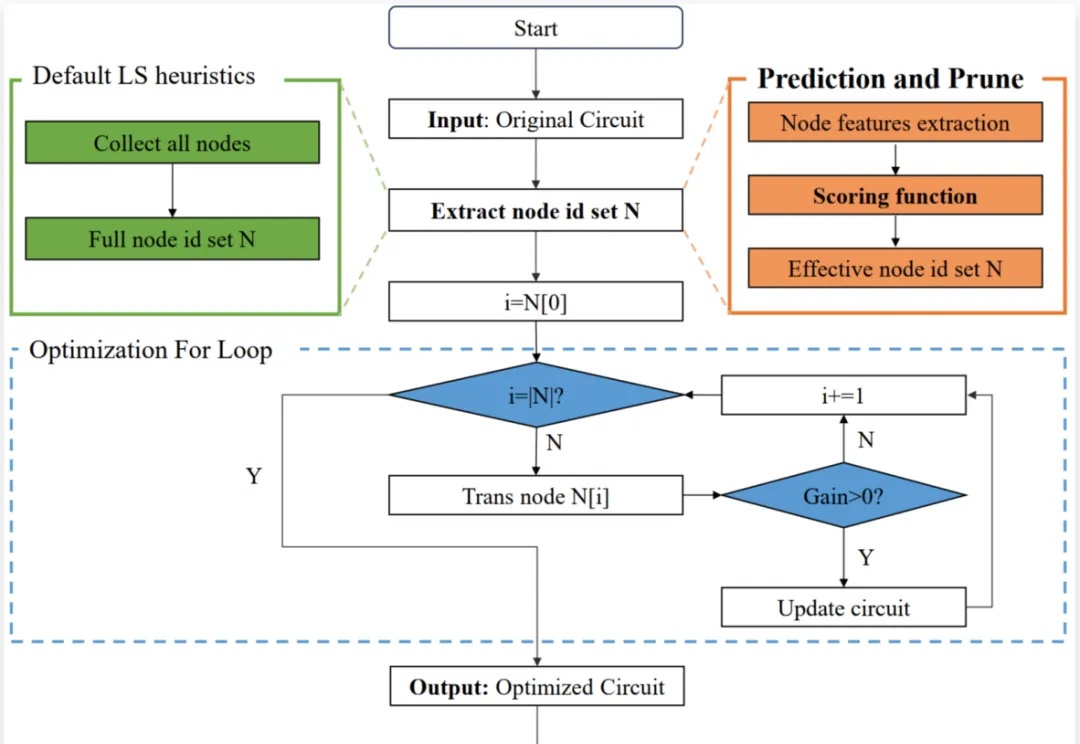

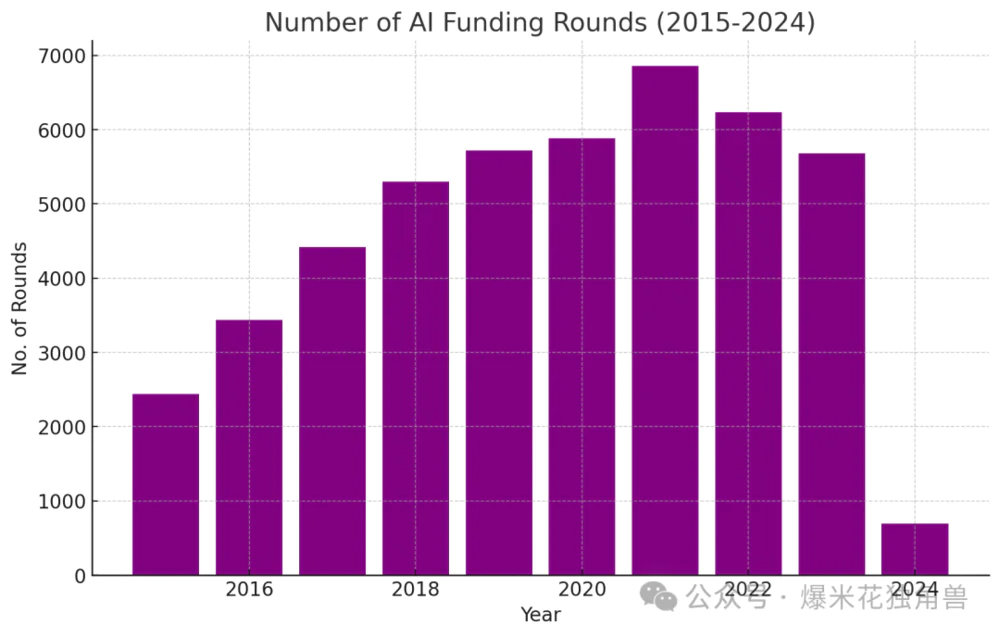

芯片设计效率提升2.5倍,中科大华为诺亚联合,用GNN+蒙特卡洛树搜索优化电路设计 | ICLR2025芯片设计是现代科技的核心,逻辑优化(Logic Optimization, LO)作为芯片设计流程中的关键环节,其效率直接影响着芯片设计的整体性能。

搜索

搜索

芯片设计是现代科技的核心,逻辑优化(Logic Optimization, LO)作为芯片设计流程中的关键环节,其效率直接影响着芯片设计的整体性能。

一个超越DeepSeek GRPO的关键RL算法出现了!这个算法名为DAPO,字节、清华AIR联合实验室SIA Lab出品,现已开源。禹棋赢,01年生,本科毕业于哈工大,直博进入清华AIR,目前博士三年级在读。去年年中,他以研究实习生的身份加入字节首次推出的「Top Seed人才计划」。

2月8日,共达地创新技术(深圳)有限公司(以下简称“共达地”)市场负责人李苏南在办公室向记者演示了他们自主研发的“神器”:只需规划好AI应用场景,上传视频、图片等原始数据并定义标注类别,机器便如同经验丰富的AI工程师,自动分析数据特点

上世纪五十年代,普通美国家庭每天看电视的时间“高达”6小时。显像管技术迎来黄金时代,但质疑声接踵而至。

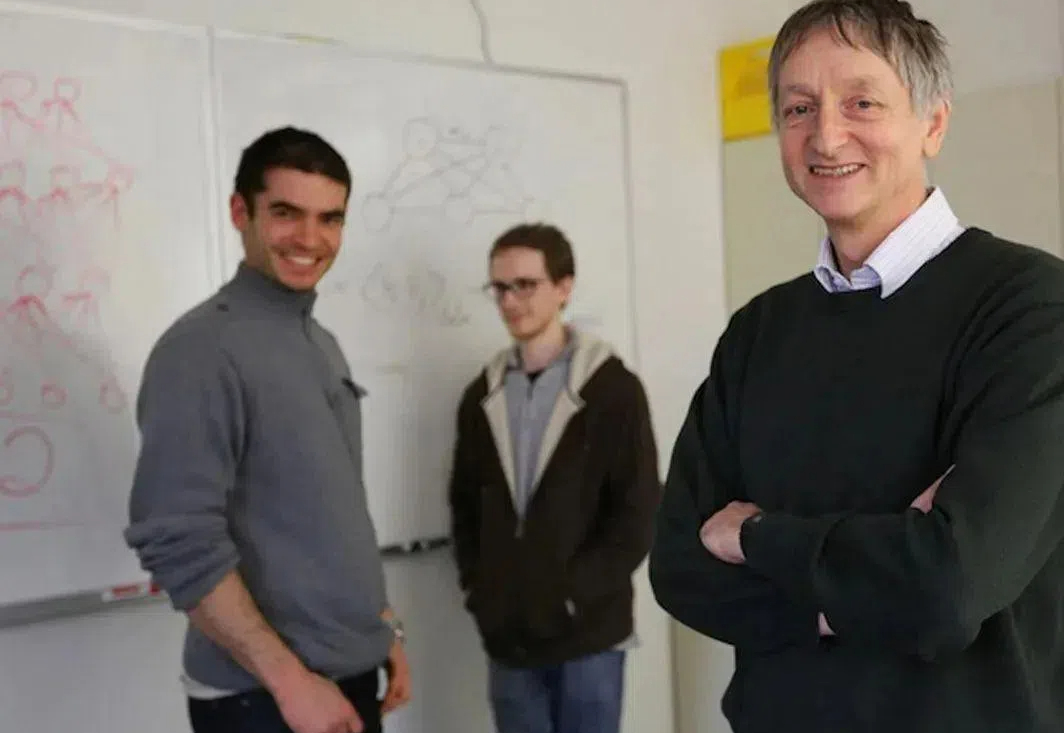

在《AI算法分析94家海外AI独角兽》提到,我们分析了2015年后成立的6500家AI公司(从2万多家公司中抽取完成融资和2022年以后创办的企业),本篇是关于VC的一篇分析报告。 我们提供了投到最多独角兽的机构列表(文末),以及对YC的业绩回报做了估算。

无需硬件传感器或对现有网络环境进行重大改动即可轻松部署。

家人们,消除“视频闪烁”(比如画面突然一白)有新招了!

迄今为止最快、近乎完美的网络流(Network Flow)算法,来了!

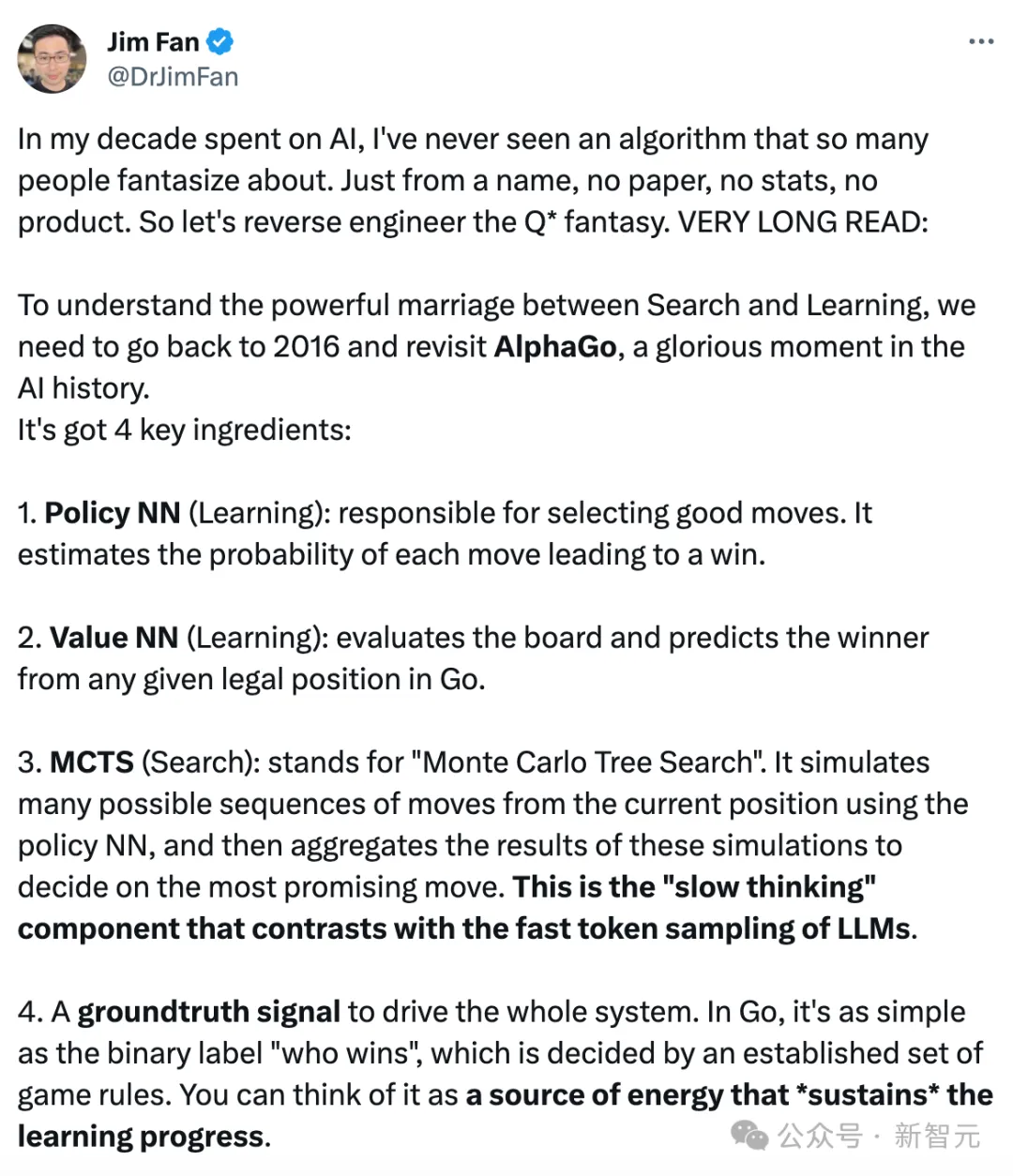

近日,一篇出自中国团队之手的AI论文在外网引发热议。论文中,研究团队提出了Q*模型算法,帮助Llama-2-7b等小模型达到参数量比其大数十倍、甚至上百倍模型的推理能力,使模型性能迎来惊人提升。

将AI预测与全自动营销预算分配相结合,使广告支出回报率最高提升70%。