“AI照骗”如今的信任危机,靠打水印真能解决吗

“AI照骗”如今的信任危机,靠打水印真能解决吗众所周知,由各类大模型驱动的生成式AI功能,如今已经相当高调地出现在了各大消费电子产品厂商的宣传中。而对于消费者来说,生成式AI的“实际价值”除了对话、问答,以及部分生产力场景可能有用的内容总结、归纳之外,最能被大家广泛接受的,恐怕还是将其用在影像处理领域的各种“生成式拍照”和“修图”功能。

来自主题: AI资讯

7146 点击 2025-02-11 11:04

众所周知,由各类大模型驱动的生成式AI功能,如今已经相当高调地出现在了各大消费电子产品厂商的宣传中。而对于消费者来说,生成式AI的“实际价值”除了对话、问答,以及部分生产力场景可能有用的内容总结、归纳之外,最能被大家广泛接受的,恐怕还是将其用在影像处理领域的各种“生成式拍照”和“修图”功能。

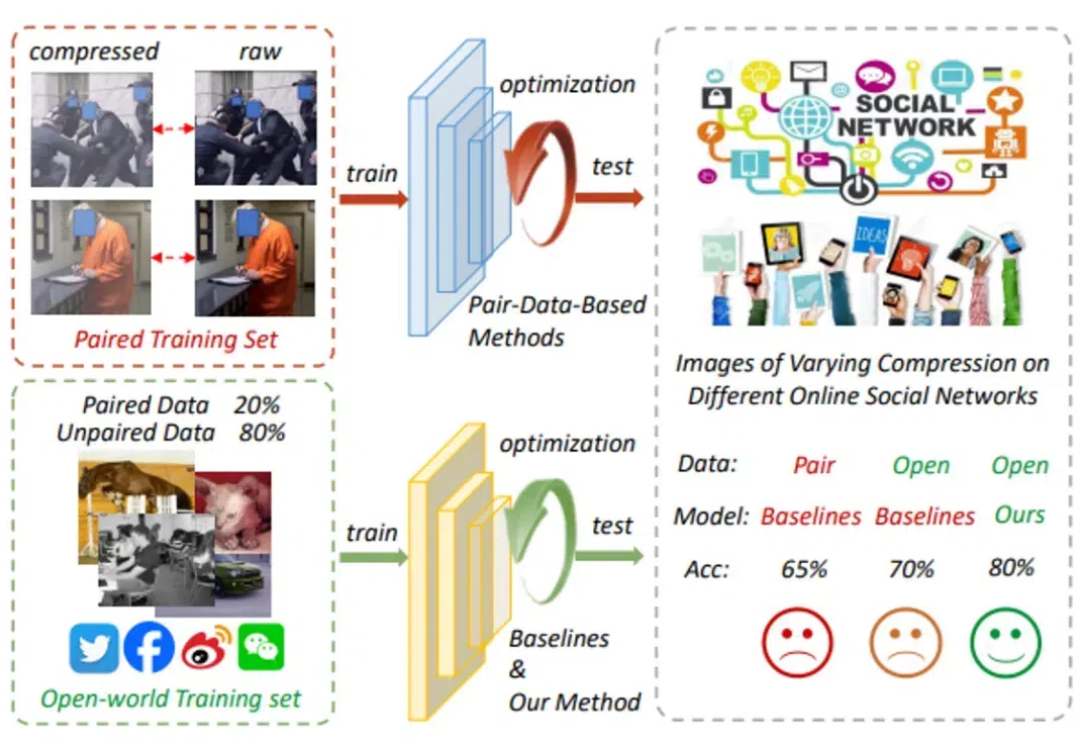

现有的深伪检测方法大多依赖于配对数据,即一张压缩图像和其对应的原始图像来训练模型,这在许多实际的开放环境中并不适用。尤其是在社交媒体等开放网络环境(OSN)中,图像通常经过多种压缩处理,导致图像质量受到影响,深伪识别也因此变得异常困难。

在 EMNLP 2024 上,我们看到了向量模型的各种创新用法,其中最出人意料的莫过于:文本水印。

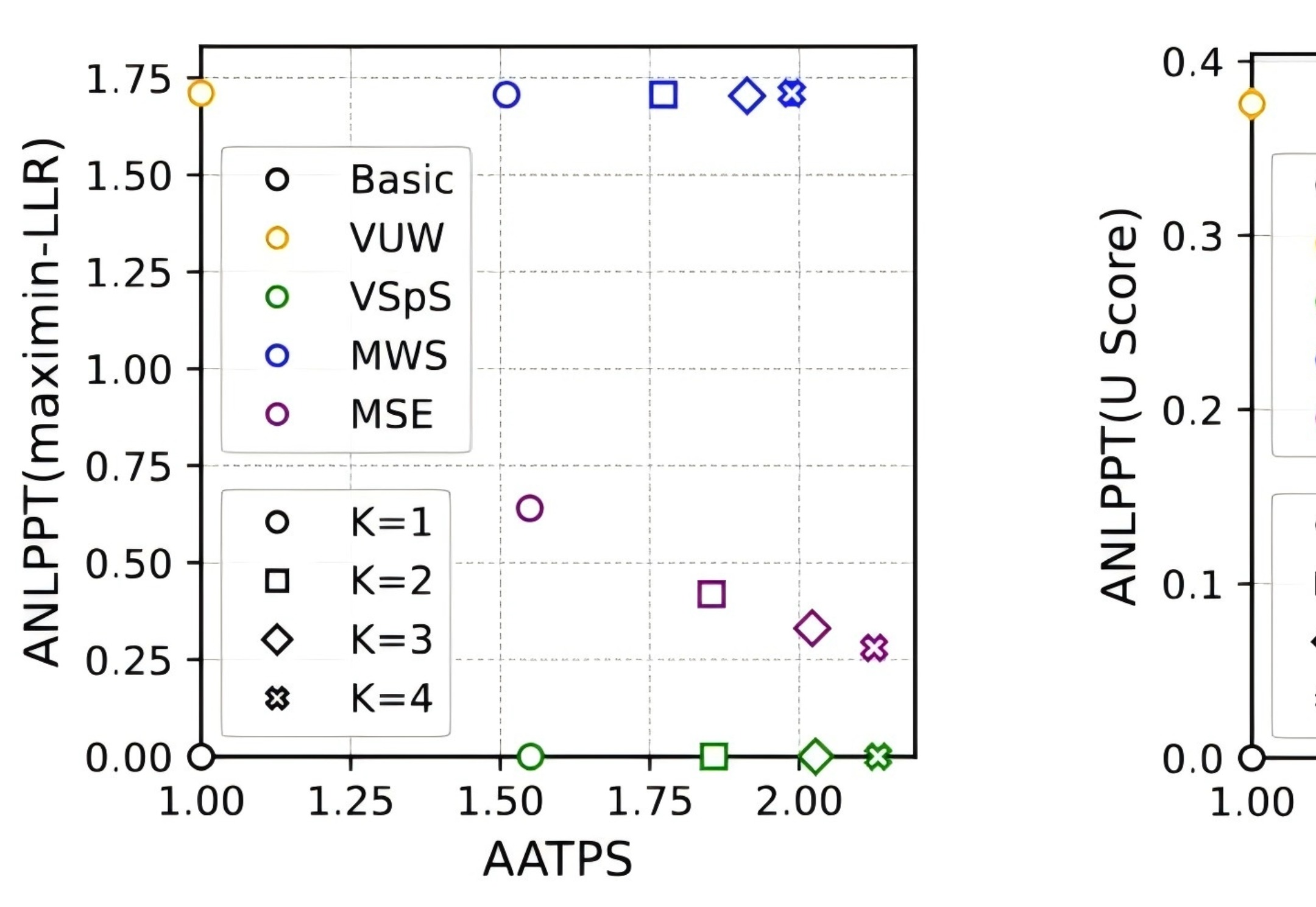

近日,DeepMind 团队将水印技术和投机采样(speculative sampling)结合,在为大语言模型加入水印的同时,提升其推理效率,降低推理成本,因此适合用于大规模生产环境。

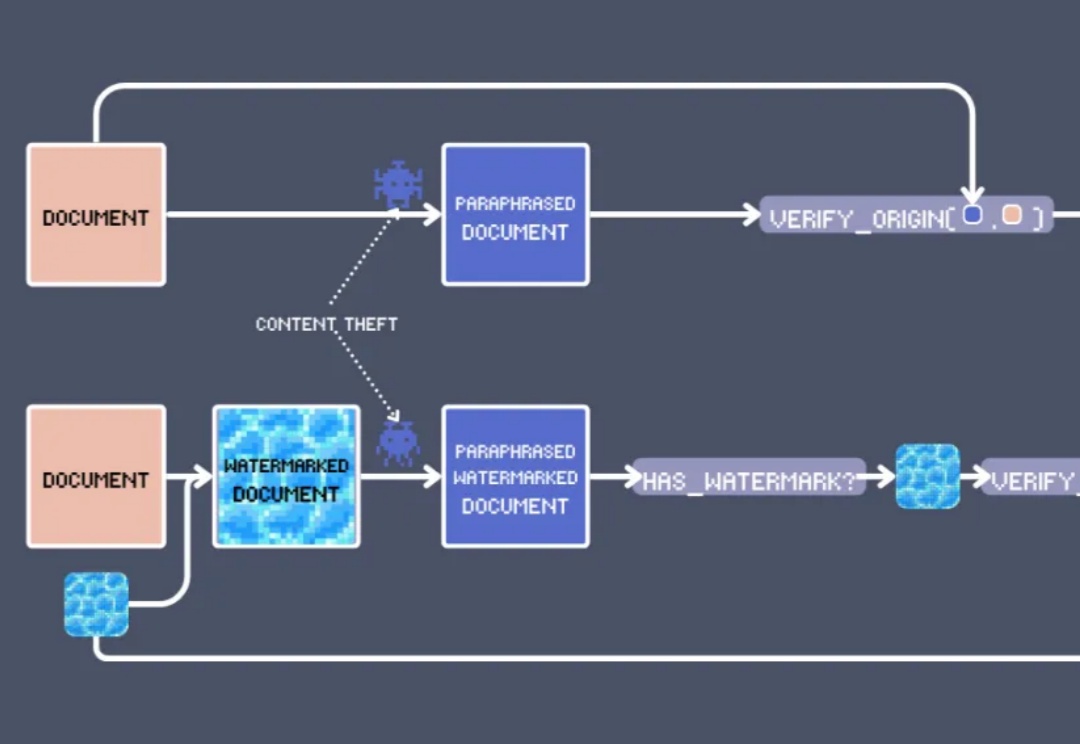

尽管生成式人工智能(AI)正在改变全球内容生产的格局,但诸多严峻挑战也随之而来:如何准确识别由 AI 生成的内容并防止其被滥用,尤其是在文本生成领域,已成为困扰越来越多人的一大难题。

现如今,大型语言模型(LLM)生成的内容已经充斥了整个互联网,并且这些模型还能模仿各种类似真人的语气和行文风格,让人难以分辨眼前的文本究竟来自人类还是 AI。