这群00后“杀疯”了,没靠资本、大学刚毕业狂赚7千万,TikTok助攻AI爆款应用出世

这群00后“杀疯”了,没靠资本、大学刚毕业狂赚7千万,TikTok助攻AI爆款应用出世三位00后创业者开发AI应用,取得显著成功。

搜索

搜索

三位00后创业者开发AI应用,取得显著成功。

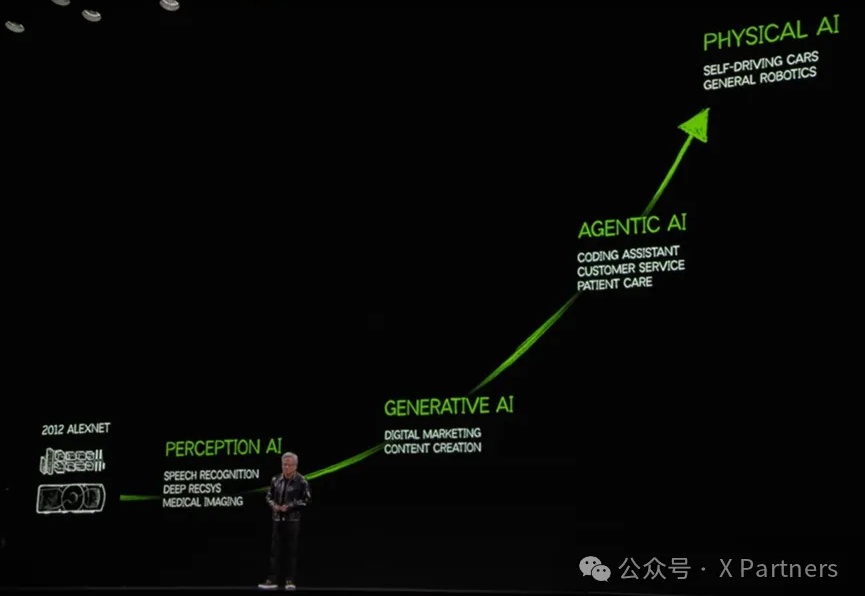

英伟达CEO黄仁勋最近在CES 上的主题演讲及问答,分享了他对未来的愿景。这显然是Agentic AI和Robotics的结合,他称之为Physical AI。

在科技飞速发展的当下,智能家居领域正经历着深刻变革。随着物联网、人工智能等技术的日益成熟,智能家居市场规模不断扩大,据相关机构预测,未来几年该市场将持续保持高速增长。

OpenAI Realtime API 的「说明书」。

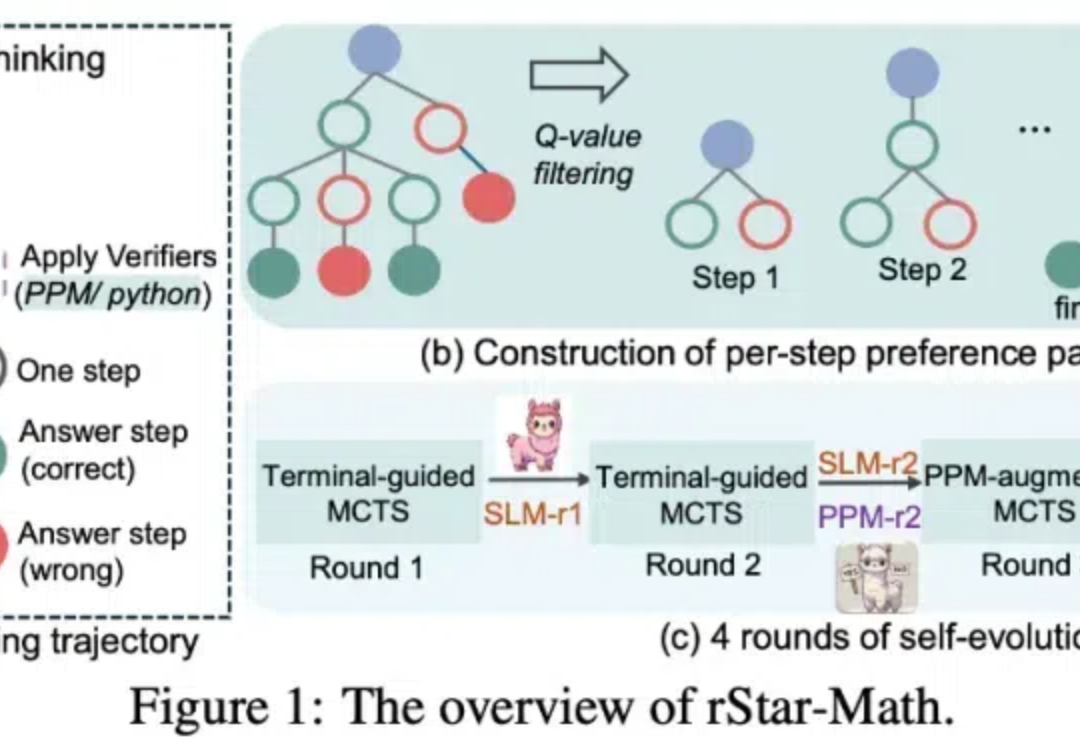

OpenAI o1 给大模型规模扩展 vs 性能的曲线带来了一次上翘。它在大模型领域重现了当年 AlphaGo 强化学习的成功 —— 给越多算力,就输出越多智能,一直到超越人类水平。

人工智能(AI)专家普遍认为,2025 年将是智能体(agent)爆发之年。

Level AI 创始人 Ashish Nagar 具有深厚的 AI 背景,曾在亚马逊 Alexa 团队工作。他观察到传统客服行业存在质量监控效率低、数据价值难以挖掘、实时支持能力不足等问题,因此创立 Level AI。

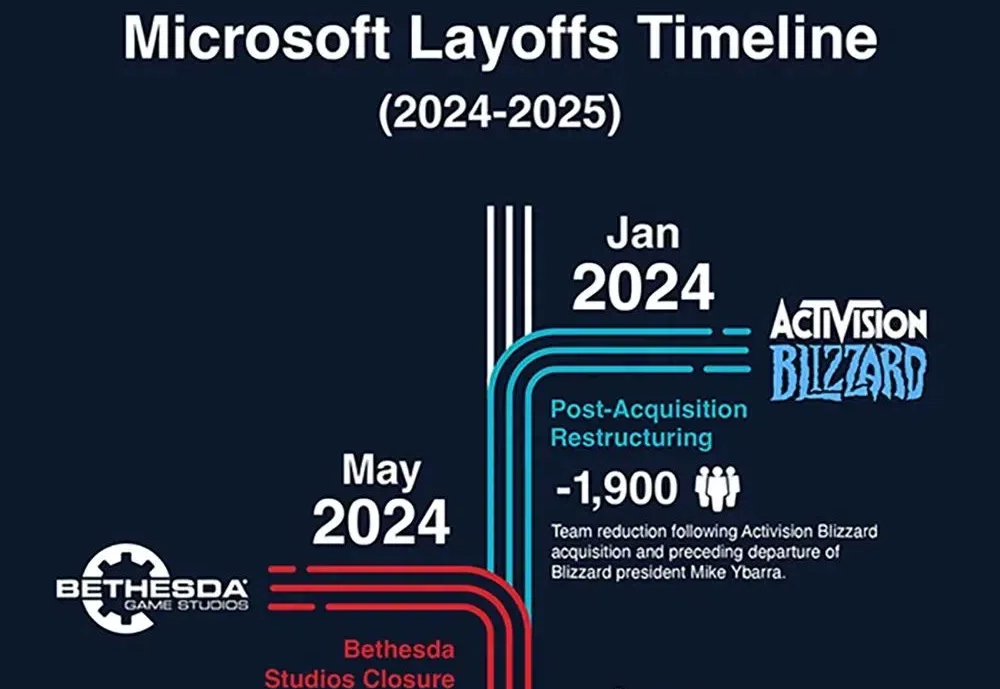

AI Agent 会是未来吗? 对于科技行业的从业者而言,很多人每天既为新技术的突破感到兴奋,又因自身和行业前景的未知而焦虑,尤其是最近一轮裁员风暴,更为整个行业蒙上了一层阴影。

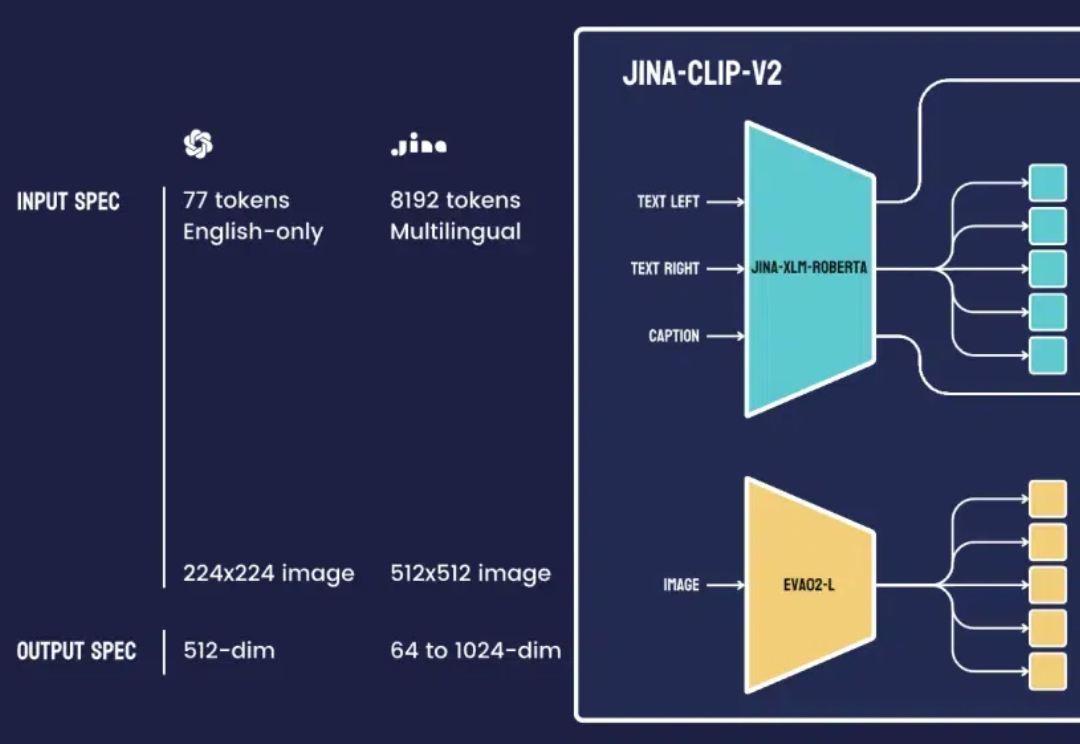

检索-增强生成 (RAG) 是一个永不过时的话题,并在不断扩展以增强LLMs 的功能。对于那些不太熟悉RAG 的人来说:这种方法利用外部知识来增强模型的能力,从外部资源中检索您实际需要的信息。

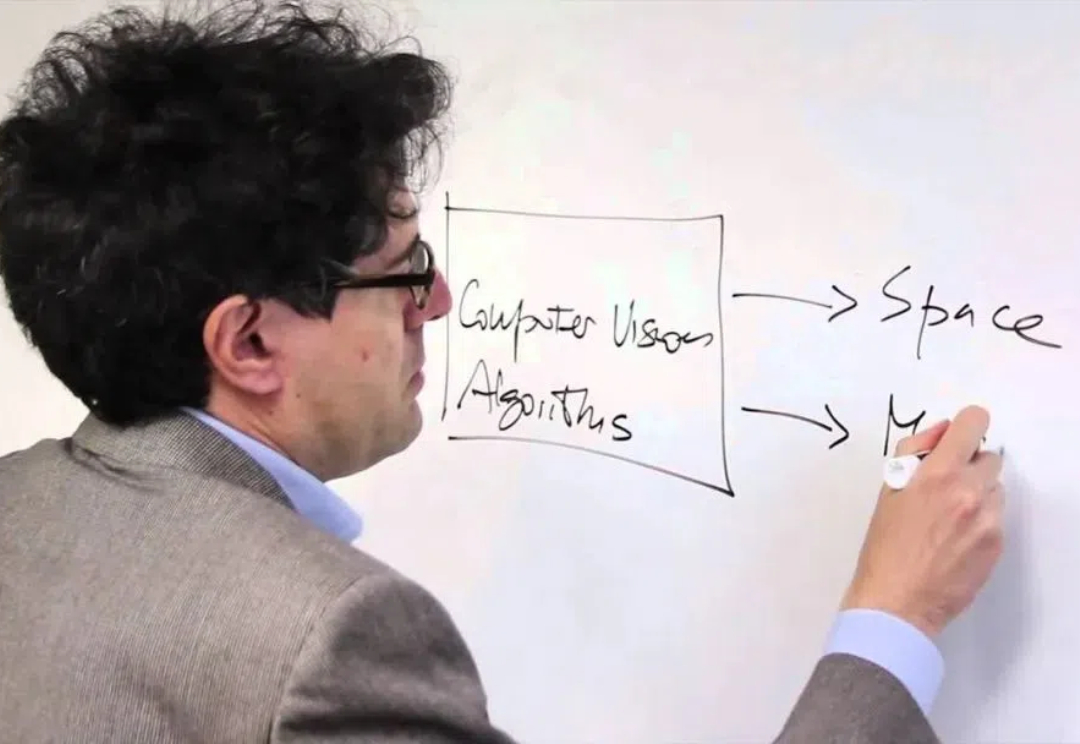

最近,我们团队的一位工程师在研究类 ColPali 模型时,受到启发,用新近发布的 jina-clip-v2 模型做了个颇具洞察力的可视化实验。