ACL 2024 Oral|我们离真正的多模态思维链推理还有多远?

ACL 2024 Oral|我们离真正的多模态思维链推理还有多远?在过去的几年中,大型语言模型(Large Language Models, LLMs)在自然语言处理(NLP)领域取得了突破性的进展。这些模型不仅能够理解复杂的语境,还能够生成连贯且逻辑严谨的文本。

在过去的几年中,大型语言模型(Large Language Models, LLMs)在自然语言处理(NLP)领域取得了突破性的进展。这些模型不仅能够理解复杂的语境,还能够生成连贯且逻辑严谨的文本。

Product Hunt 上 AI 产品榜历史第一即将刷新。

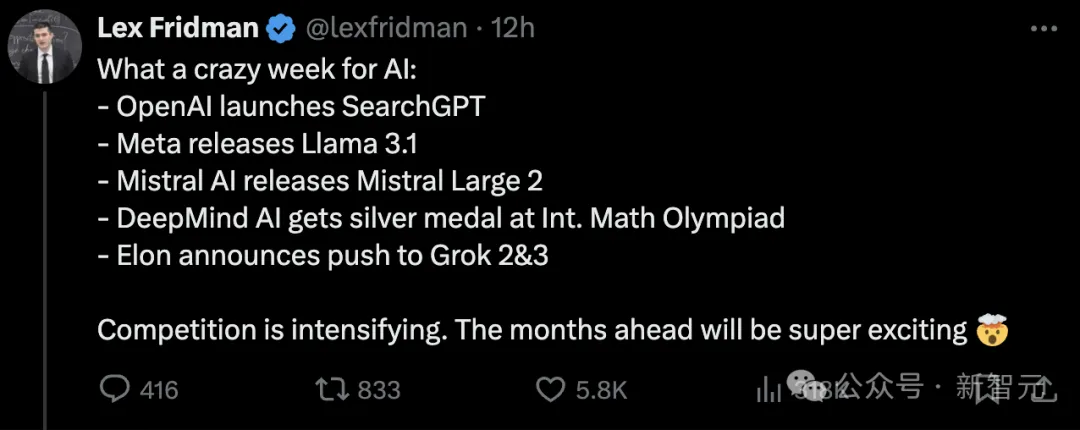

如果我们今天要谈论科技或风险投资,那么接下来的话题只会让我们想到 AI.

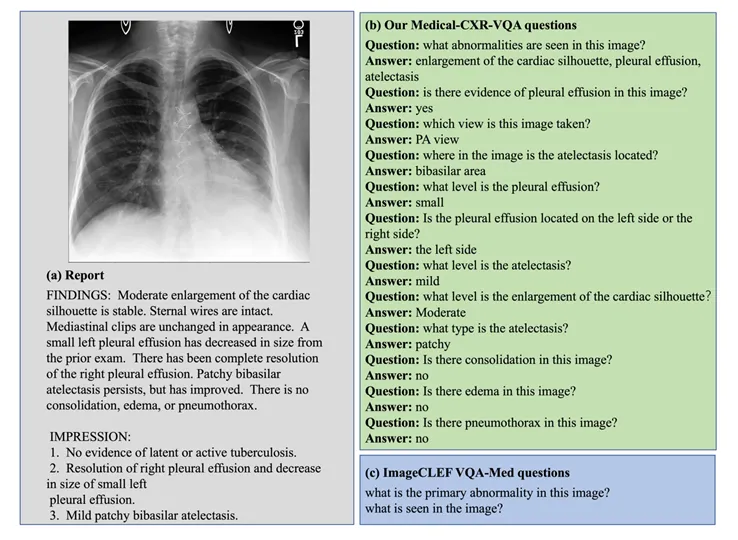

多模态大语言模型 (Multimodal Large Language Moodel, MLLM) 以其强大的语言理解能力和生成能力,在各个领域取得了巨大成功。

LLM数学水平不及小学生怎么办?CMU清华团队提出了Lean-STaR训练框架,在语言模型进行推理的每一步中都植入CoT,提升了模型的定理证明能力,成为miniF2F上的新SOTA。

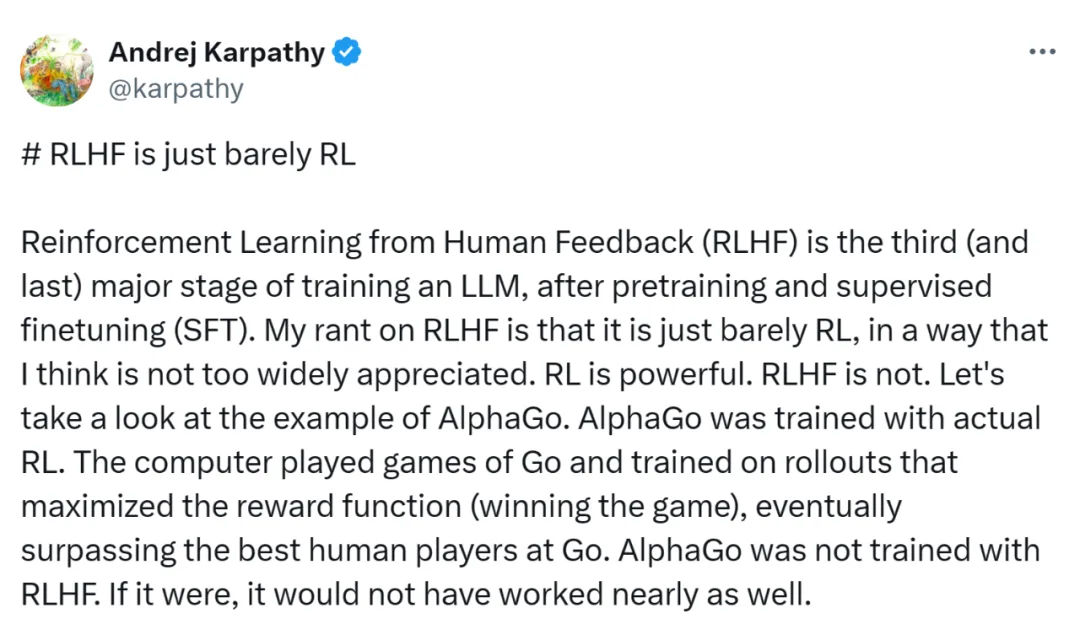

RLHF到底是不是强化学习?最近,AI大佬圈因为这个讨论炸锅了。和LeCun同为质疑派的Karpathy表示:比起那种让AlphaGo在围棋中击败人类的强化学习,RLHF还差得远呢。

前段时间冲上热搜的问题「9.11比9.9大吗?」,让几乎所有LLM集体翻车。看似热度已过,但AI界大佬Andrej Karpathy却从中看出了当前大模型技术的本质缺陷,以及未来的潜在改进方向。

RLHF 与 RL 到底能不能归属为一类,看来大家还是有不一样的看法。

深度学习三巨头之一Yoshua Bengio的下一步动向公开了,关于AI安全——

Gary Marcus再写长文整顿AI巨头圈:我们最该害怕的奥特曼是山姆·奥特曼。