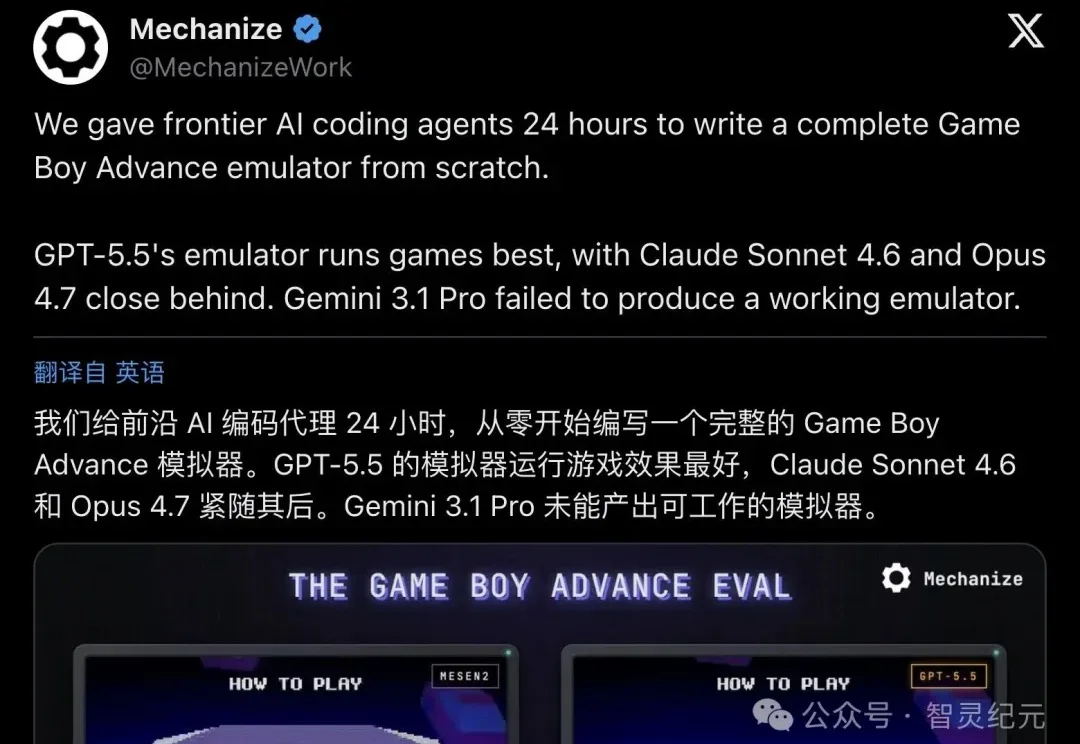

24小时从零写一个GBA模拟器!GPT-5.5跑出53分登顶,Gemini得了0.8分,底部还有两家交白卷

24小时从零写一个GBA模拟器!GPT-5.5跑出53分登顶,Gemini得了0.8分,底部还有两家交白卷Mechanize 发布了一项硬核测试:给前沿 AI coding agents 24 小时,用 Rust 从零写一个完整的 Game Boy Advance 模拟器,再和顶级开源模拟器 Mesen2 逐帧对比打分。

搜索

搜索

Mechanize 发布了一项硬核测试:给前沿 AI coding agents 24 小时,用 Rust 从零写一个完整的 Game Boy Advance 模拟器,再和顶级开源模拟器 Mesen2 逐帧对比打分。

Anthropic 在短短几年内就成为了OpenAI 的最强劲敌!

随着代码智能从 code foundation models 走向 autonomous coding agents,CLI/terminal 正在成为智能体进入真实软件工程工作流的重要入口。

4 月 9 日,Anthropic 在 X 上宣布 Claude Managed Agents 上线。同一天,一位 ID 叫 @jiayuan_jy 的中国创业者也发了一条推,“We created the open source version of Claude Managed Agents. Introducing Multica.”

昨天,OpenAI 和微软,官宣分手,今天,OpenAI 已在 AWS 把家安好。三件家具一起搬上:模型、Codex、Managed Agents。包括 GPT-5.5 在内的模型,今天起可以在 Amazon Bedrock 直接调用

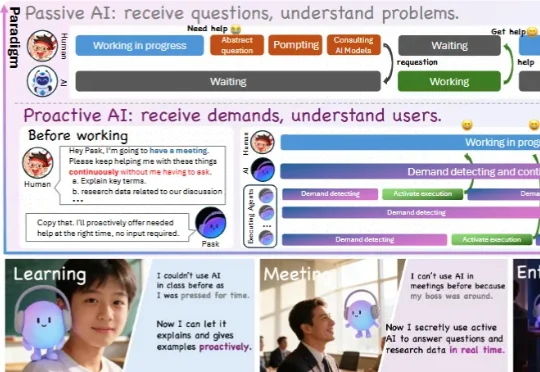

让AI像助手一样主动帮助,才是我们心中AGI的样子。主动智能体的概念已经被多次提出,但都很难做到可以真正在生活中落地。现有的工作都还停留在概念层面,无法解决复杂世界中所要求的实时性、深度、和记忆等问题。 南洋理工大学谢之非团队提出Pask,使用「底层小模型流式意图检测」+ 「上层Agents执行」架构,实现首个能够做到实时、有深度、基于个人全局记忆自进化的主动智能体。

OpenAI在ChatGPT里正式上线workspace agents,由Codex驱动,云端7×24运行,能跨数十种工具执行任务。GPTs进入退休倒计时。5月6日前免费体验。

就在刚刚,Agents SDK迎来一次彻底的架构重写。原生harness、原生沙盒、Codex级的文件系统工具,外加七家头部沙盒厂商一键接入。3月初,GPT-5.4带着原生computer use(计算机使用)高调登场时,开发者就已经吐槽过一件事。

Notion 应该是最擅长做 Agent,而且是最成功的团队之一了。

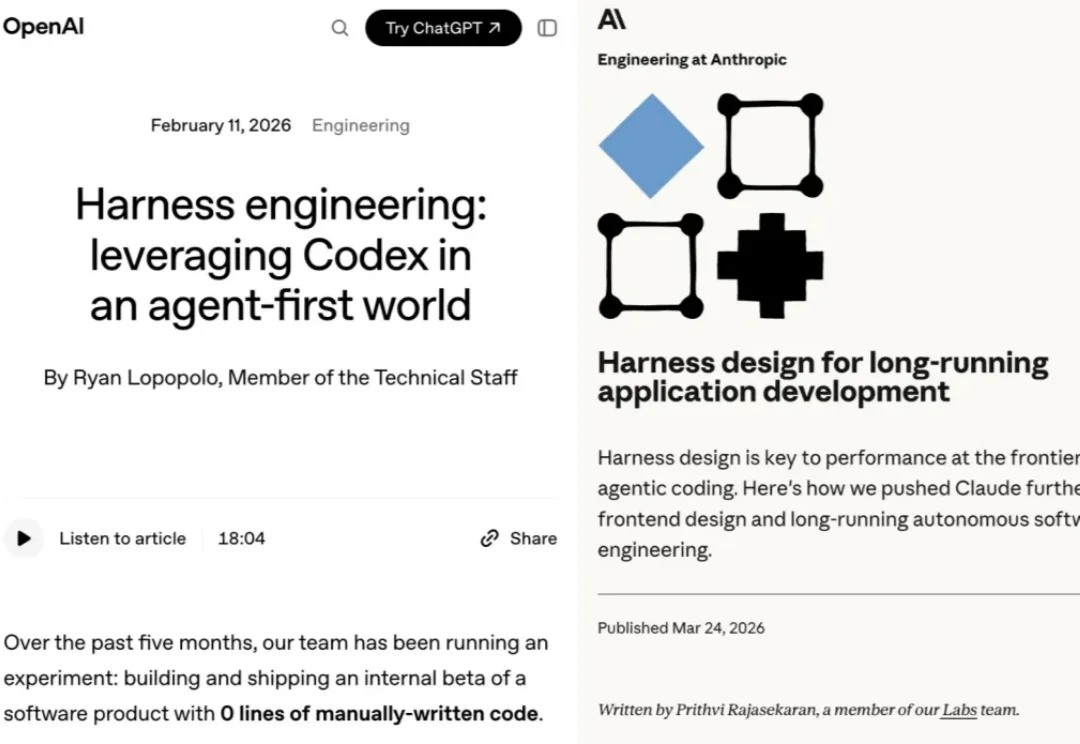

026 年初,OpenAI 和 Anthropic 几乎同时发布了关于 Harness 的技术实践文章,LangChain 工程师 Viv 给出了一个简洁的公式来概括这个理念:Agent = Model + Harness。模型提供智能,Harness 让这个智能能真正投入生产。