苹果突然发布新iMac:M4芯片加持,AI功能终于推送

苹果突然发布新iMac:M4芯片加持,AI功能终于推送就在昨晚,苹果发布了搭载M4芯片的新款iMac。

就在昨晚,苹果发布了搭载M4芯片的新款iMac。

2016 年冬天,荣耀发布了第一代荣耀 Magic 手机和 MagicUI 系统,喊出「致未来」的口号,表示要打开手机的「智慧」之门。

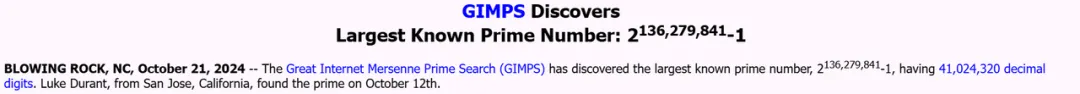

人类已知最大的素数,被GPU发现了!英伟达前员工Luke Durant发现的2136279841-1,比前一个纪录保持者多出1600万位,由A100计算,H100确认。为此,小哥搭了数千个GPU的「云超算」,分布在17个国家。

本期TICLAB直播,我们特别邀请到跃然创新CEO李勇,飞迅智瞳创始人&CEO姜洪兵,和我们一起聊聊他们如何在AI教育硬件领域寻找产品的市场契合点(PMF),以及他们如何突破传统教育以及硬件的局限,用技术为教育带来创新的解决方案。

没错,就是CPU——Central Processing Unit,中央处理器。

智能戒指加上 AI,是不是个好主意? 沉寂了3年的智能穿戴设备公司 Oura 正式推出了其最新款智能戒指 Oura Ring 4,让人不得不注意的是,这是一款更合时宜,加入 AI 功能的智能戒指。

“这是我听过的黄仁勋最好的采访!”

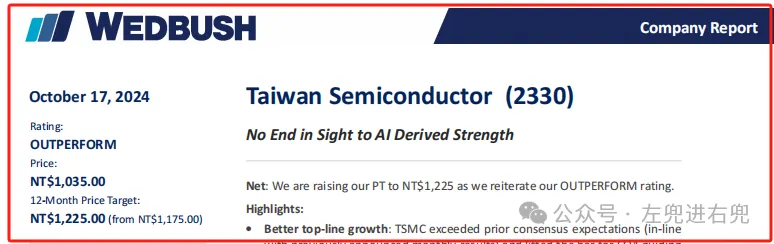

上周台积电发布完Q3财报后,上涨了10%带动了AI芯片股集体上涨,WEDBUSH、高盛、JP摩根,大摩等金融机构在Q3财报后发布了最新研报。

你绝对没有看错,这款产品就是要用AI来分析和检查你的便便,从而了解你的肠道健康和水分摄入等情况。