那么多接入 DeepSeek 的,终于有一家支持 Function Call 了!!!

那么多接入 DeepSeek 的,终于有一家支持 Function Call 了!!!众所周知,目前 DeepSeek R1 有一个很大的痛点是不支持 Function Call 的。GitHub 上有许多开发者都表达了这一诉求。

搜索

搜索

众所周知,目前 DeepSeek R1 有一个很大的痛点是不支持 Function Call 的。GitHub 上有许多开发者都表达了这一诉求。

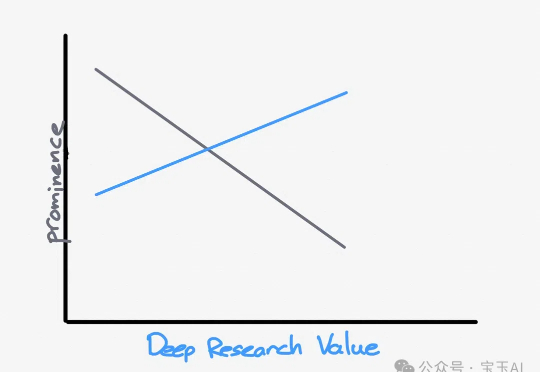

知名博主 Ben Thompson 在使用 Deep Research 后写的一篇 Deep Research and Knowledge Value[1],谈到了在信息搜索上带来的价值。

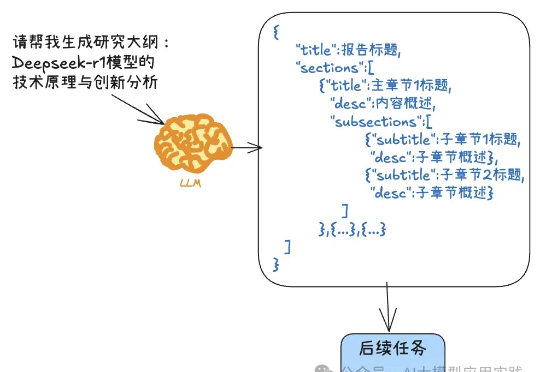

DeepSeek-R1这样的推理模型有着强大的深度思考能力,但也有着一些不同于通用模型的特点与用法,比如不支持函数调用,不支持结构化输出,o1甚至不支持系统提示(System Prompt)等。尽管这和它们的使用场景有关,但有时也会带来不便。今天我们就来说说结构化输出这个常见的问题。

就在刚刚,DeepSeek 在 X 平台发文宣布,将在下周(OpenSourceWeek 开源周)连续五天开源 5 个项目的代码库。

近日,美国知名播客Invest Like the Best再次访谈了Andreessen Horowitz的联合创始人Marc Andreessen,在访谈中,Marc和主播Patrick深入探讨了AI正在重塑技术和地缘政治的重大变革,并讨论了DeepSeek的开源人工智能以及其大国技术竞争中的意义,此外,他们还分享了对全球权力结构演变的看法,以及风险投资行业整体的转型。

赛博温存,1万起步

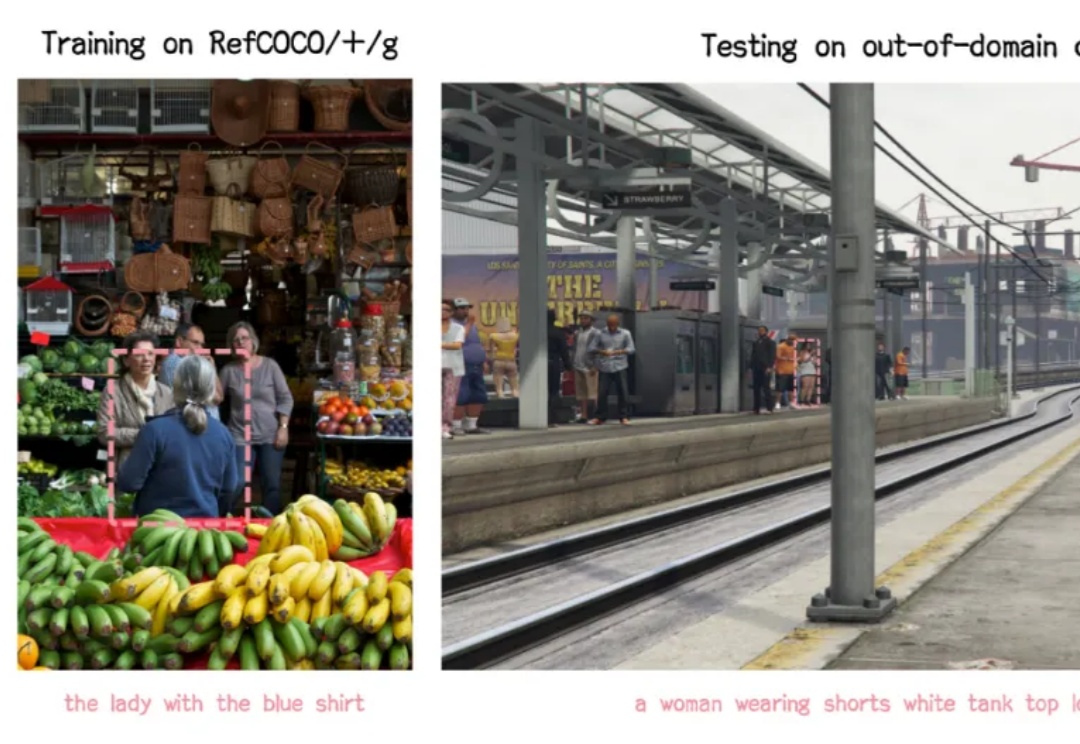

嘿,各位开发小伙伴,今天要给大家安利一个全新的开源项目 ——VLM-R1!它将 DeepSeek 的 R1 方法从纯文本领域成功迁移到了视觉语言领域,这意味着打开了对于多模态领域的想象空间!

绝对能创造价值的地方在于那些拥有一系列客户关系、能提供明确价值,并且愿意足够快地拥抱人工智能,从而不会被颠覆者取代的公司。

8999!比iPhone 16 Pro还贵,史上起售价最高的国产安卓AI手机来了!

在AI时代,腾讯的新人设是拥有“后发优势”的拳手