奥特曼深夜发动价格战,GPT-4o mini暴跌99%!清华同济校友立功,GPT-3.5退役

奥特曼深夜发动价格战,GPT-4o mini暴跌99%!清华同济校友立功,GPT-3.5退役GPT-4o mini深夜忽然上线,OpenAI终于开卷小模型!每百万输入token已达15美分的超低价,跟GPT-3相比,两年内模型成本已降低99%。Sam Altman惊呼:通往智能的成本,已变得如此低廉!另外,清华同济校友为关键负责人。

GPT-4o mini深夜忽然上线,OpenAI终于开卷小模型!每百万输入token已达15美分的超低价,跟GPT-3相比,两年内模型成本已降低99%。Sam Altman惊呼:通往智能的成本,已变得如此低廉!另外,清华同济校友为关键负责人。

“GPT-3.5(ChatGPT) API将在某个时刻退役——只是不确定在何时。”在The Verge的采访中,OpenAI API平台负责人Olivier Godement如此总结。

OpenAI突发新模型,GPT-3.5退役,大模型成本2年骤降99%

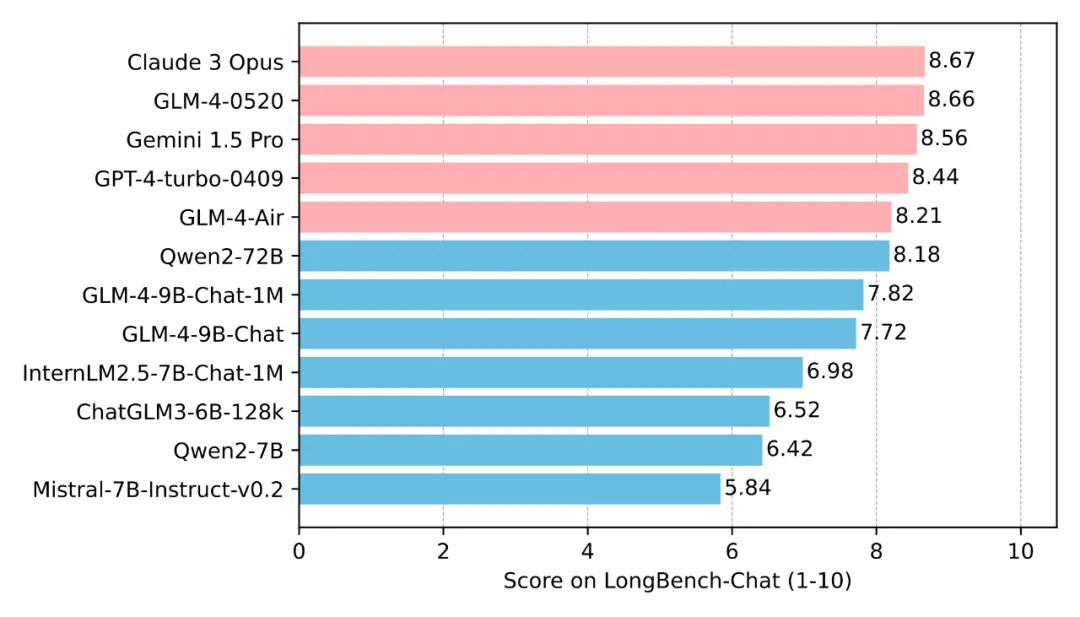

在2023年初,即便是当时最先进的GPT-3.5,其上下文长度也仅限于2k。然而,时至今日,1M的上下文长度已经成为衡量模型技术先进性的重要标志之一。

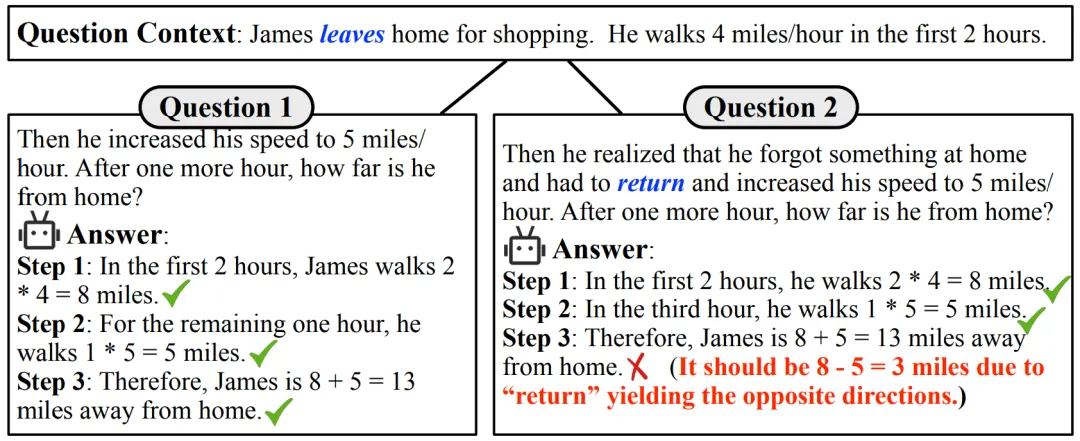

大型语言模型(LLMs)在解决问题方面的非凡能力日益显现。最近,一个值得关注的现象是,这些模型在多项数学推理的基准测试中获得了惊人的成绩。以 GPT-4 为例,在高难度小学应用题测试集 GSM8K [1] 中表现优异,准确率高达 90% 以上。同时,许多开源模型也展现出了不俗的实力,准确率超过 80%。

机器人行业的「GPT-3」时刻已经出现?

GPT-3 时刻正在进入机器人世界。

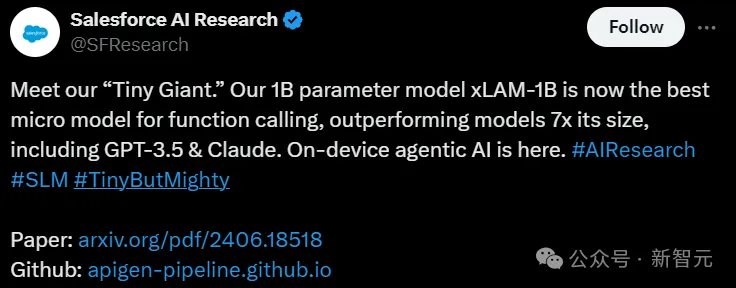

只有10亿参数的xLAM-1B在特定任务中击败了LLM霸主:OpenAI的GPT-3.5 Turbo和Anthropic的Claude-3 Haiku。上个月刚发布的苹果智能模型只有30亿参数,就连奥特曼都表示,我们正处于大模型时代的末期。那么,小语言模型(SLM)会是AI的未来吗?

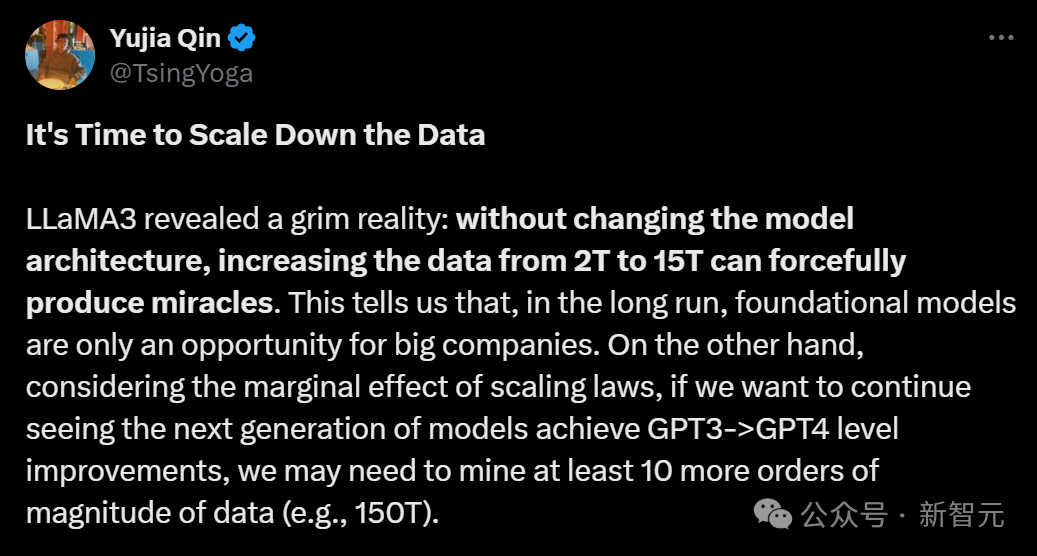

是时候把数据Scale Down了!Llama 3揭示了这个可怕的事实:数据量从2T增加到15T,就能大力出奇迹,所以要想要有GPT-3到GPT-4的提升,下一代模型至少还要150T的数据。好在,最近有团队从CommonCrawl里洗出了240T数据——现在数据已经不缺了,但你有卡吗?

基于 Transformer架构的大型语言模型在各种基准测试中展现出优异性能,但数百亿、千亿乃至万亿量级的参数规模会带来高昂的服务成本。例如GPT-3有1750亿参数,采用FP16存储,模型大小约为350GB,而即使是英伟达最新的B200 GPU 内存也只有192GB ,更不用说其他GPU和边缘设备。