AI算力大战打到太空!英伟达前脚H100入轨,谷歌TPU后脚上天,中国玩家笑而不语

AI算力大战打到太空!英伟达前脚H100入轨,谷歌TPU后脚上天,中国玩家笑而不语英伟达和谷歌,抢着上天了!

搜索

搜索

英伟达和谷歌,抢着上天了!

地球现在连显卡都供不起了,微软的GPU插不进机房。英伟达的H100直接飞向太空。

11 月 2 日,英伟达首次把 H100 GPU 送入了太空,参阅报道《英伟达发射了首个太空 AI 服务器,H100 已上天》。而刚刚谷歌宣布,他们也要让 TPU 上天。

11 月 2 日,英伟达首次把 H100 GPU 送入了太空。作为目前 AI 领域的主力训练芯片,H100 配备 80GB 内存,其性能是此前任何一台进入太空的计算机的上百倍。在轨道上,它将测试一系列人工智能处理应用,包括分析地球观测图像和运行谷歌的大语言模型(LLM)。

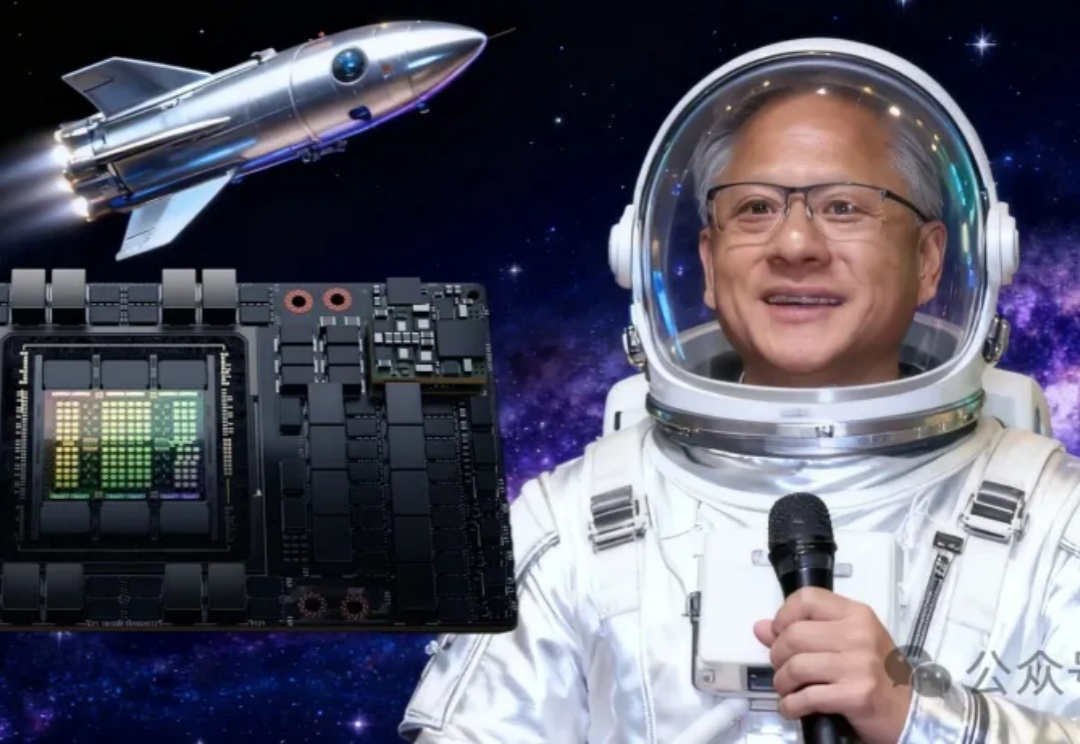

一张图,一个3D世界!今天,李飞飞团队重磅放出实时生成世界模型「RTFM」,通过端到端学习大规模视频数据,直接从输入2D图像生成同一场景下新视角的图像。值得一提的是,它仅需单块H100 GPU便能实时渲染出持久且3D一致的世界。

李飞飞的世界模型创业,最新成果来了!刚刚,教母亲自宣布对外推出全新模型RTFM(A Real-Time Frame Model),不仅具备实时运行、持久性和3D一致性,更关键的是——单张H100 GPU就能跑。

马斯克宣布了一个疯狂的计划,将在5年内实现5000万张H100的算力,这是什么概念?这将为人类带来怎样的影响?ASI能否在勇敢者的孤注一掷下现身?

今天 ,OpenAI 开源了俩模型:120B/20B 117B 的 gpt-oss-120b 对标 o4-min,按官方说法至少需要 80G 内存,推荐使用单卡 H100 GPU 而刚买的的游戏本,刚好满足gpt-oss-120b 的部署条件

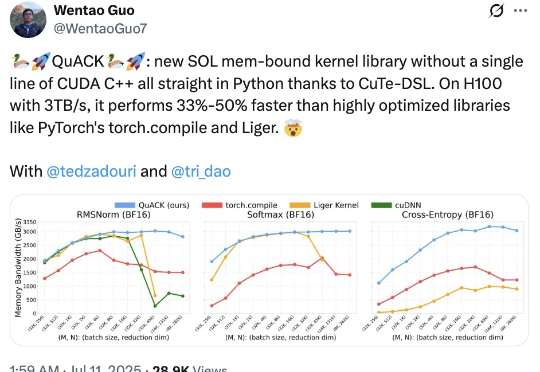

无需CUDA代码,给H100加速33%-50%! Flash Attention、Mamba作者之一Tri Dao的新作火了。

今年,AI大厂采购GPU的投入又双叒疯狂加码——马斯克xAI打算把自家的10万卡超算扩增10倍,Meta也计划投资100亿建设一个130万卡规模的数据中心……GPU的数量,已经成为了互联网企业AI实力的直接代表。