ICLR神秘论文曝光!SAM3用「概念」看世界,重构视觉AI新范式

ICLR神秘论文曝光!SAM3用「概念」看世界,重构视觉AI新范式2023年Meta推出SAM,随后SAM 2扩展到视频分割,性能再度突破。近日,SAM 3悄悄现身ICLR 2026盲审论文,带来全新范式——「基于概念的分割」(Segment Anything with Concepts),这预示着视觉AI正从「看见」迈向真正的「理解」。

搜索

搜索

2023年Meta推出SAM,随后SAM 2扩展到视频分割,性能再度突破。近日,SAM 3悄悄现身ICLR 2026盲审论文,带来全新范式——「基于概念的分割」(Segment Anything with Concepts),这预示着视觉AI正从「看见」迈向真正的「理解」。

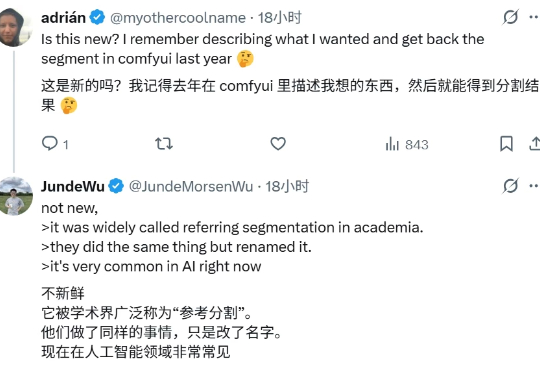

说出概念,SAM 3 就明白你在说什么,并在所有出现的位置精确描绘出边界。 Meta 的「分割一切」再上新? 9 月 12 日,一篇匿名论文「SAM 3: SEGMENT ANYTHING WITH CONCEPTS」登陆 ICLR 2026,引发网友广泛关注。

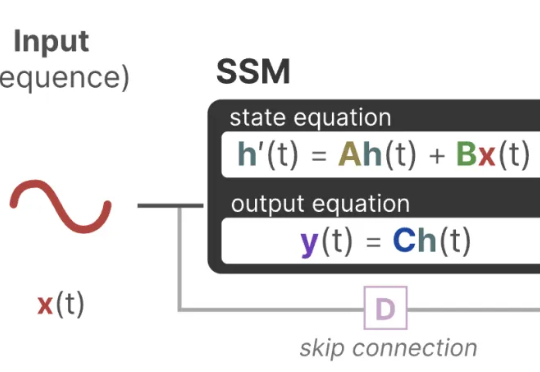

曼巴回来了!Transformer框架最有力挑战者之一Mamba的最新进化版本Mamba-3来了,已进入ICLR 2026盲审环节,超长文本处理和低延时是其相对Transformer的显著优势。另一个挑战者是FBAM,从不同的角度探索Transformer的下一代框架。

在9月底的苏黎世电影节上,一位名叫Tilly Norwood的「女演员」亮相,引发媒体和网友热议。「她」由AI制作公司Particle6打造,是全球首批AI生成演员角色之一。Tilly的出现,意味着以Sora为代表的AI视频生成技术正加速渗透,并可能深刻改变影视行业。

Tilly Norwood 有一张干净的脸孔,能演超英大片里的配角,也能出现在 BBC2 的喜剧小品里。但唯一的问题是:她不存在。她是英国公司 Particle6 Productions 用 AI 生成的「女演员」。从脸到声线、从履历到社交账号,全部都是虚拟构建。

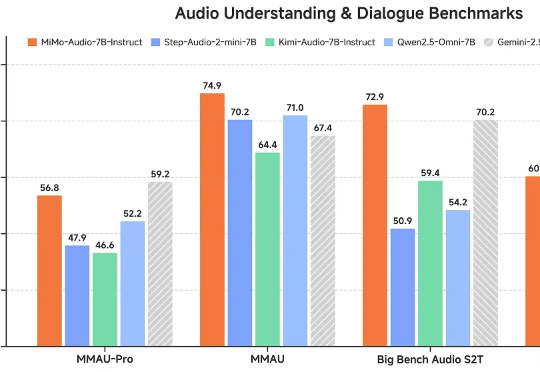

这一瓶颈如今被打破。小米正式开源首个原生端到端语音模型——Xiaomi-MiMo-Audio,它基于创新预训练架构和上亿小时训练数据,首次在语音领域实现基于 ICL 的少样本泛化,并在预训练观察到明显的“涌现”行为。

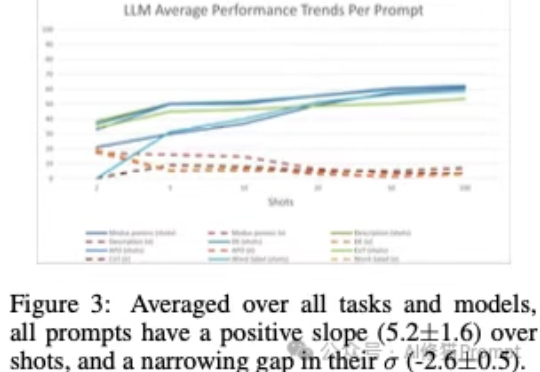

上下文学习”(In-Context Learning,ICL),是大模型不需要微调(fine-tuning),仅通过分析在提示词中给出的几个范例,就能解决当前任务的能力。您可能已经对这个场景再熟悉不过了:您在提示词里扔进去几个例子,然后,哇!大模型似乎瞬间就学会了一项新技能,表现得像个天才。

刚刚,又一个人工智能国际顶会为大模型「上了枷锁」。 ICLR 2025 已于今年 4 月落下了帷幕,最终接收了 11565 份投稿,录用率为 32.08%。

AI来了,一场悄无声息的「岗位绝种」来了。AI已深度渗透新闻采编、聚合与分发流程,从Perplexity豪赌345亿美元收购Chrome,到Particle打造全景式新闻摘要,AI正重构信息入口与用户体验。记者岗位面临「寂静灭绝」,57%的人认为会被取代。

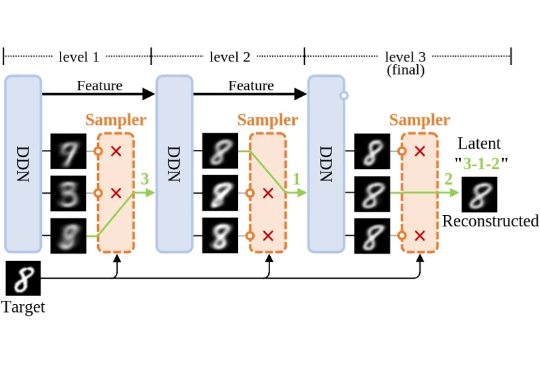

本项工作提出了一种全新的生成模型:离散分布网络(Discrete Distribution Networks),简称 DDN。相关论文已发表于 ICLR 2025。