从LLM到AI Agent,从Workflow到Agentic Workflow,25篇论文全面了解智能体工作流

从LLM到AI Agent,从Workflow到Agentic Workflow,25篇论文全面了解智能体工作流著名AI学者、斯坦福大学教授吴恩达提出了AI Agent的四种设计方式后,Agentic Workflow(智能体工作流)立即火爆全球,多个行业都在实践智能体工作流的应用,并推动了新的Agentic AI探索热潮。

搜索

搜索

著名AI学者、斯坦福大学教授吴恩达提出了AI Agent的四种设计方式后,Agentic Workflow(智能体工作流)立即火爆全球,多个行业都在实践智能体工作流的应用,并推动了新的Agentic AI探索热潮。

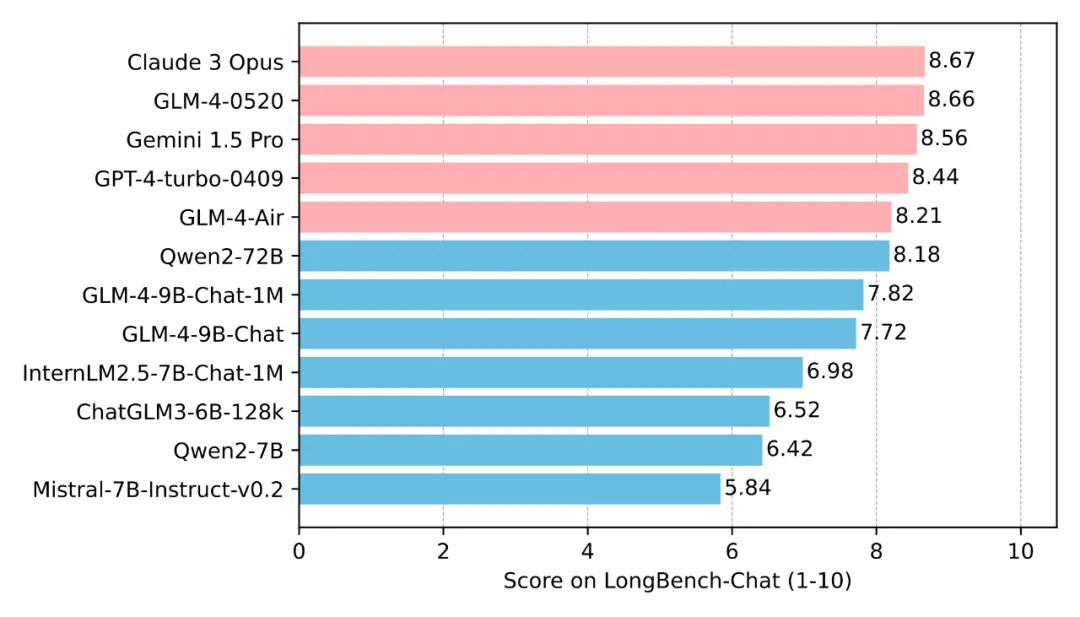

在2023年初,即便是当时最先进的GPT-3.5,其上下文长度也仅限于2k。然而,时至今日,1M的上下文长度已经成为衡量模型技术先进性的重要标志之一。

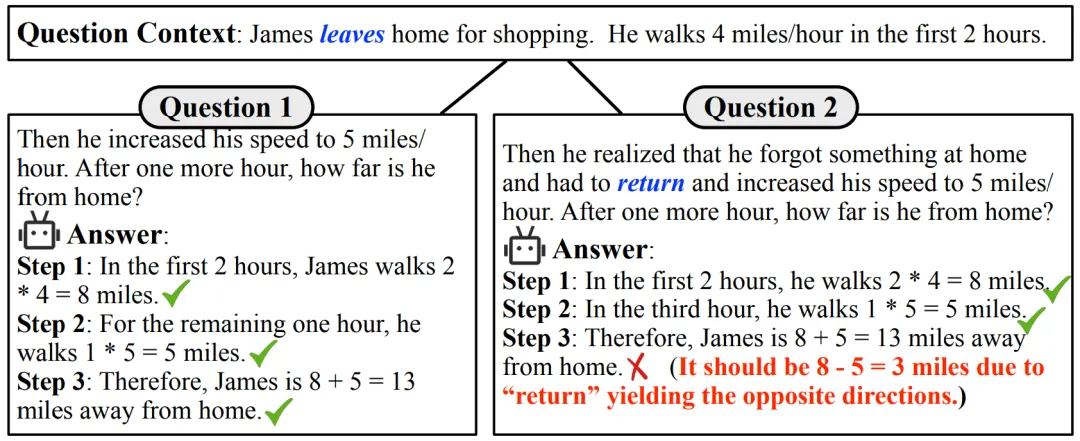

大型语言模型(LLMs)在解决问题方面的非凡能力日益显现。最近,一个值得关注的现象是,这些模型在多项数学推理的基准测试中获得了惊人的成绩。以 GPT-4 为例,在高难度小学应用题测试集 GSM8K [1] 中表现优异,准确率高达 90% 以上。同时,许多开源模型也展现出了不俗的实力,准确率超过 80%。

刚刚,信息检索领域的国际顶会SIGIR 2024,公布了最终获奖结果。在所有获奖名单中,来自清华计算机系的团队们斩获了两大奖项——时间检验奖、最佳论文奖,实至名归!

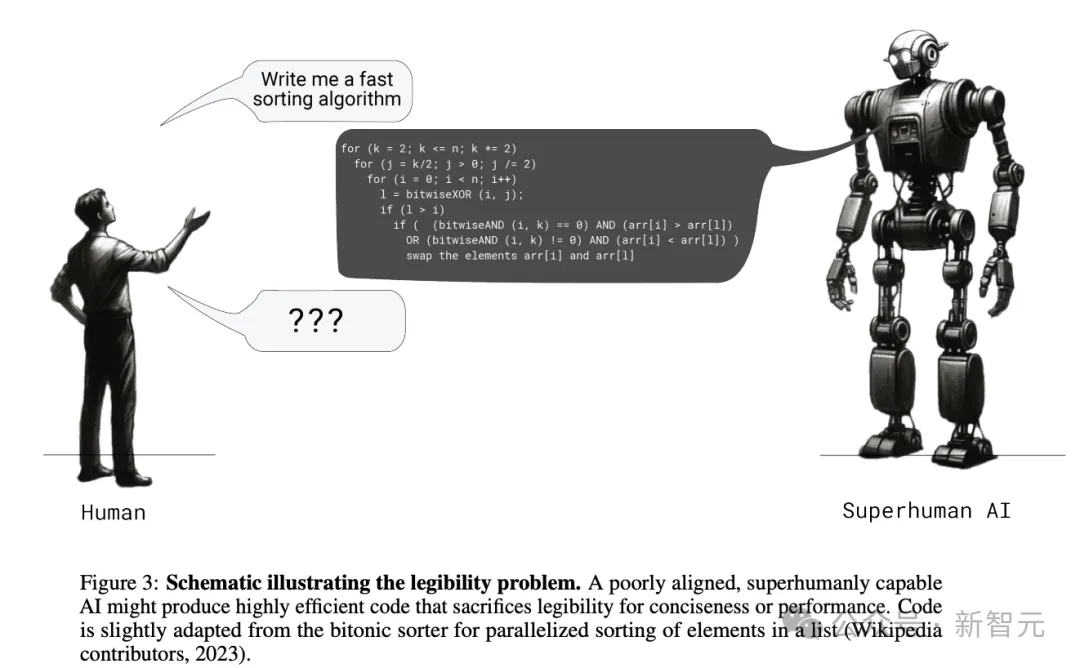

当我们不停在CoT等领域大下苦功、试图提升LLM推理准确性的同时,OpenAI的对齐团队从另一个角度发现了华点——除了准确性,生成答案的清晰度、可读性和可验证性也同样重要。

微软推出AI模型SpreadsheetLLM,提升电子表格处理效率。

具身智能是过去一年中和 LLM 一样受到市场高度关注的领域,通用机器人领域什么时候会出现「iPhone 时刻」?这是所有人都关注的问题。拾象团队在过去一年中也深度追踪通用机器人和机器人 foundation model 的进展。本篇文章是我们对机器人领域研究的开源。

自回归解码已经成为了大语言模型(LLMs)的事实标准,大语言模型每次前向计算需要访问它全部的参数,但只能得到一个token,导致其生成昂贵且缓慢。

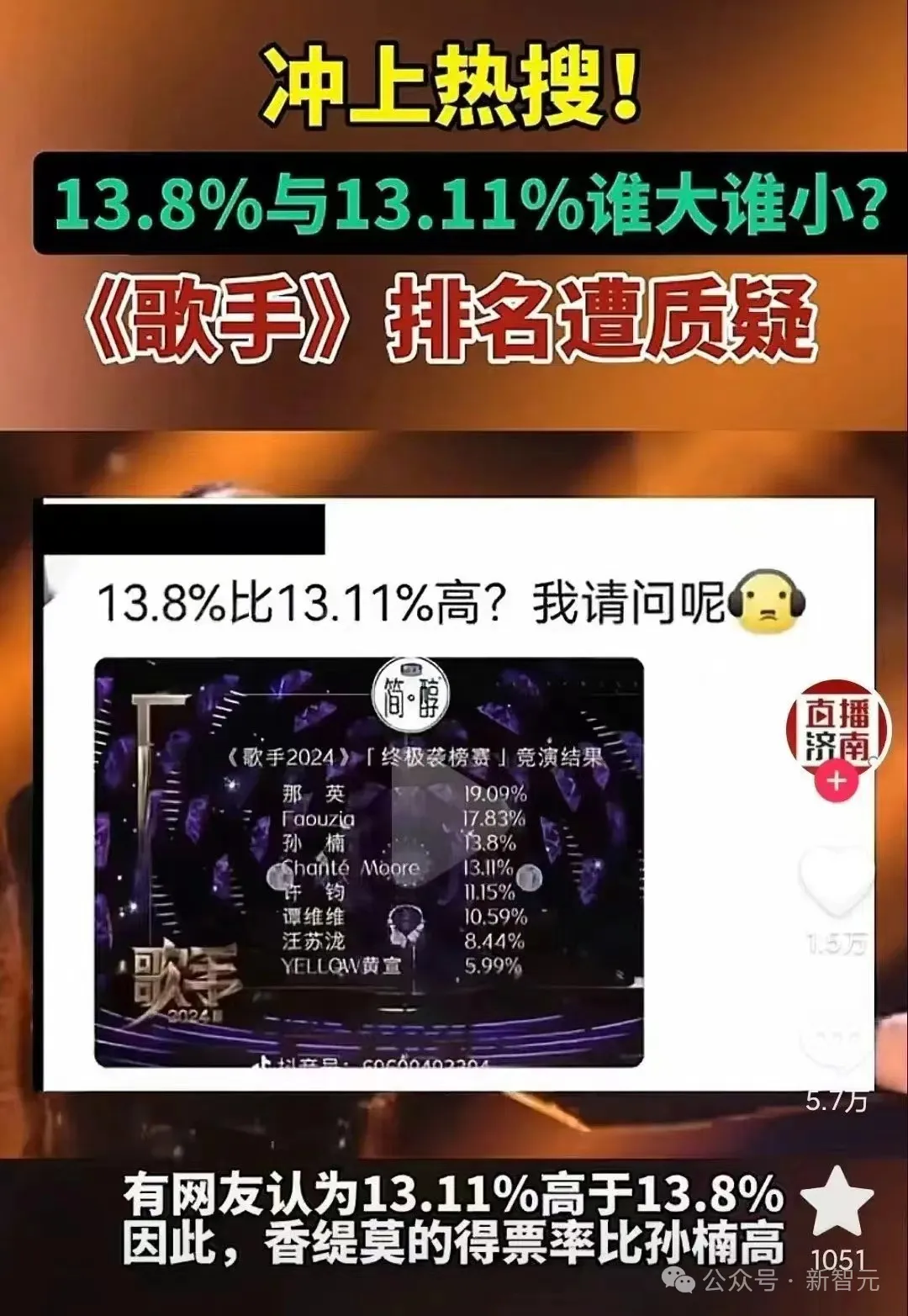

13.8和13.11哪个大?这个问题不光难倒了部分人类,还让一票大模型折戟。AI如今都能做AI奥数题了,但简单的常识问题对它们依然难如登天。其实,无论是比大小,还是卷心菜难题,都揭示了LLM在token预测上的一个重大缺陷。

大模型理解、推理Excel,现在变得更加精准了。