专治大模型说胡话,精确率100%!华科等提出首个「故障token」检测/分类方法

专治大模型说胡话,精确率100%!华科等提出首个「故障token」检测/分类方法如今,大型语言模型(LLM)已经成为了我们生活中的好帮手

搜索

搜索

如今,大型语言模型(LLM)已经成为了我们生活中的好帮手

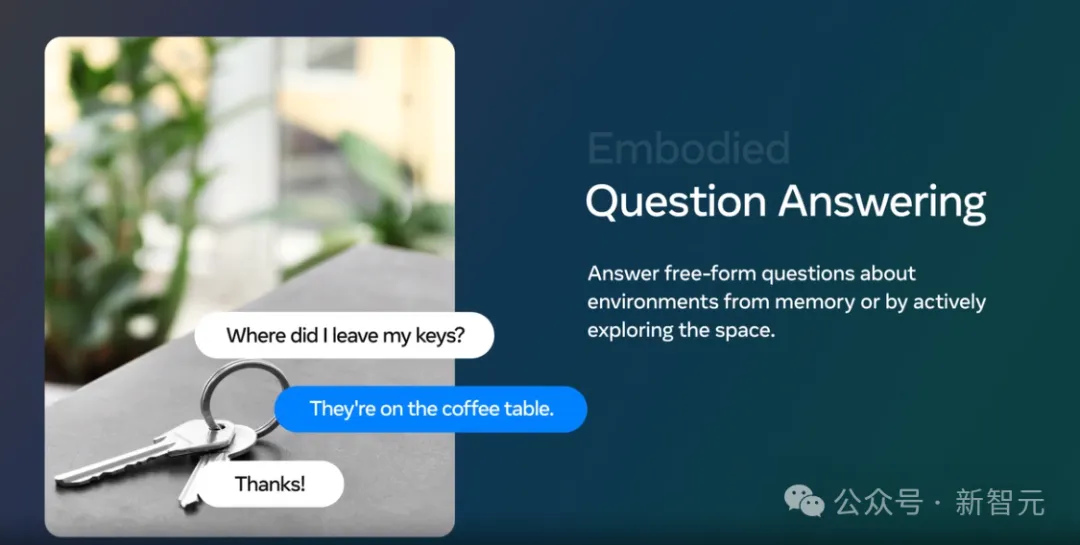

LLM已经可以理解文本和图片了,也能够根据它们的历史知识回答各种问题,但它们或许对周围世界当前发生的事情一无所知

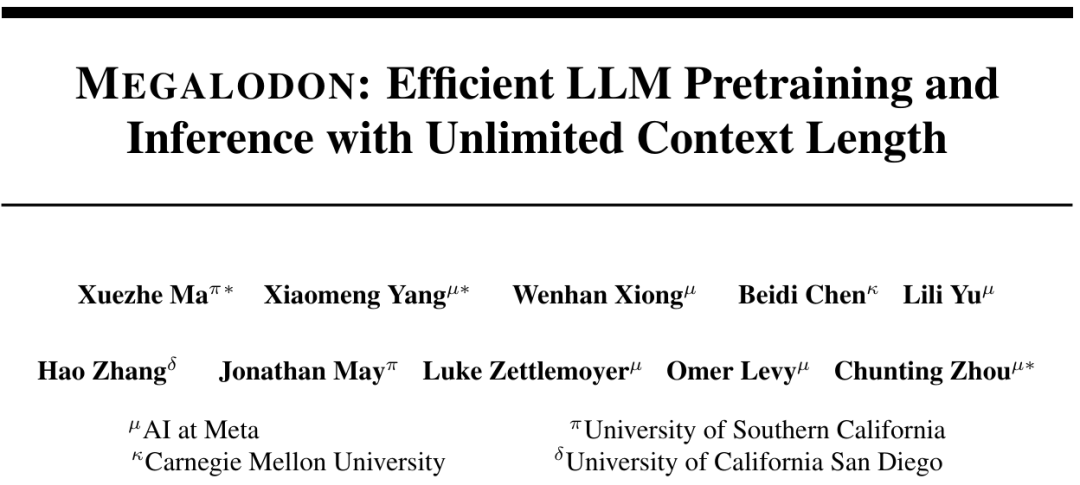

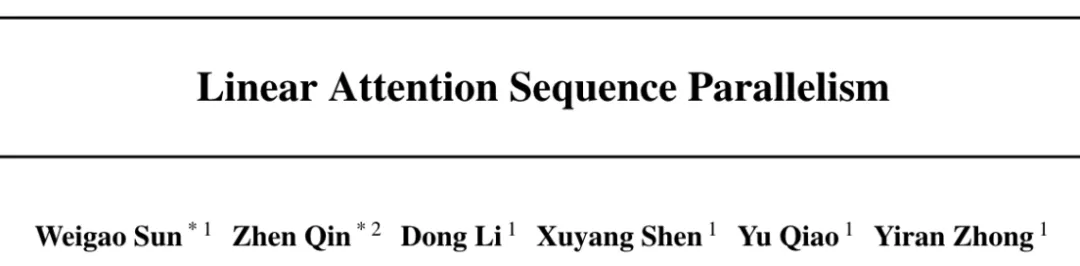

Transformers 的二次复杂度和弱长度外推限制了它们扩展到长序列的能力,虽然存在线性注意力和状态空间模型等次二次解决方案

从国际顶流 GPT-4 128K、Claude 200K 到国内「当红炸子鸡」支持 200 万字上下文的 Kimi Chat,大语言模型(LLM)在长上下文技术上不约而同地卷起来了

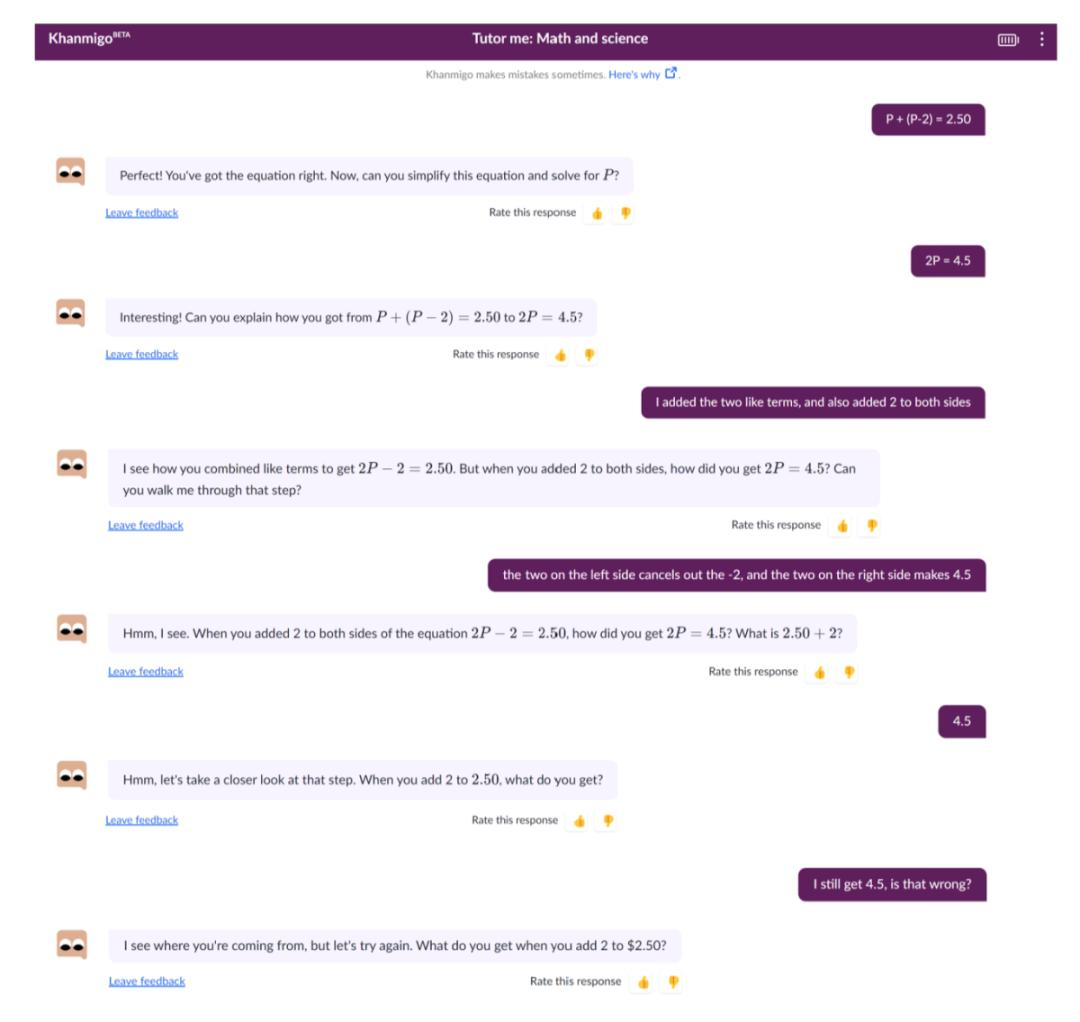

生成式人工智能(Generative Artificial Intelligence,简称生成式 AI)是 AI 的一种形式,可以生成从论文到视频等任何东西,协助人类处理信息和数据。生成式人工智能的引入,特别是 ChatGPT 等「大型语言模型」(LLM) 聊天机器人的引入,使得许多人预测这项新技术将改变现有的教育模式。

人工智能模型在对话说服力方面表现如何?

近,来自澳大利亚蒙纳士大学、蚂蚁集团、IBM 研究院等机构的研究人员探索了模型重编程 (model reprogramming) 在大语言模型 (LLMs) 上应用,并提出了一个全新的视角

为解决大模型(LLMs)在处理超长输入序列时遇到的内存限制问题,本文作者提出了一种新型架构:Infini-Transformer,它可以在有限内存条件下,让基于Transformer的大语言模型(LLMs)高效处理无限长的输入序列。实验结果表明:Infini-Transformer在长上下文语言建模任务上超越了基线模型,内存最高可节约114倍。

在实践中,人类预测的准确性依赖于「群体智慧」(wisdom of the crowd)效应,即通过聚集一群个体预测者,对未来事件的预测准确率会显著提高

大语言模型(LLM),通过在海量数据集上的训练,展现了超强的多任务学习、通用世界知识目标规划以及推理能力