奋战一年,LangChain首个稳定版本终于发布,LangGraph把智能体构建为图

奋战一年,LangChain首个稳定版本终于发布,LangGraph把智能体构建为图不知不觉,LangChain 已经问世一年了。作为一个开源框架,LangChain 提供了构建基于大模型的 AI 应用所需的模块和工具,大大降低了 AI 应用开发的门槛,使得任何人都可以基于 GPT-4 等大模型构建自己的创意应用。

搜索

搜索

不知不觉,LangChain 已经问世一年了。作为一个开源框架,LangChain 提供了构建基于大模型的 AI 应用所需的模块和工具,大大降低了 AI 应用开发的门槛,使得任何人都可以基于 GPT-4 等大模型构建自己的创意应用。

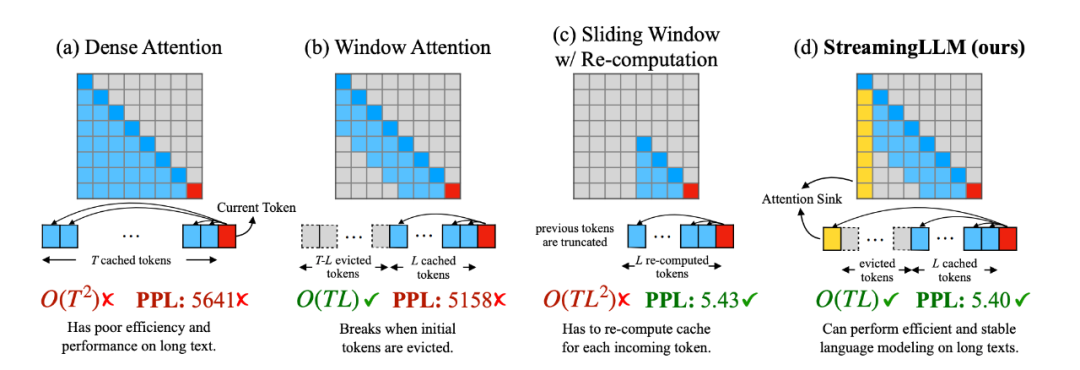

22倍加速还不够,再来提升46%,而且方法直接开源!这就是开源社区改进MIT爆火项目StreamingLLM的最新成果。

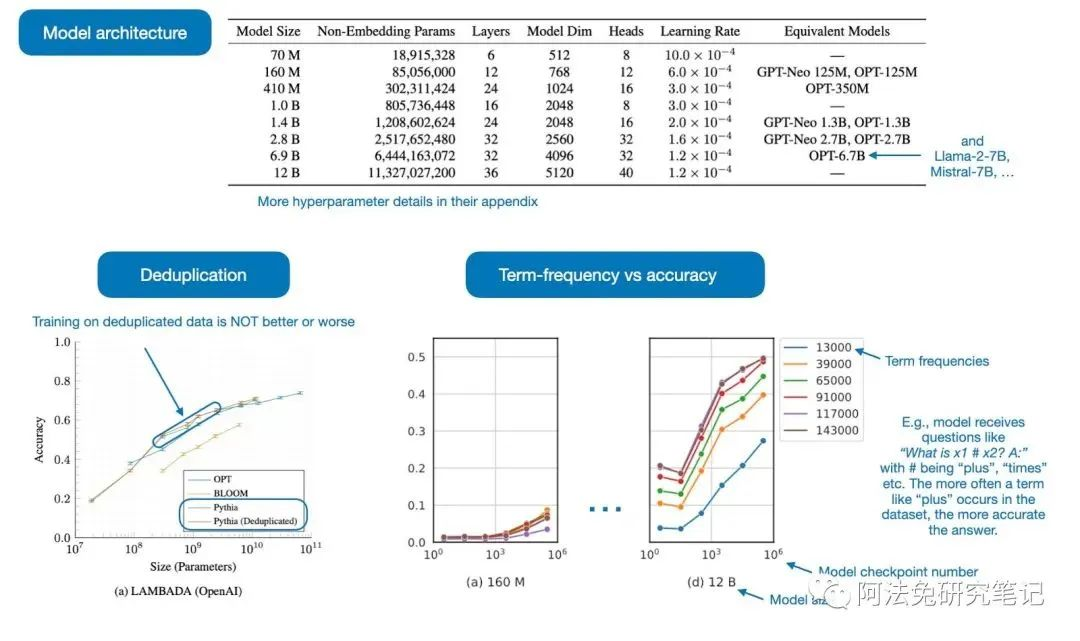

当大家都在研究大模型(LLM)参数规模达到百亿甚至千亿级别的同时,小巧且兼具高性能的小模型开始受到研究者的关注。

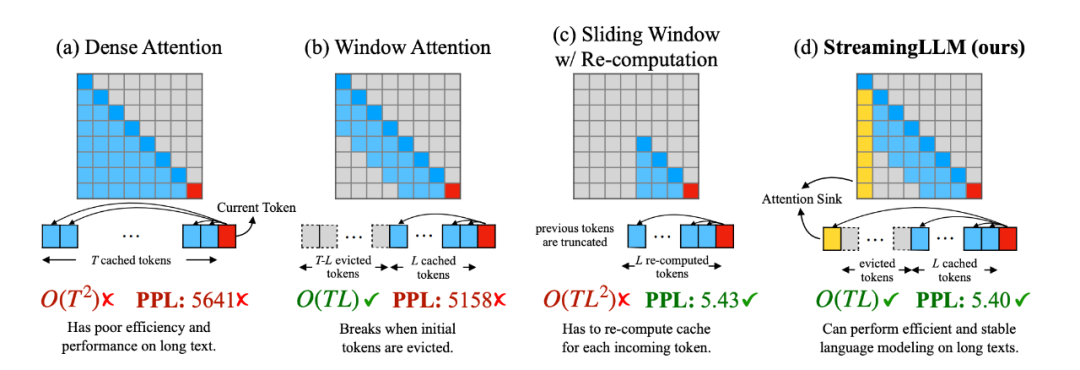

在大型语言模型(LLM)的世界中,处理多轮对话一直是一个挑战。前不久麻省理工 Guangxuan Xiao 等人推出的 StreamingLLM,能够在不牺牲推理速度和生成效果的前提下,可实现多轮对话总共 400 万个 token 的流式输入,22.2 倍的推理速度提升。

指令调优或许是让大模型性能提升最有潜力的方法。用高质量数据集进行指令调优,能让大模型性能快速提升。

大模型推理再次跃升一个新台阶!最近,全新开源的国产SwiftInfer方案,不仅能让LLM处理无限流式输入,而且还将推理性能提升了46%。

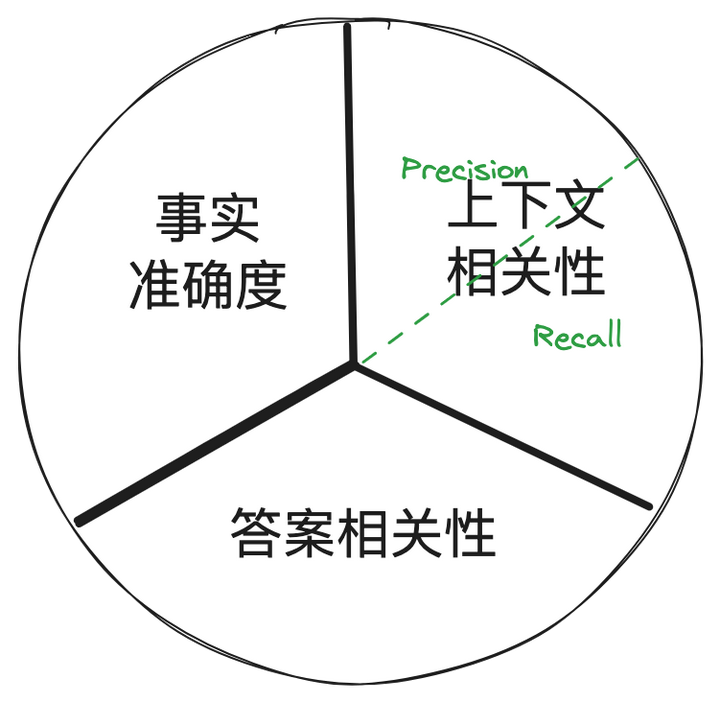

做所有的工作之前,想好如何评估结果、制定好北极星指标至关重要!!! Ragas把 RAG 系统的评估指标拆分为三个维度如下,这可不是 Benz 的标...

2023 年,是机器学习和人工智能发展最为迅速的一年,这里分享 10 篇最值得关注的论文。

同济大学王昊奋研究员团队联合复旦大学熊赟教授团队发布检索增强生成(RAG)综述,从核心范式,关键技术到未来发展趋势对 RAG 进行了全面梳理。这份工作为研究人员绘制了一幅清晰的 RAG 技术发展蓝图,指出了未来的研究探索方向。

语言模型究竟是如何感知时间的?如何利用语言模型对时间的感知来更好地控制输出甚至了解我们的大脑?最近,来自华盛顿大学和艾伦人工智能研究所的一项研究提供了一些见解。